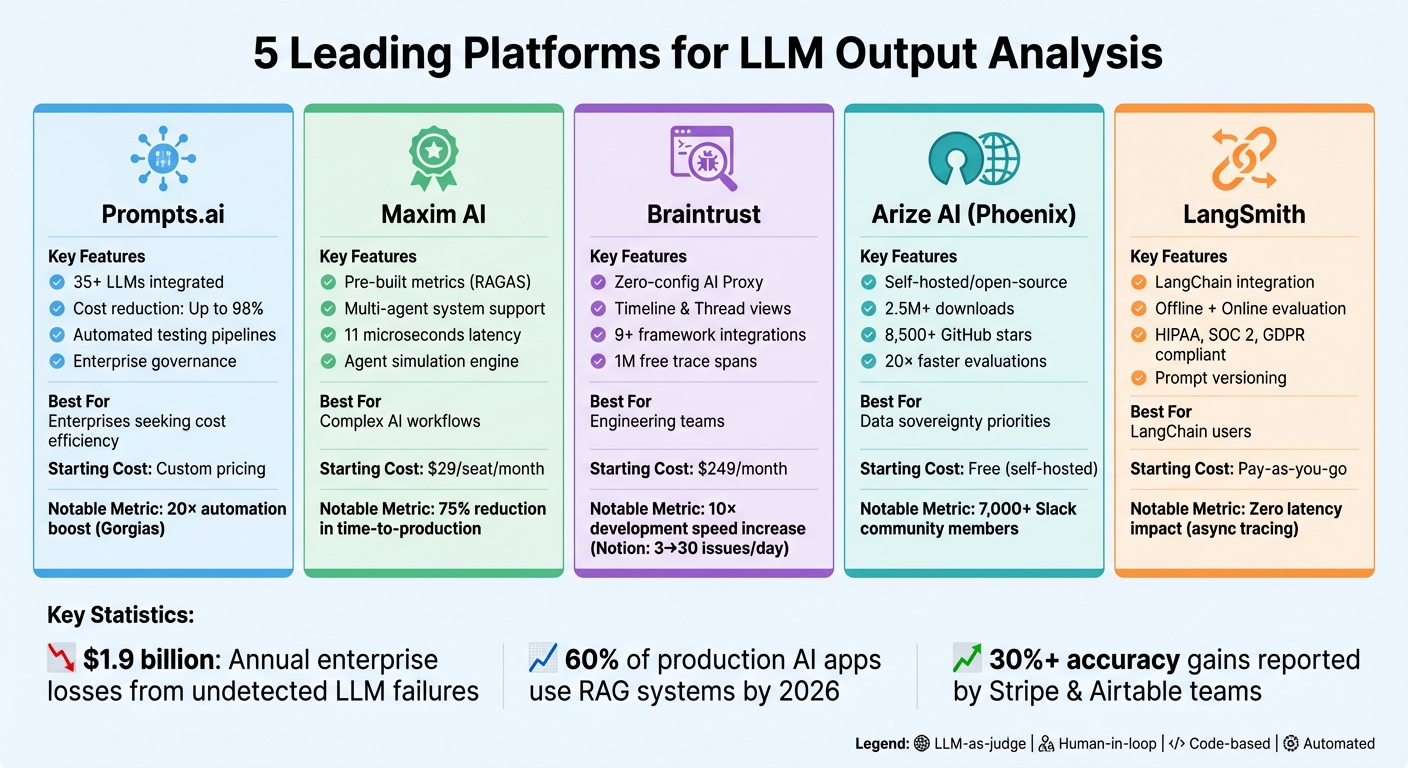

Model Bahasa Besar (LLM) sangat kuat namun tidak dapat diprediksi, sering kali menghasilkan keluaran yang tidak konsisten atau mahal. Untuk mengatasi tantangan ini, organisasi mengandalkan alat khusus untuk evaluasi, pemantauan, dan manajemen biaya. Artikel ini memperkenalkan lima platform yang menyederhanakan analisis keluaran LLM:

Setiap platform menangani aspek unik alur kerja LLM, mulai dari meningkatkan akurasi hingga memangkas biaya dan memastikan kepatuhan.

| Platform | Fitur Utama | Terbaik Untuk | Biaya Awal |

|---|---|---|---|

| Anjuran.ai | Akses LLM terpusat, alat FinOps yang menghemat biaya | Perusahaan yang mencari efisiensi biaya | Harga khusus |

| Maksim AI | Metrik yang dibuat sebelumnya, dukungan sistem multi-agen | Tim yang mengelola alur kerja AI yang kompleks | $29/kursi/bulan |

| Kepercayaan otak | Alat debugging, pengujian percakapan multi-putaran | Tim teknik | $249/bulan |

| Arize AI | Sumber terbuka, penelusuran mendetail, pemeriksaan halusinasi | Organisasi yang memprioritaskan pengendalian data | Gratis (dihosting sendiri) |

| LangSmith | Integrasi LangChain, pembuatan versi cepat | Pengguna LangChain | Bayar sesuai pemakaian |

Platform ini menyederhanakan manajemen LLM, memastikan operasi AI yang terukur, andal, dan hemat biaya.

__XLATE_5__

Prompts.ai brings together 35+ top-tier LLMs - including GPT‑5, Claude, LLaMA, and Gemini - into one unified platform designed for enterprise-level prompt engineering and detailed output analysis. It simplifies evaluation with automated testing pipelines.

Prompts.ai menampilkan saluran evaluasi yang mampu menjalankan lebih dari 20 pengujian pada kumpulan data cepat. Ini termasuk metode seperti pernyataan LLM (menggunakan AI untuk menilai keluaran), pemeriksaan kesamaan semantik melalui kesamaan kosinus, evaluasi pencocokan tepat, dan pencocokan pola berbasis ekspresi reguler. Tim juga dapat menggabungkan evaluasi human-in-the-loop melalui dasbor yang mudah digunakan, sehingga pakar domain dapat menilai keluaran secara manual sebagai bagian dari pembelajaran penguatan dari umpan balik manusia.

For instance, Gorgias, a customer support platform, used Prompts.ai to scale its AI-powered helpdesk to support millions of shoppers. This led to a 20× boost in automation. Their ML engineers and support teams run daily regression tests on backtest datasets to catch potential issues before deployment.

Kemampuan pengujian yang ketat ini memastikan integrasi yang lancar ke dalam alur kerja saat ini.

Prompts.ai’s evaluation pipelines seamlessly integrate with CI/CD workflows and enable backtesting against historical production data. The platform supports connections through external HTTP endpoints, custom Python/JavaScript scripts, and Model Context Protocol (MCP) actions.

Speak, sebuah aplikasi pembelajaran bahasa, memanfaatkan fitur otomatisasi ini untuk menyingkat berbulan-bulan pengembangan kurikulum menjadi hanya satu minggu. Efisiensi ini memungkinkan mereka meluncurkan fitur berbasis AI di 10 pasar baru secara bersamaan.

Prompts.ai juga membantu tim mengoptimalkan biaya dengan menawarkan tampilan perbandingan model secara berdampingan. Perbandingan ini memungkinkan pengguna mempertimbangkan trade-off antara biaya API, latensi, dan skor kualitas. Tim dapat meringkas keluaran atau menggunakan model yang lebih kecil dan lebih cepat untuk tugas-tugas perantara guna mengurangi penggunaan token. NoRedInk, yang melayani 60% distrik sekolah di AS, menggunakan fitur hemat biaya ini untuk memberikan masukan yang dihasilkan AI pada lebih dari 1 juta nilai siswa, sambil mempertahankan kualitas tingkat guru.

Prompts.ai meningkatkan kolaborasi dengan membekali seluruh pemangku kepentingan dengan alat untuk menyempurnakan keluaran LLM. Editor visual tanpa kode memungkinkan pengguna non-teknis mengedit dan menguji perintah tanpa bergantung pada teknisi. Prompt Registry yang terpusat memastikan manajemen versi yang efisien.

ParentLab, misalnya, menghemat lebih dari 400 jam teknis hanya dalam enam bulan dengan memungkinkan pakar domain non-teknis mengelola 700 revisi cepat.

__XLATE_12____XLATE_13__

Platform ini juga mengumpulkan peringkat pengguna dan menerjemahkannya ke dalam skor kinerja, menciptakan umpan balik yang berkelanjutan untuk meningkatkan kualitas keluaran di seluruh model terintegrasi.

Maxim AI menyediakan alat pengujian dan pemantauan mendalam, memadukan evaluasi berbasis mesin dengan umpan balik manusia untuk mendukung tim dalam mengelola alur kerja AI yang rumit. Fitur-fiturnya dirancang untuk memastikan penilaian menyeluruh, yang sangat penting untuk mempertahankan kinerja LLM yang kuat.

Maxim AI menggunakan kerangka evaluasi yang kuat yang mencakup pengujian deterministik, metode statistik, dan alat penilaian otomatis. Itu Toko Penilai menawarkan metrik siap pakai seperti RAGAS, yang disesuaikan untuk sistem generasi yang ditambah pengambilan - komponen utama di sekitar 60% aplikasi AI produksi pada tahun 2026. Selain itu, metrik tingkat node help identify failures in retrieval and generation processes. The platform’s Simulasi Agen mesin memungkinkan pengujian percakapan multi-putaran dan pembuatan persona pengguna untuk penilaian pra-penerapan. Perusahaan seperti Clinc dan Mindtickle telah melaporkan pengurangan waktu produksi sebesar 75% dengan menerapkan standar kualitas ini.

Maxim AI’s evaluation tools integrate effortlessly with today’s development environments. It supports SDKs in Python, TypeScript, Java, and Go, while offering compatibility with platforms like LangChain, LangGraph, Crew AI, OpenAI, Anthropic, Mistral, and AWS Bedrock. The platform also adheres to OpenTelemetri standar untuk penelusuran terdistribusi dan terhubung dengan alat seperti Slack dan PagerDuty untuk peringatan waktu nyata. Pengguna perusahaan mendapatkan manfaat dari opsi penerapan yang mencakup hosting Cloud dan In-VPC, yang semuanya memenuhi persyaratan kepatuhan SOC2, HIPAA, dan GDPR.

Itu Gerbang LLM Bifrost menggunakan cache semantik untuk mengurangi biaya, sekaligus memantau penggunaan token dan biaya API untuk mengidentifikasi dan mengatasi alur kerja yang mahal. Hal ini memastikan operasi yang efisien seiring skala produksi.

Maxim AI’s UI tanpa kode memberdayakan manajer produk dan desainer untuk bereksperimen dengan petunjuk dan melakukan evaluasi secara mandiri. Kellie Maloney, Pimpinan Produk di Rise Science, berbagi:

__XLATE_29__

Platform ini juga mencakup antrean anotasi untuk tinjauan human-in-the-loop, CMS Prompt terpusat dengan kontrol versi, dan RBAC dengan dukungan SAML/SSO. Tim yang memanfaatkan alat kolaborasi ini telah mencapai peningkatan lima kali lipat dalam kecepatan pengiriman, menyederhanakan iterasi, dan mempercepat peluncuran produksi.

Braintrust menggabungkan eksperimen offline dengan penilaian online untuk memberi tim gambaran menyeluruh tentang kinerja LLM mulai dari pengembangan hingga penerapan.

Braintrust menyediakan berbagai cara untuk mengevaluasi kualitas keluaran dalam skala dari 0 hingga 1. Tim dapat menggunakan pencetak skor otomatis untuk tugas-tugas seperti pemeriksaan faktualitas dan kesamaan, mengandalkan evaluasi LLM sebagai juri, atau menerapkan logika kode khusus yang disesuaikan dengan kebutuhan spesifik mereka. Platformnya mencakup Tampilan garis waktu dengan bagan Gantt untuk mengidentifikasi kemacetan, Tampilan utas untuk men-debug percakapan multi-turn, dan visualisasi jejak berbasis bahasa alami yang ditampilkan sebagai komponen React dalam sandbox. Ini juga mendukung menjalankan beberapa uji coba untuk setiap masukan, membantu tim mengukur varians dan menjaga konsistensi.

Braintrust berintegrasi dengan lancar dengan kerangka kerja AI terkemuka, menawarkan dukungan asli untuk 9+ kerangka kerja utama, seperti OpenTelemetry, Vercel AI SDK, OpenAI Agent SDK, Instruktur, LangChain, LangGraph, Google ADK, Mastra, dan Pydantic AI. Ini menggunakan "bungkus" pendekatan integrasi - contohnya meliputi bungkusAISDK untuk Vercel AI SDK (mencakup versi v3 hingga v6 beta) dan bungkus_openai untuk Instruktur. Platform ini mematuhinya Konvensi semantik OpenTelemetry GenAI, secara otomatis memetakan detail seperti penggunaan token dan pengidentifikasi model ke bidang Braintrust. Ia bekerja secara lancar dengan penyedia LLM besar, termasuk OpenAI, Anthropic, dan Google Gemini. Pengembang juga dapat menggunakan Evaluasi() fungsi atau CLI dengan --jam tangan tandai untuk menjalankan kembali evaluasi secara otomatis setiap kali file diperbarui selama pengembangan.

Braintrust lebih dari sekadar evaluasi dengan membina kolaborasi tim dengan alat bawaan. Dia sinkronisasi dua arah memastikan bahwa manajer produk dan teknisi dapat mengerjakan perintah secara bergantian antara kode dan UI. Itu Tempat bermain menawarkan ruang tanpa kode tempat tim dapat menguji perintah, membandingkan model secara berdampingan, dan berbagi konfigurasi untuk iterasi cepat. Alat anotasi khusus memungkinkan tim memberikan umpan balik langsung, menambahkan label atau koreksi langsung ke pelacakan dan memodelkan keluaran. Anotator eksternal dapat diundang untuk menilai kualitas di berbagai versi model, sementara simpanan evaluasi bersama memusatkan kumpulan data dan rubrik penilaian, sehingga menghilangkan kebutuhan akan pelacakan spreadsheet manual.

Phoenix dari Arize AI adalah platform sumber terbuka yang dirancang untuk memberi tim kendali komprehensif dalam mengevaluasi model bahasa besar (LLM). Dibangun dengan OpenTelemetry sebagai intinya, Phoenix telah menarik perhatian dengan lebih dari 2,5 juta unduhan dan 8.500+ bintang GitHub. Ini menawarkan penelusuran terperinci untuk melacak setiap langkah alur kerja LLM, sehingga lebih mudah untuk mengidentifikasi di mana masalah muncul.

Phoenix mempekerjakan LLM-sebagai-hakim pendekatan, menggunakan model dasar dari OpenAI, Anthropic, dan Gemini untuk menilai aplikasi LLM lainnya untuk faktor-faktor seperti relevansi, toksisitas, dan kinerja keseluruhan. Muncul dengan evaluator bawaan untuk tugas-tugas umum seperti Retrieval-Augmented Generation (RAG) dan pemanggilan fungsi. Fitur yang menonjol adalah miliknya kemampuan penjelasan, dimana model evaluasi memberikan alasan yang jelas di balik skornya, membantu pengembang memahami logika di balik setiap penilaian. Alat tambahan mencakup pemeriksaan berbasis kode deterministik, anotasi manusia langsung di dalam antarmuka, dan pengelompokan kumpulan data yang menggunakan penyematan untuk mengelompokkan pertanyaan dan tanggapan yang serupa secara semantik. Pengelompokan ini membantu mengisolasi area di mana model berperforma buruk.

__XLATE_63__

Alat evaluasi ini terintegrasi secara sempurna dengan ekosistem pengembangan platform yang lebih luas.

Phoenix mendukung instrumentasi otomatis untuk kerangka kerja populer seperti LlamaIndex, LangChain, DSPy, Mastra, dan Vercel AI SDK. Ia bekerja dengan Python, TypeScript, dan Java, dan desain asli OpenTelemetry memastikan kompatibilitas dengan alat observasi yang ada tanpa mengunci pengguna ke vendor tertentu. Tim juga dapat menggabungkan evaluasi dari perpustakaan pihak ketiga seperti Ragas, Deepeval, atau Cleanlab, sehingga menawarkan fleksibilitas di seluruh alur kerja mereka.

Phoenix dibuat untuk efisiensi dan penyampaian evaluasi berjalan hingga 20x lebih cepat melalui konkurensi dan batching. Prompt Playground-nya menyediakan lingkungan pengujian di mana tim dapat menyempurnakan perintah dan membandingkan varian model secara berdampingan sebelum penerapan, sehingga mengurangi risiko kesalahan produksi yang mahal.

Sebagai platform yang sepenuhnya bersumber terbuka dan dapat dihosting sendiri, Phoenix memastikan tim mempertahankan kendali penuh atas data mereka. Fitur seperti antrian anotasi manusia memungkinkan label kebenaran dasar ditambahkan langsung ke jejak, sehingga mendorong kolaborasi yang lebih baik. Itu Pusat Cepat mengelola pembuatan versi cepat, penyimpanan, dan penerapan di seluruh lingkungan, sementara Rentang Obrolan alat ini memungkinkan tim mengevaluasi dan mendiskusikan segmen alur kerja tertentu untuk mengungkap masalah kinerja. Dengan komunitas Slack yang beranggotakan lebih dari 7.000 orang, pengguna memiliki akses ke jaringan untuk memecahkan masalah dan berbagi wawasan.

__XLATE_76__

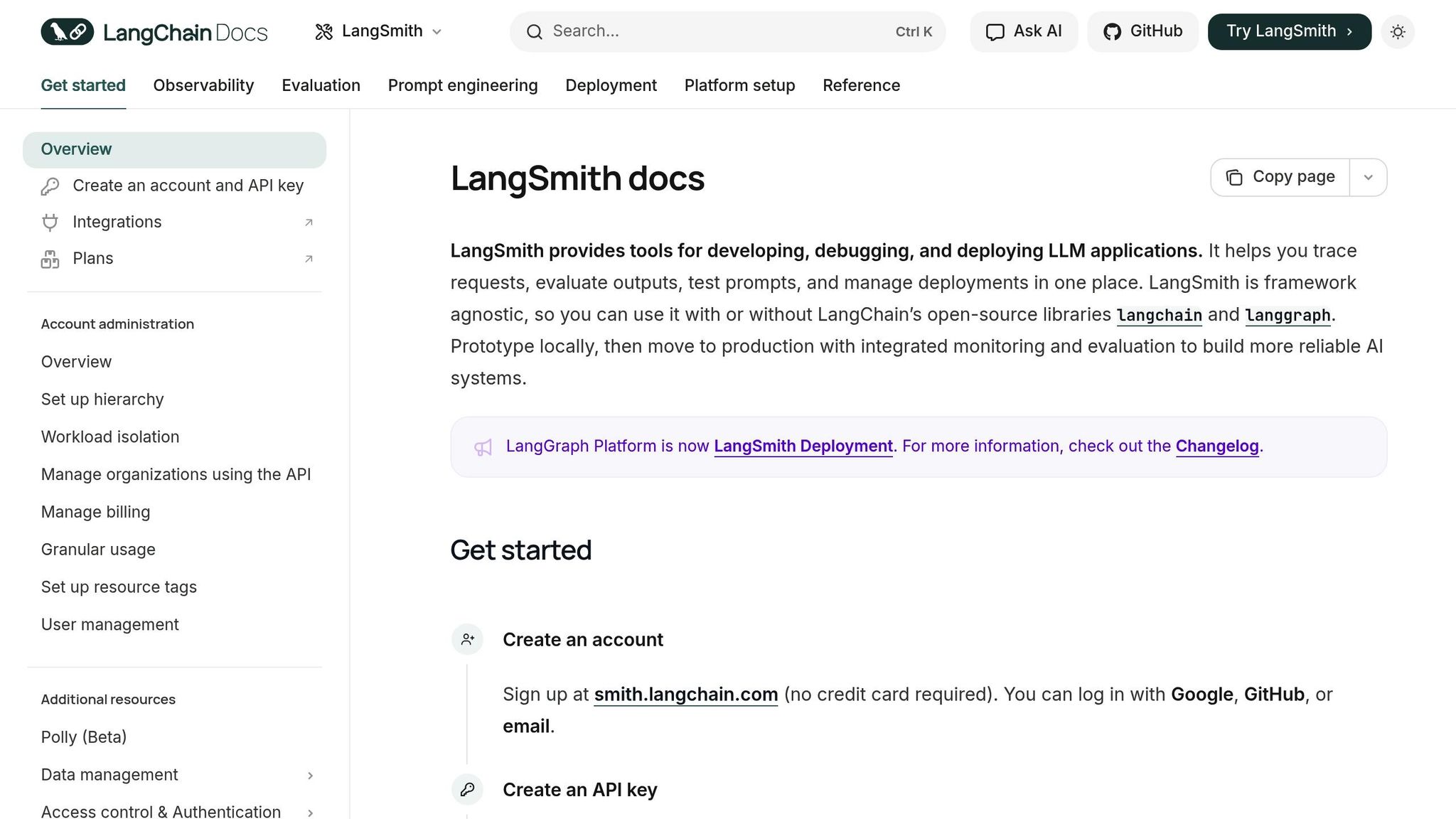

LangSmith adalah platform serbaguna yang dirancang untuk bekerja secara lancar dengan atau tanpa LangChain, sehingga dapat beradaptasi dengan tumpukan LLM apa pun. Ini terhubung dengan mudah dengan alat seperti OpenAI, Anthropic, CrewAI, Vercel AI SDK, dan Pydantic AI, memberikan fleksibilitas bagi tim yang sudah menggunakan kerangka kerja tertentu. Platform ini memenuhi standar kepatuhan seperti HIPAA, SOC 2 Tipe 2, dan GDPR, serta menggunakan proses asinkron untuk mengirim jejak, sehingga memastikan tidak ada latensi tambahan bagi pengguna akhir.

LangSmith menawarkan dua mode evaluasi untuk memenuhi kebutuhan yang berbeda: Evaluasi Offline untuk menguji kumpulan data yang dikurasi selama pengembangan dan Evaluasi Online untuk memantau lalu lintas produksi langsung. Ini mendukung empat jenis evaluator:

Platform ini mencakup alat analisis canggih seperti Tampilan Berbeda, yang menyoroti perbedaan antara keluaran model dan teks referensi, dan perbandingan berdampingan untuk tolok ukur kinerja. Ini juga menyediakan pengelompokan metadata, memungkinkan analisis metrik seperti akurasi atau biaya berdasarkan kategori seperti bidang subjek atau jenis pengguna. LangSmith terintegrasi dengan sumber terbuka pembukaan paket, menawarkan evaluator yang telah dibuat sebelumnya untuk menilai kebenaran dan singkatnya.

Fitur-fitur ini memudahkan integrasi LangSmith ke dalam alur kerja dan alat pengembangan yang ada.

LangSmith menyederhanakan penelusuran dengan @dapat dilacak dekorator atau pembungkus klien yang secara otomatis menangkap input dan output. Ini mendukung integrasi dengan Python dan TypeScript/JavaScript SDK, REST API, dan kerangka pengujian seperti pytest, Vitest, dan Jest, sehingga memudahkan untuk menyematkan evaluasi ke dalam pipeline CI/CD. Selain itu, integrasi OpenTelemetry memungkinkan tim mengirim jejak dari alur observasi yang ada langsung ke LangSmith.

LangSmith meningkatkan kolaborasi tim dengan umpan balik intuitif dan alat anotasi. Antrean Anotasi aktifkan perutean otomatis proses tertentu ke pakar materi pelajaran untuk peninjauan manual dan penilaian berdasarkan kriteria khusus. Itu Pusat Cepat berfungsi sebagai ruang terpusat bagi tim untuk mengulangi, membuat versi, dan berbagi perintah, lengkap dengan fitur pelacakan perubahan dan rollback untuk menjaga konsistensi selama pengembangan. Kemampuan anotasi inline memungkinkan anggota tim menandai masalah atau memberikan umpan balik yang ditargetkan mengenai kualitas respons, sehingga meningkatkan akurasi evaluasi dan efisiensi alur kerja.

Platform ini juga menawarkan manajemen pengguna terperinci dan isolasi beban kerja, memastikan kelancaran kolaborasi antar tim. Pengguna dapat mendaftar secara gratis di smith.langchain.com - tidak memerlukan kartu kredit. Untuk penggunaan produksi, LangSmith beroperasi dengan sistem bayar sesuai pemakaian, dengan paket perusahaan tersedia untuk hosting mandiri di kluster Kubernetes di AWS, GCP, atau Azure.

Saat mengevaluasi platform untuk penilaian LLM, penting untuk mempertimbangkan kompatibilitas teknis, biaya, dan metode evaluasi. Berikut ini adalah pilihan yang lebih dekat:

Anjuran.ai menyatukan 35+ model terkemuka dalam satu antarmuka yang aman, menawarkan kontrol FinOps yang dapat mengurangi biaya perangkat lunak AI hingga 98%. Kepercayaan otak menyederhanakan penyiapan dengan Proxy AI tanpa konfigurasi, menangkap log melalui satu URL dasar. Ini mencakup 1 juta rentang penelusuran gratis, dengan paket berbayar mulai dari $249/bulan. Maksim AI terintegrasi secara mulus dengan tumpukan observabilitas yang ada, dengan fokus pada penilaian kualitas dibandingkan penelusuran penuh. Ini menawarkan paket gratis hingga 10.000 log per bulan dan paket berbayar mulai dari $29 per kursi/bulan. Arize Phoenix mendukung hosting mandiri untuk privasi data, berintegrasi dengan alat seperti RAGAS dan Giskard untuk analisis metrik yang lebih mendalam. LangSmith dirancang untuk pengguna LangChain, memberikan kemampuan observasi tingkat lanjut, meskipun harga dukungan perusahaan bervariasi. Khususnya, Notion meningkatkan kecepatan pengembangannya sepuluh kali lipat dengan Braintrust, meningkat dari menyelesaikan 3 masalah setiap hari menjadi 30.

Pendekatan unik setiap platform menyederhanakan pengambilan keputusan berdasarkan kebutuhan evaluasi spesifik Anda. Berikut perbandingan keduanya dalam hal metode evaluasi, integrasi, dan penerapan:

Kompleksitas integrasi juga memainkan peran penting. Penyiapan berbasis proxy Braintrust sangatlah mudah - cukup perbarui URL dasar API Anda. Maxim AI berintegrasi dengan alat observasi yang ada, sementara integrasi LangChain yang ketat dari LangSmith melayani kebutuhan observasi khusus. Arize Phoenix menonjol bagi organisasi yang memprioritaskan kedaulatan data, menawarkan solusi sumber terbuka yang dihosting sendiri. Sementara itu, Prompts.ai menyediakan kontrol tata kelola tingkat perusahaan dan jalur audit lengkap untuk pengoperasian yang aman.

__XLATE_111__

Untuk mendapatkan wawasan yang cepat, penerapan berbasis proxy dan integrasi mendalam menyederhanakan prosesnya. Pengguna LangChain akan menganggap LangSmith cocok, sementara organisasi yang mengelola data sensitif mungkin akan memilih solusi sumber terbuka seperti Arize Phoenix atau Prompts.ai untuk kemampuan tata kelola dan audit yang kuat.

Berdasarkan evaluasi yang diberikan, setiap platform memberikan keuntungan berbeda untuk menyempurnakan analisis keluaran LLM. Anjuran.ai menawarkan akses terpusat kepada perusahaan-perusahaan terhadap model-model terkemuka, dipadukan dengan kontrol FinOps yang dapat mengurangi biaya AI sebanyak 98%, sekaligus memastikan tata kelola dan kemampuan audit yang kuat. Kepercayaan otak dirancang untuk tim teknik yang bergerak cepat, dengan perusahaan seperti Notion melaporkan peningkatan kecepatan pengembangan sebesar 10x - meningkatkan penyelesaian masalah dari 3 menjadi 30 per hari. Demikian pula, tim di Stripe dan Airtable mengamati lebih dari 30% peningkatan akurasi dalam beberapa minggu setelah mengadopsi platform ini.

Bagi mereka yang terintegrasi secara mendalam ke dalam ekosistem LangChain, LangSmith memberikan integrasi yang mudah dan opsi pembuatan prototipe yang cepat. Maksim AI melayani tim yang berfokus pada pengelolaan sistem multi-agen yang rumit, menawarkan alat penilaian presisi dan gateway latensi rendah yang hanya menghasilkan overhead 11 mikrodetik pada volume 5.000 permintaan per detik. Sementara itu, Arize Phoenix sangat ideal untuk organisasi yang memprioritaskan kedaulatan data, memberikan solusi sumber terbuka yang dihosting sendiri dan cocok dengan sistem observasi yang ada.

Setiap platform mengatasi tantangan penting dalam kinerja LLM dan manajemen biaya. Dengan perusahaan menghadapi potensi kerugian sebesar $1,9 miliar per tahun karena kegagalan produksi LLM yang tidak terdeteksi, kebutuhan untuk beralih dari evaluasi subjektif ke metrik terukur dan berbasis data menjadi penting untuk memastikan keandalan dan efisiensi.

Alat-alat ini meningkatkan pengembangan LLM menjadi disiplin teknik terstruktur. Baik fokus Anda menangani triliunan acara setiap bulan, menyederhanakan kolaborasi antar tim, atau mempertahankan kendali atas infrastruktur yang dihosting sendiri, memilih platform yang tepat akan memastikan alur kerja LLM Anda mencapai keandalan, kualitas, dan efektivitas biaya yang diperlukan untuk memenuhi tujuan Anda.

Platform ini dirancang untuk membantu organisasi mengurangi pengeluaran AI dengan menawarkan alat untuk memantau dan menyempurnakan penggunaan model bahasa besar (LLM). Misalnya, solusi seperti Prompts.ai memungkinkan pengguna melacak penggunaan token secara real time, sehingga lebih mudah mengenali dan mengurangi konsumsi token yang tidak diperlukan. Hal ini membantu menghindari pengeluaran berlebihan pada panggilan API yang berlebihan, sehingga menghasilkan manajemen biaya yang lebih baik.

Selain pengendalian biaya, platform ini juga memberikan wawasan berharga mengenai kinerja dan kualitas keluaran. Mereka dapat membantu mendeteksi dan mencegah masalah seperti halusinasi atau kesalahan, yang dapat mengakibatkan pengerjaan ulang yang mahal. Dengan menganalisis tren penggunaan dan mengidentifikasi inefisiensi, organisasi dapat menyederhanakan alur kerja, menurunkan biaya operasional, dan memastikan hasil yang konsisten dan berkualitas tinggi. Semua ini mendukung keputusan yang lebih cerdas dan berbasis data untuk mengelola anggaran AI secara efektif.

Platform LLM menyediakan berbagai cara untuk terhubung secara lancar dengan alat dan alur kerja, untuk memenuhi berbagai kebutuhan. Banyak platform mendukung integrasi asli melalui SDK seperti Python dan JavaScript, serta kerangka kerja seperti LangChain dan LangServe. Hal ini membuat penyematan LLM ke dalam aplikasi khusus menjadi mudah dan efisien. Untuk pemantauan, platform sering kali mendukung standar terbuka seperti OpenTelemetry, sehingga memastikan kompatibilitas dengan infrastruktur yang ada.

Beberapa platform juga berintegrasi dengan alat CI/CD seperti GitHub Actions dan Jenkins, sehingga menyederhanakan proses pengujian dan penerapan. Untuk organisasi yang memprioritaskan kontrol terhadap lingkungannya, tersedia opsi hosting mandiri, yang memungkinkan penyesuaian dengan tetap menjaga keamanan data. Fitur integrasi ini memungkinkan pengguna untuk meningkatkan efisiensi, memantau kinerja secara efektif, dan menerapkan LLM dengan aman dalam operasi mereka.

Bagi mereka yang menempatkan premi pada privasi dan kontrol data, DiPrem.LLM memberikan solusi yang sangat baik. Dirancang khusus untuk tugas-tugas sensitif privasi, platform ini memungkinkan model bahasa besar (LLM) untuk menangani data rahasia atau terbatas dengan aman dalam pengaturan offline. Dengan mengaktifkan eksekusi lokal sepenuhnya, hal ini secara signifikan mengurangi kemungkinan paparan data, sekaligus menawarkan integrasi cloud opsional untuk pengaturan hibrid bila diperlukan.

Dengan antarmuka intuitif dan tanpa kode, OnPrem.LLM memastikan aksesibilitas bagi pengguna tanpa keahlian teknis, sambil tetap menjaga pengawasan menyeluruh terhadap manajemen data. Hal ini menjadikannya pilihan ideal bagi organisasi dalam industri yang teregulasi atau sensitif dimana menjaga informasi adalah prioritas utama.