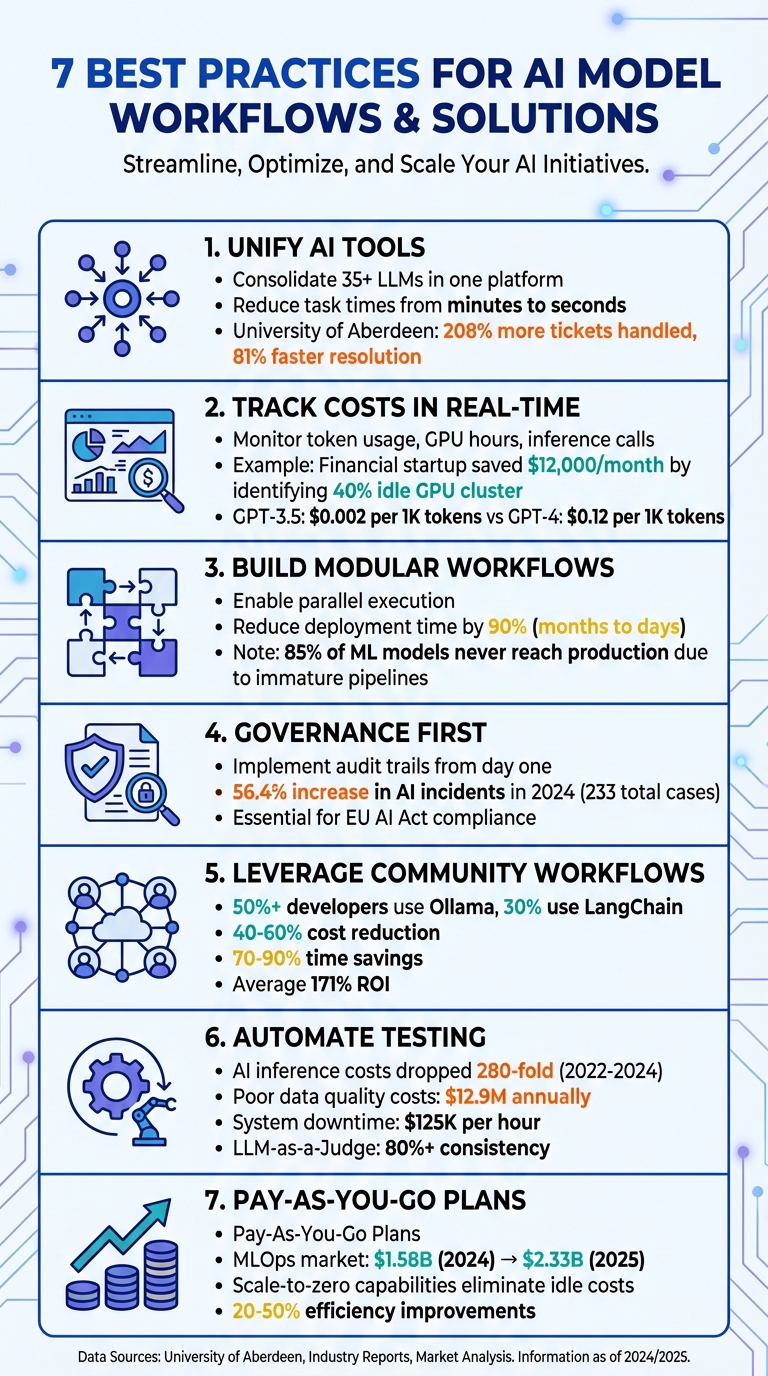

AI workflows in 2026 face challenges like fragmented tools, unchecked model drift, and escalating costs. To overcome these, organizations are adopting smarter, automated workflows that unify tools, improve governance, and optimize spending. Here’s how you can transform your AI operations:

Praktik-praktik ini menyederhanakan alur kerja, meningkatkan pengawasan, dan mengurangi biaya, sehingga memungkinkan organisasi untuk menskalakan AI secara bertanggung jawab dan efisien.

__XLATE_1__

Mengelola platform terpisah untuk model seperti GPT-5, Claude, LLaMA, dan Gemini dapat memperlambat operasi dan menciptakan rintangan yang tidak perlu. Dengan menggabungkan lebih dari 35 LLM ke dalam satu antarmuka, Prompts.ai menghilangkan kerumitan dalam mengatur banyak login dan kredensial, mengurangi waktu tugas dari menit menjadi hanya beberapa detik.

Integrasi semacam ini mendorong peningkatan produktivitas yang terukur. Misalnya, ketika Universitas Aberdeen mengadopsi sistem yang didukung AI pada bulan September 2025, tim TI mereka berhasil menangani 208% lebih banyak tiket sekaligus memangkas waktu penyelesaian sebesar 81% [1]. Hasil tersebut menyoroti bagaimana sistem yang disederhanakan memungkinkan tim untuk fokus pada hasil daripada membuang waktu mengelola alat yang terfragmentasi. Pendekatan ini membuka jalan bagi alur kerja AI yang lebih efisien, andal, dan hemat biaya.

Antarmuka terpadu tidak hanya menghemat waktu - tetapi juga menjamin keandalan dan fleksibilitas yang lebih baik. Dengan semua model yang dapat diakses dari satu platform, tim dapat beralih antar mesin dengan lancar, menjaga kesinambungan meskipun satu model gagal atau memberikan hasil yang tidak akurat. Penyiapan proaktif ini mencegah proses yang tidak terkendali, yang dapat menyebabkan melonjaknya biaya cloud ketika agen otomatis melakukan loop tanpa kontrol yang tepat.

Platform ini juga memungkinkan pengujian kinerja berdampingan, sehingga Anda dapat mengevaluasi model mana yang paling sesuai dengan tugas tertentu. Misalnya, pertanyaan dukungan pelanggan mungkin dialihkan ke satu LLM, proyek kreatif ke LLM lain, dan pemrosesan data ke LLM ketiga - semuanya dikelola dari dasbor yang sama. Desain model-agnostik ini memastikan Anda tidak terikat pada batasan atau harga satu vendor, sehingga memberi Anda kebebasan untuk mengoptimalkan kinerja dan biaya.

Prompts.ai membawa manajemen biaya ke tingkat berikutnya dengan menawarkan wawasan real-time mengenai penggunaan token di semua model. Transparansi ini membantu mencegah pembengkakan anggaran sebelum terjadi. Lapisan FinOps bawaan melacak pengeluaran pada tingkat yang cepat, sehingga memudahkan untuk mengidentifikasi alur kerja mana yang memberikan nilai dan mana yang menghabiskan sumber daya. Organisasi yang menggunakan otomatisasi alur kerja AI telah melaporkan ROI sebesar 84% ketika mereka dapat menghubungkan pengeluaran dengan hasil bisnis. Databricks, misalnya, mengurangi tiket dukungan sebesar 23% melalui triase cerdas yang didukung oleh model data yang bersih dan pelacakan biaya yang transparan [1].

Kredit TOKN bayar sesuai penggunaan platform ini menyelaraskan pengeluaran dengan penggunaan sebenarnya, sehingga menghilangkan kebutuhan untuk membayar kapasitas yang tidak terpakai. Dengan menggabungkan biaya di beberapa model, tim dapat menghemat hingga 98% dibandingkan dengan mempertahankan langganan terpisah untuk setiap alat, sehingga menghasilkan penghematan yang signifikan di seluruh proyek dan departemen.

Prompts.ai juga memperkuat tata kelola dan kepatuhan, menawarkan jalur audit terpadu yang mendukung persyaratan peraturan dan peningkatan alur kerja. Platform ini mengkategorikan tugas ke dalam tingkatan risiko, memastikan bahwa operasi berisiko tinggi (seperti tugas Level 4 dengan potensi bencana) tetap berada di bawah pengawasan manusia hingga sistem AI benar-benar dapat diandalkan.

Dengan enkripsi ujung ke ujung dan kontrol akses yang ketat, data sensitif tetap terlindungi dari kesalahan konfigurasi atau pelanggaran. Karena 78% organisasi kini menggunakan AI setidaknya di satu area bisnis mereka [2], Prompts.ai memberikan keamanan tingkat perusahaan sambil menjaga kecepatan dan ketangkasan yang dibutuhkan tim untuk berinovasi. Setiap interaksi aman, dapat dilacak, dan dapat diaudit, sehingga memberikan kepercayaan diri bagi organisasi untuk menskalakan AI secara bertanggung jawab.

Beban kerja AI sering kali menimbulkan pengeluaran tak terduga yang tidak dapat sepenuhnya dipahami melalui faktur bulanan. FinOps real-time mengubah hal ini dengan menawarkan wawasan langsung mengenai biaya yang terjadi. Dengan melacak penggunaan token, jam kerja GPU, dan panggilan inferensi hampir secara real-time, tim dapat mengidentifikasi dan mengatasi kelebihan anggaran sebelum menjadi tidak terkendali.

Misalnya, sebuah startup analisis keuangan menemukan bahwa 40% dari cluster 8-GPU-nya tidak digunakan, menghabiskan hampir $12.000 setiap bulan. Melalui pemantauan real-time, tim mengidentifikasi inefisiensi ini di tengah-tengah sprint dan segera melakukan penyesuaian untuk mengoptimalkan kapasitas.

Pelacakan terperinci berdasarkan tim, proyek, atau pelanggan semakin menyempurnakan model tagihan balik. Dengan melampirkan metadata seperti ID pelanggan ke permintaan API, pengeluaran menjadi lebih transparan. Hal ini memungkinkan departemen hanya membayar sesuai penggunaan mereka, sehingga membuka jalan bagi operasi yang skalabel dan hemat biaya.

Real-time tracking doesn’t just monitor costs - it actively supports smarter scaling decisions. Autoscaling can now factor in both performance metrics (like latency) and financial data (such as cost per prediction). For example, during traffic spikes, systems can throttle or reroute requests based on cost signals, ensuring resources are used efficiently.

__XLATE_13__

StreamForge AI mengadopsi strategi ini pada bulan September 2025 dengan mengintegrasikan Kubecost dengan Prometheus dan menampilkan data pemanfaatan di dasbor Grafana yang diperbarui setiap lima menit. Dengan menggunakan pendekatan penskalaan otomatis pensinyalan ganda - menyeimbangkan latensi p95 dan metrik biaya per permintaan - keduanya secara signifikan meningkatkan pemanfaatan GPU dan meningkatkan efektivitas biaya di lebih dari 300 tugas pelatihan harian. Pendekatan real-time ini membantu menghindari kesalahan konfigurasi yang merugikan dan dapat menguras anggaran bulanan.

Centralizing cost tracking across multiple AI providers is essential when managing diverse models. A unified AI gateway simplifies this process by consolidating token usage, latency, and cost data into a single, reliable source. Whether you’re using OpenAI, Anthropic, or self-hosted models, this centralized system eliminates the need to piece together fragmented billing data.

Tingkat integrasi ini sangat penting karena model yang berbeda memiliki titik harga yang sangat berbeda. Misalnya, GPT-3.5-Turbo berharga sekitar $0,002 per 1.000 token, sedangkan GPT-4 bisa mencapai $0,12 per 1.000 token bergantung pada jendela konteks. Pelacakan real-time memungkinkan tim membandingkan biaya-biaya ini dan mengarahkan tugas ke model yang paling ekonomis. Baik menangani pertanyaan pelanggan sederhana atau analisis kompleks, tugas ditetapkan ke model yang tepat berdasarkan data biaya langsung, memastikan alur kerja tetap efisien dan ramah anggaran.

Memecah alur kerja AI menjadi komponen modular merevolusi cara penerapan dan penskalaannya. Daripada mengandalkan satu jalur pipa yang kaku untuk menangani setiap tahapan, pendekatan modular memungkinkan setiap bagian diperbarui atau diganti tanpa mengganggu keseluruhan sistem.

Desain ini juga memungkinkan eksekusi paralel, di mana banyak tugas dapat dijalankan secara bersamaan. Misalnya, layanan terjemahan multibahasa dapat memproses berbagai versi bahasa secara bersamaan, bukan satu demi satu, sehingga mengurangi waktu pemrosesan secara signifikan. Mengadopsi praktik MLOps semakin mempercepat penerapan, mengurangi waktu untuk memindahkan model ke produksi hingga 90%. Jalur pipa otomatis dapat mempersingkat jadwal penerapan dari beberapa bulan menjadi hanya beberapa hari.

Keuntungan lainnya adalah replayability. Jika langkah tertentu, seperti pasca-pemrosesan, mengalami masalah, Anda dapat menjalankan kembali modul tersebut menggunakan artefak yang disimpan alih-alih mengulangi seluruh alur kerja. Pendekatan pemutaran ulang yang ditargetkan ini menghemat waktu dan sumber daya, terutama untuk tugas-tugas yang memerlukan daya komputasi yang signifikan. Alur kerja modular juga mempermudah standarisasi dan mengintegrasikan komponen di seluruh sistem dengan aman.

Setelah fondasi modular diterapkan, memastikan kelancaran komunikasi antar komponen menjadi hal yang penting. Standarisasi format input dan output membantu menghindari kesalahan berjenjang. Misalnya, jika modul penyerapan data mengeluarkan file JSON yang didefinisikan dengan jelas dan selaras sempurna dengan masukan yang diharapkan dari modul inferensi, potensi miskomunikasi akan dihilangkan.

Memisahkan logika AI dari logika kebijakan semakin meningkatkan kemampuan pemeliharaan. Hal ini memungkinkan Anda untuk mengelola perilaku model dinamis secara independen dari aturan bisnis tetap, seperti yang disorot dalam Panduan Preskriptif AWS. Alat seperti Docker atau Kubernetes dapat memasukkan modul ke dalam container, memastikan modul tersebut tetap portabel di lingkungan yang berbeda. Modul dalam container dapat beroperasi secara konsisten dalam pengembangan, staging, dan produksi, dan bahkan dapat melakukan transisi antar penyedia cloud tanpa memerlukan perubahan. Untuk orkestrasi, AWS Step Functions menyediakan koordinasi tanpa server dengan percobaan ulang bawaan, sementara Apache Airflow menawarkan fleksibilitas berbasis Python untuk mengelola alur kerja yang lebih rumit.

Desain modular juga memberikan keuntungan finansial dengan memungkinkan Anda mengalokasikan sumber daya yang tepat untuk setiap tugas. Model penalaran yang kompleks, yang membutuhkan banyak sumber daya, dapat digunakan untuk analisis yang menuntut, sementara tugas yang lebih sederhana dapat ditangani oleh model yang lebih murah. Hal ini memastikan sumber daya komputasi digunakan secara bijaksana.

Melacak metadata di tingkat modul meningkatkan transparansi. Dengan melampirkan detail seperti stempel waktu, versi model, dan data biaya ke setiap artefak saat bergerak melalui jalur pipa, tim mendapatkan jejak audit yang jelas. Ini tidak hanya membantu dalam debugging tetapi juga dalam pelacakan keuangan. Menyelaraskan biaya dengan metrik khusus modul memungkinkan penganggaran yang tepat sekaligus menjaga fleksibilitas. Selain itu, menetapkan batas ukuran batch dan konkurensi dapat membantu mencegah pengeluaran tak terduga selama periode permintaan tinggi.

It’s worth noting that about 85% of machine-learning models never make it to production, often due to immature pipeline structures. Modular, iterative workflows offer a way to overcome this challenge. Teams can start small, validate one module at a time, and gradually scale up, reducing risks and ensuring systems are ready for production.

Memasukkan tata kelola ke dalam alur kerja AI Anda sejak awal akan menyelamatkan Anda dari penyesuaian yang mahal. Dengan memanfaatkan evaluasi otomatis dan transparansi yang telah dibahas sebelumnya, Anda dapat memastikan kepatuhan dimasukkan ke dalam proses Anda sejak awal. Segera setelah model atau use case dibuat, buat tiket pelacakan di alat alur kerja Anda dan menetapkan tingkat risiko awal. Penerapan yang berisiko tinggi, seperti sistem penilaian kredit atau perekrutan, memerlukan proses persetujuan yang lebih ketat dan pemantauan yang lebih ketat dibandingkan dengan alat yang berisiko rendah yang digunakan secara internal. Gerakan "bergeser ke kiri" yang proaktif ini Pendekatan ini membuat Anda tetap siap menghadapi persyaratan peraturan, terutama dengan kerangka kerja seperti EU AI Act yang mewajibkan dokumentasi rinci tentang proses pelatihan dan evaluasi.

Landasan kepatuhan adalah pelacakan garis keturunan, yang menyediakan jalur yang jelas dan dapat direproduksi dari data mentah hingga keluaran model akhir. Gabungkan pelacakan garis keturunan dengan ketertelusuran snapshot, memastikan bahwa status kode, data, dan konfigurasi Anda dipertahankan sebelum penerapan. Ini memungkinkan Anda mereproduksi versi model apa pun sesuai kebutuhan. Riset industri menyoroti pentingnya langkah-langkah ini, dengan mencatat peningkatan sebesar 56,4% dalam insiden terkait AI pada tahun 2024, dengan total 233 kasus – yang menekankan perlunya jalur audit yang kuat.

Jalur audit menyederhanakan pemecahan masalah dengan menghubungkan kesalahan secara langsung ke sumbernya. Daripada memilah-milah log secara manual, para insinyur dapat menggunakan pelacakan garis keturunan untuk dengan cepat mengidentifikasi di mana saluran pipa rusak atau kualitas data menurun. Mengotomatiskan tugas tata kelola - seperti pemeriksaan aset dan evaluasi risiko - tidak hanya memastikan kepatuhan tetapi juga menjaga inisiatif AI Anda tetap berjalan efisien seiring pertumbuhannya. Dengan mengotomatiskan langkah-langkah ini, Anda dapat mengurangi waktu persetujuan dan menjaga konsistensi di seluruh operasi.

Tata kelola data yang kuat sangat penting untuk menjaga data berkualitas tinggi. Manajemen metadata terpusat menggabungkan informasi tentang semua aset AI di satu tempat, menghilangkan redundansi dan memastikan kelancaran operasional. Ketika setiap komponen, mulai dari perintah hingga versi model, dilacak dengan stempel waktu dan rincian biaya, tim memperoleh keuntungan sejarah eksekusi yang komprehensif. Hal ini membuat saluran pipa lebih mudah untuk direproduksi dan disempurnakan. Log audit otomatis semakin mengurangi kesalahan manusia, sehingga menciptakan alur kerja yang andal dan dapat diulang.

Strategi tata kelola ini terintegrasi secara sempurna dengan alur kerja modular, memastikan kepatuhan tetap menjadi bagian inti sistem Anda seiring dengan skalanya.

Lapisan tata kelola yang terpadu menyatukan alur kerja yang efisien dan transparansi biaya, sehingga memastikan kepatuhan di seluruh aspek. Banyak sistem – seperti Snowflake, Databricks, platform cloud, dan lingkungan edge – beroperasi di berbagai platform. Tanpa pendekatan tata kelola terpadu, Anda berisiko “membayangi AI”, di mana model diterapkan tanpa pengawasan, sehingga verifikasi kepatuhan menjadi tidak mungkin dilakukan. Ketertelusuran lintas sistem memastikan bahwa silsilah data waktu proses ditangkap di seluruh kueri, buku catatan, pekerjaan, dan dasbor, menjaga kepatuhan saat data berpindah antar platform. Antarmuka terstandarisasi, seperti Model Context Protocol (MCP) dengan gateway terpusat, memungkinkan pencatatan log yang konsisten dan pelacakan permintaan di seluruh server dan penyewa. Ini memberi Anda jejak audit yang lengkap, di mana pun pekerjaan dilakukan.

Membuat alur kerja dari awal dapat memakan waktu dan tidak efisien. Kerangka kerja berbasis komunitas seperti LangChain Dan Ollama telah menjadi solusi tepat, menawarkan templat siap pakai untuk merangkai perintah dan mengintegrasikan alat. Kerangka kerja ini diadopsi secara luas, dengan lebih dari 50% pengembang menggunakan Ollama dan hampir sepertiganya mengandalkan LangChain untuk mengelola agen AI. Mereka menggantikan kode kustom yang rapuh dengan fungsi fleksibel tanpa server yang beroperasi secara independen, sehingga lebih mudah dikelola dan diskalakan.

Manfaat utamanya adalah skalabilitas tanpa kompleksitas. Dengan mengandalkan pola yang telah teruji oleh komunitas, Anda dapat beralih model - seperti berpindah dari GPT ke Amazon Bedrock - tanpa merombak logika orkestrasi Anda. Fleksibilitas ini mempercepat penerapan sekaligus menjaga konsistensi. Penelitian menunjukkan bahwa meskipun orkestrasi merupakan prioritas bagi banyak organisasi, hanya sedikit yang telah menerapkannya sepenuhnya. Alur kerja komunitas menawarkan solusi praktis, memungkinkan integrasi tanpa hambatan di berbagai platform AI.

Alur kerja komunitas juga mengatasi tantangan dalam mengintegrasikan alat AI di seluruh platform. Standar seperti Protokol Konteks Model (MCP) mengatasi masalah perluasan platform, yang menjadi perhatian 63% eksekutif. Protokol ini memungkinkan agen dan alat AI untuk bekerja sama di seluruh platform seperti Gmail, Slack, dan CRM tanpa memerlukan entri data manual. Misalnya, permintaan bahasa alami yang sederhana - seperti "ringkas 10 email terakhir dari Gmail" - dapat memicu tugas terstruktur dengan koneksi API yang telah dikonfigurasi sebelumnya.

__XLATE_52__

Interoperabilitas sangat penting, dengan 87% pemimpin TI mengidentifikasinya sebagai hal yang penting untuk mengadopsi sistem berbasis AI. Alur kerja komunitas dirancang dengan mempertimbangkan ketahanan, menawarkan fitur seperti percobaan ulang otomatis, waktu tunggu, dan eksekusi paralel untuk menangani potensi kegagalan model. Perlindungan ini sangat penting, terutama sejak saat itu 87% pengembang mengkhawatirkan keakuratan AI, Dan 81% mengkhawatirkan keamanan dan privasi. Selain meningkatkan integrasi, alur kerja ini juga membantu mengurangi biaya secara signifikan.

Menggunakan templat komunitas untuk mengubah perintah bahasa alami menjadi alur kerja otomatis dapat memangkas biaya dan menghemat waktu secara drastis. Laporan organisasi Pengurangan biaya 40-60%. Dan Penghematan waktu 70-90%. ketika mereka mengadopsi otomatisasi AI melalui alur kerja ini. Memulai dengan solusi yang telah teruji menghilangkan kebutuhan akan proses coba-coba yang mahal.

Alur kerja ini juga meningkatkan transparansi dengan menggabungkan jalur audit standar dan pelacakan metadata. Mereka secara otomatis mencatat detail seperti sumber data, izin, dan riwayat keputusan agen. Banyak yang menyertakan manusia dalam lingkaran pos pemeriksaan untuk peninjauan manual terhadap tugas-tugas sensitif atau berbiaya tinggi, memastikan pengawasan di tempat yang paling penting. Dengan mengelola biaya inferensi selama penskalaan, perusahaan telah melihat rata-ratanya ROI 171%. ketika memanfaatkan alur kerja yang dibangun komunitas.

Mengotomatiskan pengujian dan evaluasi adalah bagian terakhir dalam menciptakan siklus hidup AI yang mulus. Hal ini menghilangkan penundaan yang disebabkan oleh pengujian manual, yang sering kali menghalangi model mencapai produksi - 85% model gagal diterapkan karena inefisiensi proses. Dengan memanfaatkan pipeline CI/CD/CT (Pelatihan Berkelanjutan) otomatis, waktu penerapan menyusut dari beberapa bulan menjadi hanya beberapa hari. Pipeline ini dapat secara otomatis melatih ulang model ketika metrik kinerja turun di bawah ambang batas yang ditetapkan atau ketika data baru tersedia, sehingga menghilangkan kebutuhan akan pengawasan manual yang terus-menerus.

Keuntungan finansialnya jelas. Antara tahun 2022 dan 2024, biaya inferensi AI turun 280 kali lipat, sehingga pemantauan berkelanjutan dan pelatihan ulang menjadi pilihan praktis. Saluran pipa otomatis juga membantu mendeteksi masalah sejak dini, sehingga menghindari kesalahan yang merugikan. Misalnya, kualitas data yang buruk dapat merugikan perusahaan sebesar $12,9 juta per tahun, sementara waktu henti sistem yang tidak direncanakan dapat mencapai $125.000 per jam. Langkah-langkah validasi data otomatis, seperti mengidentifikasi ketidakcocokan skema, nilai nol, atau pergeseran distribusi, memastikan masalah telah diatasi pada tahap penyerapan, sehingga mencegah masalah yang lebih besar di kemudian hari.

Otomatisasi tidak hanya mempercepat alur kerja tetapi juga memangkas pengeluaran yang tidak perlu. Pipeline yang dapat menyesuaikan sendiri memastikan pelatihan ulang hanya terjadi bila diperlukan, sehingga mengurangi penggunaan sumber daya GPU yang mahal selama periode tidak aktif. Alat seperti LLM-as-a-Judge menyederhanakan proses evaluasi, memangkas biaya sekaligus menjaga konsistensi lebih dari 80% di ribuan pengujian.

Strategi pengujian dapat lebih mengoptimalkan anggaran. Mensimulasikan pengujian dengan alat seperti Dev Proxy memungkinkan Anda menguji titik akhir tanpa dikenakan biaya per panggilan. Memulai dengan model yang lebih kecil dan kumpulan data yang representatif membantu memvalidasi ide sebelum melakukan evaluasi skala penuh. Selain itu, menandai sumber daya cloud berdasarkan proyek, tim, atau versi model memberikan wawasan penagihan terperinci, sehingga memudahkan untuk memutuskan alur kerja mana yang layak untuk diinvestasikan.

Pengujian otomatis juga mendukung tata kelola dengan menciptakan jalur audit yang dibutuhkan oleh regulator. Gerbang tata kelola memastikan alur kerja dijeda hingga aset penting - seperti skema dan data dasar - divalidasi. Setiap snapshot model menjalani penilaian risiko standar, dengan hasil dicatat secara otomatis dan tiket yang dipicu kegagalan dikeluarkan untuk pelacakan.

Otomatisasi dapat memantau tiga jenis penyimpangan utama: penyimpangan data (pergeseran distribusi input), penyimpangan kinerja (penurunan akurasi atau waktu respons lebih lambat), dan penyimpangan keselamatan (peningkatan toksisitas atau paparan informasi sensitif). Peringatan menandai masalah ini sejak dini, sehingga mencegah masalah tersebut memengaruhi pengguna akhir. Selain itu, tombol pemutus (kill switch) memungkinkan tim untuk dengan cepat menonaktifkan rute atau fitur model yang bermasalah selama terjadi insiden, menunjukkan pendekatan langsung terhadap tata kelola yang memastikan sistem tetap terkendali pada saat yang paling penting.

Paket bayar sesuai pemakaian adalah cara cerdas untuk mengelola pengeluaran AI sekaligus memungkinkan tim untuk tumbuh dan beradaptasi dengan mudah. Rencana ini didasarkan pada strategi seperti pelacakan biaya dan skalabilitas modular untuk memastikan bahwa sumber daya digunakan secara efisien.

With pay-as-you-go pricing, you’re only charged for the tokens and compute time you actually use. Real-time dashboards provide insights into token consumption, latencies, and outcomes, helping to pinpoint inefficiencies and eliminate unnecessary spending. When combined with scale-to-zero capabilities, this model becomes even more effective - idle inference endpoints automatically shut down, so you’re not paying for unused GPU resources.

For tasks that aren’t time-sensitive, such as exploratory data analysis or offline model training, spot pricing offers a lower-cost alternative to on-demand rates. These savings add up, especially when paired with tools that track usage and performance in real time, allowing teams to fine-tune their compute needs and stay within budget.

Elastic compute ensures that your workflows can adapt to changing demands without manual adjustments. Features like autoscaling node pools and serverless architectures handle fluctuating workloads seamlessly, so there’s no need to overprovision resources for peak usage. By separating model artifacts from application code and using cloud storage, pods can start up almost instantly, making scaling operations faster and more efficient.

This approach is particularly valuable when transitioning from pilot projects to full-scale production. As the global MLOps market grows - expected to rise from $1.58 billion in 2024 to $2.33 billion by 2025 - organizations need scalable systems that won’t require constant rebuilding. Pay-as-you-go plans align costs with actual usage, making it easier to expand models, users, or teams without driving up expenses.

Paket bayar sesuai pemakaian bekerja sama dengan alat tim canggih untuk menyederhanakan manajemen biaya dan alur kerja operasional. Alat modern mengintegrasikan tata kelola, jalur audit, dan fitur keamanan seperti sistem masuk tunggal (SSO) dan kontrol akses berbasis peran (RBAC) langsung ke lapisan orkestrasi. Kemampuan ini penting untuk memenuhi persyaratan kepatuhan seperti SOC 2 atau ISO 27001.

Platform yang menawarkan dukungan untuk API yang kompatibel dengan OpenAI memungkinkan tim untuk beralih antar penyedia atau model LLM tanpa merombak alur kerja mereka, sehingga memastikan fleksibilitas seiring munculnya teknologi baru. Lingkungan terkelola semakin meningkatkan operasi tim dengan menggabungkan fitur seperti izin, SLA, pelacakan metadata terpusat, dan kontrol otorisasi. Sistem ini tidak hanya berkembang seiring dengan organisasi Anda tetapi juga menjaga transparansi dan kontrol yang diperlukan untuk memenuhi standar peraturan, memastikan setiap anggota tim memiliki akses yang tepat dan setiap tindakan dicatat untuk diaudit.

Membangun alur kerja AI yang efektif memerlukan model canggih yang dikombinasikan dengan pendekatan terstruktur dan terukur. Tujuh praktik yang dibahas sebelumnya membantu mengubah inisiatif AI yang terputus-putus menjadi proses yang efisien dan siap digunakan oleh perusahaan. Dengan menggabungkan beragam LLM, mempertahankan pemantauan biaya berkelanjutan, dan memanfaatkan desain modular, Anda dapat menghilangkan hambatan dan menciptakan alur kerja yang berkembang sesuai kebutuhan Anda. Dimulai dengan tata kelola memastikan setiap keputusan AI dapat dilacak dan mematuhi peraturan, sementara permintaan berbasis komunitas dan siklus pengujian otomatis mempercepat pengembangan tanpa mengurangi kualitas. Strategi-strategi ini menjadi tulang punggung operasi AI yang efisien dan andal.

Seperti yang dijelaskan sebelumnya, metode ini dapat meningkatkan efisiensi sebesar 20% hingga 50% di seluruh alur kerja seperti orientasi dan manajemen insiden. Pelacakan biaya secara real-time, dipadukan dengan model bayar sesuai pemakaian, menjaga pengeluaran tetap selaras dengan penggunaan, menghindari pembengkakan anggaran sekaligus mendukung penskalaan yang lancar. Dengan mengintegrasikan otomatisasi dan putaran umpan balik, sistem AI dapat mengoptimalkan dirinya sendiri, mengidentifikasi anomali, menyarankan penyempurnaan, dan mengelola tugas-tugas kompleks secara mandiri.

Pergerakan menuju tata kelola terintegrasi dan arsitektur adaptif menggarisbawahi pentingnya membangun alur kerja di atas landasan yang kokoh. Alat yang terstandarisasi, batasan komponen yang jelas, dan penelusuran mendetail memastikan sistem Anda tetap fleksibel seiring munculnya model dan kemampuan baru. Dengan berfokus pada proses yang dapat diskalakan dan berulang, Anda dapat beralih dari proyek percontohan ke produksi skala penuh tanpa perbaikan terus-menerus.

Bersama-sama, strategi ini mengubah eksperimen yang terfragmentasi menjadi alur kerja yang efisien, akuntabel, dan hemat biaya. Siap mengendalikan alur kerja AI Anda? Dengan Prompts.ai, Anda dapat mengamankan model, mengelola biaya, dan melakukan penskalaan dengan mudah. Akses lebih dari 35 model teratas, manfaatkan kontrol FinOps bawaan, dan terapkan tata kelola tingkat perusahaan - semuanya dalam satu antarmuka. Prompts.ai menghilangkan penyebaran alat, memastikan kepatuhan, dan memungkinkan tim Anda fokus pada inovasi, mengubah kekacauan AI menjadi operasi yang efisien dan didorong oleh ROI.

Untuk memilih model bahasa besar (LLM) yang paling sesuai, mulailah dengan mengidentifikasi secara jelas kebutuhan spesifik Anda - apakah itu untuk penulisan, pengkodean, dukungan pelanggan, atau aplikasi lainnya. Evaluasi model menggunakan pendekatan terstruktur yang mempertimbangkan faktor-faktor seperti kinerja, biaya, dan privasi. Untuk tugas dengan risiko minimal, prioritaskan model yang lebih cepat dan ramah anggaran. Di sisi lain, tugas-tugas berisiko tinggi memerlukan model yang lebih andal dan mencakup pengawasan yang tepat. Pembandingan adalah langkah penting untuk memastikan model yang dipilih memenuhi persyaratan tugas dan sasaran operasional Anda.

Untuk menjaga agar biaya AI tetap terkendali, penting untuk melakukan pemantauan penggunaan token seperti yang terjadi. Ini melibatkan pelacakan permintaan, perintah, dan panggilan model. Dengan tetap mengikuti metrik ini, Anda dapat menemukan inefisiensi dan melakukan penyesuaian untuk mengoptimalkan penggunaan sumber daya, menjaga keseimbangan antara biaya dan kinerja.

Agar tetap terdepan dalam penyimpangan model, siapkan sistem pemantauan otomatis yang terus memantau metrik performa dan kualitas data secara real-time. Alat-alat ini dapat mendeteksi pergeseran seperti penyimpangan konsep, pergeseran kovariat, atau penyimpangan label dengan memeriksa perubahan dalam distribusi data dan akurasi prediksi. Ketika penyimpangan terdeteksi, pemicu pelatihan ulang yang telah ditentukan sebelumnya dapat bekerja untuk memperbarui model Anda dengan cepat, menjaga validasi yang konsisten dan integrasi yang lancar dalam proses MLOps Anda.