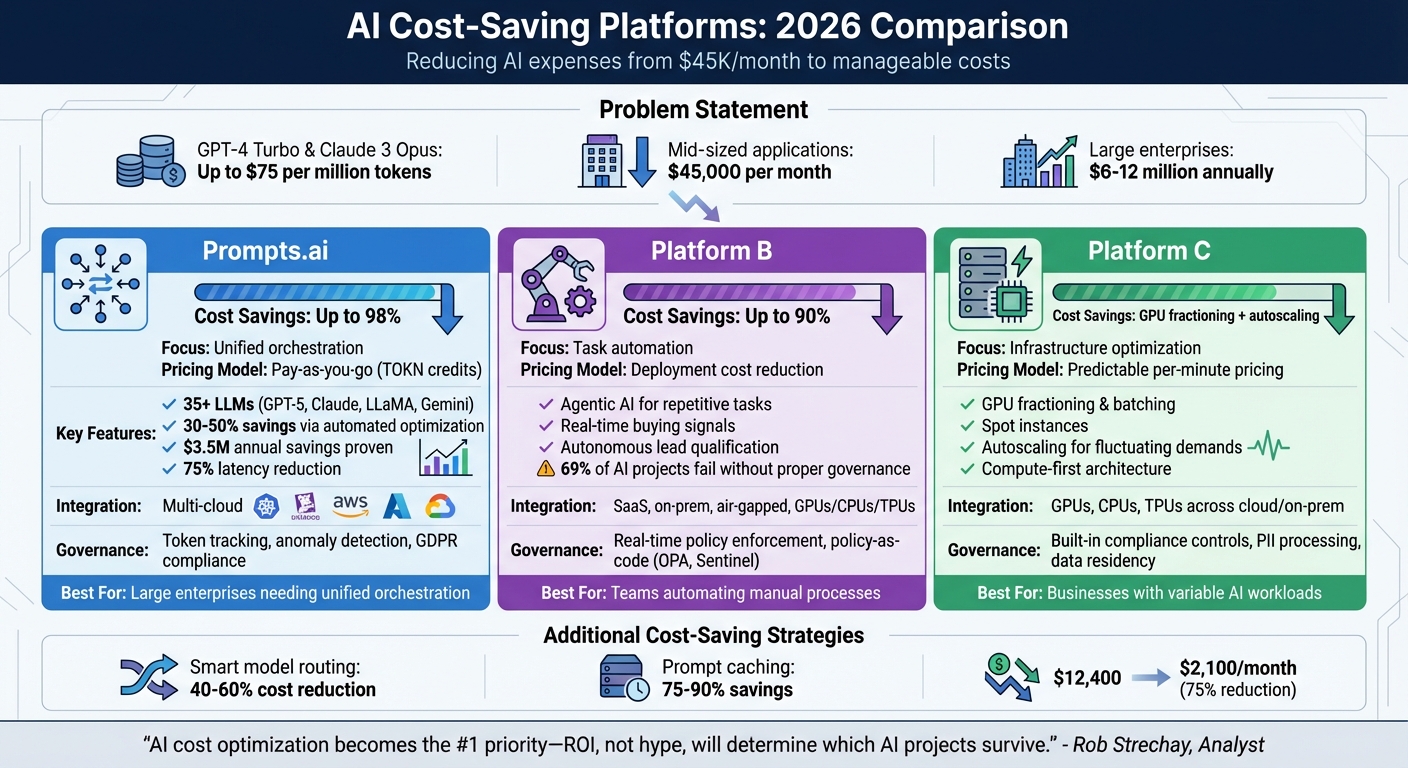

到 2026 年,管理人工智能成本已成为企业的首要任务。由于 GPT-4 Turbo 和 Claude 3 Opus 等模型每百万代币的成本高达 75 美元,费用可能会迅速失控 - 达到 每月 45,000 美元 适用于中型应用和 $6–12 million annually 对于大型企业。为了解决这个问题,平台如 提示.ai、平台 B 和平台 C 提供通过统一编排、自动化和 基础设施优化。主要要点包括:

这些平台简化工作流程、减少开支并确保合规性,帮助企业在保持预算的同时保持绩效。

| 功能/平台 | 提示.ai | 平台B | 平台C |

|---|---|---|---|

| 节省成本 | 高达98% | 高达90% | GPU 分段、自动缩放 |

| 重点 | 统一编排 | 任务自动化 | 基础设施优化 |

| 定价模型 | 即用即付(TOKN 积分) | 降低部署成本 | 可预测的每分钟定价 |

| 一体化 | 多云、Kubernetes、Datadog | SaaS、本地、气隙 | GPU、CPU、TPU |

| 治理 | 令牌跟踪、异常检测 | 实时政策执行 | 内置合规性控制 |

Choosing the right platform depends on your organization’s needs, whether it's reducing costs, improving workflows, or managing compliance effectively.

__XLATE_9__

Prompts.ai 将 GPT-5、Claude、LLaMA 和 Gemini 等超过 35 种最先进的大型语言模型汇集到统一的编排平台中。通过消除多个供应商合同和订阅的需要,它使组织能够将 AI 软件成本降低多达 98%。该平台在使用 TOKN 积分的即用即付系统上运行,确保用户只需为他们使用的内容付费,无需任何经常性的月费。

Prompts.ai delivers 30–50% savings through automated resource optimization, which adjusts compute, storage, and network resources to the exact needs of the organization. Proven implementations have shown annual savings of $3.5 million by applying these optimizations to AI training and inference workloads. The platform’s FinOps layer provides detailed cost tracking, allowing teams to pinpoint anomalies and fine-tune spending at a granular level - whether by token, inference, or API call.

实时成本控制通过为团队和项目设置支出上限来帮助避免预算超支。高峰和非高峰时段的自动 GPU 扩展可减少高达 75% 的延迟,同时降低云 AI 服务费用。对于基于 Kubernetes 的管道,Prompts.ai 可以自动执行现货实例使用和工作负载调度,有效地将工作负载打包到经济高效的实例上,而不会影响模型性能。其无缝集成功能还确保了与现有基础设施的兼容性。

Prompts.ai 可以轻松地与 AWS、Azure、Google Cloud、Kubernetes、AWS Lambda、Amazon EC2、Snowflake 和 Datadog 等平台连接,从而在当前设置中实现流畅的工作流程。它支持大型语言模型的实时数据流并自动配置,使开发人员能够在流量激增期间更轻松地集成 Datadog 等监控工具或规模推理端点。这些集成不仅改善了资源分配,还最大限度地减少了运营开销。通过并排模型比较,团队可以根据自己的需求选择最具成本效益的选项,而统一的提示工作流程则消除了同时使用多个工具的麻烦。

除了节省成本和集成之外,Prompts.ai 还提供治理工具,确保精确的成本跟踪和遵守监管标准。用于成本分配的虚拟标记和基于机器学习的异常检测等功能无需更改现有基础设施即可运行。该平台支持 Showback 模型,并在多云环境中遵守 GDPR 等法规,确保可审计的成本治理。每个人工智能交互都会被记录下来,为企业提供模型使用、团队活动和数据管理的完整可见性。

Prompts.ai 旨在轻松处理不断增长的人工智能工作负载,支持轻松扩展的多云设置。组织可以在短短几分钟内加入新的模型、用户和团队,而无需中断当前的工作流程。其架构专为企业级部署而设计,能够管理超过 100,000 个生产变更,同时保持一致的性能。这使其成为公司从小规模试点项目过渡到跨多个部门的全面人工智能运营的理想解决方案。

平台 B 旨在通过自动化接管重复性任务来降低人工智能成本。它不只专注于基础设施调整,而是使用代理人工智能来处理研究、数据输入和 CRM 更新等时间密集型活动。这使得团队能够专注于更有影响力的工作,同时降低运营成本。

通过自动化手动流程,平台 B 显着降低了费用。其代理人工智能自主运行,对实时购买信号做出反应,而不是依赖僵化的剧本。这使其能够识别合格的潜在客户并有效地制作定制消息。使用该系统的公司报告称,AI 部署成本下降了 90%[3]。

平台 B 充当集中控制中心,用于管理跨各种基础设施(包括 SaaS 平台、云 VPC、本地系统,甚至气隙环境)的 AI 工作负载。与 GPU、CPU 和 TPU 兼容,无需专门配置。该平台通过直观的 UI、SDK 和 CLI 与现有 AI 工具无缝集成,使构建和配置模型变得更加容易。这种方法允许组织增强其当前的设置,而无需进行大量的基础设施更改。

该平台通过跨云环境自动收集证据和实时执行策略来确保合规性。使用 OPA、HashiCorp Sentinel 和 AWS Config 等策略即代码工具,它将治理嵌入到 CI/CD 和 IaC 管道中。自动偏差检测将实时基础设施与声明的状态进行比较,标记并解决非托管资源或安全问题。每个模型工件都与其 Git 提交和 Terraform 计划 ID 相关联,从而创建详细的审计跟踪。由于集成和治理障碍,69% 的人工智能项目未能实现部署[3],这些功能有助于避免未经授权的操作并维持监管标准。

平台 B 提供统一的控制平面来管理多云 AI 设置。它通过标准化 IAM 角色和标记来简化扩展,同时使用协调循环来优化资源以应对不断增长的工作负载。鉴于 94% 的组织将流程编排视为 AI 成功的关键[3],这种简化的系统支持从小试点扩展到大规模企业部署,而不会增加不必要的复杂性。其集中式方法可确保随着业务的扩展随时采取节省成本的措施。

平台 C 专注于通过优化基础设施层来削减成本。它雇用了 GPU 分段和批处理 以充分利用 GPU 资源。通过将多个工作负载分组在一起,它可以提高吞吐量,确保企业只需为他们主动使用的资源付费,而不是维持未使用的容量。

该平台通过以下方式减少开支 现货实例和自动缩放。自动扩展可最大限度地减少空闲期间的计算资源,这对于人工智能需求波动的企业来说是理想的选择。它不依赖于昂贵的每个代币定价,而是提供了 可预测的每分钟定价模型,随着使用规模的扩大,成本更易于管理。此外,通过将 GPU 推理与电信接入点并置,无需多个第三方供应商,从而简化了集成并降低了相关成本。这些功能与灵活的部署策略相结合,以适应各种业务需求。

平台C使用 计算优先架构 支持跨 GPU、CPU 和 TPU 的部署。其统一控制平面允许跨 SaaS 平台、云 VPC、本地设置甚至气隙环境无缝编排 AI 工作负载,所有这些都无需供应商锁定。这种方法使组织能够利用其现有基础设施,同时访问预构建模型和工作流程库。该平台无需复杂的配置,从而简化了操作。

该平台包括用于处理 PII 处理、通话录音同意和数据驻留要求等任务的内置控件。其统一的堆栈架构通过维护监管标准来简化合规性,而不会增加额外的复杂性。通过将治理功能整合到单一平台中,企业可以有效地满足合规性需求并控制成本。

选择平台时,必须权衡利弊,以充分利用您的人工智能投资。本节以早期的成本节约策略为基础,研究平台不同的关键领域。

降低成本: Smart model routing can cut costs by 40–60% by diverting simpler queries to more affordable models, such as DeepSeek or Gemini Flash. Additionally, using prompt caching for repetitive tasks can save 75–90%. For example, in late 2025, a team reduced their monthly expenses by 75%, dropping from $12,400 to $2,100 by routing queries to cost-efficient models.

整合能力: Platforms offering extensive connectors - some supporting over 70 vector databases and 100+ data ingestion sources - are highly adaptable to existing systems. However, these abstract layers may introduce 15–25% latency compared to direct model calls, which could be a concern for real-time applications.

__XLATE_35__

治理与合规:对于监管严格的行业来说,包含审计跟踪、可解释性工具和数据驻留控制的平台至关重要。该决定通常归结为平衡灵活性和控制力。自托管解决方案提供了增强的隐私性,但需要更多的技术专业知识,而 SaaS 平台虽然提供了便利,但代价是数据主权的潜在成本。这些治理考虑因素极大地影响了实际使用中的可扩展性。

可扩展性:随着工作负载的增加,基于执行的定价模型对于复杂的 AI 工作流程通常更加经济,而 OpenAI for Codex 在生产中使用的状态持久性和持久执行等功能使代理能够在不丢失上下文的情况下管理长时间运行的任务。相反,较小的框架更适合边缘部署,即使它们缺乏一些企业级功能。

最终,2026 年的成功将取决于您如何将平台功能与您在成本、集成、合规性和可扩展性方面的特定需求结合起来。

__XLATE_41__

- __XLATE_109__

Choosing the right platform to maximize cost savings and streamline operations in 2026 depends heavily on your organization’s size and specific needs. The strategies discussed - ranging from unified orchestration to intelligent model routing - are key for platforms designed to support seamless AI workflows. For large enterprises, orchestration layers offering centralized governance, token tracking, and vendor management are essential for coordinating multiple teams and maintaining compliance. On the other hand, small to mid-sized businesses often find greater value in using smaller, specialized models and tools tailored to specific tasks, like invoice processing or demand forecasting, without the complexity of large-scale integrations.

成本控制仍然是运营效率背后的驱动力。正如分析师 Rob Strechay 所说,“人工智能成本优化成为第一要务 - 投资回报率(而不是炒作)将决定哪些人工智能项目能够生存。”这些优化策略为满足各种规模组织的定制方法铺平了道路。

For smaller teams, immediate savings can be achieved with prompt caching and straightforward model routing. High-volume operations, however, gain more from advanced techniques like semantic caching and intelligent routing, which ensure premium models are reserved for complex tasks. Enterprises managing large-scale AI initiatives require robust governance tools - such as budget alerts, audit trails, and token approval systems - to keep spending under control. Notably, while technology accounts for only 20% of an AI initiative’s value, redesigning workflows delivers the remaining 80%, making operational adjustments equally critical.

在成本效率不容妥协的时代,采用人工智能主权(在私有基础设施上运行模型)为组织提供了一种在保护敏感数据的同时减少开支的方法。到 2026 年蓬勃发展的平台将是那些与运营工作流程无缝集成的平台,能够真正节省成本,同时保持性能和合规标准。

Prompts.ai 通过以下方式帮助企业减少人工智能支出 智能提示路由 和 工作流程优化。通过将更简单的任务引导到更便宜的模型,并为要求更高或更关键的工作保留高级模型,这种方法有助于降低基于代币的费用。平均而言,企业报告节省了约 6.5%。

该平台还包括实时成本跟踪、超过 35 个人工智能模型的访问以及基于规则的路由等工具,以简化流程。用于管理多个提供商的统一 API 和重用先前输出的缓存策略等功能进一步有助于最大限度地减少资源消耗和成本。这些工具可确保人工智能工作流程保持高效且经济高效,同时保持高性能。

Prompts.ai 以其出色的表现而大放异彩 以人工智能为中心的编排工具,旨在简化各种人工智能模型、数据集和应用程序的工作流程。其突出特点包括 实时成本跟踪 and adherence to strict security standards such as SOC 2 Type II and HIPAA. With support for over 35 AI models, it’s a strong option for businesses aiming to enhance AI-driven operations while keeping costs and security in check.

相比之下,其他平台通常可以实现更广泛的自动化目标。有些人擅长 无代码自动化,提供广泛的应用程序集成,以满足管理不同工作流程的非技术团队的需求。其他人优先考虑 安全的人工智能工作流程管理,专注于减少工具蔓延、简化流程并提供深入的成本可见性。

Prompts.ai 特别适合有需要的企业 高效、安全且注重预算的人工智能工作流程解决方案,而替代平台可能会更好地服务于那些具有一般自动化或利基合规性要求的人。

治理和合规性在选择合适的人工智能成本节约平台方面发挥着至关重要的作用。它们确保您的人工智能工作流程遵守法律、道德和组织标准,这是保护敏感数据、避免罚款和维持信任的关键。

坚实的治理框架使企业能够有效地监督和管理人工智能的运营。它确保政策得到遵循,同时控制成本。这种方法降低了资源滥用的风险,并使人工智能计划与企业目标和监管要求保持一致。通过优先考虑治理,组织可以降低风险,同时提高效率并节省成本。