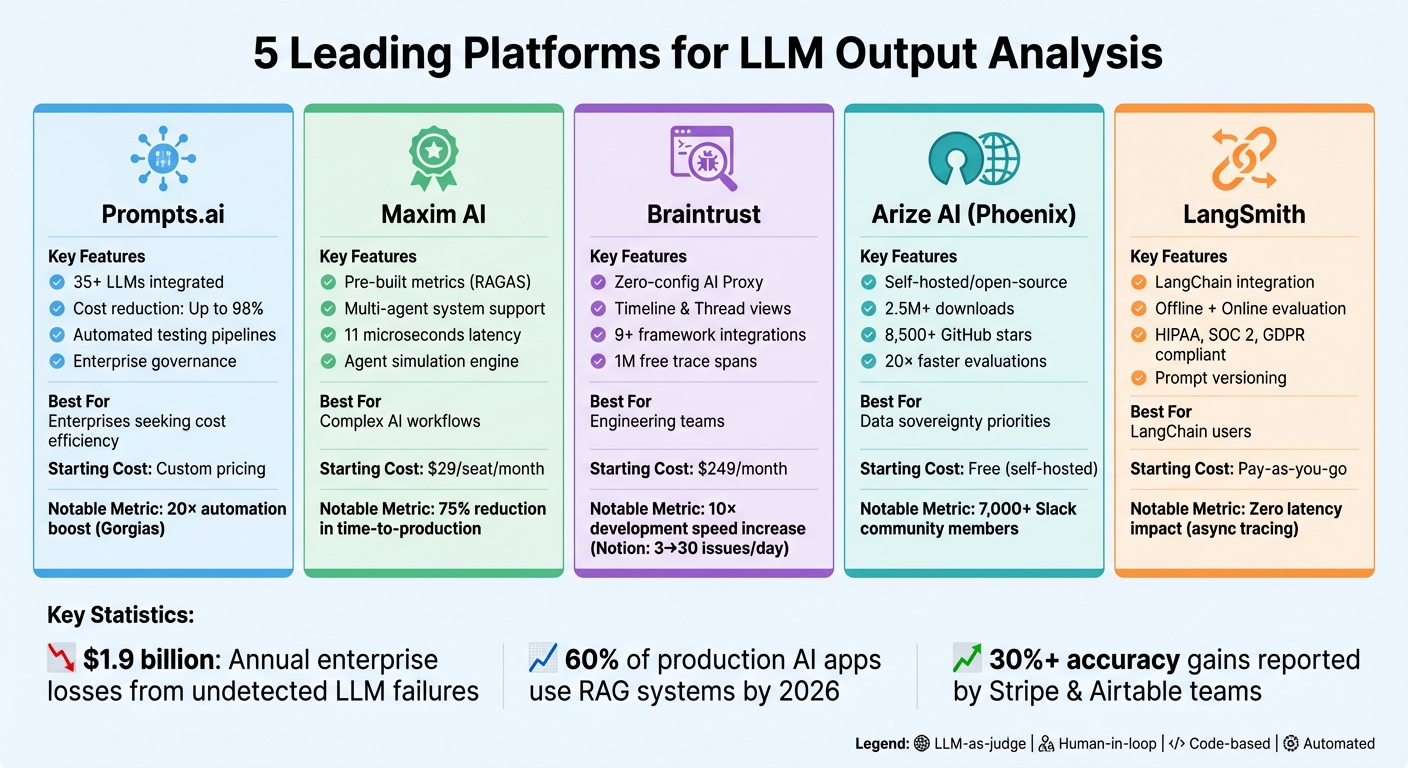

大型语言模型 (LLM) 功能强大但不可预测,通常会产生不一致或成本高昂的输出。为了应对这些挑战,组织依靠专门的工具进行评估、监控和成本管理。本文介绍 五个平台 简化 LLM 输出分析:

每个平台都解决了法学硕士工作流程的独特方面,从提高准确性到削减成本和确保合规性。

| 平台 | 主要特点 | 最适合 | 起始成本 |

|---|---|---|---|

| 提示.ai | 集中式 LLM 访问、节省成本的 FinOps 工具 | 追求成本效益的企业 | 定制定价 |

| 马克西姆人工智能 | 预建指标、多代理系统支持 | 管理复杂人工智能工作流程的团队 | $29/席位/月 |

| 智囊团 | 调试工具、多轮对话测试 | 工程团队 | $249/月 |

| 阿里兹人工智能 | 开源、详细追踪、幻觉检查 | 优先考虑数据控制的组织 | 免费(自托管) |

| 兰·史密斯 | LangChain集成,及时版本控制 | 浪链用户 | 按量付费 |

这些平台简化了法学硕士管理,确保可扩展、可靠且经济高效的人工智能运营。

__XLATE_5__

Prompts.ai brings together 35+ top-tier LLMs - including GPT‑5, Claude, LLaMA, and Gemini - into one unified platform designed for enterprise-level prompt engineering and detailed output analysis. It simplifies evaluation with automated testing pipelines.

Prompts.ai 具有评估管道,能够在提示数据集上运行 20 多个测试。其中包括 LLM 断言(使用 AI 对输出进行分级)、通过余弦相似度进行语义相似度检查、精确匹配评估和基于正则表达式的模式匹配等方法。团队还可以通过用户友好的仪表板纳入人机交互评估,允许领域专家手动评估输出,作为人类反馈强化学习的一部分。

For instance, Gorgias, a customer support platform, used Prompts.ai to scale its AI-powered helpdesk to support millions of shoppers. This led to a 20× boost in automation. Their ML engineers and support teams run daily regression tests on backtest datasets to catch potential issues before deployment.

这些严格的测试功能可确保顺利集成到当前的工作流程中。

Prompts.ai’s evaluation pipelines seamlessly integrate with CI/CD workflows and enable backtesting against historical production data. The platform supports connections through external HTTP endpoints, custom Python/JavaScript scripts, and Model Context Protocol (MCP) actions.

Speak 是一款语言学习应用程序,利用这些自动化功能将数月的课程开发压缩为一周。这种效率使他们能够同时在 10 个新市场推出人工智能驱动的功能。

Prompts.ai 还通过提供并排模型比较视图来帮助团队优化成本。这些比较允许用户权衡 API 成本、延迟和质量分数之间的权衡。团队可以总结输出或使用更小、更快的模型来执行中间任务,以减少令牌的使用。 NoRedInk 为美国 60% 的学区提供服务,利用这些节省成本的功能为超过 100 万学生的成绩提供人工智能生成的反馈,同时保持教师水平的质量。

Prompts.ai 通过为所有利益相关者配备完善 LLM 输出的工具来加强协作。无代码可视化编辑器允许非技术用户编辑和测试提示,而无需依赖工程师。集中式的PromptRegistry确保高效的版本管理。

例如,ParentLab 通过让非技术领域专家管理 700 项即时修订,在短短六个月内节省了 400 多个工程时间。

__XLATE_12____XLATE_13__

该平台还收集用户评分并将其转化为绩效分数,创建持续的反馈循环以提高所有集成模型的输出质量。

Maxim AI 提供深入的测试和监控工具,将机器驱动的评估与人类反馈相结合,以支持团队管理复杂的 AI 工作流程。其功能旨在确保全面的评估,这对于保持出色的法学硕士表现至关重要。

Maxim AI 使用强大的评估框架,包括确定性测试、统计方法和自动判断工具。这 评估器商店 提供 RAGAS 等预构建指标,专为检索增强生成系统量身定制,到 2026 年,该系统将成为约 60% 的生产人工智能应用程序的关键组件。 节点级指标 help identify failures in retrieval and generation processes. The platform’s 代理模拟 引擎支持多轮对话测试和用户角色创建以进行部署前评估。 Clinc 和 Mindtickle 等公司报告称,通过采用这些质量标准,生产时间缩短了 75%。

Maxim AI’s evaluation tools integrate effortlessly with today’s development environments. It supports SDKs in Python, TypeScript, Java, and Go, while offering compatibility with platforms like LangChain, LangGraph, Crew AI, OpenAI, Anthropic, Mistral, and AWS Bedrock. The platform also adheres to 开放遥测 分布式跟踪标准,并与 Slack 和 PagerDuty 等工具连接以实现实时警报。企业用户受益于包括云和 VPC 内托管在内的部署选项,所有选项均满足 SOC2、HIPAA 和 GDPR 合规性要求。

这 Bifrost LLM 网关 使用语义缓存来减少开支,同时监控令牌使用情况和 API 成本,以识别和解决昂贵的工作流程。这确保了生产规模的高效运营。

Maxim AI’s 无代码用户界面 使产品经理和设计师能够独立尝试提示并进行评估。 Rise Science 产品主管 Kellie Maloney 分享道:

__XLATE_29__

该平台还包括用于人工循环审核的注释队列、具有版本控制的集中式 Prompt CMS 以及具有 SAML/SSO 支持的 RBAC。利用这些协作工具的团队将运输速度提高了五倍,简化了迭代并加快了生产部署。

Braintrust 将离线实验与在线评分相结合,让团队能够全面了解从开发到部署的 LLM 表现。

Braintrust 提供了多种方法来评估输出质量,范围从 0 到 1。团队可以使用自动评分器来执行诸如事实性和相似性检查之类的任务,依靠法学硕士作为法官评估,或实施根据其特定需求量身定制的自定义代码逻辑。该平台包括 时间线视图 使用甘特图来识别瓶颈, 话题浏览次数 用于调试多轮对话,以及显示为沙盒 React 组件的自然语言驱动的跟踪可视化。它还支持对每个输入运行多次试验,帮助团队衡量差异并保持一致性。

Braintrust 与领先的人工智能框架顺利集成,为 9+主要框架,例如 OpenTelemetry、Vercel AI SDK、OpenAI Agent SDK、Instructor、LangChain、LangGraph、Google ADK、Mastra 和 Pydantic AI。它使用“包装”。集成方法 - 示例包括 包装AI SDK Vercel AI SDK(涵盖版本 v3 到 v6 beta)以及 包装_openai 为导师。平台秉承 OpenTelemetry GenAI 语义约定,自动将令牌使用和模型标识符等详细信息映射到 Braintrust 字段。它与主要的法学硕士提供商无缝合作,包括 OpenAI、Anthropic 和 Google Gemini。开发者还可以使用 评估() 函数或带有以下命令的 CLI - 手表 每当开发过程中更新文件时,都会自动重新运行评估。

Braintrust 超越了评估,通过内置工具促进团队协作。它是 双向同步 确保产品经理和工程师可以在代码和 UI 之间交替处理提示。这 操场 提供了一个无代码空间,团队可以在其中测试提示、并排比较模型以及共享配置以进行快速迭代。专用注释工具允许团队提供人机交互反馈,直接向迹线和模型输出添加标签或更正。可以邀请外部注释者评估不同模型版本的质量,同时共享评估待办事项集中数据集和评分标准,从而无需手动电子表格跟踪。

Arize AI 的 Phoenix 是一个开源平台,旨在让团队全面控制评估大型语言模型 (LLM)。 Phoenix 以 OpenTelemetry 为核心构建,以超过 250 万次下载和 8,500 多个 GitHub star 吸引了人们的关注。它提供详细的跟踪来跟踪 LLM 工作流程的每个步骤,从而更轻松地识别出现问题的位置。

凤凰城采用 法学硕士法官 方法,使用 OpenAI、Anthropic 和 Gemini 的基础模型来评估其他 LLM 申请的相关性、毒性和整体表现等因素。它配备了用于常见任务的预构建评估器,例如检索增强生成 (RAG) 和函数调用。一个突出的特点是它 解释能力,其中评估模型提供了分数背后的清晰推理,帮助开发人员理解每个评估背后的逻辑。其他工具包括基于代码的确定性检查、直接在界面内进行人工注释以及 数据集聚类 它使用嵌入来直观地对语义上相似的问题和响应进行分组。这种聚类有助于隔离模型表现不佳的区域。

__XLATE_63__

这些评估工具与平台更广泛的开发生态系统无缝集成。

Phoenix 支持 LlamaIndex、LangChain、DSPy、Mastra 和 Vercel AI SDK 等流行框架的自动检测。它与 Python、TypeScript 和 Java 配合使用,其 OpenTelemetry 原生设计可确保与现有可观测工具的兼容性,而无需将用户锁定到特定供应商。团队还可以合并来自 Ragas、Deepeval 或 Cleanlab 等第三方库的评估,从而在整个工作流程中提供灵活性。

Phoenix 专为提高效率而打造,提供 评估运行速度提高高达 20 倍 通过并发和批处理。其 Prompt Playground 提供了一个测试环境,团队可以在部署之前完善提示并并排比较模型变体,从而降低代价高昂的生产错误的风险。

作为一个完全开源和自托管的平台,Phoenix 确保团队对其数据保持完全控制。特点如 人工注释队列 允许将真实标签直接添加到痕迹中,从而促进更好的协作。这 提示中心 管理跨环境的即时版本控制、存储和部署,而 跨度聊天 该工具使团队能够评估和讨论特定的工作流程段以发现性能问题。 Slack 社区拥有超过 7,000 名成员,用户可以访问网络进行故障排除和分享见解。

__XLATE_76__

LangSmith 是一个多功能平台,旨在与或不与 LangChain 无缝协作,使其适用于任何 LLM 堆栈。它可以轻松地与 OpenAI、Anthropic、CrewAI、Vercel AI SDK 和 Pydantic AI 等工具连接,为已经使用特定框架的团队提供灵活性。该平台符合 HIPAA、SOC 2 Type 2 和 GDPR 等合规标准,并使用异步流程发送跟踪,确保最终用户不会增加延迟。

朗史密斯提供 两种评价模式 以满足不同的需求:用于在开发过程中测试精选数据集的离线评估和用于监控实时生产流量的在线评估。它支持四种类型的评估器:

该平台包括高级分析工具,例如 差异视图,它突出显示了模型输出和参考文本之间的差异,以及性能基准测试的并排比较。它还提供 元数据分组,能够按主题领域或用户类型等类别分析准确性或成本等指标。 LangSmith 与开源集成 开放评估 包,提供预构建的评估器来评估正确性和简洁性。

这些功能可以轻松地将 LangSmith 集成到现有的工作流程和开发工具中。

LangSmith 通过以下方式简化了追踪 @可追踪 自动捕获输入和输出的装饰器或客户端包装器。它支持与 Python 和 TypeScript/JavaScript SDK、REST API 以及 pytest、Vitest 和 Jest 等测试框架集成,从而可以轻松地将评估嵌入到 CI/CD 管道中。此外,OpenTelemetry 集成允许团队将现有可观测性管道中的跟踪直接发送到 LangSmith。

LangSmith 通过直观的反馈和注释工具增强团队协作。 注释队列 启用特定运行的自动路由给主题专家,以便根据自定义标准进行手动审查和评分。这 提示中心 作为团队迭代、版本和共享提示的集中空间,并具有更改跟踪和回滚功能,以在整个开发过程中保持一致性。内联注释功能使团队成员可以标记问题或提供有关响应质量的有针对性的反馈,从而提高评估准确性和工作流程效率。

该平台还提供详细的用户管理和工作负载隔离,确保团队之间的顺利协作。用户可以在 smith.langchain.com 免费注册 - 无需信用卡。对于生产使用,LangSmith 以按需付费的方式运营,企业计划可在跨 AWS、GCP 或 Azure 的 Kubernetes 集群上自托管。

在评估LLM评估平台时,必须考虑技术兼容性、成本和评估方法。以下是选项的详细介绍:

提示.ai 将超过 35 个领先模型汇集在一个安全界面下,提供 FinOps 控制,可将 AI 软件成本降低高达 98%。 智囊团 使用零配置 AI 代理简化设置,通过单个基本 URL 捕获日志。它包括 100 万个免费跟踪跨度,付费计划起价为 249 美元/月。 马克西姆人工智能 与现有的可观察性堆栈无缝集成,专注于质量评分而不是完整的跟踪。它提供每月最多 10,000 个日志的免费计划和每个席位每月 29 美元起的付费计划。 阿里兹·菲尼克斯 支持数据隐私的自托管,与 RAGAS 和 Giskard 等工具集成以进行更深入的指标分析。 兰·史密斯 为LangChain用户量身定制,提供先进的可观察性,尽管企业支持定价各不相同。值得注意的是,Notion 在 Braintrust 的帮助下将其开发速度提高了十倍,从每天解决 3 个问题增加到 30 个。

每个平台的独特方法可根据您的特定评估需求简化决策。以下是它们在评估方法、集成和部署方面的比较:

集成复杂性也起着关键作用。 Braintrust 基于代理的设置非常简单 - 只需更新您的 API 基本 URL 即可。 Maxim AI 与现有的可观测性工具集成,而 LangSmith 的紧密 LangChain 集成可满足专门的可观测性需求。 Arize Phoenix 在优先考虑数据主权的组织中脱颖而出,提供自托管的开源解决方案。同时,Prompts.ai 提供企业级治理控制和完整的审计跟踪以确保安全操作。

__XLATE_111__

为了快速获得洞察,基于代理的部署和深度集成简化了流程。 LangChain 用户会发现 LangSmith 非常适合,而管理敏感数据的组织可能会倾向于使用 Arize Phoenix 或 Prompts.ai 等开源解决方案来获得强大的治理和审计功能。

根据提供的评估,每个平台都为完善 LLM 输出分析提供了独特的优势。 提示.ai 为企业提供对领先模型的集中访问,并与 FinOps 控制相结合,可将 AI 成本降低多达 98%,同时确保强大的治理和审计能力。 智囊团 专为快节奏的工程团队量身定制,Notion 等公司报告称开发速度提高了 10 倍 - 将每天解决的问题从 3 个提高到 30 个。同样,Stripe 和 Airtable 的团队在采用该平台后几周内就发现准确率提高了 30% 以上。

对于深度融入浪链生态的人来说, 兰·史密斯 提供轻松集成和快速原型制作选项。 马克西姆人工智能 迎合专注于管理复杂的多代理系统的团队,提供精确的评分工具和低延迟网关,在每秒 5,000 个请求的情况下仅引入 11 微秒的开销。同时, 阿里兹·菲尼克斯 非常适合优先考虑数据主权的组织,提供可无缝融入现有可观测系统的自托管开源解决方案。

每个平台都解决了法学硕士绩效和成本管理方面的关键挑战。企业面临潜在损失 每年 19 亿美元 由于生产中未发现的 LLM 故障,需要超越主观评估,转向可测量的、数据驱动的指标,这对于确保可靠性和效率至关重要。

这些工具将法学硕士发展提升为结构化工程学科。无论您的重点是每月处理数万亿个事件、简化团队之间的协作,还是保持对自托管基础设施的控制,选择正确的平台都可以确保您的 LLM 工作流程实现实现您的目标所需的可靠性、质量和成本效益。

这些平台旨在通过提供监控和微调大型语言模型 (LLM) 使用的工具来帮助组织减少人工智能支出。例如,Prompts.ai 等解决方案允许用户实时跟踪代币使用情况,从而更容易发现并减少不必要的代币消耗。这有助于避免过多 API 调用的超支,从而实现更好的成本管理。

除了成本控制之外,这些平台还提供有关性能和输出质量的宝贵见解。它们可以帮助检测和防止幻觉或错误等问题,否则可能会导致昂贵的返工。通过分析使用趋势并找出效率低下的地方,组织可以简化工作流程、降低运营成本并确保一致的高质量结果。所有这些都支持更智能、数据驱动的决策,以有效管理人工智能预算。

LLM平台提供了多种与工具和工作流程无缝连接的方式,以满足不同的需求。许多平台支持通过 Python 和 JavaScript 等 SDK 以及 LangChain 和 LangServe 等框架进行本机集成。这使得将法学硕士嵌入到定制应用程序中变得简单而高效。对于监控,平台通常支持 OpenTelemetry 等开放标准,确保与现有基础设施的兼容性。

一些平台还与 GitHub Actions 和 Jenkins 等 CI/CD 工具集成,从而简化了测试和部署流程。对于优先控制环境的组织来说,可以使用自托管选项,允许自定义,同时保持数据安全。这些集成功能使用户能够提高效率、有效监控绩效并在其运营中安全地实施法学硕士。

对于那些重视的人 数据隐私和控制, 本地法学硕士 提供了一个优秀的解决方案。该平台专为隐私敏感任务而设计,允许大型语言模型 (LLM) 在离线设置中安全地处理机密或受限数据。通过实现完全本地执行,它可以显着降低数据泄露的机会,同时还可以在必要时为混合设置提供可选的云集成。

OnPrem.LLM 凭借其直观的无代码界面,确保无需技术专业知识的用户也可以访问,同时保持对数据管理的全面监督。这使其成为受监管或敏感行业的组织的理想选择,这些行业的信息保护是重中之重。