2026 年,人工智能工作流程平台将重塑企业运营方式,从简单的任务自动化转向由大型语言模型 (LLM) 提供支持的更智能、决策驱动的系统。这些工具简化了运营,降低了成本,并与现有技术生态系统无缝集成,解决了工具蔓延和缺乏兼容性等挑战。以下是引领这一转变的顶级平台:

这些平台满足成本效率、可扩展性和治理等关键需求,使其成为企业引领人工智能驱动的未来的重要工具。

Prompts.ai 将超过 35 个大型语言模型 (LLM)(例如 GPT-5、Claude、LLaMA、Gemini、Grok-4 和 Flux Pro)汇集到一个安全的平台中。这消除了处理多个订阅、登录和计费系统的麻烦。以下是其功能如何简化人工智能工作流程并提高生产力。

Prompts.ai’s design allows users to switch between models effortlessly without reconfiguring workflows or managing separate API keys. This means you can directly compare GPT-5’s strengths to those of Claude or Gemini, then direct production tasks to the model that fits your needs best. Each model has unique strengths - some excel in creative tasks, while others are better suited for data analysis or coding. This flexibility ensures you always have the right tool for the job.

除了集成功能之外,Prompts.ai 还通过其简单的、基于使用情况的计费模型帮助降低成本。通过实施统一的代币使用跟踪系统,该平台提供即用即付的 TOKN 积分,无需经常性费用。通过将多个工具整合到这个单一、透明的平台中,许多组织已将 AI 软件费用降低了高达 98%。

Prompts.ai adapts to the needs of individuals, teams, and enterprises alike. Plans start at $29 per month for individual users, while enterprise plans range from $99 to $129 per member. There’s even a $99 Family Plan, recognizing that AI automation is increasingly valuable for both personal and professional use. This scalability ensures that users only pay for what they need, whether they’re automating workflows for a small team or an entire organization.

对于不断增长的业务,安全治理是重中之重。 Prompts.ai 采用企业级功能构建,为每次 AI 交互提供审核跟踪,以支持合规性需求。敏感数据保留在组织内部,避免在多个第三方服务中暴露。实时仪表板使管理员能够了解支出、访问控制以及将人工智能成本直接与业务成果联系起来的能力。这些工具对于保持人工智能驱动的运营的透明度和控制至关重要。

Vellum AI 采用了不同的方法,专注于人工智能原生工作流程编排,而不仅仅是自动化单个任务。它允许用户用简单的语言描述流程,平台自动生成工作流程结构——无需手动设置节点。这种“提示构建”功能可以节省大量时间,特别是对于尝试多个代理概念的团队而言。

凭借其与模型无关的设计,Vellum 可以实现法学硕士之间的无缝切换,以平衡成本、速度和质量,而无需重建完整的工作流程。该平台支持检索增强生成 (RAG)、语义路由和多步骤代理编排等高级功能。它允许用户链接提示,因此一个模型的输出成为另一个模型的输入,从而实现复杂的推理管道。内置的版本控制和评估工具可以轻松测试和完善提示变化。

Vellum 旨在将技术和非技术团队聚集在一起。产品经理和运营人员可以使用其可视化构建器来创建代理,而工程师可以使用 TypeScript 或 Python SDK 的自定义逻辑来增强工作流程。例如,RelyHealth 使用 Vellum 部署了数百个定制医疗保健代理,将其部署时间缩短了 100 倍。技术与设计副总裁 Max Bryan 分享道:

__XLATE_8__

我们将 9 个月的时间表加快了 2 倍,并通过我们的虚拟助手实现了无懈可击的准确性。 Vellum 在使我们的数据具有可操作性和可靠性方面发挥了重要作用。

The platform’s strong governance features ensure that rapid deployment doesn’t compromise security.

Vellum 通过基于角色的访问控制 (RBAC)、SSO/SAML 集成以及跟踪每个提示和输出的不可变审核日志提供企业级安全性。它符合 SOC 2、GDPR、HIPAA 和 ISO 27001 标准。部署选项包括公共云、私有 VPC、本地设置,甚至适用于法规严格的行业的气隙环境。人机交互审批门允许暂停敏感操作以进行审查,从而确保问责制。值得注意的是,78% 的运营领导者将可解释性和调试工具视为其购买决策的关键因素。

专业版计划的起价为 25 美元/月,商业计划的起价为 79 美元/用户/月,以及提供无限积分和专门支持的自定义企业定价。

Zapier 将 AI 任务连接到 8,000 多个应用程序,每月为超过 100 万家公司处理超过 2300 万个 AI 任务。用户可以从 GPT、Anthropic、Gemini 和 Azure OpenAI 等 LLM 提供商中进行选择,也可以选择内置的免费选项,如 GPT-4o mini 和 Gemini 2.0 Flash。通过用人工智能驱动的动态决策取代静态工作流程,Zapier 提供了更具适应性的自动化体验。

Zapier 的 Zaps 功能中的代理使 AI 能够自主决定如何实现目标,超越严格的工作流程。这些代理可以执行网络搜索、起草消息和更新数据库等任务,而无需人工干预。该平台还支持直接在工作流程中处理图像、音频和视频。借助模型上下文协议 (MCP) 连接器,开发人员可以将外部 AI 工具无缝集成到 Zapier 的 8,000 多个应用程序的生态系统中,而无需复杂的 API 设置。为了增加控制,人机交互审批步骤(例如基于 Slack 的审核)允许团队在最终确定人工智能生成的操作之前对其进行验证,从而提高自动化的准确性和信任度。

Zapier 通过实际应用展示了其在扩展运营方面的价值。例如:

这些例子凸显了人工智能自动化如何提高各行业的效率和财务影响。

__XLATE_16__

“扎皮尔让我们的三人团队看起来像十人团队。” - Marcus Saito,远程 IT 和 AI 自动化主管

Zapier 遵守 SOC 2 Type II、GDPR、GDPR UK 和 CCPA 标准,并采取保障措施确保第三方 AI 模型不会使用客户数据进行训练。该平台提供集中式治理工具,例如用于实现完整使用可见性的域捕获、用于限制特定人工智能集成的应用程序控制以及团队、应用程序和数据级别的详细权限。安全措施包括企业 SSO (SAML 2.0)、SCIM、双因素身份验证、IP 白名单和用于安全内部连接的 VPC 对等互连。数据受到顶级加密和传输协议的保护,确保工作流程更改的透明度。专业计划的起价为 19.99 美元/月,团队计划的起价为 69 美元/月,并且为包含无限用户的企业计划提供自定义定价选项。

Make 使用显示自动化工作流程的可视画布连接 3,000 多个应用程序。与传统的线性工具不同,Make 采用基于场景的自动化,其中包含分支逻辑、过滤器和灵活的多路径工作流程。得益于迭代器和聚合器等功能,其可视化构建器特别擅长处理数据转换。这使其成为无需编码技能即可处理大量数据的绝佳选择。

Make 为 OpenAI(ChatGPT、DALL-E、Whisper)和 Google Gemini 等流行工具提供本机模块,同时还通过其 HTTP 模块支持任何 OpenAI 兼容模型。 2026 年,该平台引入了 Make AI Agents——目标驱动的自动化,可以自主选择工具来实现既定目标。这些代理利用现有的 Make 场景来处理任务,无需人工干预。此外,Make 还充当模型上下文协议 (MCP) 服务器,允许外部 AI 模型(例如 Claude)安全地执行 Make 场景,作为现实世界任务的工具。

展望未来,Make Maia 助手将使用户只需用自然语言描述即可构建复杂的工作流程。此功能将允许以对话方式创建自动化,减少手动配置的需要并简化用户的流程。

Make 使用基于操作的定价模型,按模块执行而不是按完成的工作流程收费。免费计划包括每月 1,000 次操作和 2 个活动场景。核心计划(10,000 次操作,无限场景)的付费计划起价为 9 美元/月,Pro(增加优先支持)每月 16 美元,Teams(具有多用户功能)每月 29 美元。额外的操作可以以每 1,000 次操作大约 1 美元的价格购买。对于具有分支逻辑的复杂工作流程,此模型非常经济,因为您只需为运行的模块付费。然而,人工智能步骤每次执行可能会消耗多个学分,具体取决于其复杂性。

Make’s pricing model and operational framework support scalability, from simple automations to enterprise-level workflows. The platform ensures data integrity with ACID transactions and offers tools for bulk data processing. It boasts a 99.9% infrastructure availability rate and average response times under 200ms for standard integrations. Examples of its scalability in action include:

__XLATE_23__

Teleclinic 的运营主管表示:“Make 确实帮助我们扩大了运营规模,消除了流程中的摩擦,降低了成本,并减轻了我们支持团队的负担。”

__XLATE_25__

Shop Accelerator Martech 的首席运营官表示:“Make 以我们从未想象过的方式在我们的业务中提高了前所未有的效率。它只需花费一小部分成本即可雇用一名额外的员工(或 10 名)。”

The upcoming Make Grid feature, set to launch in 2026, will act as a "Command Center", providing a visual overview of an organization’s entire automation ecosystem. This tool will help teams identify bottlenecks and monitor workflow performance in real time.

Make adheres to SOC 2 Type II, GDPR, and SCIM standards, offering Single Sign-On (SSO) and a secure connection manager that stores API keys securely instead of embedding them directly in workflows. The "Scenario Run Replay" feature allows users to replay failed executions with the original data, speeding up troubleshooting processes. Enterprise plans include advanced governance options and dedicated support, though some users have noted that the platform’s role-based access control (RBAC) is less detailed compared to other enterprise solutions. To minimize risks, critical modules should include manual error-handling configurations to prevent silent data loss during API disruptions. For organizations with strict compliance needs, redirecting execution data to an external logging service may be advisable, as Make’s native logs are retained only for a limited time based on the plan.

n8n 作为一个专为开发人员设计的平台脱颖而出,提供云托管和自托管选项。它采用基于执行的定价模型,其中一次工作流程运行等于一次执行,无论它包含多少个步骤。这使得它成为管理复杂、多步骤的人工智能工作流程的实用选择,而且不会产生通常与基于任务的定价相关的更高成本。

n8n 提供原生 LangChain 集成,使用户能够直接在其可视化编辑器中创建先进的多代理 AI 系统和 RAG(检索增强生成)管道。借助 AI 代理节点,标准法学硕士可以转变为目标驱动的代理,能够使用工具、做出决策并在复杂的工作流程中保留记忆。该平台支持一系列法学硕士,包括 OpenAI、Anthropic (Claude)、Google Gemini、DeepSeek、Groq 和 Hugging Face,以及矢量数据库集成,例如 pgvector、Pinecone、Chroma、Qdrant 和 Weaviate。其AI Workflow Builder甚至可以自动将自然语言描述转换为功能性工作流程。通过链接 AI 请求并使用更便宜的模型进行中间步骤,用户可以将 API 成本降低 30-50%。

n8n’s execution-based pricing ensures affordability for even the most complex workflows. Technical users can access the self-hosted Community Edition for free, with unlimited workflows and executions. For cloud-hosted options, the Cloud Starter plan begins at $20/month for 2,500 executions, while Cloud Pro offers 10,000 executions for $50/month. For businesses, the self-hosted Business plan costs $800/month, offering advanced features, while Enterprise pricing is customized for organizations requiring features like advanced RBAC, SSO, and dedicated support. By charging per workflow execution instead of per step, n8n can save organizations over $500 per month on high-volume workflows compared to task-based pricing models.

n8n is built to handle up to 220 workflow executions per second per instance. Its Queue Mode leverages Redis to distribute execution across multiple worker processes, enabling horizontal scaling to meet increasing demands for fast and efficient AI workflows. For instance, in 2025, Dennis Zahrt, Director of Global IT Service Delivery at Delivery Hero, implemented a user management workflow that saved the company 200 hours each month. Similarly, Luka Pilic, Marketplace Tech Lead at StepStone, reported a dramatic improvement in efficiency, completing two weeks’ worth of API integration and data transformation work in just two hours.

__XLATE_29__

“我最多需要 2 个小时来连接 API 并转换我们需要的数据。在代码中不可能这么快地做到这一点。” - Luka Pilic,StepStone 市场技术主管

n8n 通过与 AWS Secrets Manager、Azure Key Vault、Google Cloud Platform、HashiCorp Vault 和 Infisical 等外部秘密管理器集成来优先考虑安全性,确保敏感凭证远离平台。对于选择通过 Docker 或 Kubernetes 自托管的用户,所有工作流程数据、凭证和日志都保留在自己的防火墙内,支持遵守 HIPAA、GDPR 和 SOC 2 等法规。企业用户通过“项目”受益于高级 RBAC,“项目”根据角色限制对特定工作流程和凭证的访问。此外,基于 Git 的源代码控制允许在开发、登台和生产环境之间安全地移动工作流程。

Gumloop 是一个专门为帮助团队轻松利用大型语言模型 (LLM) 而设计的平台。该系统的核心是 Gummie,它是一个人工智能助手,可以将自然语言指令转换为功能齐全的工作流程。事实证明,这种能力对于组织来说是无价的。 Instacart 首席执行官 Fidji Simo 表示:“Gumloop 在帮助 Instacart 的所有团队(包括那些没有技术技能的团队)采用人工智能并实现工作流程自动化方面发挥了至关重要的作用,这极大地提高了我们的运营效率。”

Gumloop supports model-agnostic workflows, allowing users to switch seamlessly between models like GPT-4o, Claude 3.7 Sonnet, Deepseek V3 R1, and Gemini 2.5 Pro within a single automation. Unlike many platforms that require users to manage API keys separately, Gumloop simplifies the process by including LLM costs in its subscription plans. The AI Router node intelligently assigns tasks to the right models, while the Model Context Protocol (MCP) server enables connections to custom APIs, extending the platform’s capabilities beyond its 125+ built-in nodes. This setup ensures predictable pricing and smooth integration.

Gumloop’s pricing structure is designed for flexibility and clarity:

通过将 LLM API 成本捆绑到其订阅计划中,而不是按任务收费,Gumloop 简化了预算,使组织能够更轻松地扩展其 AI 工作流程,而无需产生意外费用。

Gumloop’s structure is designed to grow alongside organizations of any size. It uses a hierarchical approach, with Organizations providing centralized control and Workspaces enabling collaboration across departments like Sales, Marketing, and Operations. The platform also supports agentic workflows, where AI agents can assess tasks dynamically and trigger workflows based on context instead of following rigid sequences. Bryant Chou of Webflow remarked, "Gumloop wins time back across an org. It puts the tools into the hands of people who understand a task and lets them completely automate it away." Additionally, the platform’s ability to auto-scale and execute workflows in parallel ensures it can handle the demands of enterprise operations.

Gumloop 优先考虑安全性和合规性以满足组织需求。它遵循 SOC 2 和 GDPR 标准,并包含用于企业级控制的工具。管理员可以强制执行 AI 模型允许/拒绝列表,通过限制某些模型或提供商来确保遵守 HIPAA 等法规。隐身模式通过实时擦除所有输入、输出和中间数据来增强隐私。组织级凭据进一步支持集中式安全策略,这些凭据覆盖个人或工作区密钥以防止未经授权的访问。对于需要最高安全性的组织,VPC 部署允许 Gumloop 在自己的云基础设施内运行。全面的审计日志记录跟踪平台上的每个操作,通过仪表板或 API 提供数据流和管理更改的透明视图。

Lindy.ai 通过创建能够思考和适应而不是遵循严格的预设脚本的人工智能代理,在自动化领域脱颖而出。凭借其创新的“vibe 编码”方法,用户可以用简单的英语描述代理的行为,该平台可以快速将其转换为可立即投入生产的解决方案 - 有时仅需 5 分钟。这使得企业可以通过部署具有内存和适应性的代理来减少重复性任务。

该平台利用 GPT 和 Claude 为代理提供分析文本、生成输出和理解用户意图的能力。与面对不断变化的环境时会动摇的传统自动化工具不同,Lindy.ai 代理使用内存来导航复杂的场景,包括通常需要人工输入的边缘情况。 Lindy.ai 支持 3,000 多个本机集成(在某些配置中支持多达 7,000 多个),可与 CRM 系统、电子邮件平台和日历工具无缝连接。首席执行官 Flo Crivello 强调了这一功能:

__XLATE_37__

人工智能驱动的工作流程可以处理这些边缘情况并进行调整以保持自动化的运行。

其 Autopilot 功能通过为代理提供自己的基于云的计算机来增强功能,使他们能够执行典型 API 集成之外的任务。此外,多代理协调允许专业代理在复杂的业务流程上进行协作,从而弥合自动化和实时决策之间的差距。

Lindy.ai 提供基于任务的定价模型,按任务执行而不是按用户收费,这使其成为具有高使用需求的团队的经济选择。定价等级包括:

额外费用包括每分钟 20 个积分的 AI 电话通话和每月每个号码 10 美元的 AI 电话号码,为特殊任务提供了灵活性。

Lindy.ai 旨在轻松扩展,适应个人用户和大型企业。团队帐户允许跨部门安全共享和部署人工智能代理,而代理群功能使单个代理能够克隆自身并同时执行数百项任务,例如管理个性化外展活动。对于需要精确度的工作流程,人机交互 (HITL) 功能可让 AI 处理大部分任务,但会在关键点暂停以供人工审核,这使其成为财务、人力资源或客户支持等领域敏感操作的理想选择。

Lindy.ai 优先考虑安全性和合规性,满足 SOC 2、HIPAA、GDPR 和 PIPEDA 等严格标准。该平台包括信任中心和秘密管理工具,以满足企业级安全需求。通过团队帐户,组织可以配置权限和控制,以确保代理安全且可预测地运行。对于医疗保健提供者,Lindy.ai 提供了一款专为医疗文档量身定制的符合 HIPAA 要求的记事本,满足医疗保健和金融等受监管行业的独特需求。

StackAI 提供了一个无代码平台,通过直观的 2D 视觉画布将大型语言模型 (LLM) 与企业数据联系起来。业务团队可以使用拖放工具轻松创建工作流程,而开发人员可以灵活地使用 Python 节点增强这些工作流程以进行更深入的自定义。 2025 年,LifeMD 的 CIO Stefan Galluppi 使用 StackAI 简化了复杂的人工智能工作流程,展示了该平台的有效性。

这种用户友好的设计支持与领先的法学硕士无缝集成。

StackAI 原生支持顶级 LLM,包括 OpenAI、Anthropic (Claude)、Mistral、Google、Meta、Azure OpenAI 以及通过端点的本地模型。其AI-Native Routing引入了用于if/else决策和动态提示的逻辑节点,从而实现了基于LLM输出的自动化任务路由。内置知识库节点通过处理分块、嵌入、索引和引用检索来简化检索增强生成 (RAG) 流程,覆盖 90% 的开箱即用的 RAG 用例。

该平台还擅长处理非结构化数据,提供 PDF 解析、网页抓取和 OCR 工具。这将原始数据转换为结构化洞察,可以部署为聊天机器人、Web 表单、批量任务的批处理器或用于后端集成的 REST API。例如,在麻省理工学院马丁信托中心,Gen AI 负责人 Doug Williams 在短短几周内为学生创建了 AI 助手,彻底改变了他们的学习体验,而无需具备编码技能。同样,Noblereach 的 BI 总监 Brian Hayt 将生成资助和竞争性研究的完整引用报告所需的时间从一周缩短到五分钟。

StackAI 提供清晰、灵活的定价结构,分为三层:用于早期原型设计的免费计划、用于扩展运营的基于使用情况的 SaaS 模型,以及针对大规模部署(包括私有云或本地选项)量身定制的企业自定义计划。

这种灵活的定价确保StackAI能够为每个阶段的用户提供支持,从小型原型到企业级应用程序。

该平台可满足个人和企业需求,具有 100 多个预构建模板,可用于快速部署。企业级工具包括 SSO、密码保护、自定义域和用于监控令牌使用情况和性能的集中分析。开发人员可以使用自定义代码或 API 节点扩展工作流程,而非技术用户则可以从简单的可视化构建器中受益。 Vercel 首席执行官 Guillermo Rauch 强调了其易用性:

__XLATE_51__

StackAI 使人工智能代理的承诺成为现实。适合所有人,只需点击即可大规模实现。

这种简单性和高级功能的平衡使 StackAI 成为适合各种规模组织的强大工具。

StackAI 通过 8 层治理模型优先考虑安全性,其中包括 RBAC、文件夹级控制、项目版本控制、SSO、加密连接、生产分析和 MFA。该平台符合 SOC 2 Type II、HIPAA 和 GDPR 标准,ISO 27001 认证正在进行中。 PII 检测和编辑、数据保留策略以及根据企业合同不使用用户数据进行模型训练的严格承诺等功能可确保数据隐私。对于国防和金融等具有严格数据驻留要求的行业,StackAI 支持本地和私有云部署。此外,手动审批工作流程可确保人工智能代理在未经适当审查的情况下不会上线。

这种全面的治理和安全方法使 StackAI 成为具有高合规性和隐私标准的组织的值得信赖的选择。

Pipedream is a platform designed with developers in mind, blending serverless infrastructure with AI-driven workflow automation. It’s trusted by over 1,000,000 developers, from small startups to Fortune 500 companies, handling billions of events and supporting data pipelines that process over 10,000,000 events per second. After being acquired by Workday in December 2025, Pipedream has strengthened its focus on enterprise-level stability and governance, giving developers more control and flexibility in automation. This foundation supports its advanced AI integration capabilities.

The platform’s code-centric design is a key feature, allowing developers to write custom Node.js, Python, Go, or Bash code directly within workflows. It also supports the use of any npm or PyPI package in a serverless environment. This flexibility makes it easier for developers to prototype quickly without the limitations often found in no-code platforms.

Pipedream 结合了“用 AI 创建”、“用 AI 编辑”和“用 AI 调试”等 AI 工具(由 String.com 提供支持),帮助开发人员使用自然语言提示和自动错误修复来构建、修改和排除工作流程故障。

The platform supports the Model Context Protocol (MCP), which includes a Docs MCP Server. This feature enables AI assistants like Claude and development environments such as VSCode to search Pipedream documentation and generate precise integration code. Pre-built actions are available for popular LLMs like OpenAI and Claude, handling tasks such as text classification, summarization, and embeddings. Developers can also write their own code to interact with any LLM API using Pipedream’s serverless environment.

Pipedream 使用基于信用的定价结构,其中 1 个信用等于 30 秒的计算时间。

对于企业来说,可以使用 HIPAA 合规性和审核日志等附加功能进行自定义定价。

Pipedream 专为可扩展性而构建,提供可调节内存、自定义超时、速率限制和冷启动管理等功能。它支持事件驱动模式和实时触发器,使其成为大容量数据处理和后端自动化的理想选择。凭借 3,000 多个应用程序集成和内置身份验证管理,团队可以创建复杂的工作流程,而无需担心手动凭据处理。

对于开发团队,该平台提供了 GitHub Sync、VS Code 集成和 MCP 服务器部署等工具。步骤注释允许开发人员将基于 Markdown 的解释直接添加到工作流程步骤中,从而改善团队沟通和文档记录。

Pipedream 优先考虑治理和安全以及性能。该平台经过 SOC 2 Type II 认证,符合 HIPAA 标准,并符合 GDPR 标准。它包括用于管理敏感数据的数据处理协议 (DPA)。主要安全功能包括:

对于企业用户,还可以使用 SAML SSO、用于身份管理的 SCIM 和双因素身份验证 (2FA) 等其他选项。审核日志记录包含在企业层中,提供对工作流程执行和更改的洞察。此外,源可用的触发器和操作增强了安全审查的透明度。

Workato is a platform designed to handle complex, cross-departmental processes for enterprises. It’s trusted by over 2,000 brands, including Broadcom, Zendesk, and Atlassian, to manage workflows that require high uptime and strict governance.

该平台具有 Workato Agentic 和 Workato Agentic 功能。 Genie Framework,它使用人工智能驱动的自动化来超越基本的聊天机器人功能。这些专门的人工智能代理被称为“Genies”,可以检索数据、触发 8,500 多个应用程序的操作,并管理动态流程。 AI Connector 是与 Anthropic 和 OpenAI 合作开发的,利用 Anthropic 的 Sonnet 4 和 OpenAI 的 GPT-4o mini 等模型来执行文本分析、电子邮件起草、摘要和翻译等任务。

At the heart of Workato’s AI capabilities is Workato Genie, which uses generative AI to interpret user intent, incorporate real-time enterprise data, and execute tasks autonomously. Bhaskar Roy, Chief of AI Products & Solutions at Workato, highlights its impact:

__XLATE_64__

“借助 Workato Agentic,企业现在可以通过低代码/无代码快速构建和管理 AI 代理,以提高整个组织的生产力并提高运营效率。”

Workato 还包括 AIRO(AI Orchestrator),这是一款人工智能助手,可帮助用户使用自然语言创建和完善工作流程。预配置的 AI 操作提供内置的 LLM 功能,而 Agent Studio 通过 Slack 或 Microsoft Teams 将敏感决策传递给人类以供批准。对于客户工作区,AI 连接器操作限制为每分钟 60 个请求。

The platform offers pre-built applications known as Genie Apps, such as ITGenie for handling helpdesk tickets and SalesGenie to boost sales productivity. These Genies adapt based on user interactions, ensuring that learning remains specific to the customer’s environment to protect data privacy.

Workato 的人工智能集成与在大型组织中有效扩展的能力相结合。

Workato’s workflows are designed to scale across enterprises and mid-sized businesses, connecting with over 8,500 apps, databases, and ERP systems. With orchestration patterns capable of managing more than 850 billion actions, the platform also supports Data Pipelines for high-volume replication to data warehouses like Snowflake and Databricks. These pipelines use parallel execution and automatic schema updates to handle large datasets efficiently.

决策模型通过将规则存储在各个工作流程之外的集中表中,简化了复杂的业务逻辑,例如动态定价或潜在客户评分。这种方法使审核和更新变得简单。同时,数据表(查找表的升级版)可存储具有高级搜索功能的更大的数据集。

Workato’s global infrastructure supports local data residency with data centers in the EU, Australia, and Singapore. The platform is available in eight languages, including Japanese, Korean, and Spanish, and maintains a 99.9% uptime SLA for critical operations. It has been recognized as a Leader in the Gartner® Magic Quadrant™ for iPaaS seven times, with two instances of being positioned furthest in "Vision" as of 2025.

为了补充其可扩展性,Workato 优先考虑治理和安全性。

Workato’s Enterprise MCP Gateway serves as a secure control layer between AI tools and business systems, enforcing policies and ensuring visibility during runtime. AI agents operate under user-specific OAuth credentials, limiting access to authorized data. Additional safeguards include PII masking and de-identification within workflows.

管理员可以定义“可信技能”,这是代理可以使用的预先批准的配方或连接器,以防止未经授权的 API 调用。 RBAC 2.0确保项目级权限精准,避免不必要的角色扩展。该平台还包括先进的安全措施,例如 BYOK 加密、每小时密钥轮换和使用 mTLS 进行容器隔离。认证包括 SOC 2 Type II、ISO 27001、PCI DSS 和 GDPR 合规性。

实时审计跟踪和人机交互批准确保对所有代理操作负责。审核和批准功能简化了跨开发、测试和生产环境的配方部署。一家组织报告称,使用 Workato 处理员工调动请求的速度提高了 98%。

Workato 遵循以企业为中心的定价模式,没有公开的费率。定价是根据任务数量、高级连接器使用情况和用户数量等因素定制的。小型企业通常每月花费 500 至 3,000 美元,中端市场公司每月花费 3,000 至 10,000 美元,大型企业每月通常花费超过 10,000 美元用于定制集成和支持。该平台专为需要高级治理和复杂流程管理的组织而设计。

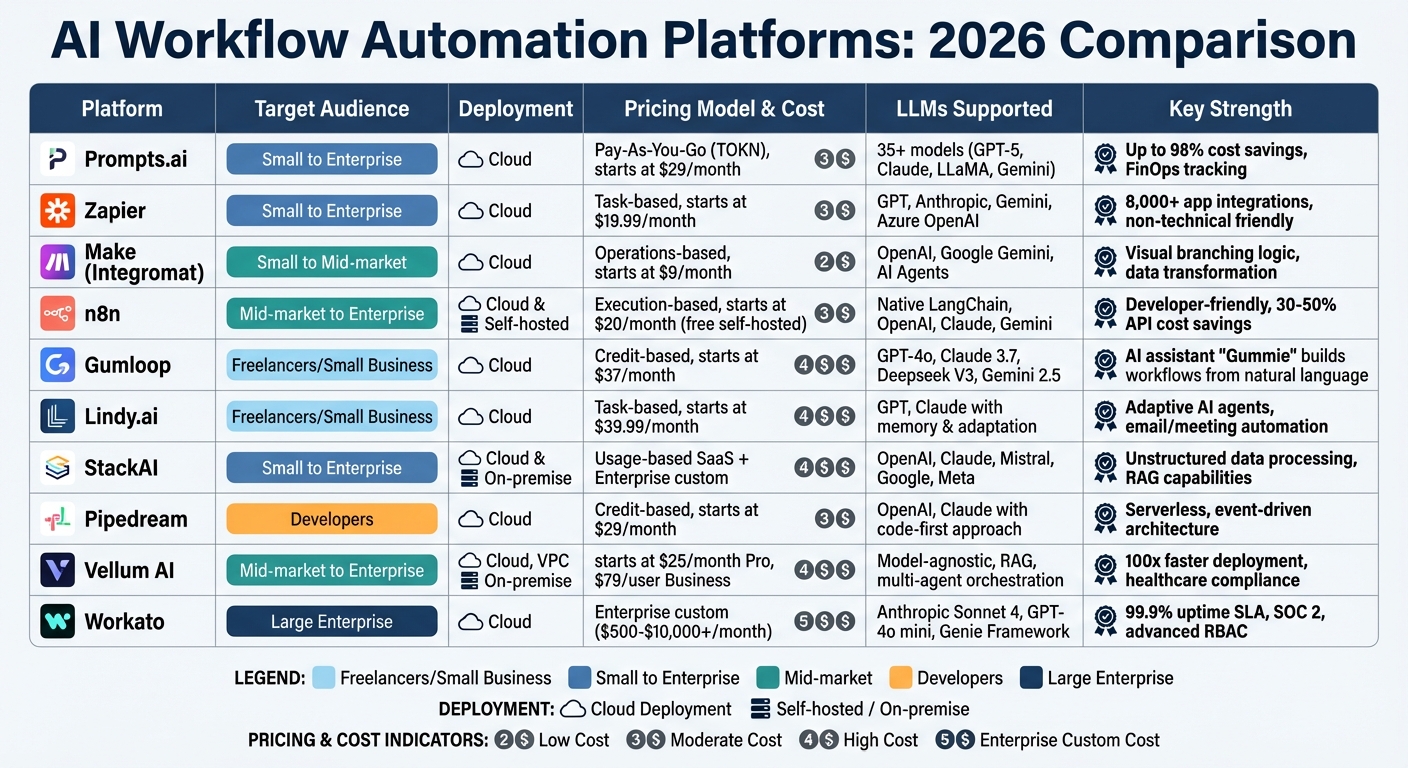

AI 工作流平台比较:功能、定价和性能2026 年目标受众

Choosing the right AI workflow platform depends on your team’s size, technical expertise, budget, and governance requirements. To simplify the decision-making process, the table below provides a side-by-side comparison of key features across various platforms.

这种比较突出了每个平台如何满足特定的业务需求、平衡定价模型和部署灵活性。例如,n8n 通过其免费的自托管选项提供可预测的成本和灵活性,这使其对技术团队具有吸引力。相比之下,Zapier 等平台优先考虑非技术用户的易用性,但任务量大时可能会变得成本高昂。

在考虑部署选项时,数据隐私是一个关键因素。与大多数纯云平台不同,n8n 允许自托管,让团队能够完全控制其基础设施。另一方面,Workato 等企业解决方案专注于高级治理和合规性,使其成为管理敏感、大容量工作流程的理想选择。这些区别确保企业可以将平台功能与其运营优先级保持一致。

Choosing the right AI workflow platform in 2026 requires aligning your team's technical skills with your organization’s scale and compliance needs. For non-technical teams, tools like Zapier or Lindy.ai offer intuitive, prompt-based environments. On the other hand, developer-heavy organizations often prefer platforms like n8n or Pipedream, which provide greater customization through code extensions. A key differentiator among these platforms is how they manage workflow maintenance, a theme that has been explored throughout this guide.

从基本自动化到自主人工智能工作流程的演变引入了新的需求——处理语义决策、检索增强生成和多代理编排。正如尼古拉斯·泽布所说:

__XLATE_77__

2026 年的前进道路是从仅限人工智能自动化开发的学科到团队运动的巨大飞跃。

这一转变强调了将技术灵活性与治理功能相结合的平台的重要性,使工程师和主题专家能够有效协作。这些挑战凸显了绩效指标和运营透明度的重要性。

生产就绪平台通过实时日志记录、版本控制和清晰的定价结构等功能脱颖而出。由于基础设施限制,95% 的生成式 AI 试点未能投入生产,因此支持可观察性和成本可预测性的工具至关重要。许多组织从重点试点开始,尽早合并语义路由,并在第三周引入回归测试,从而在 2 到 6 周内实现生产级结果。

除了技术能力之外,法规和安全合规性对于企业采用也至关重要。基于角色的访问控制 (RBAC)、SOC 2 合规性、审计跟踪和灵活的部署选项等功能可确保平台在满足监管要求的同时进行扩展。正如前面所强调的,Prompts.ai 和 Workato 等平台有效地集成了这些控件来满足不同的企业需求。

虽然人工智能代理到 2028 年可能贡献 4500 亿美元的价值,但只有 2% 的组织完全接受它们。本指南中讨论的平台为弥合这一差距奠定了基础,将孤立的人工智能实验转变为可扩展、可测量的工作流程,从而推动生产力向前发展。

2026 年,人工智能工作流程平台将为企业和专业人士带来改变游戏规则的优势。它们简化了复杂任务的自动化,提高了工作流程效率,并集中管理各种人工智能模型。这些功能可大幅降低成本并将生产力提高十倍。

除了效率之外,这些平台还解决了合规性、安全性和集成多个工具的挑战等紧迫问题。通过统一人工智能模型和自动化治理流程,它们确保了平稳运营。它们还可以轻松地与先进的大型语言模型集成,使组织能够有效地扩展其运营,同时保持对其人工智能工作流程的控制和监督。这种效率和监督的结合使得这些平台对于提高生产力和维持高运营标准至关重要。

Prompts.ai 通过提供实时成本跟踪和灵活的即用即付定价模式,使企业能够削减开支,同时保持透明度。这些工具使公司能够密切关注他们的支出,并且只为他们积极使用的资源付费,确保支出保持可预测和适应性。

最重要的是,Prompts.ai 强调安全性和合规性,具有 SOC 2 Type II 和 HIPAA 合规标准。这些措施有助于降低代价高昂的监管挫折的风险。通过将有效的成本管理与强大的合规保障相结合,Prompts.ai 可以帮助组织简化工作流程,而不会面临意外的财务障碍。

人工智能工作流程平台优先考虑强大的安全协议,以保护敏感信息并满足行业法规。关键措施包括用于保护传输中和静态数据的加密、用于管理用户权限的基于角色的访问控制,以及遵守 SOC 2 和 GDPR 等框架。

许多平台还提供高级功能,例如实时威胁检测、安全密钥管理以及验证其对安全性的关注的认证。这些工具有助于降低未经授权的访问、数据泄露和人工智能模型被盗等风险,使企业能够自信地管理人工智能驱动的工作流程。