Orquestração de IA em 2026 evoluiu para uma necessidade de gerenciamento de fluxos de trabalho complexos, coordenação de agentes especializados de IA e integração com sistemas corporativos como ferramentas de CRM, ERP e ITSM. As empresas agora estão aproveitando plataformas que não apenas conectam vários modelos de IA, mas também otimizam custos, garantem conformidade e fornecem escalabilidade contínua. Com mais 50% das empresas espera-se que adotem essas plataformas, selecionar a ferramenta certa tornou-se fundamental para alcançar eficiência operacional e resultados mensuráveis.

Cada plataforma oferece pontos fortes únicos, desde eficiência de custos até governança e escalabilidade avançadas. Esteja você automatizando fluxos de trabalho ou coordenando agentes de IA, essas ferramentas permitem que as empresas dimensionem as operações enquanto mantêm o controle e a segurança.

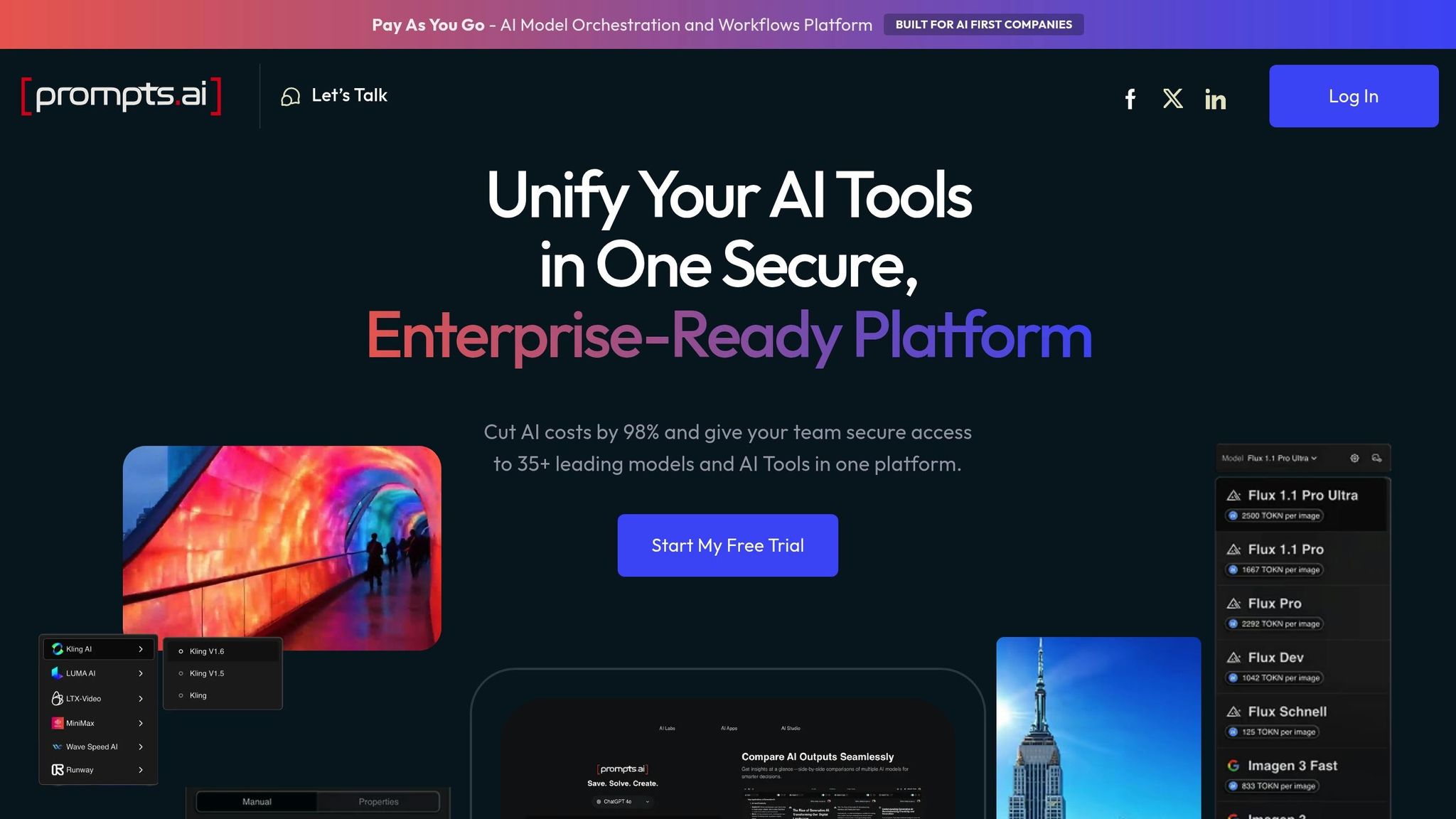

Prompts.ai reúne 35 principais modelos de linguagem grande - como GPT-5, Claude 4, LLaMA 3 e Gemini - em uma plataforma unificada e pronta para empresas. Esta configuração simplifica a automação do fluxo de trabalho, elimina a necessidade de múltiplas ferramentas e reduz os custos de software de IA ao até 98%, ao mesmo tempo que permite que os usuários alternem modelos dinamicamente com base em suas tarefas.

O mecanismo de inferência unificado da plataforma integra-se perfeitamente com APIs nativas para mais de 50 grandes modelos de linguagem. Isso permite a troca dinâmica de modelos nos fluxos de trabalho sem a necessidade de alterações de código, reduzindo a latência em até 40% em pipelines multimodelos. Por exemplo, a Netflix usou Prompts.ai para automatizar 80% de seus fluxos de trabalho de conteúdo, resultando em um Aumento de 25% no engajamento. O design plug-and-play permite que as equipes encadeiem modelos para tomada de decisões em tempo real, otimizando o desempenho para necessidades específicas. Esta abordagem não só melhora a eficiência, mas também proporciona economias substanciais de custos.

Prompts.ai usa um modelo de cobrança de pagamento por token, com taxas entre US$ 0,0001 e US$ 0,001 por 1.000 tokens (USD). Seu sistema de inferência com escalonamento automático, combinado com destilação de modelo, reduz custos em 60%. Além disso, os mecanismos de cache evitam chamadas de API redundantes, reutilizando respostas imediatas. Um relatório da Forrester de 2025 destacou que empresas de médio porte que usam automações diárias reduziram suas despesas de LLM em 50%. Por exemplo, as empresas que processam 1 bilhão de tokens mensalmente economize por aí $10,000. As projeções do Gartner para 2026 posicionam a Prompts.ai como líder na redução do custo total de propriedade para orquestração de IA.

Prompts.ai prioriza a conformidade empresarial com recursos como controle de acesso baseado em função (RBAC), Criptografia AES-256e registros de auditoria detalhados que atendem SOC 2, GDPR e HIPAA padrões. A plataforma também incorpora proteções de IA para detectar polarização e toxicidade de filtro, bloqueando 95% dos resultados prejudiciais em setores sensíveis como o financeiro. Auditorias independentes confirmam estas capacidades. Os especialistas do Gartner observaram que os classificadores de risco do Prompts.ai estão alinhados com os requisitos de alto risco da Lei de IA da UE, incluindo relatórios de conformidade automatizados que registram 100% das inferências para rastreabilidade. Esta abordagem abrangente é fundamental para evitar multas que poderiam atingir 7% da receita anual, garantindo escalabilidade segura em um ambiente regulamentado globalmente.

Com orquestração Kubernetes e implantação sem servidor, Prompts.ai pode lidar mais de 1 milhão de inferências por segundo, acomodando as necessidades de empresas globais com demandas variadas. A plataforma suporta uma comunidade próspera de Mais de 200.000 desenvolvedores e oferece acesso a Mais de 500 plug-ins do GitHub (com mais de 50.000 estrelas). Até 2026, espera-se que a plataforma capture 25% do mercado com 5 milhões de usuários, alimentado por Crescimento de 300% ano a ano. VentureBeat relata que Prompts.ai já atende Mais de 1.000 clientes corporativos, com tempos de implementação em média inferiores a 24 horas ao usar modelos de comunidade e o painel sem código para prototipagem de fluxo de trabalho. Essa combinação de escalabilidade e envolvimento ativo da comunidade posiciona a Prompts.ai como líder em soluções de fluxo de trabalho de IA.

Plataforma B, conhecida como LangGraph, organiza fluxos de trabalho de IA como gráficos direcionados, onde cada nó representa uma etapa específica e as arestas determinam a sequência de execução. Esse design permite ciclos, processamento paralelo e ramificação condicional, tornando-o adequado para lidar com fluxos de trabalho complexos e iterativos. Ele também oferece suporte à execução dinâmica e ao refinamento contínuo em sistemas multiagentes.

LangGraph integra-se com mais de 1.000 ferramentas através do ecossistema LangChain. Ele usa um protocolo de agente aberto, permitindo uma comunicação perfeita entre agentes em estruturas como CrewAI e Microsoft Agent Framework por meio de APIs padronizadas. No início de 2026, LangGraph alcançou v1.0 GA status, marcando sua prontidão para uso em produção em ambientes multiagentes.

LangGraph emprega um arquitetura híbrida que separa o plano de controle de orquestração do ambiente de execução. Essa configuração garante que os usuários mantenham controle total sobre sua infraestrutura de execução e dados confidenciais, enquanto o LangGraph lida apenas com metadados de orquestração. A plataforma nunca acessa o código-fonte do fluxo de trabalho ou processa os dados reais, protegendo as informações proprietárias. Além disso, todos os metadados de orquestração são criptografados durante o trânsito e em repouso, atendendo aos rigorosos padrões de segurança exigidos pelos setores regulamentados. Essa abordagem promove escalabilidade e garante operações tolerantes a falhas.

The platform’s checkpointing feature stores workflow states in databases such as PostgreSQL ou Redis, enabling recovery, human intervention, and in-depth debugging. LangGraph’s precise control over transitions and decision-making processes makes it particularly effective for agentic RAG pipelines that require explicit state management.

A Plataforma C, conhecida como Prefect, oferece orquestração de IA por meio de uma arquitetura híbrida que separa o controle da execução. Embora a interface de orquestração opere como um serviço gerenciado, todos os fluxos de trabalho de IA e processamento de dados permanecem dentro de sua infraestrutura privada, seja uma configuração VPC, Kubernetes ou local. Essa abordagem prioriza implantações seguras e soberania de dados, garantindo que códigos de fluxo de trabalho confidenciais, chaves de API e dados de treinamento nunca saiam da sua rede.

O Prefect se conecta a sistemas de IA usando seu núcleo de código aberto, que possui mais de 6.000.000 de downloads mensais a partir do início de 2026. Essa flexibilidade permite que as equipes integrem vários grandes modelos de linguagem e ferramentas de IA, mantendo o controle total sobre a execução. Os trabalhadores locais cuidam da orquestração por meio de conexões somente de saída, eliminando a necessidade de acesso de entrada ou portas de firewall abertas.

O Prefect foi desenvolvido pensando na segurança empresarial. Ele segura Certificação SOC 2 Tipo II, cumpre com GDPR, e é Preparado para HIPAA, tornando-o ideal para setores como finanças e saúde. Os dados permanecem criptografados em trânsito (TLS 1.2+) e em repouso com chaves de criptografia exclusivas para cada espaço de trabalho. A plataforma oferece suporte a RBAC, logon único (SSO) via SAML 2.0 ou OIDC e sincronização de diretório SCIM. Além disso, oferece registros de auditoria detalhados com períodos de retenção personalizáveis para monitorar a atividade do usuário e alterações no sistema.

__XLATE_83__

Essa estrutura de segurança abrangente oferece suporte à eficiência operacional e à escalabilidade.

Prefect’s open-source base has garnered significant attention, with over 18.000 estrelas e Mais de 372 colaboradores no GitHub. Sua escalabilidade é evidente em aplicações do mundo real, como a implementação do Snorkel AI, que administrou mais de 1.000 fluxos por hora e dezenas de milhares de execuções diárias. Smit Shah, Diretor de Engenharia da Snorkel AI, compartilhou como eles alcançaram um Melhoria de rendimento de 20x ao mesmo tempo que mantém um ambiente Kubernetes auto-hospedado para preservar o controle dos dados. O Prefect também opera em GCP e AWS com alta disponibilidade multi-AZ, tornando-o uma escolha robusta para operações de IA em escala empresarial.

__XLATE_93__

__XLATE_94__

Esta seção analisa os pontos fortes e os desafios das principais plataformas de orquestração de IA, destacando suas vantagens e desvantagens em termos de funcionalidade, custo e usabilidade. À medida que a orquestração de IA continua a evoluir, essas plataformas refletem prioridades de design distintas que atendem a diversos níveis de conhecimento técnico e necessidades de fluxo de trabalho. Os insights aqui baseiam-se em discussões anteriores sobre integração de modelos, gerenciamento de custos e escalabilidade segura.

LangGraph v1.0 oferece controle detalhado por meio de execução baseada em gráficos e persistência de estado, tornando-o adequado para fluxos de trabalho de decisão complexos. No entanto, dominar a plataforma normalmente requer 2–3 weeks, o que pode ser um obstáculo para novos usuários. Seu modelo de preços de pagamento por nó, combinado com suporte para o Protocolo de Agente aberto, garante compatibilidade entre estruturas.

n8n fornece um modelo de precificação baseado em execução econômico, ideal para tarefas repetitivas de IA. Possui integração nativa com LangChain e suporta auto-hospedagem para proteger a privacidade dos dados. As equipes podem se tornar proficientes em 1–2 weeks, mas seus recursos de nível empresarial são um tanto limitados.

Temporal tornou-se uma solução ideal para "Execução de agente durável", destacando-se em cenários que envolvem pausas humanas durante longos períodos ou tarefas que exigem resiliência às reinicializações do servidor. OpenAI aproveita o Temporal for Codex na produção, especialmente para gerenciar tarefas com estado de longa execução. Sua arquitetura orientada a eventos garante escalabilidade e confiabilidade, embora a implementação eficaz exija um alto nível de conhecimento técnico.

Essas comparações ressaltam a importância de equilibrar fatores como controle, custo e facilidade de uso para alinhar-se às necessidades do projeto.

| Plataforma | Curva de Aprendizagem | Melhor para | Modelo de preços | Limitação de chave |

|---|---|---|---|---|

| LangGraph v1.0 | 2–3 weeks | Fluxos de trabalho de decisão complexos | Pagamento por nó | Curva de aprendizado íngreme |

| n8n | 1–2 weeks | Usuários avançados de operações de TI/técnicos | Baseado em execução | Recursos empresariais limitados |

| Temporal | 1–2 weeks | Execução de agente durável | Baseado no uso | Exige proficiência técnica |

| Tripulação AI v1.8 | 1 semana | Prototipagem rápida | Personalizado | Controle limitado |

Projetos de orquestração personalizados geralmente exigem 3–5 times more time do que usar essas plataformas, tornando a escolha da ferramenta certa crítica para cumprir o cronograma e gerenciar os recursos de maneira eficaz.

Choose a platform that complements your team’s skills and fits your workflow requirements. LangGraph v1.0 é ideal para gerenciar fluxos de trabalho complexos que exigem controle de estado preciso. n8n se destaca por seus preços econômicos baseados em execução e recursos de auto-hospedagem, tornando-o uma escolha prática para equipes de operações de TI. Temporal é excelente no gerenciamento de fluxos de trabalho duráveis e de missão crítica, garantindo confiabilidade mesmo durante reinicializações do servidor ou pausas prolongadas. Tripulação AI v1.8 oferece suporte à prototipagem rápida, permitindo que as equipes definam agentes com base em funções e objetivos específicos por meio da colaboração baseada em funções.

Para empresas focadas na integração de grandes modelos de linguagem sem esforço, plataformas como Base Amazônica, LangChain, e Zapier fornecem conectividade robusta para modelos básicos e ferramentas empresariais.

Construir um sistema de orquestração personalizado geralmente requer consideravelmente mais recursos em comparação com o aproveitamento de plataformas estabelecidas. Optar por uma solução que equilibre a força técnica com uma integração suave pode ajudar a acelerar as iniciativas de IA e proporcionar benefícios comerciais tangíveis.

To select the most suitable AI orchestration platform, start by evaluating your team’s specific needs, such as the complexity of workflows, the number of LLMs in use, and your budget constraints. Focus on platforms that offer essential features like centralized model management, cost monitoring, and governance tools.

Platforms that enable workflow automation, ensure compliance, and allow for scalability should take priority. Ease of use is another critical factor - no-code tools are ideal for teams without technical expertise, while open-source platforms may better serve technical teams looking for customization. Lastly, confirm that the platform meets your organization’s security and compliance standards.

Before implementing AI and orchestration platforms, it’s critical to prioritize segurança e conformidade para proteger os dados e cumprir os regulamentos. Procure recursos como controle de acesso baseado em função (RBAC), monitoramento em tempo real e criptografia para dados em repouso e em trânsito. Certifique-se de que a plataforma esteja alinhada com padrões como GDPR, HIPAA ou SOC 2. Salvaguardas adicionais, como registros de auditoria, autenticação multifator (MFA) e integrações seguras de API, são essenciais para manter a integridade operacional e atender aos requisitos regulatórios.

Para reduzir as despesas associadas aos grandes modelos de linguagem (LLMs), mantendo intacto o seu desempenho, considere estratégias como cache de prompt, que elimina processamento redundante, e roteamento de modelo, que atribui tarefas a modelos mais econômicos. Plataformas como prompts.ai simplifique esse processo oferecendo gerenciamento centralizado de modelos, monitoramento de custos em tempo real e seleção dinâmica de modelos. Ao integrar esses métodos, você pode gerenciar custos com eficácia e, ao mesmo tempo, manter resultados de alta qualidade.