As plataformas de fluxo de trabalho de IA em 2026 estão remodelando a forma como as empresas operam, indo além da simples automação de tarefas para sistemas mais inteligentes e orientados a decisões, alimentados por grandes modelos de linguagem (LLMs). Essas ferramentas simplificam as operações, reduzem custos e integram-se perfeitamente aos ecossistemas tecnológicos existentes, resolvendo desafios como a proliferação de ferramentas e a falta de compatibilidade. Abaixo estão as principais plataformas que lideram essa transformação:

Estas plataformas respondem a necessidades críticas como eficiência de custos, escalabilidade e governação, tornando-as ferramentas essenciais para as empresas que navegam no futuro impulsionado pela IA.

Prompts.ai reúne mais de 35 grandes modelos de linguagem (LLMs) - como GPT-5, Claude, LLaMA, Gemini, Grok-4 e Flux Pro - em uma plataforma única e segura. Isso elimina o incômodo de lidar com várias assinaturas, logins e sistemas de cobrança. Veja como seus recursos simplificam os fluxos de trabalho de IA e aumentam a produtividade.

Prompts.ai’s design allows users to switch between models effortlessly without reconfiguring workflows or managing separate API keys. This means you can directly compare GPT-5’s strengths to those of Claude or Gemini, then direct production tasks to the model that fits your needs best. Each model has unique strengths - some excel in creative tasks, while others are better suited for data analysis or coding. This flexibility ensures you always have the right tool for the job.

Além de seus recursos de integração, o Prompts.ai ajuda a reduzir custos com seu modelo de faturamento simples e baseado no uso. Ao implementar um sistema de rastreamento unificado para uso de tokens, a plataforma oferece créditos TOKN pré-pagos, eliminando a necessidade de taxas recorrentes. Muitas organizações reduziram suas despesas com software de IA em até 98% ao consolidar diversas ferramentas nesta plataforma única e transparente.

Prompts.ai adapts to the needs of individuals, teams, and enterprises alike. Plans start at $29 per month for individual users, while enterprise plans range from $99 to $129 per member. There’s even a $99 Family Plan, recognizing that AI automation is increasingly valuable for both personal and professional use. This scalability ensures that users only pay for what they need, whether they’re automating workflows for a small team or an entire organization.

Para operações em crescimento, a governação segura é uma prioridade máxima. Prompts.ai foi desenvolvido com recursos de nível empresarial, fornecendo uma trilha de auditoria para cada interação de IA para atender às necessidades de conformidade. Os dados confidenciais permanecem dentro da organização, evitando a exposição a vários serviços de terceiros. Painéis em tempo real oferecem aos administradores visibilidade sobre gastos, controle de acesso e a capacidade de vincular os custos de IA diretamente aos resultados de negócios. Estas ferramentas são cruciais para manter a transparência e o controlo nas operações orientadas pela IA.

Vellum AI adota uma abordagem diferente, concentrando-se na orquestração do fluxo de trabalho nativo da IA, em vez de apenas automatizar tarefas individuais. Ele permite que os usuários descrevam um processo em linguagem simples, e a plataforma gera automaticamente a estrutura do fluxo de trabalho – eliminando a necessidade de configuração manual do nó. Esse recurso de “prompt-to-build” economiza um tempo significativo, especialmente para equipes que estão experimentando conceitos de múltiplos agentes.

Com seu design independente de modelo, o Vellum permite a alternância perfeita entre LLMs para equilibrar custo, velocidade e qualidade sem exigir uma reconstrução completa do fluxo de trabalho. A plataforma oferece suporte a recursos avançados como geração aumentada de recuperação (RAG), roteamento semântico e orquestração de agente em várias etapas. Ele permite que os usuários encadeiem prompts, de modo que a saída de um modelo se torne a entrada de outro, possibilitando pipelines de raciocínio complexos. As ferramentas integradas de controle de versão e avaliação facilitam o teste e o refinamento de variações imediatas.

Vellum foi projetado para reunir equipes técnicas e não técnicas. Os gerentes de produto e a equipe de operações podem usar seu construtor visual para criar agentes, enquanto os engenheiros podem aprimorar os fluxos de trabalho usando lógica personalizada com TypeScript ou Python SDKs. Por exemplo, a RelyHealth usou o Vellum para implantar centenas de agentes de saúde personalizados, reduzindo o cronograma de implantação em 100 vezes. Max Bryan, vice-presidente de tecnologia e design, compartilhou:

__XLATE_8__

Aceleramos nosso cronograma de 9 meses em 2x e alcançamos uma precisão à prova de balas com nosso assistente virtual. Vellum tem sido fundamental para tornar nossos dados acionáveis e confiáveis.

The platform’s strong governance features ensure that rapid deployment doesn’t compromise security.

Vellum fornece segurança de nível empresarial com controle de acesso baseado em função (RBAC), integração SSO/SAML e registros de auditoria imutáveis que rastreiam cada prompt e saída. Está em conformidade com os padrões SOC 2, GDPR, HIPAA e ISO 27001. As opções de implantação incluem nuvem pública, VPC privada, configurações locais e até mesmo ambientes isolados para setores com regulamentações rígidas. Os portões de aprovação humanos permitem que ações confidenciais sejam pausadas para revisão, garantindo a responsabilidade. Notavelmente, 78% dos líderes de operações citam a explicabilidade e as ferramentas de depuração como fatores críticos nas suas decisões de compra.

O preço começa em US$ 25/mês para o plano Pro, US$ 79/usuário/mês para planos Business e preços Enterprise personalizados para créditos ilimitados e suporte dedicado.

Zapier conecta tarefas de IA em mais de 8.000 aplicativos, lidando com mais de 23 milhões de tarefas de IA mensalmente para mais de 1 milhão de empresas. Os usuários podem selecionar provedores LLM como GPT, Anthropic, Gemini e Azure OpenAI, ou optar por opções gratuitas integradas, como GPT-4o mini e Gemini 2.0 Flash. Ao substituir fluxos de trabalho estáticos por tomadas de decisão dinâmicas orientadas por IA, o Zapier oferece uma experiência de automação mais adaptável.

O recurso Agentes em Zaps do Zapier permite que a IA tome decisões sobre como atingir metas de forma autônoma, indo além de fluxos de trabalho rígidos. Esses agentes podem realizar tarefas como pesquisas na web, redação de mensagens e atualização de bancos de dados sem intervenção manual. A plataforma também oferece suporte ao processamento de imagens, áudio e vídeo diretamente nos fluxos de trabalho. Com o conector Model Context Protocol (MCP), os desenvolvedores podem integrar perfeitamente ferramentas externas de IA ao ecossistema Zapier de mais de 8.000 aplicativos sem precisar de configurações complexas de API. Para maior controle, as etapas de aprovação humanas, como as análises baseadas no Slack, permitem que as equipes verifiquem as ações geradas pela IA antes de serem finalizadas, aumentando a precisão e a confiança na automação.

Zapier demonstra seu valor no dimensionamento de operações por meio de aplicativos do mundo real. Por exemplo:

Esses exemplos destacam como a automação da IA pode gerar eficiência e impacto financeiro em vários setores.

__XLATE_16__

"Zapier faz com que nossa equipe de três pareça uma equipe de dez." - Marcus Saito, chefe de TI e automação de IA, remoto

Zapier adere aos padrões SOC 2 Tipo II, GDPR, GDPR UK e CCPA, com salvaguardas para garantir que modelos de IA de terceiros não usem dados de clientes para treinamento. A plataforma oferece ferramentas de governança centralizadas, como captura de domínio para visibilidade total do uso, controles de aplicativos para restringir integrações específicas de IA e permissões detalhadas nos níveis de equipe, aplicativo e dados. As medidas de segurança incluem Enterprise SSO (SAML 2.0), SCIM, autenticação de dois fatores, lista de permissões de IP e peering de VPC para conectividade interna segura. Os dados são protegidos com criptografia de alto nível e protocolos de transporte, garantindo transparência nas alterações do fluxo de trabalho. Os preços começam em US$ 19,99/mês para planos Profissionais, US$ 69/mês para planos Team, com opções de preços personalizadas disponíveis para planos Enterprise que incluem usuários ilimitados.

Conecte mais de 3.000 aplicativos usando uma tela visual que exibe seus fluxos de trabalho de automação. Ao contrário das ferramentas lineares tradicionais, o Make emprega automação baseada em cenários, que incorpora lógica de ramificação, filtros e fluxos de trabalho flexíveis de múltiplos caminhos. Seu construtor visual é especialmente adequado para lidar com transformações de dados, graças a recursos como iteradores e agregadores. Isso o torna uma excelente escolha para processar grandes volumes de dados sem exigir habilidades de codificação.

Make fornece módulos nativos para ferramentas populares como OpenAI (ChatGPT, DALL-E, Whisper) e Google Gemini, ao mesmo tempo que oferece suporte a qualquer modelo compatível com OpenAI por meio de seu módulo HTTP. Em 2026, a plataforma introduziu Make AI Agents – automações orientadas por metas que selecionam ferramentas de forma autônoma para atingir objetivos definidos. Esses agentes aproveitam os cenários Make existentes para lidar com tarefas sem intervenção manual. Além disso, o Make funciona como um servidor Model Context Protocol (MCP), permitindo que modelos externos de IA, como Claude, executem cenários Make com segurança como ferramentas para tarefas do mundo real.

Olhando para o futuro, o assistente Make Maia permitirá aos usuários construir fluxos de trabalho complexos simplesmente descrevendo-os em linguagem natural. Este recurso permitirá que automações sejam criadas de forma conversacional, reduzindo a necessidade de configuração prática e simplificando o processo para os usuários.

Make usa um modelo de preços baseado em operações, cobrando por execução de módulo em vez de por fluxo de trabalho concluído. O plano Gratuito inclui 1.000 operações por mês e 2 cenários ativos. Os planos pagos começam em US$ 9/mês para o plano Core (10.000 operações, cenários ilimitados), US$ 16/mês para Pro (que adiciona suporte prioritário) e US$ 29/mês para Teams (com recursos multiusuário). Operações adicionais podem ser adquiridas por aproximadamente US$ 1 por 1.000 operações. Este modelo pode ser altamente econômico para fluxos de trabalho complexos com lógica de ramificação, pois você paga apenas pelos módulos executados. No entanto, as etapas de IA podem consumir vários créditos por execução, dependendo da sua complexidade.

Make’s pricing model and operational framework support scalability, from simple automations to enterprise-level workflows. The platform ensures data integrity with ACID transactions and offers tools for bulk data processing. It boasts a 99.9% infrastructure availability rate and average response times under 200ms for standard integrations. Examples of its scalability in action include:

__XLATE_23__

O chefe de operações da Teleclinic compartilhou: "O Make realmente nos ajudou a dimensionar nossas operações, eliminar o atrito de nossos processos, reduzir custos e aliviar nossa equipe de suporte".

__XLATE_25__

O COO da Shop Accelerator Martech comentou: "A Make impulsiona uma eficiência sem precedentes em nossos negócios de maneiras que nunca imaginamos. É ter um funcionário extra (ou 10) por uma fração do custo."

The upcoming Make Grid feature, set to launch in 2026, will act as a "Command Center", providing a visual overview of an organization’s entire automation ecosystem. This tool will help teams identify bottlenecks and monitor workflow performance in real time.

Make adheres to SOC 2 Type II, GDPR, and SCIM standards, offering Single Sign-On (SSO) and a secure connection manager that stores API keys securely instead of embedding them directly in workflows. The "Scenario Run Replay" feature allows users to replay failed executions with the original data, speeding up troubleshooting processes. Enterprise plans include advanced governance options and dedicated support, though some users have noted that the platform’s role-based access control (RBAC) is less detailed compared to other enterprise solutions. To minimize risks, critical modules should include manual error-handling configurations to prevent silent data loss during API disruptions. For organizations with strict compliance needs, redirecting execution data to an external logging service may be advisable, as Make’s native logs are retained only for a limited time based on the plan.

n8n se destaca como uma plataforma projetada pensando nos desenvolvedores, oferecendo opções hospedadas na nuvem e auto-hospedadas. Ele opera em um modelo de precificação baseado em execução, onde uma execução de fluxo de trabalho é igual a uma execução, não importa quantas etapas inclua. Isso o torna uma escolha prática para gerenciar fluxos de trabalho de IA complexos e de várias etapas, sem os custos mais elevados frequentemente associados à precificação baseada em tarefas.

n8n fornece integração nativa com LangChain, permitindo aos usuários criar sistemas avançados de IA multiagente e pipelines RAG (Retrieval-Augmented Generation) diretamente em seu editor visual. Com o AI Agent Node, os LLMs padrão podem ser transformados em agentes orientados por objetivos, capazes de usar ferramentas, tomar decisões e reter memória em fluxos de trabalho complexos. A plataforma suporta uma variedade de LLMs, incluindo OpenAI, Anthropic (Claude), Google Gemini, DeepSeek, Groq e Hugging Face, juntamente com integrações de banco de dados vetoriais como pgvector, Pinecone, Chroma, Qdrant e Weaviate. Seu AI Workflow Builder pode até converter descrições de linguagem natural em fluxos de trabalho funcionais automaticamente. Ao encadear solicitações de IA e usar modelos mais baratos para etapas intermediárias, os usuários podem reduzir os custos de API em 30-50%.

n8n’s execution-based pricing ensures affordability for even the most complex workflows. Technical users can access the self-hosted Community Edition for free, with unlimited workflows and executions. For cloud-hosted options, the Cloud Starter plan begins at $20/month for 2,500 executions, while Cloud Pro offers 10,000 executions for $50/month. For businesses, the self-hosted Business plan costs $800/month, offering advanced features, while Enterprise pricing is customized for organizations requiring features like advanced RBAC, SSO, and dedicated support. By charging per workflow execution instead of per step, n8n can save organizations over $500 per month on high-volume workflows compared to task-based pricing models.

n8n is built to handle up to 220 workflow executions per second per instance. Its Queue Mode leverages Redis to distribute execution across multiple worker processes, enabling horizontal scaling to meet increasing demands for fast and efficient AI workflows. For instance, in 2025, Dennis Zahrt, Director of Global IT Service Delivery at Delivery Hero, implemented a user management workflow that saved the company 200 hours each month. Similarly, Luka Pilic, Marketplace Tech Lead at StepStone, reported a dramatic improvement in efficiency, completing two weeks’ worth of API integration and data transformation work in just two hours.

__XLATE_29__

"Levo no máximo duas horas para conectar APIs e transformar os dados que precisamos. Você não pode fazer isso tão rápido no código." - Luka Pilic, líder de tecnologia do Marketplace, StepStone

A n8n prioriza a segurança integrando-se com gerenciadores de segredos externos, como AWS Secrets Manager, Azure Key Vault, Google Cloud Platform, HashiCorp Vault e Infisical, garantindo que credenciais confidenciais permaneçam fora da plataforma. Para usuários que optam por auto-hospedagem via Docker ou Kubernetes, todos os dados, credenciais e logs do fluxo de trabalho permanecem dentro de seu próprio firewall, apoiando a conformidade com regulamentações como HIPAA, GDPR e SOC 2. Os usuários corporativos se beneficiam do RBAC avançado por meio de "Projetos", que restringem o acesso a fluxos de trabalho e credenciais específicos com base em funções. Além disso, o controle de origem baseado em Git permite a movimentação segura de fluxos de trabalho entre ambientes de desenvolvimento, preparação e produção.

Gumloop é uma plataforma projetada especificamente para ajudar as equipes a aproveitarem grandes modelos de linguagem (LLMs) com facilidade. No centro deste sistema está o Gummie, um assistente de IA que converte instruções de linguagem natural em fluxos de trabalho totalmente funcionais. Esse recurso provou ser inestimável para as organizações. Fidji Simo, CEO da Instacart, compartilhou: “Gumloop tem sido fundamental para ajudar todas as equipes da Instacart – incluindo aquelas sem habilidades técnicas – a adotar IA e automatizar seus fluxos de trabalho, o que melhorou muito nossa eficiência operacional”.

Gumloop supports model-agnostic workflows, allowing users to switch seamlessly between models like GPT-4o, Claude 3.7 Sonnet, Deepseek V3 R1, and Gemini 2.5 Pro within a single automation. Unlike many platforms that require users to manage API keys separately, Gumloop simplifies the process by including LLM costs in its subscription plans. The AI Router node intelligently assigns tasks to the right models, while the Model Context Protocol (MCP) server enables connections to custom APIs, extending the platform’s capabilities beyond its 125+ built-in nodes. This setup ensures predictable pricing and smooth integration.

Gumloop’s pricing structure is designed for flexibility and clarity:

Ao agrupar os custos da API LLM em seus planos de assinatura, em vez de cobrar por tarefa, o Gumloop simplifica o orçamento, tornando mais fácil para as organizações dimensionarem seus fluxos de trabalho de IA sem despesas inesperadas.

Gumloop’s structure is designed to grow alongside organizations of any size. It uses a hierarchical approach, with Organizations providing centralized control and Workspaces enabling collaboration across departments like Sales, Marketing, and Operations. The platform also supports agentic workflows, where AI agents can assess tasks dynamically and trigger workflows based on context instead of following rigid sequences. Bryant Chou of Webflow remarked, "Gumloop wins time back across an org. It puts the tools into the hands of people who understand a task and lets them completely automate it away." Additionally, the platform’s ability to auto-scale and execute workflows in parallel ensures it can handle the demands of enterprise operations.

Gumloop prioriza segurança e conformidade para atender às necessidades organizacionais. Ele segue os padrões SOC 2 e GDPR e inclui ferramentas para controle de nível empresarial. Os administradores podem impor listas de permissões/negações de modelos de IA, garantindo a conformidade com regulamentações como HIPAA, restringindo determinados modelos ou provedores. O modo de navegação anônima aumenta a privacidade apagando todas as entradas, saídas e intermediários em tempo real. As políticas de segurança centralizadas são ainda apoiadas por credenciais de nível organizacional, que substituem as chaves pessoais ou do espaço de trabalho para impedir o acesso não autorizado. Para organizações que exigem segurança máxima, as implantações de VPC permitem que o Gumloop opere em sua própria infraestrutura de nuvem. O registro de auditoria abrangente rastreia todas as ações na plataforma, oferecendo uma visão transparente do fluxo de dados e das alterações administrativas por meio de um painel ou API.

Lindy.ai se destaca no cenário de automação por criar agentes de IA que pensam e se adaptam em vez de seguir scripts rígidos e predefinidos. Com sua abordagem inovadora de “vibe coding”, os usuários podem descrever o comportamento de um agente em inglês simples, e a plataforma rapidamente transforma isso em uma solução pronta para produção – às vezes em apenas 5 minutos. Isso permite que as empresas reduzam tarefas repetitivas implantando agentes equipados com memória e adaptabilidade.

A plataforma aproveita GPT e Claude para capacitar agentes capazes de analisar texto, gerar resultados e compreender a intenção do usuário. Ao contrário das ferramentas de automação tradicionais que vacilam quando confrontados com mudanças de contexto, os agentes Lindy.ai usam memória para navegar em cenários complexos, incluindo casos extremos que muitas vezes requerem intervenção humana. Com suporte para mais de 3.000 integrações nativas – e até mais de 7.000 em determinadas configurações – Lindy.ai se conecta perfeitamente com sistemas CRM, plataformas de e-mail e ferramentas de calendário. O CEO Flo Crivello destaca esta capacidade:

__XLATE_37__

Os fluxos de trabalho alimentados por IA podem lidar com esses casos extremos e se adaptar para manter a automação em funcionamento.

Seu recurso Autopilot aprimora a funcionalidade, fornecendo aos agentes seus próprios computadores baseados em nuvem, permitindo-lhes executar tarefas além das integrações típicas de API. Além disso, a coordenação multiagente permite que agentes especializados colaborem em processos de negócios complexos, preenchendo a lacuna entre a automação e a tomada de decisões em tempo real.

Lindy.ai oferece um modelo de preços baseado em tarefas, cobrando pela execução das tarefas e não por usuário, tornando-o uma escolha econômica para equipes com altas demandas de uso. Os níveis de preços incluem:

As cobranças adicionais incluem chamadas telefônicas de IA a 20 créditos por minuto e números de telefone de IA a US$ 10 por número por mês, oferecendo flexibilidade para tarefas especializadas.

Lindy.ai foi projetado para ser dimensionado sem esforço, acomodando usuários individuais e grandes empresas. As contas de equipe permitem o compartilhamento seguro e a implantação de agentes de IA entre departamentos, enquanto o recurso Agent Swarms permite que um único agente se clone e execute centenas de tarefas simultaneamente, como o gerenciamento de campanhas de divulgação personalizadas. Para fluxos de trabalho que exigem precisão, o recurso Human-in-the-Loop (HITL) permite que a IA lide com a maioria das tarefas, mas faz pausas para revisão humana em pontos críticos, tornando-o ideal para operações sensíveis em áreas como finanças, RH ou suporte ao cliente.

Lindy.ai prioriza segurança e conformidade, atendendo a padrões rigorosos como SOC 2, HIPAA, GDPR e PIPEDA. A plataforma inclui um Trust Center e ferramentas de gerenciamento secreto para atender aos requisitos de segurança de nível empresarial. Através das contas de equipe, as organizações podem configurar permissões e controles para garantir que os agentes operem de forma segura e previsível. Para prestadores de serviços de saúde, Lindy.ai oferece um anotador compatível com HIPAA feito sob medida para documentação médica, atendendo às necessidades exclusivas de setores regulamentados, como saúde e finanças.

StackAI fornece uma plataforma sem código que une grandes modelos de linguagem (LLMs) com dados corporativos por meio de uma tela visual 2D intuitiva. As equipes de negócios podem criar fluxos de trabalho facilmente usando ferramentas de arrastar e soltar, enquanto os desenvolvedores têm a flexibilidade de aprimorar esses fluxos de trabalho com nós Python para uma personalização mais profunda. Em 2025, Stefan Galluppi, CIO da LifeMD, usou StackAI para simplificar fluxos de trabalho intrincados de IA, demonstrando a eficácia da plataforma.

Este design fácil de usar oferece suporte à integração perfeita com os principais LLMs.

StackAI oferece suporte nativo aos principais LLMs, incluindo OpenAI, Anthropic (Claude), Mistral, Google, Meta, Azure OpenAI e modelos locais por meio de endpoints. Seu roteamento AI-Native introduz nós lógicos para tomada de decisão if/else e prompts dinâmicos, permitindo roteamento automatizado de tarefas com base em resultados LLM. Um nó integrado da Base de Conhecimento simplifica o processo de geração aumentada de recuperação (RAG), lidando com agrupamento, incorporação, indexação e recuperação com citações, cobrindo 90% dos casos de uso de RAG prontos para uso.

A plataforma também se destaca no processamento de dados não estruturados, oferecendo ferramentas para análise de PDF, web scraping e OCR. Isso transforma dados brutos em insights estruturados que podem ser implantados como chatbots, formulários web, processadores em lote para tarefas em massa ou APIs REST para integração de back-end. Por exemplo, no Martin Trust Center do MIT, Doug Williams, líder da geração de IA, criou assistentes de IA para estudantes em apenas algumas semanas, revolucionando sua experiência de aprendizagem sem exigir habilidades de codificação. Da mesma forma, Brian Hayt, Diretor de BI da Noblereach, reduziu o tempo necessário para gerar relatórios completos para bolsas e pesquisas competitivas de uma semana para apenas cinco minutos.

StackAI oferece uma estrutura de preços clara e flexível com três níveis: um plano gratuito para prototipagem em estágio inicial, um modelo SaaS baseado em uso para operações de escalonamento e um plano empresarial personalizado adaptado para implantações em grande escala, incluindo nuvem privada ou opções locais.

Esse preço flexível garante que StackAI possa oferecer suporte aos usuários em todas as fases, desde protótipos de pequena escala até aplicativos de nível empresarial.

A plataforma se adapta às necessidades individuais e empresariais, apresentando mais de 100 modelos pré-construídos para implantação rápida. As ferramentas de nível empresarial incluem SSO, proteção por senha, domínios personalizados e análises centralizadas para monitorar o uso e o desempenho do token. Os desenvolvedores podem expandir os fluxos de trabalho com código personalizado ou nós de API, enquanto os usuários não técnicos se beneficiam do construtor visual simples. Guillermo Rauch, CEO da Vercel, destaca sua acessibilidade:

__XLATE_51__

StackAI torna real a promessa dos agentes de IA. Para todos, em escala, bastando apontar e clicar.

Esse equilíbrio entre simplicidade e funcionalidade avançada torna StackAI uma ferramenta poderosa para organizações de todos os tamanhos.

StackAI prioriza a segurança com um modelo de governança de 8 camadas que inclui RBAC, controles em nível de pasta, controle de versão de projeto, SSO, conexões criptografadas, análise de produção e MFA. A plataforma está em conformidade com os padrões SOC 2 Tipo II, HIPAA e GDPR, com certificação ISO 27001 em andamento. Recursos como detecção e redação de PII, políticas de retenção de dados e um compromisso estrito de não usar dados de usuários para treinamento de modelos sob contratos empresariais garantem a privacidade dos dados. Para setores com requisitos rigorosos de residência de dados, como defesa e finanças, StackAI oferece suporte a implantações locais e em nuvem privada. Além disso, os fluxos de trabalho de aprovação manual garantem que nenhum agente de IA entre em operação sem a devida revisão.

Essa abordagem abrangente de governança e segurança faz do StackAI uma escolha confiável para organizações com altos padrões de conformidade e privacidade.

Pipedream is a platform designed with developers in mind, blending serverless infrastructure with AI-driven workflow automation. It’s trusted by over 1,000,000 developers, from small startups to Fortune 500 companies, handling billions of events and supporting data pipelines that process over 10,000,000 events per second. After being acquired by Workday in December 2025, Pipedream has strengthened its focus on enterprise-level stability and governance, giving developers more control and flexibility in automation. This foundation supports its advanced AI integration capabilities.

The platform’s code-centric design is a key feature, allowing developers to write custom Node.js, Python, Go, or Bash code directly within workflows. It also supports the use of any npm or PyPI package in a serverless environment. This flexibility makes it easier for developers to prototype quickly without the limitations often found in no-code platforms.

Pipedream incorpora ferramentas de IA como "Criar com IA", "Editar com IA" e "Depurar com IA" - desenvolvido por String.com - para ajudar os desenvolvedores a criar, modificar e solucionar problemas de fluxos de trabalho usando prompts de linguagem natural e correções automatizadas de erros.

The platform supports the Model Context Protocol (MCP), which includes a Docs MCP Server. This feature enables AI assistants like Claude and development environments such as VSCode to search Pipedream documentation and generate precise integration code. Pre-built actions are available for popular LLMs like OpenAI and Claude, handling tasks such as text classification, summarization, and embeddings. Developers can also write their own code to interact with any LLM API using Pipedream’s serverless environment.

Pipedream usa uma estrutura de preços baseada em créditos onde 1 crédito equivale a 30 segundos de tempo de computação.

Para empresas, preços personalizados estão disponíveis com recursos adicionais, como conformidade com HIPAA e registros de auditoria.

O Pipedream foi desenvolvido para escalabilidade, oferecendo recursos como memória ajustável, tempos limite personalizados, limites de taxa e gerenciamento de inicialização a frio. Ele oferece suporte a padrões orientados a eventos e acionadores em tempo real, tornando-o ideal para processamento de dados de alto volume e automação de back-end. Com mais de 3.000 integrações de aplicativos e gerenciamento de autenticação integrado, as equipes podem criar fluxos de trabalho complexos sem se preocupar com o manuseio manual de credenciais.

Para equipes de desenvolvedores, a plataforma oferece ferramentas como GitHub Sync, integração de VS Code e implantação de servidor MCP. As notas das etapas permitem que os desenvolvedores adicionem explicações baseadas em descontos diretamente às etapas do fluxo de trabalho, melhorando a comunicação e a documentação da equipe.

A Pipedream prioriza governança e segurança juntamente com desempenho. A plataforma tem certificação SOC 2 Tipo II, é compatível com HIPAA e atende aos padrões GDPR. Inclui um Acordo de Processamento de Dados (DPA) para gerenciamento de dados confidenciais. Os principais recursos de segurança incluem:

Para usuários corporativos, estão disponíveis opções adicionais como SAML SSO, SCIM para gerenciamento de identidade e autenticação de dois fatores (2FA). O registro de auditoria está incluído na camada Enterprise, fornecendo insights sobre execuções e alterações de fluxo de trabalho. Além disso, os gatilhos e ações disponíveis na fonte aumentam a transparência das análises de segurança.

Workato is a platform designed to handle complex, cross-departmental processes for enterprises. It’s trusted by over 2,000 brands, including Broadcom, Zendesk, and Atlassian, to manage workflows that require high uptime and strict governance.

A plataforma conta com o Workato Agentic & Genie Framework, que usa automação orientada por IA para ir além dos recursos básicos do chatbot. Esses agentes especializados de IA, chamados “Genies”, podem recuperar dados, desencadear ações em mais de 8.500 aplicativos e gerenciar processos dinâmicos. O AI Connector, desenvolvido em colaboração com a Anthropic e a OpenAI, aproveita modelos como o Sonnet 4 da Anthropic e o GPT-4o mini da OpenAI para tarefas como análise de texto, redação de e-mail, resumo e tradução.

At the heart of Workato’s AI capabilities is Workato Genie, which uses generative AI to interpret user intent, incorporate real-time enterprise data, and execute tasks autonomously. Bhaskar Roy, Chief of AI Products & Solutions at Workato, highlights its impact:

__XLATE_64__

“Com o Workato Agentic, as empresas agora podem construir e gerenciar rapidamente agentes de IA com low-code/no-code para aumentar a produtividade e impulsionar a eficiência operacional em toda a sua organização.”

Workato também inclui AIRO (AI Orchestrator), um assistente com tecnologia de IA que ajuda os usuários a criar e refinar fluxos de trabalho usando linguagem natural. As ações de IA pré-configuradas oferecem recursos LLM integrados, enquanto o Agent Studio encaminha decisões confidenciais para humanos por meio do Slack ou do Microsoft Teams para aprovação. Para espaços de trabalho do cliente, as ações do conector AI estão limitadas a 60 solicitações por minuto.

The platform offers pre-built applications known as Genie Apps, such as ITGenie for handling helpdesk tickets and SalesGenie to boost sales productivity. These Genies adapt based on user interactions, ensuring that learning remains specific to the customer’s environment to protect data privacy.

A integração de IA da Workato está associada à capacidade de escalabilidade eficaz em grandes organizações.

Workato’s workflows are designed to scale across enterprises and mid-sized businesses, connecting with over 8,500 apps, databases, and ERP systems. With orchestration patterns capable of managing more than 850 billion actions, the platform also supports Data Pipelines for high-volume replication to data warehouses like Snowflake and Databricks. These pipelines use parallel execution and automatic schema updates to handle large datasets efficiently.

Os modelos de decisão simplificam lógicas de negócios complexas, como preços dinâmicos ou pontuação de leads, armazenando regras em tabelas centralizadas fora de fluxos de trabalho individuais. Essa abordagem simplifica a auditoria e as atualizações. Enquanto isso, as Data Tables - uma atualização das Lookup Tables - armazenam conjuntos de dados significativamente maiores com funcionalidade de pesquisa avançada.

Workato’s global infrastructure supports local data residency with data centers in the EU, Australia, and Singapore. The platform is available in eight languages, including Japanese, Korean, and Spanish, and maintains a 99.9% uptime SLA for critical operations. It has been recognized as a Leader in the Gartner® Magic Quadrant™ for iPaaS seven times, with two instances of being positioned furthest in "Vision" as of 2025.

Para complementar sua escalabilidade, a Workato prioriza governança e segurança.

Workato’s Enterprise MCP Gateway serves as a secure control layer between AI tools and business systems, enforcing policies and ensuring visibility during runtime. AI agents operate under user-specific OAuth credentials, limiting access to authorized data. Additional safeguards include PII masking and de-identification within workflows.

Os administradores podem definir “habilidades confiáveis”, que são receitas ou conectores pré-aprovados que os agentes podem usar, evitando chamadas de API não autorizadas. O RBAC 2.0 garante permissões precisas no nível do projeto, evitando expansão desnecessária de funções. A plataforma também inclui medidas de segurança avançadas, como criptografia BYOK, rotação de chaves por hora e isolamento de contêineres com mTLS. As certificações incluem SOC 2 Tipo II, ISO 27001, PCI DSS e conformidade com GDPR.

Trilhas de auditoria em tempo real e aprovações humanas garantem a responsabilidade por todas as ações do agente. O recurso Avaliações e Aprovações simplifica a implantação de receitas em ambientes de desenvolvimento, teste e produção. Uma organização relatou processar solicitações de realocação de funcionários 98% mais rápido usando o Workato.

Workato segue um modelo de preços focado na empresa, sem taxas disponíveis publicamente. O preço é personalizado com base em fatores como o número de tarefas, o uso do conector avançado e o número de usuários. As pequenas empresas normalmente gastam de US$ 500 a US$ 3.000 por mês, as empresas de médio porte, de US$ 3.000 a US$ 10.000, e as grandes empresas geralmente excedem US$ 10.000 mensais para integrações e suporte personalizados. A plataforma foi projetada para organizações que exigem governança avançada e gerenciamento de processos complexos.

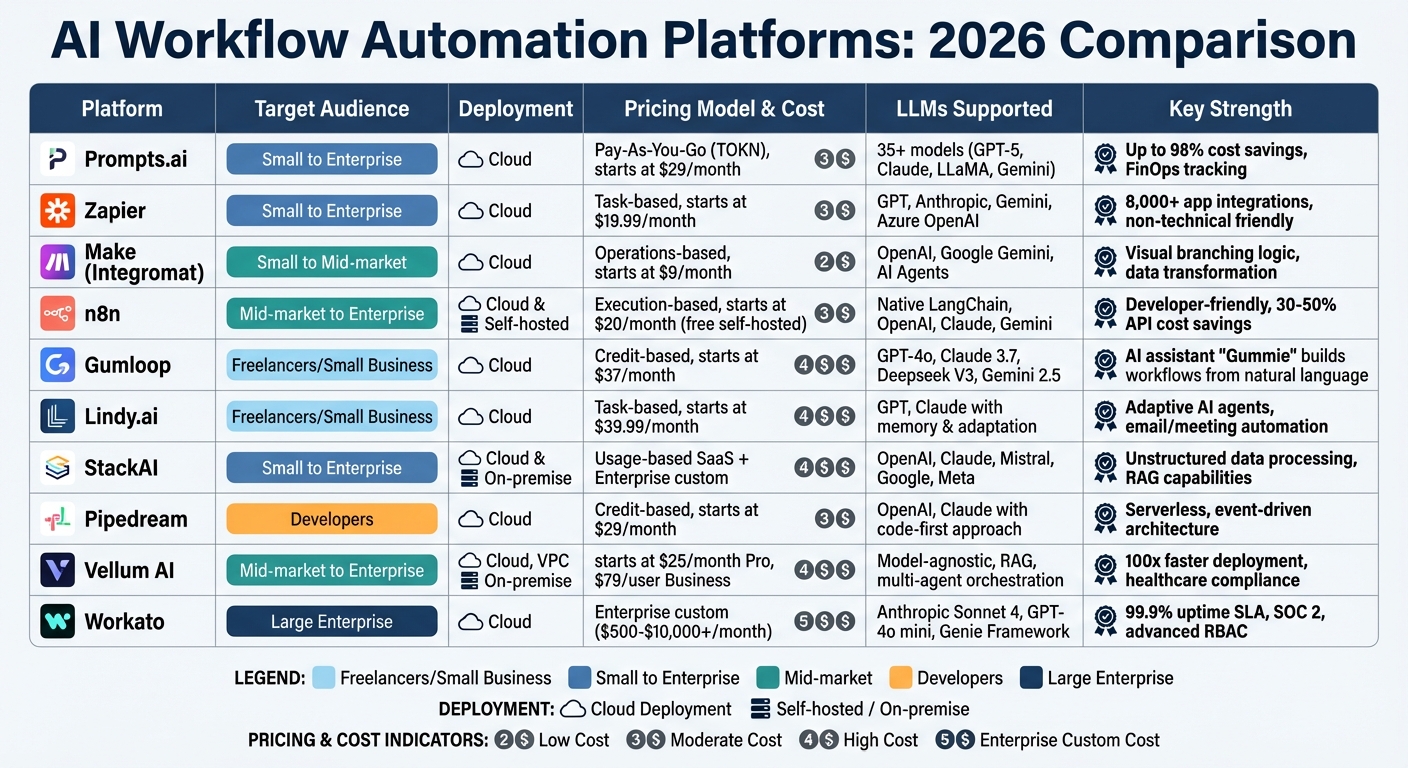

Comparação da plataforma de fluxo de trabalho de IA: recursos, preços e recursos Público Alvo 2026

Choosing the right AI workflow platform depends on your team’s size, technical expertise, budget, and governance requirements. To simplify the decision-making process, the table below provides a side-by-side comparison of key features across various platforms.

Esta comparação destaca como cada plataforma atende às necessidades específicas do negócio, equilibrando modelos de preços e flexibilidade de implantação. Por exemplo, o n8n oferece custos previsíveis e flexibilidade com sua opção gratuita de auto-hospedagem, tornando-o atraente para equipes técnicas. Por outro lado, plataformas como Zapier priorizam a facilidade de uso para usuários não técnicos, mas podem se tornar caras com grandes volumes de tarefas.

Ao considerar as opções de implantação, a privacidade dos dados é um fator chave. Ao contrário da maioria das plataformas somente em nuvem, o n8n permite auto-hospedagem, dando às equipes controle total sobre sua infraestrutura. Por outro lado, soluções empresariais como o Workato concentram-se em governança e conformidade avançadas, tornando-as ideais para gerenciar fluxos de trabalho sensíveis e de alto volume. Estas distinções garantem que as empresas possam alinhar as capacidades da plataforma com as suas prioridades operacionais.

Choosing the right AI workflow platform in 2026 requires aligning your team's technical skills with your organization’s scale and compliance needs. For non-technical teams, tools like Zapier or Lindy.ai offer intuitive, prompt-based environments. On the other hand, developer-heavy organizations often prefer platforms like n8n or Pipedream, which provide greater customization through code extensions. A key differentiator among these platforms is how they manage workflow maintenance, a theme that has been explored throughout this guide.

A evolução da automação básica para fluxos de trabalho autônomos de IA introduz novas demandas – tratamento da tomada de decisão semântica, geração aumentada de recuperação e orquestração multiagente. Como diz Nicolas Zeeb:

__XLATE_77__

O caminho a seguir em 2026 é dar um grande salto, de uma disciplina exclusiva para desenvolvedores de automação de IA para um esporte coletivo.

Esta mudança enfatiza a importância de plataformas que combinem flexibilidade técnica com recursos de governança, permitindo que engenheiros e especialistas no assunto colaborem de forma eficaz. Esses desafios destacam a importância das métricas de desempenho e da transparência operacional.

As plataformas prontas para produção se destacam por recursos como registro em tempo real, controle de versão e estruturas de preços claras. Com 95% dos pilotos de IA generativa não conseguindo entrar em produção devido a limitações de infraestrutura, ferramentas que apoiem a observabilidade e a previsibilidade de custos são essenciais. Muitas organizações alcançam resultados de nível de produção dentro de 2 a 6 semanas, começando com pilotos focados, incorporando o roteamento semântico desde o início e introduzindo testes de regressão na terceira semana.

Além das capacidades técnicas, a conformidade regulatória e de segurança é crucial para a adoção empresarial. Recursos como controle de acesso baseado em função (RBAC), conformidade com SOC 2, trilhas de auditoria e opções flexíveis de implantação garantem que as plataformas possam ser dimensionadas e, ao mesmo tempo, atender aos requisitos regulatórios. Conforme destacado anteriormente, plataformas como Prompts.ai e Workato integram efetivamente esses controles para atender às diversas necessidades empresariais.

Embora os agentes de IA possam contribuir com 450 mil milhões de dólares em valor até 2028, apenas 2% das organizações os adotaram totalmente. As plataformas discutidas neste guia fornecem a base para preencher essa lacuna, transformando experimentos isolados de IA em fluxos de trabalho escaláveis e mensuráveis que impulsionam a produtividade.

As plataformas de fluxo de trabalho de IA em 2026 trazem vantagens revolucionárias para empresas e profissionais. Eles simplificam a automação de tarefas complexas, melhoram a eficiência do fluxo de trabalho e centralizam o gerenciamento de vários modelos de IA. Esses recursos levam a grandes reduções de custos e a um aumento de até dez vezes na produtividade.

Além da eficiência, essas plataformas abordam questões urgentes como conformidade, segurança e o desafio de integração de múltiplas ferramentas. Ao unificar modelos de IA e automatizar processos de governança, garantem operações tranquilas. Eles também se integram facilmente a modelos avançados de linguagem de grande porte, permitindo que as organizações dimensionem suas operações de maneira eficaz, mantendo o controle e a supervisão de seus fluxos de trabalho de IA. Esta combinação de eficiência e supervisão torna estas plataformas essenciais para impulsionar a produtividade e manter elevados padrões operacionais.

Prompts.ai permite que as empresas cortem despesas e ao mesmo tempo permaneçam transparentes, oferecendo rastreamento de custos em tempo real e um modelo flexível de preços pré-pagos. Estas ferramentas permitem que as empresas acompanhem de perto os seus gastos e paguem apenas pelos recursos que utilizam ativamente, garantindo que as despesas permanecem previsíveis e adaptáveis.

Além disso, Prompts.ai enfatiza segurança e conformidade, apresentando padrões de conformidade SOC 2 Tipo II e HIPAA. Estas medidas ajudam a reduzir o risco de dispendiosos reveses regulamentares. Ao combinar o gerenciamento eficaz de custos com fortes proteções de conformidade, o Prompts.ai ajuda as organizações a otimizar seus fluxos de trabalho sem enfrentar obstáculos financeiros inesperados.

As plataformas de fluxo de trabalho de IA priorizam protocolos de segurança fortes para proteger informações confidenciais e atender às regulamentações do setor. As principais medidas incluem criptografia para proteger dados em trânsito e em repouso, controles de acesso baseados em funções para gerenciar permissões de usuários e conformidade com estruturas como SOC 2 e GDPR.

Muitas plataformas também oferecem recursos avançados, como detecção de ameaças em tempo real, gerenciamento seguro de chaves e certificações que validam seu foco na segurança. Essas ferramentas ajudam a reduzir riscos como acesso não autorizado, violações de dados e roubo de modelos de IA, permitindo que as empresas gerenciem com confiança fluxos de trabalho alimentados por IA.