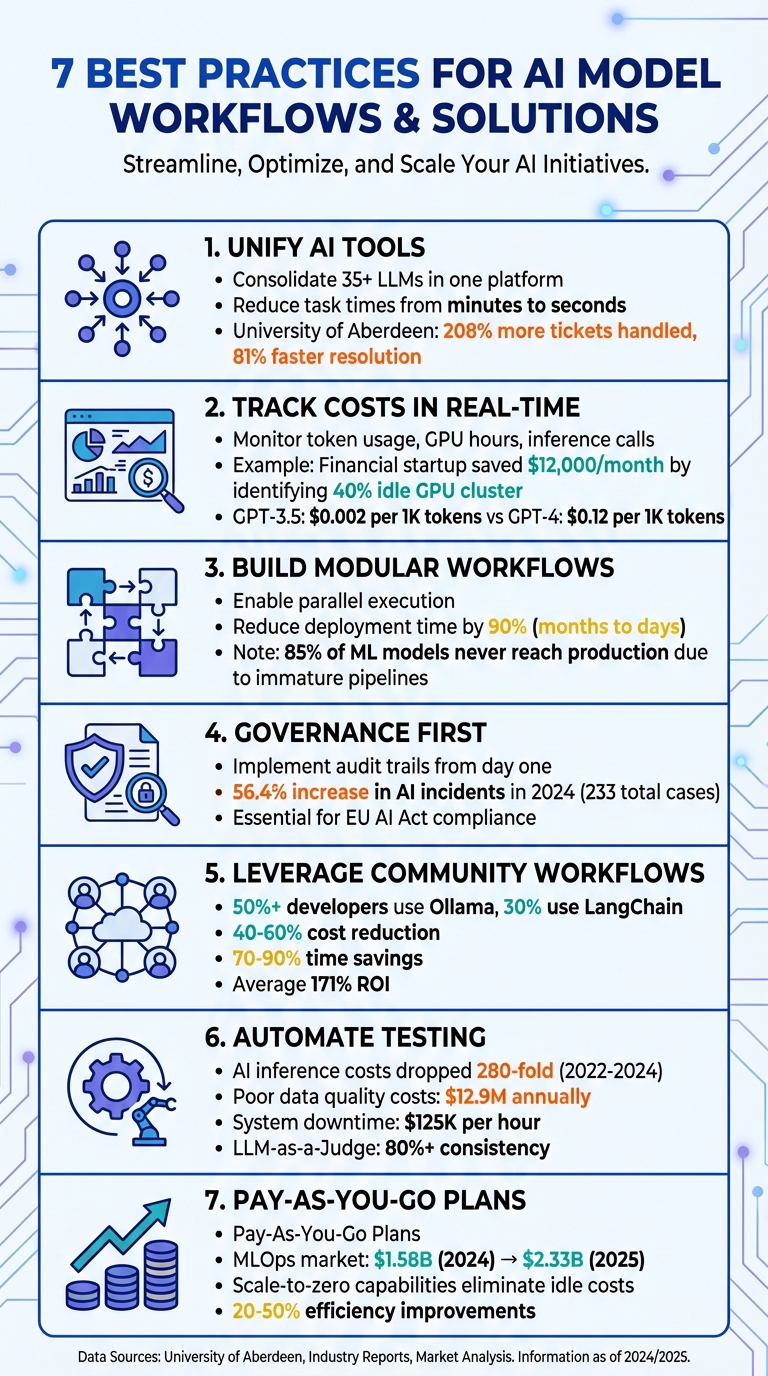

AI workflows in 2026 face challenges like fragmented tools, unchecked model drift, and escalating costs. To overcome these, organizations are adopting smarter, automated workflows that unify tools, improve governance, and optimize spending. Here’s how you can transform your AI operations:

이러한 관행은 워크플로를 간소화하고, 감독을 강화하며, 비용을 절감하여 조직이 책임감 있고 효율적으로 AI를 확장할 수 있도록 해줍니다.

__XLATE_1__

GPT-5, Claude, LLaMA, Gemini와 같은 모델에 대해 별도의 플랫폼을 관리하면 운영 속도가 느려지고 불필요한 장애물이 생길 수 있습니다. 35개 이상의 LLM을 하나의 인터페이스로 통합함으로써 Prompts.ai는 여러 로그인 및 자격 증명을 저글링하는 번거로움을 없애고 작업 시간을 몇 분에서 단 몇 초로 단축합니다.

이러한 종류의 통합은 측정 가능한 생산성 향상을 가져옵니다. 예를 들어, 애버딘 대학교(University of Aberdeen)가 2025년 9월 AI 기반 시스템을 채택했을 때 IT 팀은 해결 시간을 81% 단축하는 동시에 208% 더 많은 티켓을 처리할 수 있었습니다[1]. 이러한 결과는 간소화된 시스템을 통해 팀이 단편화된 도구를 관리하는 데 시간을 낭비하는 대신 결과에 집중할 수 있는 방법을 강조합니다. 이 접근 방식은 보다 효율적이고 안정적이며 비용 효과적인 AI 워크플로를 위한 길을 열어줍니다.

통합 인터페이스는 시간을 절약할 뿐만 아니라 더 큰 안정성과 유연성을 보장합니다. 단일 플랫폼에서 모든 모델에 액세스할 수 있으므로 팀은 엔진 간에 원활하게 전환하여 한 모델이 실패하거나 부정확한 결과를 제공하는 경우에도 연속성을 유지할 수 있습니다. 이러한 사전 예방적 설정은 자동화된 에이전트가 적절한 제어 없이 반복될 때 급증하는 클라우드 비용으로 이어질 수 있는 폭주 프로세스를 방지합니다.

또한 이 플랫폼은 병렬 성능 테스트를 지원하므로 특정 작업에 가장 적합한 모델을 평가할 수 있습니다. 예를 들어 고객 지원 쿼리는 하나의 LLM으로, 창의적인 프로젝트는 다른 LLM으로, 데이터 처리는 세 번째로 라우팅될 수 있으며 모두 동일한 대시보드에서 관리됩니다. 모델에 구애받지 않는 이 설계를 통해 단일 공급업체의 제한 사항이나 가격에 얽매이지 않고 자유롭게 성능과 비용을 최적화할 수 있습니다.

Prompts.ai는 모든 모델의 토큰 사용량에 대한 실시간 통찰력을 제공하여 비용 관리를 한 단계 더 발전시킵니다. 이러한 투명성은 예산 초과가 발생하기 전에 방지하는 데 도움이 됩니다. 내장된 FinOps 레이어는 즉각적인 수준에서 지출을 추적하므로 어떤 워크플로가 가치를 제공하고 어떤 워크플로가 리소스를 소모하는지 쉽게 식별할 수 있습니다. AI 워크플로우 자동화를 사용하는 조직은 지출을 비즈니스 결과에 연결할 수 있을 때 84%의 ROI를 보고했습니다. 예를 들어 Databricks는 깨끗한 데이터 모델과 투명한 비용 추적을 기반으로 하는 스마트 분류를 통해 지원 티켓을 23% 줄였습니다[1].

플랫폼의 종량제 TOKN 크레딧은 비용을 실제 사용량에 맞춰 조정하므로 사용하지 않은 용량에 대해 비용을 지불할 필요가 없습니다. 여러 모델의 비용을 통합함으로써 팀은 각 도구에 대해 별도의 구독을 유지하는 것에 비해 최대 98%를 절약할 수 있으며 프로젝트와 부서 전반에 걸쳐 상당한 비용 절감 효과를 얻을 수 있습니다.

Prompts.ai는 또한 거버넌스 및 규정 준수를 강화하여 규제 요구 사항과 워크플로 개선을 모두 지원하는 통합 감사 추적을 제공합니다. 플랫폼은 작업을 위험 계층으로 분류하여 AI 시스템이 완전히 신뢰할 수 있을 때까지 위험도가 높은 작업(예: 재앙적 잠재력이 있는 레벨 4 작업)이 인간의 감독하에 유지되도록 보장합니다.

엔드투엔드 암호화와 엄격한 액세스 제어를 통해 중요한 데이터는 잘못된 구성이나 위반으로부터 보호됩니다. 현재 조직의 78%가 비즈니스의 적어도 한 영역에서 AI를 사용하므로[2] Prompts.ai는 팀이 혁신하는 데 필요한 속도와 민첩성을 유지하면서 엔터프라이즈급 보안을 제공합니다. 모든 상호 작용은 안전하고 추적 가능하며 감사 가능하므로 조직은 AI를 책임감 있게 확장할 수 있다는 확신을 갖게 됩니다.

AI 워크로드는 월별 송장을 통해 완전히 이해할 수 없는 예측할 수 없는 비용으로 이어지는 경우가 많습니다. 실시간 FinOps는 비용 발생 시 즉각적인 통찰력을 제공함으로써 이러한 상황을 변화시킵니다. 토큰 사용량, GPU 시간 및 추론 호출을 거의 실시간으로 추적함으로써 팀은 예산 초과가 통제 불능 상태가 되기 전에 이를 식별하고 해결할 수 있습니다.

예를 들어, 한 금융 분석 스타트업은 8-GPU 클러스터의 40%가 유휴 상태로 매달 거의 12,000달러를 낭비한다는 사실을 발견했습니다. 실시간 모니터링을 통해 팀은 스프린트 중간에 이러한 비효율성을 식별하고 즉시 용량을 최적화하도록 조정했습니다.

팀, 프로젝트 또는 고객별로 세분화된 추적을 통해 지불 거절 모델을 더욱 구체화합니다. 고객 ID와 같은 메타데이터를 API 요청에 첨부하면 지출이 더욱 투명해집니다. 이를 통해 부서는 사용한 만큼만 비용을 지불함으로써 확장 가능하고 비용 효율적인 운영을 위한 기반을 마련할 수 있습니다.

Real-time tracking doesn’t just monitor costs - it actively supports smarter scaling decisions. Autoscaling can now factor in both performance metrics (like latency) and financial data (such as cost per prediction). For example, during traffic spikes, systems can throttle or reroute requests based on cost signals, ensuring resources are used efficiently.

__XLATE_13__

StreamForge AI는 Kubecost를 Prometheus와 통합하고 5분마다 새로 고쳐지는 Grafana 대시보드에 사용 데이터를 표시하는 방식으로 2025년 9월에 이 전략을 채택했습니다. p95 대기 시간과 요청당 비용 지표의 균형을 맞추는 이중 신호 자동 크기 조정 접근 방식을 사용하여 GPU 활용도를 크게 높이고 300개 이상의 일일 훈련 작업의 비용 효율성을 개선했습니다. 이러한 실시간 접근 방식은 월예산을 고갈시킬 수 있는 비용이 많이 드는 잘못된 구성을 방지하는 데 도움이 됩니다.

Centralizing cost tracking across multiple AI providers is essential when managing diverse models. A unified AI gateway simplifies this process by consolidating token usage, latency, and cost data into a single, reliable source. Whether you’re using OpenAI, Anthropic, or self-hosted models, this centralized system eliminates the need to piece together fragmented billing data.

다양한 모델의 가격대가 크게 다르기 때문에 이러한 통합 수준은 매우 중요합니다. 예를 들어, GPT-3.5-Turbo의 비용은 토큰 1,000개당 약 $0.002인 반면, GPT-4는 컨텍스트 창에 따라 토큰 1,000개당 최대 $0.12까지 올라갈 수 있습니다. 실시간 추적을 통해 팀은 이러한 비용을 비교하고 작업을 가장 경제적인 모델로 라우팅할 수 있습니다. 간단한 고객 쿼리를 처리하든 복잡한 분석을 처리하든 실시간 비용 데이터를 기반으로 작업이 올바른 모델에 할당되므로 워크플로가 효율적이고 예산 친화적으로 유지됩니다.

AI 워크플로를 모듈식 구성 요소로 나누면 배포 및 확장 방식이 혁신됩니다. 모든 단계를 처리하기 위해 견고한 단일 파이프라인에 의존하는 대신 모듈식 접근 방식을 통해 전체 시스템을 중단하지 않고 개별 부품을 업데이트하거나 교체할 수 있습니다.

이 디자인은 또한 여러 작업이 동시에 실행될 수 있는 병렬 실행을 가능하게 합니다. 예를 들어, 다국어 번역 서비스는 다양한 언어 버전을 차례로 처리하는 것이 아니라 동시에 처리할 수 있어 처리 시간을 크게 단축할 수 있습니다. MLOps 방식을 채택하면 배포 속도가 더욱 빨라지고 모델을 프로덕션으로 전환하는 데 걸리는 시간이 최대 90% 단축됩니다. 자동화된 파이프라인은 배포 일정을 몇 개월에서 단 며칠로 단축할 수 있습니다.

또 다른 장점은 재생성입니다. 사후 처리와 같은 특정 단계에서 문제가 발생하는 경우 전체 워크플로를 다시 실행하는 대신 저장된 아티팩트를 사용하여 해당 모듈만 다시 실행할 수 있습니다. 이러한 목표 재실행 접근 방식은 특히 상당한 컴퓨팅 성능이 필요한 작업의 경우 시간과 리소스를 모두 절약합니다. 또한 모듈식 워크플로를 통해 시스템 전반에 걸쳐 구성 요소를 보다 쉽게 표준화하고 안전하게 통합할 수 있습니다.

모듈식 기반이 마련되면 구성 요소 간의 원활한 통신을 보장하는 것이 필수적입니다. 입력 및 출력 형식을 표준화하면 계단식 오류를 방지하는 데 도움이 됩니다. 예를 들어, 데이터 수집 모듈이 추론 모듈의 예상 입력과 완벽하게 일치하는 명확하게 정의된 JSON 파일을 출력하는 경우 잠재적인 잘못된 의사소통이 제거됩니다.

AI 로직과 정책 로직을 분리하면 유지 관리성이 더욱 향상됩니다. 이를 통해 AWS Prescriptive Guidance에 강조된 대로 고정된 비즈니스 규칙과 별도로 동적 모델 동작을 관리할 수 있습니다. Docker 또는 Kubernetes와 같은 도구는 모듈을 컨테이너화하여 다양한 환경에서 이식성을 유지할 수 있습니다. 컨테이너화된 모듈은 개발, 스테이징 및 프로덕션 과정에서 일관되게 작동할 수 있으며 변경 없이 클라우드 공급자 간에 전환할 수도 있습니다. 오케스트레이션을 위해 AWS Step Functions는 내장된 재시도를 통해 서버리스 조정을 제공하고, Apache Airflow는 더 복잡한 워크플로를 관리하기 위한 Python 기반 유연성을 제공합니다.

모듈식 설계는 각 작업에 적합한 리소스를 할당함으로써 재정적 이점도 제공합니다. 리소스 집약적인 복잡한 추론 모델은 까다로운 분석을 위해 예약될 수 있으며, 간단한 작업은 저렴한 모델로 처리됩니다. 이를 통해 컴퓨팅 리소스를 현명하게 사용할 수 있습니다.

모듈 수준에서 메타데이터를 추적하면 투명성이 향상됩니다. 파이프라인을 통해 이동하는 각 아티팩트에 타임스탬프, 모델 버전, 비용 데이터 등의 세부 정보를 첨부함으로써 팀은 명확한 감사 추적을 얻을 수 있습니다. 이는 디버깅뿐만 아니라 재무 추적에도 도움이 됩니다. 비용을 모듈별 지표에 맞춰 조정하면 유연성을 유지하면서 정확한 예산을 책정할 수 있습니다. 또한 배치 크기 및 동시성에 대한 제한을 설정하면 수요가 많은 기간 동안 예상치 못한 비용을 방지하는 데 도움이 될 수 있습니다.

It’s worth noting that about 85% of machine-learning models never make it to production, often due to immature pipeline structures. Modular, iterative workflows offer a way to overcome this challenge. Teams can start small, validate one module at a time, and gradually scale up, reducing risks and ensuring systems are ready for production.

처음부터 거버넌스를 AI 워크플로우에 통합하면 비용이 많이 드는 조정을 피할 수 있습니다. 앞서 설명한 자동화된 평가와 투명성을 바탕으로 처음부터 프로세스에 규정 준수가 적용되도록 할 수 있습니다. 모델이나 사용 사례가 생성되자마자 워크플로 도구에서 추적 티켓을 생성하세요. 초기 위험 수준을 할당합니다. 신용 평가 또는 채용 시스템과 같은 고위험 애플리케이션은 내부에서 사용되는 저위험 도구에 비해 더 엄격한 승인 프로세스와 면밀한 모니터링을 요구합니다. 이러한 적극적인 "왼쪽 이동"은 접근 방식을 사용하면 특히 교육 및 평가 프로세스에 대한 자세한 문서화를 요구하는 EU AI Act와 같은 프레임워크를 통해 규제 요구 사항에 대비할 수 있습니다.

규정 준수의 초석은 다음과 같습니다. 계보 추적이는 원시 데이터에서 최종 모델 출력까지 명확하고 재현 가능한 경로를 제공합니다. 계보 추적과 결합 스냅샷 추적성, 배포 전에 코드, 데이터 및 구성의 정확한 상태가 보존되도록 합니다. 이를 통해 필요에 따라 모든 모델 버전을 재현할 수 있습니다. 업계 연구에서는 2024년에 AI 관련 사고가 56.4% 증가하여 총 233건에 달해 강력한 감사 추적의 필요성을 강조하면서 이러한 조치의 시급성을 강조했습니다.

감사 추적은 오류를 원본에 직접 연결하여 문제 해결을 간소화합니다. 엔지니어는 로그를 수동으로 선별하는 대신 계보 추적을 사용하여 파이프라인이 중단되거나 데이터 품질이 저하된 위치를 신속하게 식별할 수 있습니다. 자산 확인 및 위험 평가와 같은 거버넌스 작업을 자동화하면 규정 준수를 보장할 뿐만 아니라 AI 이니셔티브가 성장함에 따라 효율적으로 움직일 수 있습니다. 이러한 단계를 자동화하면 승인 시간을 줄이고 작업 전반에 걸쳐 일관성을 유지할 수 있습니다.

고품질 데이터를 유지하려면 강력한 데이터 거버넌스가 필수적입니다. 중앙 집중식 메타데이터 관리는 모든 AI 자산에 대한 정보를 한 곳에 통합하여 중복을 제거하고 원활한 운영을 보장합니다. 프롬프트부터 모델 버전까지 모든 구성 요소가 타임스탬프 및 비용 세부 정보와 함께 추적되면 팀은 포괄적인 실행 내역. 이를 통해 파이프라인을 더 쉽게 재현하고 개선할 수 있습니다. 자동화된 감사 로그는 인적 오류를 더욱 줄여 안정적이고 반복 가능한 워크플로를 구축합니다.

이러한 거버넌스 전략은 모듈식 워크플로와 원활하게 통합되어 시스템 확장에 따라 규정 준수가 시스템의 핵심 부분으로 유지되도록 보장합니다.

통합 거버넌스 계층은 간소화된 워크플로와 비용 투명성을 결합하여 전반적인 규정 준수를 보장합니다. Snowflake, Databricks, 클라우드 플랫폼, 엣지 환경 등 많은 시스템이 여러 플랫폼에서 작동합니다. 통합 거버넌스 접근 방식이 없으면 모델이 감독 없이 배포되어 규정 준수 확인이 불가능해지는 "그림자 AI"가 발생할 위험이 있습니다. 시스템 간 추적성 쿼리, 노트북, 작업 및 대시보드 전체에서 런타임 데이터 계보를 캡처하여 플랫폼 간에 데이터가 이동할 때 규정 준수를 유지합니다. 중앙 집중식 게이트웨이가 있는 MCP(모델 컨텍스트 프로토콜)와 같은 표준화된 인터페이스를 사용하면 서버와 테넌트 전체에서 일관된 로깅 및 요청 추적이 가능합니다. 이를 통해 작업이 어디에서 이루어지든 완벽한 감사 추적이 가능합니다.

처음부터 워크플로를 만드는 것은 시간이 많이 걸리고 비효율적일 수 있습니다. 다음과 같은 커뮤니티 중심 프레임워크 랭체인 그리고 올라마 프롬프트 연결 및 도구 통합을 위해 사전 구축된 템플릿을 제공하는 인기 솔루션이 되었습니다. 이러한 프레임워크는 널리 채택되어 개발자의 50% 이상이 Ollama를 사용하고 거의 1/3은 LangChain을 사용하여 AI 에이전트를 관리합니다. 깨지기 쉬운 사용자 지정 코드를 독립적으로 작동하는 유연한 서버리스 기능으로 대체하여 관리 및 확장이 더 쉬워집니다.

주요 이점은 복잡하지 않은 확장성. 커뮤니티에서 테스트한 패턴을 사용하면 오케스트레이션 논리를 정밀 검사하지 않고도 GPT에서 Amazon Bedrock으로 이동하는 등 모델을 전환할 수 있습니다. 이러한 유연성은 일관성을 유지하면서 배포 속도를 높여줍니다. 연구에 따르면 오케스트레이션은 많은 조직에서 우선 순위이지만 이를 완전히 구현한 조직은 소수에 불과합니다. 커뮤니티 워크플로는 다양한 AI 플랫폼 간의 원활한 통합을 가능하게 하는 실용적인 솔루션을 제공합니다.

커뮤니티 워크플로는 플랫폼 전반에 걸쳐 AI 도구를 통합하는 문제도 해결합니다. 와 같은 표준 모델 컨텍스트 프로토콜(MCP) 플랫폼의 무질서한 확장 문제를 해결합니다. 임원의 63%. 이러한 프로토콜을 사용하면 AI 에이전트와 도구가 수동으로 데이터를 입력하지 않고도 Gmail, Slack, CRM과 같은 플랫폼에서 함께 작동할 수 있습니다. 예를 들어 "Gmail에서 보낸 최근 10개 이메일 요약"과 같은 간단한 자연어 요청이 있습니다. - 사전 구성된 API 연결을 통해 구조화된 작업을 트리거할 수 있습니다.

__XLATE_52__

상호 운용성은 매우 중요합니다. IT 리더의 87% AI 기반 시스템을 채택하는 데 필수적이라고 식별합니다. 커뮤니티 워크플로는 복원력을 염두에 두고 설계되어 잠재적인 모델 오류를 처리하기 위한 자동화된 재시도, 시간 초과 및 병렬 실행과 같은 기능을 제공합니다. 이러한 안전 장치는 특히 중요합니다. 개발자의 87%가 AI 정확도에 대해 걱정합니다., 그리고 81%는 보안과 개인 정보 보호에 대해 우려하고 있습니다.. 통합 개선 외에도 이러한 워크플로는 비용을 크게 절감하는 데도 도움이 됩니다.

커뮤니티 템플릿을 사용하여 자연어 프롬프트를 자동화된 워크플로로 변환하면 비용과 시간을 대폭 절감할 수 있습니다. 조직 보고서 40-60% 비용 절감 그리고 70-90% 시간 절약 이러한 워크플로우를 통해 AI 자동화를 채택할 때. 테스트된 솔루션으로 시작하면 값비싼 시행착오 프로세스가 필요하지 않습니다.

또한 이러한 워크플로우는 표준화된 감사 추적 및 메타데이터 추적을 통합하여 투명성을 향상시킵니다. 데이터 소스, 권한, 상담원 결정 내역과 같은 세부정보를 자동으로 기록합니다. 다수는 다음을 포함합니다 인간 참여형 민감하거나 비용이 많이 드는 작업을 수동으로 검토하기 위한 체크포인트를 제공하여 가장 중요한 부분에 대한 감독을 보장합니다. 확장 중 추론 비용을 관리함으로써 기업은 평균적인 171% ROI 커뮤니티 구축 워크플로를 활용할 때.

테스트 및 평가 자동화는 원활한 AI 수명주기를 만드는 마지막 부분입니다. 이는 종종 모델이 생산에 도달하지 못하게 하는 수동 테스트로 인한 지연을 제거합니다. 프로세스 비효율성으로 인해 모델의 85%가 배포에 실패합니다. 자동화된 CI/CD/CT(지속적 교육) 파이프라인을 활용하면 배포 시간이 몇 달에서 며칠로 단축됩니다. 이러한 파이프라인은 성능 지표가 설정된 임계값 아래로 떨어지거나 새로운 데이터를 사용할 수 있게 되면 자동으로 모델을 재교육할 수 있으므로 지속적인 수동 감독이 필요하지 않습니다.

재정적 이점은 분명합니다. 2022년에서 2024년 사이에 AI 추론 비용이 280배 감소하여 지속적인 모니터링과 재교육이 실용적인 옵션이 되었습니다. 또한 자동화된 파이프라인은 문제를 조기에 파악하여 비용이 많이 드는 오류를 방지하는 데 도움이 됩니다. 예를 들어, 열악한 데이터 품질로 인해 기업은 연간 1,290만 달러의 비용을 지출할 수 있으며, 계획되지 않은 시스템 가동 중지 시간은 시간당 125,000달러에 달할 수 있습니다. 스키마 불일치, Null 값 또는 분포 이동 식별과 같은 자동화된 데이터 검증 단계는 수집 단계에서 문제가 해결되도록 보장하여 더 큰 문제를 예방합니다.

자동화는 작업 흐름을 가속화할 뿐만 아니라 불필요한 비용도 줄여줍니다. 자체 조정 파이프라인은 필요한 경우에만 재교육이 이루어지도록 보장하여 유휴 기간 동안 값비싼 GPU 리소스의 사용을 줄입니다. LLM-as-a-Judge와 같은 도구는 평가 프로세스를 간소화하고 비용을 절감하는 동시에 수천 번의 테스트에서 80% 이상의 일관성을 유지합니다.

테스트 전략을 통해 예산을 더욱 최적화할 수 있습니다. Dev Proxy와 같은 도구를 사용하여 테스트를 시뮬레이션하면 호출당 비용을 발생시키지 않고 엔드포인트에 대한 스트레스 테스트를 수행할 수 있습니다. 더 작은 모델과 대표적인 데이터 세트로 시작하면 본격적인 평가를 시작하기 전에 아이디어를 검증하는 데 도움이 됩니다. 또한 프로젝트, 팀 또는 모델 버전별로 클라우드 리소스에 태그를 지정하면 자세한 청구 통찰력을 얻을 수 있어 투자 가치가 있는 워크플로를 더 쉽게 결정할 수 있습니다.

또한 자동화된 테스트는 규제 기관에서 요구하는 감사 추적을 생성하여 거버넌스를 강화합니다. 거버넌스 게이트는 스키마 및 기준 데이터와 같은 중요한 자산이 검증될 때까지 워크플로를 일시 중지합니다. 각 모델 스냅샷은 표준 위험 평가를 거쳐 결과가 자동으로 기록되고 추적을 위해 오류로 인해 발생하는 티켓이 발행됩니다.

자동화는 세 가지 주요 드리프트 유형을 모니터링할 수 있습니다. 데이터 드리프트 (입력 분포의 변화), 성능 드리프트 (정확도가 떨어지거나 응답 시간이 느려짐) 안전 드리프트 (민감한 정보의 독성 또는 노출 증가) 경고는 이러한 문제를 조기에 표시하여 최종 사용자에게 영향을 미치지 않도록 합니다. 또한 킬 스위치를 사용하면 팀은 사고 발생 시 문제가 있는 모델 경로나 기능을 신속하게 비활성화할 수 있으며, 가장 중요한 순간에 시스템을 제어 상태로 유지하는 거버넌스에 대한 실질적인 접근 방식을 보여줍니다.

종량제 계획은 팀이 쉽게 성장하고 적응할 수 있도록 지원하면서 AI 비용을 관리하는 현명한 방법입니다. 이러한 계획은 리소스가 효율적으로 사용되도록 보장하기 위해 비용 추적 및 모듈식 확장성과 같은 전략을 기반으로 합니다.

With pay-as-you-go pricing, you’re only charged for the tokens and compute time you actually use. Real-time dashboards provide insights into token consumption, latencies, and outcomes, helping to pinpoint inefficiencies and eliminate unnecessary spending. When combined with scale-to-zero capabilities, this model becomes even more effective - idle inference endpoints automatically shut down, so you’re not paying for unused GPU resources.

For tasks that aren’t time-sensitive, such as exploratory data analysis or offline model training, spot pricing offers a lower-cost alternative to on-demand rates. These savings add up, especially when paired with tools that track usage and performance in real time, allowing teams to fine-tune their compute needs and stay within budget.

Elastic compute ensures that your workflows can adapt to changing demands without manual adjustments. Features like autoscaling node pools and serverless architectures handle fluctuating workloads seamlessly, so there’s no need to overprovision resources for peak usage. By separating model artifacts from application code and using cloud storage, pods can start up almost instantly, making scaling operations faster and more efficient.

This approach is particularly valuable when transitioning from pilot projects to full-scale production. As the global MLOps market grows - expected to rise from $1.58 billion in 2024 to $2.33 billion by 2025 - organizations need scalable systems that won’t require constant rebuilding. Pay-as-you-go plans align costs with actual usage, making it easier to expand models, users, or teams without driving up expenses.

종량제 계획은 고급 팀 도구와 함께 작동하여 비용 관리 및 운영 워크플로를 간소화합니다. 최신 도구는 SSO(Single Sign-On) 및 RBAC(역할 기반 액세스 제어)와 같은 거버넌스, 감사 추적 및 보안 기능을 오케스트레이션 계층에 직접 통합합니다. 이러한 기능은 SOC 2 또는 ISO 27001과 같은 규정 준수 요구 사항을 충족하는 데 필수적입니다.

OpenAI 호환 API를 지원하는 플랫폼을 사용하면 팀은 워크플로를 정밀 검사하지 않고도 LLM 제공업체나 모델 간에 전환할 수 있어 새로운 기술이 등장할 때 유연성을 보장할 수 있습니다. 관리형 환경은 권한, SLA, 중앙 집중식 메타데이터 추적, 권한 부여 제어와 같은 기능을 통합하여 팀 운영을 더욱 향상시킵니다. 이러한 시스템은 조직과 함께 확장될 뿐만 아니라 규제 표준을 충족하는 데 필요한 투명성과 통제력을 유지하여 모든 팀원이 올바른 액세스 권한을 갖고 감사를 위해 모든 작업이 기록되도록 보장합니다.

효과적인 AI 워크플로우를 구축하려면 체계적이고 확장 가능한 접근 방식과 결합된 강력한 모델이 필요합니다. 앞서 논의한 7가지 사례는 분리된 AI 이니셔티브를 간소화된 엔터프라이즈급 프로세스로 전환하는 데 도움이 됩니다. 다양한 LLM을 통합하고 지속적인 비용 모니터링을 유지하며 모듈식 설계를 활용함으로써 병목 현상을 제거하고 필요에 따라 발전하는 워크플로를 만들 수 있습니다. 거버넌스부터 시작하면 모든 AI 결정이 추적 가능하고 규정을 준수하도록 보장하는 동시에 커뮤니티 중심 프롬프트와 자동화된 테스트 주기를 통해 품질 저하 없이 개발 속도를 높일 수 있습니다. 이러한 전략은 효율적이고 안정적인 AI 운영의 중추를 형성합니다.

앞에서 강조한 것처럼 이러한 방법은 온보딩 및 사고 관리와 같은 워크플로 전반에서 효율성을 20%~50% 향상할 수 있습니다. 종량제 모델과 결합된 실시간 비용 추적은 지출을 사용량에 맞춰 유지하고 예산 초과를 방지하는 동시에 원활한 확장을 지원합니다. 자동화와 피드백 루프를 통합함으로써 AI 시스템은 자체 최적화, 이상 징후 식별, 개선 제안, 복잡한 작업을 자율적으로 관리할 수 있습니다.

통합 거버넌스와 적응형 아키텍처로의 전환은 견고한 기반 위에 워크플로를 구축하는 것의 중요성을 강조합니다. 표준화된 도구, 명확한 구성 요소 경계 및 상세한 추적을 통해 새로운 모델과 기능이 등장하더라도 시스템의 유연성을 유지할 수 있습니다. 확장 가능하고 반복 가능한 프로세스에 집중함으로써 지속적인 점검 없이 파일럿 프로젝트에서 본격적인 생산으로 전환할 수 있습니다.

이러한 전략은 단편적인 실험을 효율적이고 책임 있고 비용에 민감한 워크플로우로 전환합니다. AI 워크플로를 제어할 준비가 되셨나요? Prompts.ai를 사용하면 모델을 보호하고 비용을 관리하며 손쉽게 확장할 수 있습니다. 35개가 넘는 상위 모델에 액세스하고, 내장된 FinOps 제어 기능을 활용하고, 엔터프라이즈급 거버넌스를 구현하는 등 이 모든 것이 단일 인터페이스 내에서 가능합니다. Prompts.ai는 도구의 무분별한 확장을 제거하고 규정 준수를 보장하며 팀이 혁신에 집중할 수 있도록 하여 AI 혼란을 간소화된 ROI 중심 운영으로 전환합니다.

가장 적합한 LLM(대형 언어 모델)을 선택하려면 글쓰기, 코딩, 고객 지원 또는 기타 애플리케이션 등 특정 요구 사항을 명확하게 식별하는 것부터 시작하십시오. 성능, 비용, 개인 정보 보호와 같은 요소를 고려하는 구조화된 접근 방식을 사용하여 모델을 평가합니다. 위험이 최소화된 작업의 경우 더 빠르고 예산 친화적인 모델의 우선순위를 지정하세요. 반면에 위험도가 높은 작업에는 보다 신뢰할 수 있고 적절한 감독이 포함된 모델이 필요합니다. 벤치마킹은 선택한 모델이 작업 요구 사항과 운영 목표를 모두 충족하는지 확인하는 중요한 단계입니다.

AI 비용을 통제하려면 모니터링이 필수적입니다. 토큰 사용 일어나는 대로. 여기에는 요청, 프롬프트 및 모델 호출 추적이 포함됩니다. 이러한 지표를 파악함으로써 비효율성을 파악하고 조정하여 리소스 사용을 최적화하고 비용과 성능 간의 균형을 유지할 수 있습니다.

모델 드리프트보다 앞서 나가려면 성능 지표와 데이터 품질을 실시간으로 면밀히 관찰하는 자동화된 모니터링 시스템을 설정하세요. 이러한 도구는 데이터 분포 및 예측 정확도의 변화를 조사하여 개념 표류, 공변량 이동 또는 레이블 표류와 같은 변화를 찾아낼 수 있습니다. 드리프트가 감지되면 사전 정의된 재학습 트리거가 시작되어 모델을 신속하게 업데이트하고 MLOps 프로세스 내에서 일관된 검증과 원활한 통합을 유지할 수 있습니다.