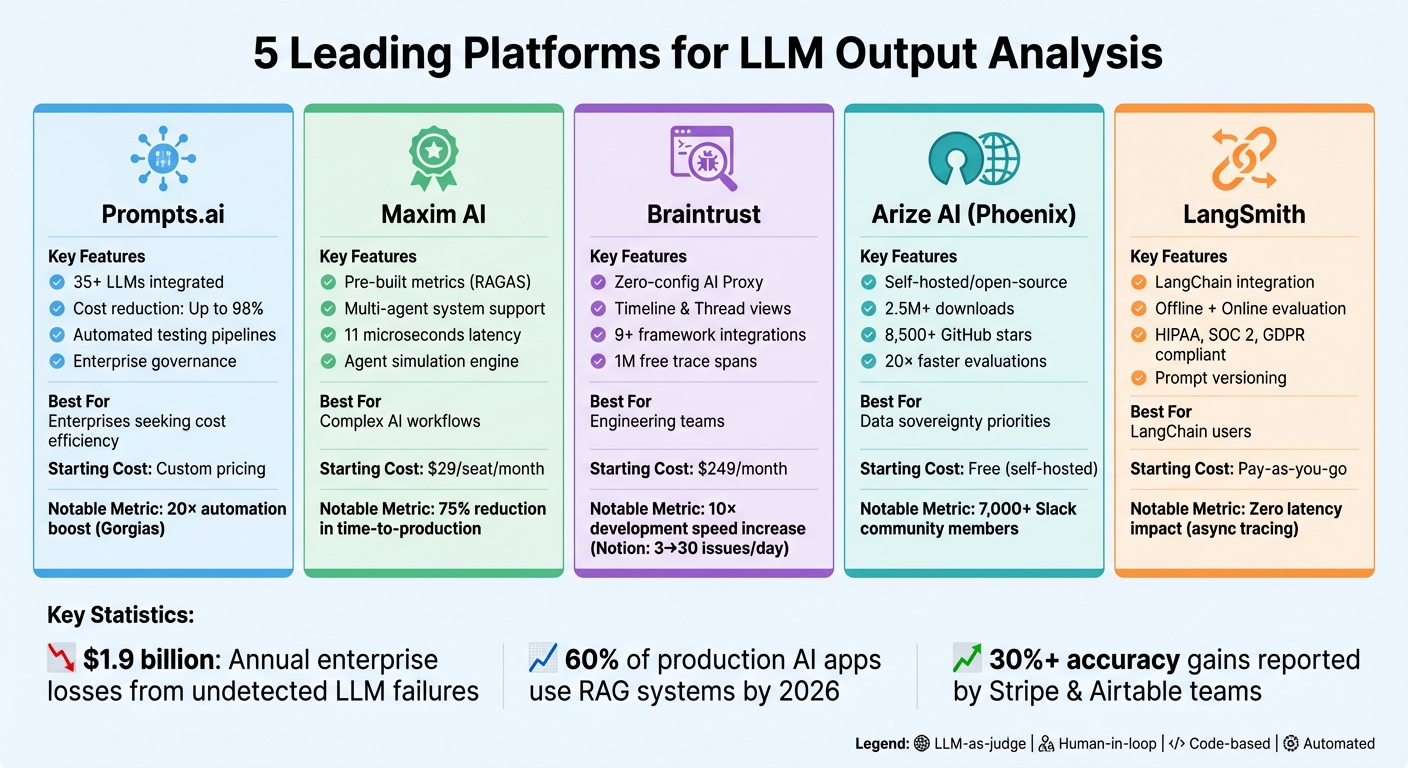

大規模言語モデル (LLM) は強力ですが予測不可能で、一貫性のない出力やコストのかかる出力が生成されることがよくあります。これらの課題に取り組むために、組織は評価、監視、コスト管理のための専用ツールに依存しています。この記事で紹介するのは 5つのプラットフォーム LLM 出力分析を合理化します。

各プラットフォームは、精度の向上からコスト削減、コンプライアンスの確保に至るまで、LLM ワークフローの固有の側面に対応します。

| プラットフォーム | 主な特長 | 最適な用途 | 開始コスト |

|---|---|---|---|

| プロンプト.ai | 一元化された LLM アクセス、コスト削減の FinOps ツール | コスト効率を求める企業 | カスタム価格設定 |

| マキシムAI | 事前構築されたメトリクス、マルチエージェント システムのサポート | 複雑な AI ワークフローを管理するチーム | $29/シート/月 |

| ブレイントラスト | デバッグツール、マルチターン会話テスト | エンジニアリングチーム | $249/月 |

| アライズAI | オープンソースの詳細な追跡、幻覚チェック | データ管理を優先する組織 | 無料(自己ホスト型) |

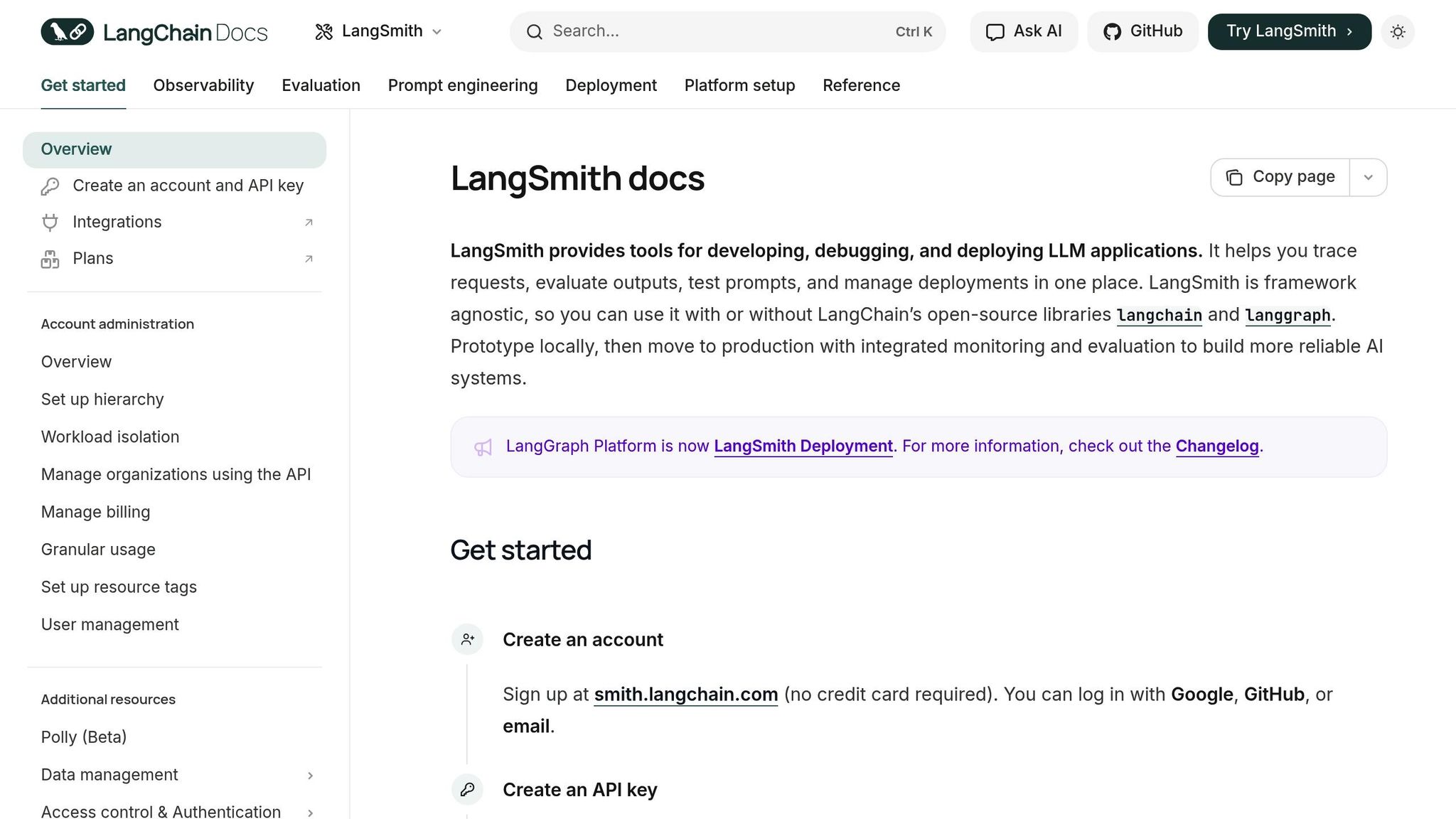

| ラング・スミス | LangChain の統合、プロンプト バージョニング | ラングチェーンユーザー | 従量課金制 |

これらのプラットフォームは LLM 管理を簡素化し、スケーラブルで信頼性が高く、コスト効率の高い AI 運用を保証します。

__XLATE_5__

Prompts.ai brings together 35+ top-tier LLMs - including GPT‑5, Claude, LLaMA, and Gemini - into one unified platform designed for enterprise-level prompt engineering and detailed output analysis. It simplifies evaluation with automated testing pipelines.

Prompts.ai は、プロンプト データセットに対して 20 を超えるテストを実行できる評価パイプラインを備えています。これらには、LLM アサーション (AI を使用して出力を評価する)、コサイン類似度による意味的類似性チェック、完全一致評価、正規表現ベースのパターン マッチングなどの方法が含まれます。チームは、ユーザーフレンドリーなダッシュボードを通じて人間参加型の評価を組み込むこともでき、分野の専門家が人間のフィードバックからの強化学習の一環として出力を手動で評価できるようになります。

For instance, Gorgias, a customer support platform, used Prompts.ai to scale its AI-powered helpdesk to support millions of shoppers. This led to a 20× boost in automation. Their ML engineers and support teams run daily regression tests on backtest datasets to catch potential issues before deployment.

これらの厳格なテスト機能により、現在のワークフローへのスムーズな統合が保証されます。

Prompts.ai’s evaluation pipelines seamlessly integrate with CI/CD workflows and enable backtesting against historical production data. The platform supports connections through external HTTP endpoints, custom Python/JavaScript scripts, and Model Context Protocol (MCP) actions.

言語学習アプリの Speak は、これらの自動化機能を活用して、数か月にわたるカリキュラム開発をわずか 1 週間に凝縮しました。この効率性により、10 の新しい市場で AI 主導の機能を同時にリリースできるようになりました。

Prompts.ai は、モデルを並べて比較するビューを提供することで、チームのコストの最適化にも役立ちます。これらの比較により、ユーザーは API コスト、レイテンシ、品質スコアの間のトレードオフを比較検討できます。チームは出力を要約したり、中間タスクに小規模で高速なモデルを使用してトークンの使用量を削減したりできます。米国の学区の 60% にサービスを提供している NoRedInk は、これらのコスト削減機能を使用して、教師レベルの品質を維持しながら、100 万人を超える生徒の成績に関する AI 生成のフィードバックを提供しています。

Prompts.ai は、LLM 出力を改良するためのツールをすべての関係者に提供することでコラボレーションを強化します。コード不要のビジュアル エディターを使用すると、技術者以外のユーザーでもエンジニアに頼ることなくプロンプトを編集およびテストできます。一元化されたプロンプト レジストリにより、効率的なバージョン管理が保証されます。

たとえば、ParentLab では、非技術分野の専門家が 700 のプロンプト改訂を管理できるようにすることで、わずか 6 か月で 400 を超えるエンジニアリング時間を節約しました。

__XLATE_12____XLATE_13__

また、このプラットフォームはユーザー評価を収集してパフォーマンス スコアに変換し、継続的なフィードバック ループを作成して、すべての統合モデルにわたる出力品質を向上させます。

Maxim AIは詳細なテストおよび監視ツールを提供し、機械による評価と人間のフィードバックを組み合わせて、複雑なAIワークフローを管理するチームをサポートします。その機能は、強力な LLM パフォーマンスを維持するために重要な徹底的な評価を保証するように設計されています。

Maxim AIは、決定論的テスト、統計的手法、自動判断ツールを含む堅牢な評価フレームワークを使用します。の 評価ストア は、2026 年までに実稼働 AI アプリケーションの約 60% の主要コンポーネントとなる検索拡張生成システム向けに調整された RAGAS などの事前構築済みメトリクスを提供します。 ノードレベルのメトリクス help identify failures in retrieval and generation processes. The platform’s エージェントシミュレーション このエンジンにより、導入前評価のための複数ターンの会話テストとユーザー ペルソナの作成が可能になります。 Clinc や Mindtickle などの企業は、これらの品質基準を採用することで生産までの時間が 75% 短縮されたと報告しています。

Maxim AI’s evaluation tools integrate effortlessly with today’s development environments. It supports SDKs in Python, TypeScript, Java, and Go, while offering compatibility with platforms like LangChain, LangGraph, Crew AI, OpenAI, Anthropic, Mistral, and AWS Bedrock. The platform also adheres to オープンテレメトリー 分散トレーシングの標準に準拠し、Slack や PagerDuty などのツールと接続してリアルタイム アラートを実現します。エンタープライズ ユーザーは、SOC2、HIPAA、GDPR のコンプライアンス要件をすべて満たす、クラウドおよび VPC 内ホスティングを含む展開オプションの恩恵を受けます。

の Bifrost LLM ゲートウェイ セマンティック キャッシュを使用して経費を削減すると同時に、トークンの使用状況と API コストを監視して高価なワークフローを特定して対処します。これにより、生産規模の拡大に応じて効率的な運用が保証されます。

Maxim AI’s コード不要の UI プロダクト マネージャーとデザイナーがプロンプトを試し、独立して評価を実施できるようにします。 Rise Science のプロダクト リードである Kellie Maloney 氏は次のように述べています。

__XLATE_29__

このプラットフォームには、人間参加型レビュー用の注釈キュー、バージョン管理を備えた集中型プロンプト CMS、SAML/SSO サポートを備えた RBAC も含まれています。これらのコラボレーション ツールを活用するチームは、出荷速度の 5 倍の向上を達成し、イテレーションを合理化し、生産展開をスピードアップしました。

Braintrust は、オフラインの実験とオンラインのスコアリングを組み合わせて、チームが開発から導入まで LLM のパフォーマンスを完全に把握できるようにします。

Braintrust は、出力品質を 0 から 1 のスケールで評価する複数の方法を提供します。チームは、事実性や類似性のチェックなどのタスクに自動スコアラーを使用したり、LLM による審査員としての評価に依存したり、特定のニーズに合わせたカスタム コード ロジックを実装したりできます。プラットフォームには以下が含まれます タイムラインビュー ガント チャートを使用してボトルネックを特定し、 スレッドビュー マルチターン会話のデバッグ用、およびサンドボックス化された React コンポーネントとして表示される自然言語駆動のトレース視覚化用。また、入力ごとに複数のトライアルを実行することもサポートされており、チームが差異を測定し、一貫性を維持するのに役立ちます。

Braintrust は、主要な AI フレームワークとスムーズに統合し、ネイティブ サポートを提供します。 9 個以上の主要なフレームワーク、OpenTelemetry、Vercel AI SDK、OpenAI Agent SDK、Instructor、LangChain、LangGraph、Google ADK、Mastra、Pydantic AI など。 「ラップ」を使用します。統合のためのアプローチ - 例としては、 ラップAISDK Vercel AI SDK (バージョン v3 から v6 ベータ版をカバー) および ラップオープンナイ インストラクター向け。プラットフォームは準拠しています OpenTelemetry GenAI のセマンティック規則、トークンの使用状況やモデル識別子などの詳細を Braintrust フィールドに自動的にマッピングします。 OpenAI、Anthropic、Google Gemini などの主要な LLM プロバイダーとシームレスに連携します。開発者は、 Eval() 関数または CLI を使用して - 時計 開発中にファイルが更新されるたびに評価を自動的に再実行するフラグを設定します。

Braintrust は、組み込みツールを使用してチームのコラボレーションを促進することで、評価を超えたものになります。その 双方向同期 プロダクト マネージャーとエンジニアがコードと UI の間でプロンプトを互換的に作業できるようにします。の 遊び場 チームがプロンプトをテストし、モデルを並べて比較し、迅速な反復のために構成を共有できるノーコード スペースを提供します。専用の注釈ツールを使用すると、チームは人間参加型のフィードバックを提供し、トレースやモデル出力にラベルや修正を直接追加できます。外部のアノテーターを招待して、さまざまなモデル バージョンにわたる品質を評価することができます。また、共有された評価バックログによってデータセットとスコアリング ルーブリックが集中化され、手動でスプレッドシートを追跡する必要がなくなります。

Arize AI の Phoenix は、チームに大規模言語モデル (LLM) の評価を包括的に制御できるように設計されたオープンソース プラットフォームです。 OpenTelemetry を中核として構築された Phoenix は、250 万回以上のダウンロードと 8,500 個以上の GitHub スターを獲得して注目を集めています。 LLM ワークフローのすべてのステップを追跡する詳細なトレースを提供し、問題が発生した場所を特定しやすくします。

フェニックスが採用しているのは、 裁判官としてのLLM このアプローチでは、OpenAI、Anthropic、Gemini の基盤モデルを使用して、関連性、毒性、全体的なパフォーマンスなどの要素について他の LLM アプリケーションを評価します。これには、検索拡張生成 (RAG) や関数呼び出しなどの一般的なタスク用に事前に構築されたエバリュエーターが付属しています。際立った特徴は、 説明力、評価モデルはスコアの背後にある明確な根拠を提供し、開発者が各評価の背後にあるロジックを理解するのに役立ちます。追加ツールには、決定論的なコードベースのチェック、インターフェイス内での直接の人による注釈、および データセットのクラスタリング 埋め込みを使用して、意味的に類似した質問と回答を視覚的にグループ化します。このクラスタリングは、モデルのパフォーマンスが低下している領域を分離するのに役立ちます。

__XLATE_63__

これらの評価ツールは、プラットフォームのより広範な開発エコシステムとシームレスに統合されます。

Phoenix は、LlamaIndex、LangChain、DSPy、Mastra、Vercel AI SDK などの一般的なフレームワークの自動インスツルメンテーションをサポートしています。 Python、TypeScript、Java で動作し、OpenTelemetry ネイティブの設計により、ユーザーを特定のベンダーに固定することなく、既存の可観測性ツールとの互換性が保証されます。チームは、Ragas、Deepeval、Cleanlab などのサードパーティ ライブラリからの評価を組み込むこともでき、ワークフロー全体に柔軟性を提供します。

Phoenix は効率性を重視して構築されており、 最大 20 倍高速な評価実行 並行性とバッチ処理を通じて。そのプロンプト プレイグラウンドは、チームがプロンプトを調整し、展開前にモデル バリアントを並べて比較できるテスト環境を提供し、コストのかかる本番環境でのミスのリスクを軽減します。

完全にオープンソースで自己ホスト可能なプラットフォームとして、フェニックスはチームがデータを完全に制御できるようにします。のような機能 人間による注釈キュー グラウンド トゥルース ラベルをトレースに直接追加できるようになり、より良いコラボレーションが促進されます。の プロンプトハブ 迅速なバージョニング、ストレージ、環境全体の展開を管理します。 スパンチャット このツールを使用すると、チームは特定のワークフロー セグメントを評価および議論して、パフォーマンスの問題を明らかにできます。 7,000 人を超えるメンバーからなる Slack コミュニティにより、ユーザーはネットワークにアクセスしてトラブルシューティングを行ったり、洞察を共有したりできます。

__XLATE_76__

LangSmith は、LangChain の有無にかかわらずシームレスに動作するように設計された多用途のプラットフォームであり、あらゆる LLM スタックに適応できます。 OpenAI、Anthropic、CrewAI、Vercel AI SDK、Pydantic AI などのツールと簡単に接続できるため、すでに特定のフレームワークを使用しているチームに柔軟性を提供します。このプラットフォームは、HIPAA、SOC 2 Type 2、GDPR などのコンプライアンス標準を満たしており、非同期プロセスを使用してトレースを送信するため、エンド ユーザーに遅延が追加されることはありません。

ラングスミスのオファー 2つの評価モード さまざまなニーズに合わせて: 開発中に厳選されたデータセットをテストするためのオフライン評価と、実際の運用トラフィックを監視するためのオンライン評価。次の 4 種類のエバリュエーターをサポートします。

プラットフォームには、次のような高度な分析ツールが含まれています。 差分ビュー、モデルの出力と参考テキストの違い、およびパフォーマンス ベンチマークのための並べての比較を強調表示します。また、 メタデータのグループ化、対象領域やユーザー タイプなどのカテゴリごとに、精度やコストなどの指標を分析できるようになります。 LangSmith はオープンソースと統合します オープンエバルス パッケージでは、正確さと簡潔さを評価するための事前構築されたエバリュエーターが提供されます。

これらの機能により、LangSmith を既存のワークフローや開発ツールに簡単に統合できます。

LangSmith は、 @traceable 入力と出力を自動的にキャプチャするデコレータまたはクライアント ラッパー。 Python および TypeScript/JavaScript SDK、REST API、pytest、Vitest、Jest などのテスト フレームワークとの統合をサポートしているため、評価を CI/CD パイプラインに簡単に埋め込むことができます。さらに、OpenTelemetry の統合により、チームは既存の可観測性パイプラインから直接 LangSmith にトレースを送信できるようになります。

LangSmith は、直感的なフィードバックと注釈ツールを使用してチームのコラボレーションを強化します。 注釈キュー 特定の実行を対象分野の専門家に自動的にルーティングし、カスタム基準に基づいて手動レビューとスコアリングを行うことができます。の プロンプトハブ チームがプロンプトを繰り返し、バージョン付けし、共有するための集中スペースとして機能し、開発全体で一貫性を維持するための変更追跡機能とロールバック機能を備えています。インライン注釈機能により、チームメンバーは問題にフラグを立てたり、応答品質に関する的を絞ったフィードバックを提供したりできるため、評価の精度とワークフローの効率の両方が向上します。

このプラットフォームは、詳細なユーザー管理とワークロードの分離も提供し、チーム間のスムーズなコラボレーションを保証します。ユーザーは smith.langchain.com で無料でサインアップできます。クレジット カードは必要ありません。運用環境での使用については、LangSmith は従量課金制で動作し、AWS、GCP、または Azure の Kubernetes クラスターでセルフホスティングできるエンタープライズ プランを利用できます。

LLM 評価用のプラットフォームを評価する場合は、技術的な互換性、コスト、評価方法を考慮することが重要です。ここでオプションを詳しく見てみましょう。

プロンプト.ai は 35 以上の主要なモデルを 1 つの安全なインターフェイスにまとめ、AI ソフトウェアのコストを最大 98% 削減できる FinOps 制御を提供します。 ブレイントラスト 構成ゼロの AI プロキシによりセットアップが簡素化され、単一のベース URL を介してログがキャプチャされます。これには 100 万のトレース スパンが無料で含まれており、有料プランは月額 249 ドルから始まります。 マキシムAI 既存の可観測性スタックとシームレスに統合し、完全なトレースよりも品質スコアリングに重点を置きます。月額最大 10,000 ログの無料プランと、1 シートあたり月額 29 ドルからの有料プランを提供します。 アライズフェニックス データプライバシーのためのセルフホスティングをサポートし、RAGAS や Giskard などのツールと統合してより詳細なメトリクス分析を実現します。 ラング・スミス エンタープライズ サポートの価格は異なりますが、LangChain ユーザー向けに調整されており、高度な可観測性を提供します。特に、Notion は Braintrust によって開発速度が 10 倍向上し、毎日 3 件の問題の解決が 30 件に増加しました。

各プラットフォームの独自のアプローチにより、特定の評価ニーズに基づいた意思決定が簡素化されます。評価方法、統合、展開の点での比較は次のとおりです。

統合の複雑さも重要な役割を果たします。 Braintrust のプロキシベースのセットアップは簡単です。API ベース URL を更新するだけです。 Maxim AIは既存の可観測性ツールと統合され、LangSmithの緊密なLangChain統合は特殊な可観測性のニーズに応えます。 Arize Phoenix は、データ主権を優先する組織を代表する企業であり、セルフホスト型のオープンソース ソリューションを提供しています。一方、Prompts.ai は、安全な運用のためのエンタープライズ グレードのガバナンス制御と完全な監査証跡を提供します。

__XLATE_111__

迅速な洞察を得るために、プロキシベースの展開と緊密な統合によりプロセスが合理化されます。 LangChain ユーザーは LangSmith が自然に適していると感じるでしょうが、機密データを管理する組織は、堅牢なガバナンスと監査機能を求めて Arize Phoenix や Prompts.ai などのオープンソース ソリューションを好む可能性があります。

提供された評価に基づいて、各プラットフォームは LLM 出力分析を改良するための明確な利点を提供します。 プロンプト.ai は、堅牢なガバナンスと監査機能を確保しながら、AI コストを最大 98% 削減できる FinOps 制御と組み合わせて、企業に主要なモデルへの一元的なアクセスを提供します。 ブレイントラスト はペースの速いエンジニアリング チーム向けに調整されており、Notion のような企業は開発速度が 10 倍向上し、問題解決が 1 日あたり 3 件から 30 件に向上したと報告しています。同様に、Stripe と Airtable のチームは、プラットフォームの採用から数週間以内に 30% 以上の精度の向上を観察しました。

LangChain エコシステムに深く統合されているユーザーにとっては、 ラング・スミス 簡単な統合と高速プロトタイピング オプションを提供します。 マキシムAI は、複雑なマルチエージェント システムの管理に重点を置くチームに対応し、高精度のスコアリング ツールと、1 秒あたり 5,000 リクエストの量でわずか 11 マイクロ秒のオーバーヘッドを導入する低遅延ゲートウェイを提供します。その間、 アライズフェニックス は、データ主権を優先する組織に最適で、既存の可観測性システムにシームレスに適合するセルフホスト型のオープンソース ソリューションを提供します。

各プラットフォームは、LLM のパフォーマンスとコスト管理における重要な課題に対処します。企業は潜在的な損失に直面しているため、 年間19億ドル 本番環境では LLM 障害が検出されないため、信頼性と効率を確保するには、主観的な評価を超えて、測定可能なデータ駆動型のメトリクスに移行する必要性が不可欠になっています。

これらのツールは、LLM 開発を構造化されたエンジニアリング分野に高めます。毎月何兆ものイベントを処理すること、チーム間のコラボレーションを合理化すること、またはセルフホスト型インフラストラクチャの制御を維持することのいずれに焦点を当てているかにかかわらず、適切なプラットフォームを選択することで、LLM ワークフローが目標を達成するために必要な信頼性、品質、費用対効果を確実に達成できます。

これらのプラットフォームは、大規模言語モデル (LLM) の使用を監視および微調整するツールを提供することで、組織が AI 費用を削減できるように設計されています。たとえば、Prompts.ai のようなソリューションを使用すると、ユーザーはトークンの使用状況をリアルタイムで追跡できるため、不必要なトークンの消費を見つけて削減することが容易になります。これにより、過剰な API 呼び出しによる過剰な支出が回避され、コスト管理が向上します。

これらのプラットフォームは、コスト管理を超えて、パフォーマンスと出力品質に関する貴重な洞察も提供します。これらは、高価なやり直しにつながる可能性がある幻覚やエラーなどの問題を検出して防止するのに役立ちます。使用傾向を分析し、非効率性を特定することで、組織はワークフローを合理化し、運用コストを削減し、一貫した高品質の結果を保証できます。これらすべてが、AI 予算を効果的に管理するための、よりスマートなデータ主導の意思決定をサポートします。

LLM プラットフォームは、ツールやワークフローとシームレスに接続するためのさまざまな方法を提供し、さまざまなニーズに応えます。多くのプラットフォームは、LangChain や LangServe などのフレームワークとともに、Python や JavaScript などの SDK を介したネイティブ統合をサポートしています。これにより、カスタム アプリケーションへの LLM の埋め込みが簡単かつ効率的になります。監視に関しては、プラットフォームは OpenTelemetry などのオープン標準をサポートしていることが多く、既存のインフラストラクチャとの互換性が確保されています。

一部のプラットフォームは、GitHub Actions や Jenkins などの CI/CD ツールとも統合されており、テストとデプロイのプロセスが簡素化されます。環境の制御を優先する組織の場合は、データ セキュリティを維持しながらカスタマイズできるセルフホスティング オプションが利用可能です。これらの統合機能により、ユーザーは効率を高め、パフォーマンスを効果的に監視し、運用内で LLM を安全に実装できるようになります。

を重視する人にとっては、 データのプライバシーと管理, オンプレミス.LLM 優れたソリューションを提供します。プライバシーに配慮したタスク向けに特別に設計されたこのプラットフォームにより、大規模言語モデル (LLM) がオフライン設定で機密データまたは制限付きデータを安全に処理できるようになります。完全にローカルでの実行を可能にすることで、データ漏洩の可能性が大幅に低減されると同時に、必要に応じてハイブリッド設定のためのオプションのクラウド統合も提供されます。

OnPrem.LLM は、直感的なコード不要のインターフェイスにより、データ管理の完全な監視を維持しながら、技術的な専門知識を持たないユーザーでもアクセシビリティを保証します。そのため、情報の保護が最優先事項である規制産業や機密性の高い業界の組織にとって、理想的な選択肢となります。