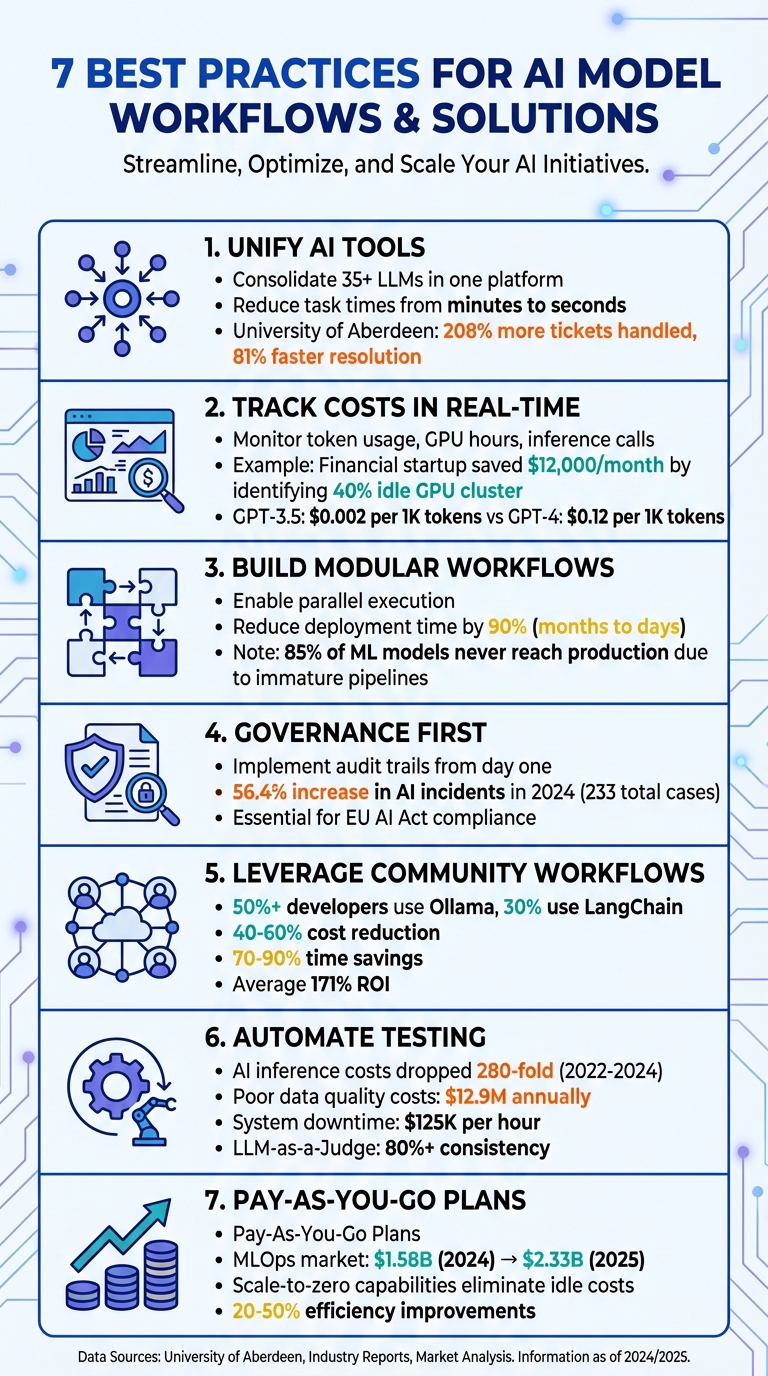

AI workflows in 2026 face challenges like fragmented tools, unchecked model drift, and escalating costs. To overcome these, organizations are adopting smarter, automated workflows that unify tools, improve governance, and optimize spending. Here’s how you can transform your AI operations:

これらの実践により、ワークフローが合理化され、監視が強化され、コストが削減され、組織が責任を持って効率的に AI を拡張できるようになります。

__XLATE_1__

GPT-5、Claude、LLaMA、Gemini などのモデルの個別のプラットフォームを管理すると、操作が遅くなり、不必要なハードルが生じる可能性があります。 Prompts.ai は、35 を超える LLM を 1 つのインターフェイスに統合することで、複数のログインと認証情報をやりくりする煩わしさを排除し、作業時間を数分からわずか数秒に短縮します。

この種の統合により、目に見える生産性の向上がもたらされます。たとえば、アバディーン大学が 2025 年 9 月に AI を活用したシステムを導入したとき、IT チームは解決時間を 81% 短縮しながら、208% 多くのチケットを処理することに成功しました [1]。このような結果は、合理化されたシステムにより、チームが断片化されたツールの管理に時間を浪費するのではなく、成果に集中できることを浮き彫りにしています。このアプローチにより、より効率的で信頼性が高く、コスト効率の高い AI ワークフローへの道が開かれます。

統一されたインターフェースは時間を節約するだけでなく、より高い信頼性と柔軟性を保証します。単一のプラットフォームからすべてのモデルにアクセスできるため、チームはエンジンをシームレスに切り替えることができ、1 つのモデルに障害が発生したり不正確な結果が得られた場合でも継続性を維持できます。このプロアクティブなセットアップにより、自動化されたエージェントが適切な制御なしでループした場合にクラウド コストの高騰につながる可能性がある暴走プロセスを防ぎます。

このプラットフォームでは並列パフォーマンス テストも可能であるため、どのモデルが特定のタスクに最適かを評価できます。たとえば、カスタマー サポートのクエリは 1 つの LLM にルーティングされ、クリエイティブ プロジェクトは別の LLM にルーティングされ、データ処理は 3 番目の LLM にルーティングされ、すべて同じダッシュボードから管理されます。このモデルに依存しない設計により、単一ベンダーの制限や価格設定に縛られることがなくなり、パフォーマンスとコストを自由に最適化できます。

Prompts.ai は、すべてのモデルにわたるトークンの使用状況に関するリアルタイムの洞察を提供することで、コスト管理を次のレベルに引き上げます。この透明性により、予算超過を事前に防ぐことができます。組み込みの FinOps レイヤーは支出をプロンプト レベルで追跡し、どのワークフローが価値をもたらし、どのワークフローがリソースを浪費するかを簡単に特定できるようにします。 AI ワークフロー自動化を使用している組織は、支出を業績に結び付けることができた場合、84% の ROI を報告しています。たとえば、Databricks は、クリーンなデータ モデルと透明性のあるコスト追跡を活用したスマート トリアージにより、サポート チケットを 23% 削減しました [1]。

このプラットフォームの従量課金制 TOKN クレジットにより、実際の使用量に応じて費用が調整されるため、未使用の容量に対して支払う必要がなくなります。複数のモデルにわたるコストを統合することで、チームはツールごとに個別のサブスクリプションを維持する場合と比較して最大 98% を節約でき、プロジェクトや部門全体で大幅な節約が可能になります。

Prompts.ai はまた、ガバナンスとコンプライアンスを強化し、規制要件とワークフロー改善の両方をサポートする統合監査証跡を提供します。このプラットフォームはタスクをリスク階層に分類し、AI システムが完全に信頼できるようになるまで、一か八かの操作 (壊滅的な可能性を伴うレベル 4 のタスクなど) が人間の監督下に置かれるようにします。

エンドツーエンドの暗号化と厳格なアクセス制御により、機密データは構成ミスや侵害から保護されます。現在、組織の 78% がビジネスの少なくとも 1 つの分野で AI を使用しているため [2]、Prompts.ai は、チームが革新するために必要なスピードと機敏性を維持しながら、エンタープライズ グレードのセキュリティを提供します。すべてのインタラクションは安全で、追跡可能で、監査可能であるため、組織は自信を持って AI を責任を持って拡張できます。

AI のワークロードは、毎月の請求書だけでは完全には理解できない、予測不可能な出費につながることがよくあります。リアルタイム FinOps は、コストが発生したときに即座に洞察を提供することで、この状況を変えます。トークンの使用状況、GPU 時間、推論呼び出しをほぼリアルタイムで追跡することで、チームは予算超過を特定し、制御不能になる前に対処できます。

たとえば、ある金融分析のスタートアップでは、8 GPU クラスターの 40% がアイドル状態になっており、毎月 12,000 ドル近くを無駄にしていることがわかりました。リアルタイムのモニタリングを通じて、チームはスプリントの途中でこの非効率性を特定し、すぐにキャパシティを最適化するための調整を行いました。

チーム、プロジェクト、または顧客ごとのきめ細かな追跡により、チャージバック モデルがさらに洗練されます。 API リクエストに顧客 ID などのメタデータを添付することで、支出の透明性が高まります。これにより、各部門は使用した分だけ料金を支払うことができ、拡張性とコスト効率の両方に優れた運用への道が開かれます。

Real-time tracking doesn’t just monitor costs - it actively supports smarter scaling decisions. Autoscaling can now factor in both performance metrics (like latency) and financial data (such as cost per prediction). For example, during traffic spikes, systems can throttle or reroute requests based on cost signals, ensuring resources are used efficiently.

__XLATE_13__

StreamForge AI は、Kubecost と Prometheus を統合し、5 分ごとに更新される Grafana ダッシュボードに使用率データを表示することで、2025 年 9 月にこの戦略を採用しました。デュアル シグナリング自動スケーリング アプローチ (p95 レイテンシーとリクエストあたりのコスト メトリクスのバランスを取る) を使用して、GPU 使用率を大幅に向上させ、毎日 300 を超えるトレーニング ジョブの費用対効果を向上させました。このリアルタイムのアプローチは、毎月の予算を使い果たす可能性のある、コストのかかる構成ミスを回避するのに役立ちます。

Centralizing cost tracking across multiple AI providers is essential when managing diverse models. A unified AI gateway simplifies this process by consolidating token usage, latency, and cost data into a single, reliable source. Whether you’re using OpenAI, Anthropic, or self-hosted models, this centralized system eliminates the need to piece together fragmented billing data.

モデルによって価格が大幅に異なるため、このレベルの統合は非常に重要です。たとえば、GPT-3.5-Turbo の料金は 1,000 トークンあたり約 0.002 ドルですが、GPT-4 はコンテキスト ウィンドウに応じて 1,000 トークンあたり最大 0.12 ドルになります。リアルタイム追跡により、チームはこれらのコストを比較し、タスクを最も経済的なモデルにルーティングすることができます。単純な顧客のクエリを処理する場合でも、複雑な分析を処理する場合でも、タスクはリアルタイムのコスト データに基づいて適切なモデルに割り当てられ、ワークフローの効率性と予算に優しい状態が維持されます。

AI ワークフローをモジュール式コンポーネントに分割することで、その導入と拡張の方法に革命が起こります。すべての段階を処理するために単一の固定パイプラインに依存するのではなく、モジュラーアプローチにより、システム全体を中断することなく個々の部品を更新または交換できます。

この設計により、複数のタスクを同時に実行できる並列実行も可能になります。たとえば、多言語翻訳サービスは、さまざまな言語バージョンを次々に処理するのではなく、同時に処理できるため、処理時間を大幅に短縮できます。 MLOps プラクティスを採用すると、展開がさらに加速され、モデルを実稼働環境に移行する時間が最大 90% 短縮されます。自動化されたパイプラインにより、導入のタイムラインを数か月からわずか数日に短縮できます。

もう 1 つの利点は、再現性です。後処理などの特定のステップで問題が発生した場合は、ワークフロー全体をやり直すのではなく、保存されているアーティファクトを使用してそのモジュールだけを再実行できます。この対象を絞った再実行アプローチにより、特に大量の計算能力を必要とするタスクの場合に、時間とリソースの両方が節約されます。モジュール式ワークフローにより、システム全体でコンポーネントを標準化して安全に統合することも容易になります。

モジュール基盤が整ったら、コンポーネント間のスムーズな通信を確保することが不可欠になります。入力および出力形式を標準化すると、連鎖的なエラーを回避できます。たとえば、データ取り込みモジュールが、推論モジュールの予期される入力と完全に一致する、明確に定義された JSON ファイルを出力する場合、潜在的な通信ミスは排除されます。

AI ロジックをポリシー ロジックから分離することで、保守性がさらに向上します。これにより、AWS 処方ガイダンスで強調されているように、固定のビジネス ルールから独立して動的モデルの動作を管理できます。 Docker や Kubernetes などのツールはモジュールをコンテナ化して、異なる環境間での移植性を確保できます。コンテナ化されたモジュールは、開発、ステージング、本番環境で一貫して動作し、変更を必要とせずにクラウド プロバイダー間を移行することもできます。オーケストレーションの場合、AWS Step Functions は組み込みの再試行によるサーバーレス調整を提供し、Apache Airflow はより複雑なワークフローを管理するための Python ベースの柔軟性を提供します。

モジュラー設計では、各タスクに適切なリソースを割り当てることができるため、経済的なメリットも得られます。リソースを大量に消費する複雑な推論モデルは要求の厳しい分析用に確保しておき、より単純なタスクは安価なモデルで処理します。これにより、計算リソースが賢明に使用されます。

モジュールレベルでメタデータを追跡すると、透明性が高まります。パイプラインを通過する各成果物にタイムスタンプ、モデルのバージョン、コスト データなどの詳細を添付することで、チームは明確な監査証跡を取得できます。これは、デバッグだけでなく財務追跡にも役立ちます。コストをモジュール固有の指標に合わせることで、柔軟性を維持しながら正確な予算編成が可能になります。さらに、バッチ サイズと同時実行性に制限を設定すると、需要が高い時期の予期せぬ出費を防ぐことができます。

It’s worth noting that about 85% of machine-learning models never make it to production, often due to immature pipeline structures. Modular, iterative workflows offer a way to overcome this challenge. Teams can start small, validate one module at a time, and gradually scale up, reducing risks and ensuring systems are ready for production.

ガバナンスを最初から AI ワークフローに組み込むことで、将来のコストのかかる調整を節約できます。前述した自動評価と透明性を基盤とすることで、最初からコンプライアンスをプロセスに確実に組み込むことができます。モデルまたはユースケースが作成されるとすぐに、 ワークフローツールで追跡チケットを生成する そして初期リスクレベルを割り当てます。信用スコアリングや採用システムなどの高リスクのアプリケーションでは、社内で使用される低リスクのツールと比較して、より厳格な承認プロセスと綿密な監視が求められます。この積極的な「シフトレフト」は、このアプローチにより、特にトレーニングと評価プロセスの詳細な文書化を義務付ける EU AI 法のようなフレームワークで、規制要件に備えることができます。

コンプライアンスの基礎となるのは、 血統追跡これにより、生データから最終モデル出力までの明確で再現可能なパスが提供されます。リネージ追跡を組み合わせる スナップショットのトレーサビリティにより、コード、データ、構成の正確な状態が展開前に確実に保持されます。これにより、必要に応じてモデルのバージョンを再現できます。業界調査では、これらの対策の緊急性が強調されており、2024 年には AI 関連のインシデントが 56.4% 増加し、合計 233 件に達すると指摘されており、堅牢な監査証跡の必要性が強調されています。

監査証跡は、エラーをその原因に直接リンクすることでトラブルシューティングを効率化します。エンジニアはログを手動で選別する代わりに、リネージ追跡を使用して、パイプラインが破損した場所やデータ品質が低下した場所を迅速に特定できます。資産チェックやリスク評価などのガバナンス タスクを自動化すると、コンプライアンスが確保されるだけでなく、AI イニシアチブの成長に合わせて効率的に推進し続けることができます。これらの手順を自動化することで、承認時間を短縮し、運用全体での一貫性を維持できます。

高品質のデータを維持するには、強力なデータ ガバナンスが不可欠です。メタデータの一元管理により、すべての AI 資産に関する情報が 1 か所に統合され、冗長性が排除され、スムーズな運用が保証されます。プロンプトからモデルのバージョンに至るすべてのコンポーネントがタイムスタンプとコストの詳細で追跡されると、チームは 包括的な実行履歴。これにより、パイプラインの再現と改良が容易になります。自動化された監査ログにより人的エラーがさらに削減され、信頼性が高く再現可能なワークフローが確立されます。

これらのガバナンス戦略はモジュール式ワークフローとシームレスに統合され、規模が拡大してもコンプライアンスがシステムの中核部分であり続けるようにします。

統合されたガバナンス層は、合理化されたワークフローとコストの透明性を結び付け、全体的なコンプライアンスを確保します。 Snowflake、Databricks、クラウド プラットフォーム、エッジ環境などの多くのシステムは、複数のプラットフォーム間で動作します。統一されたガバナンス アプローチがなければ、モデルが監視なしにデプロイされ、コンプライアンスの検証が不可能になる「シャドウ AI」のリスクが生じます。 システム間のトレーサビリティ 実行時のデータ系統がクエリ、ノートブック、ジョブ、ダッシュボード全体で確実にキャプチャされ、プラットフォーム間でデータが移動する際のコンプライアンスが維持されます。集中ゲートウェイを備えたモデル コンテキスト プロトコル (MCP) などの標準化されたインターフェイスにより、サーバーとテナント全体で一貫したログ記録と要求の追跡が可能になります。これにより、作業がどこで行われたかに関係なく、完全な監査証跡が得られます。

ワークフローをゼロから作成するのは時間がかかり、非効率的になる可能性があります。コミュニティ主導のフレームワーク ラングチェーン そして オラマ は頼りになるソリューションとなり、プロンプトを連鎖させたりツールを統合したりするための事前に構築されたテンプレートを提供しています。これらのフレームワークは広く採用されており、開発者の 50% 以上が Ollama を使用し、3 分の 1 近くが AI エージェントの管理に LangChain に依存しています。これらは、脆弱なカスタム コードを独立して動作する柔軟なサーバーレス機能に置き換え、管理と拡張を容易にします。

主な利点は 複雑さを伴わない拡張性。コミュニティでテストされたパターンに依存することで、オーケストレーション ロジックを全面的に見直すことなく、モデルを切り替える (GPT から Amazon Bedrock への移行など) ことができます。この柔軟性により、一貫性を維持しながら展開が迅速化されます。調査によると、オーケストレーションは多くの組織にとって優先事項ですが、それを完全に実装している組織はわずかです。コミュニティ ワークフローは実用的なソリューションを提供し、さまざまな AI プラットフォーム間でのシームレスな統合を可能にします。

コミュニティ ワークフローは、プラットフォーム間で AI ツールを統合するという課題にも対処します。のような規格 モデルコンテキストプロトコル (MCP) 懸念されているプラットフォームのスプロール化の問題に取り組む 経営幹部の63%。これらのプロトコルを使用すると、手動でデータを入力することなく、AI エージェントとツールが Gmail、Slack、CRM などのプラットフォーム間で連携して動作できるようになります。たとえば、「Gmail からの最新 10 件のメールを要約してください」などの単純な自然言語リクエストは、 - 事前設定された API 接続を使用して構造化タスクをトリガーできます。

__XLATE_52__

相互運用性は非常に重要です。 IT リーダーの 87% AI 主導のシステムを導入するためにはそれが不可欠であると認識しています。コミュニティ ワークフローは復元力を念頭に置いて設計されており、潜在的なモデル障害に対処するための自動再試行、タイムアウト、並列実行などの機能を提供します。これらの安全策は特に重要です。 開発者の 87% が AI の精度を心配しています、 そして 81% がセキュリティとプライバシーを懸念しています。これらのワークフローは、統合を改善するだけでなく、コストを大幅に削減するのにも役立ちます。

コミュニティ テンプレートを使用して自然言語プロンプトを自動化されたワークフローに変換すると、コストを大幅に削減し、時間を節約できます。組織報告書 40~60%のコスト削減 そして 70 ~ 90% の時間を節約 これらのワークフローを通じて AI 自動化を導入する場合。テスト済みのソリューションから始めると、費用のかかる試行錯誤プロセスが不要になります。

これらのワークフローは、標準化された監査証跡とメタデータ追跡を組み込むことで透明性も高めます。データ ソース、権限、エージェントの決定履歴などの詳細を自動的に記録します。多くは以下を含みます 人間関係者 機密性の高いタスクや高コストのタスクを手動でレビューするためのチェックポイントにより、最も重要な部分を確実に監視できます。スケーリング中の推論コストを管理することで、企業は平均的なコストを達成できました。 171% の ROI コミュニティが構築したワークフローを活用する場合。

テストと評価の自動化は、シームレスな AI ライフサイクルを作成するための最後の部分です。これにより、モデルの本番環境への到達を妨げることが多い手動テストによって引き起こされる遅延が排除されます。プロセスの非効率性により、モデルの 85% がデプロイに失敗します。自動化された CI/CD/CT (継続的トレーニング) パイプラインを活用することで、導入にかかる時間が数か月からわずか数日に短縮されます。これらのパイプラインは、パフォーマンス メトリクスが設定されたしきい値を下回ったとき、または新しいデータが利用可能になったときにモデルを自動的に再トレーニングできるため、手動による継続的な監視の必要がなくなります。

経済的なメリットは明らかです。 2022 年から 2024 年にかけて、AI 推論コストは 280 分の 1 に低下し、継続的なモニタリングと再トレーニングが現実的な選択肢になりました。自動化されたパイプラインは問題を早期に発見し、コストのかかるエラーを回避するのにも役立ちます。たとえば、データ品質が低いと企業に年間 1,290 万ドルの損失が発生する可能性があり、計画外のシステム ダウンタイムは 1 時間あたり 125,000 ドルに達する可能性があります。スキーマの不一致、NULL 値、配布のシフトの特定など、自動化されたデータ検証ステップにより、問題が取り込み段階で確実に解決され、将来的により大きな問題が発生するのを防ぎます。

自動化はワークフローを加速するだけでなく、不必要な経費も削減します。自動調整パイプラインにより、必要な場合にのみ再トレーニングが行われるため、アイドル期間中の高価な GPU リソースの使用が削減されます。 LLM-as-a-Judge のようなツールは、評価プロセスを合理化し、数千のテストにわたって 80% 以上の一貫性を維持しながらコストを削減します。

テスト戦略により、予算をさらに最適化できます。 Dev Proxy などのツールを使用してテストをシミュレートすると、通話ごとの料金を発生させることなくエンドポイントのストレス テストを行うことができます。小規模なモデルと代表的なデータセットから始めると、本格的な評価に着手する前にアイデアを検証するのに役立ちます。さらに、プロジェクト、チーム、またはモデルのバージョンごとにクラウド リソースにタグを付けると、詳細な請求情報が提供され、どのワークフローが投資に値するかを判断しやすくなります。

自動テストは、規制当局が必要とする監査証跡を作成することでガバナンスも強化します。ガバナンス ゲートにより、スキーマやベースライン データなどの重要な資産が検証されるまでワークフローが一時停止します。各モデルのスナップショットは標準的なリスク評価を受け、結果は自動的に記録され、追跡のために障害がトリガーされたチケットが発行されます。

自動化では、次の 3 つの主要なタイプのドリフトを監視できます。 データドリフト (入力分布の変化)、 パフォーマンスのドリフト (精度の低下または応答時間の低下)、および 安全ドリフト (毒性の増加または機密情報の暴露)。アラートはこれらの問題に早期にフラグを立て、エンド ユーザーへの影響を防ぎます。さらに、キル スイッチを使用すると、チームはインシデント発生時に問題のあるモデル ルートや機能を迅速に無効にすることができ、最も重要なときにシステムを確実に制御できるガバナンスへの実践的なアプローチを実証します。

従量課金制プランは、チームが容易に成長して適応できるようにしながら、AI 費用を管理する賢い方法です。これらの計画は、コスト追跡やモジュール式の拡張性などの戦略に基づいて構築されており、リソースが効率的に使用されるようになります。

With pay-as-you-go pricing, you’re only charged for the tokens and compute time you actually use. Real-time dashboards provide insights into token consumption, latencies, and outcomes, helping to pinpoint inefficiencies and eliminate unnecessary spending. When combined with scale-to-zero capabilities, this model becomes even more effective - idle inference endpoints automatically shut down, so you’re not paying for unused GPU resources.

For tasks that aren’t time-sensitive, such as exploratory data analysis or offline model training, spot pricing offers a lower-cost alternative to on-demand rates. These savings add up, especially when paired with tools that track usage and performance in real time, allowing teams to fine-tune their compute needs and stay within budget.

Elastic compute ensures that your workflows can adapt to changing demands without manual adjustments. Features like autoscaling node pools and serverless architectures handle fluctuating workloads seamlessly, so there’s no need to overprovision resources for peak usage. By separating model artifacts from application code and using cloud storage, pods can start up almost instantly, making scaling operations faster and more efficient.

This approach is particularly valuable when transitioning from pilot projects to full-scale production. As the global MLOps market grows - expected to rise from $1.58 billion in 2024 to $2.33 billion by 2025 - organizations need scalable systems that won’t require constant rebuilding. Pay-as-you-go plans align costs with actual usage, making it easier to expand models, users, or teams without driving up expenses.

従量課金制プランは、高度なチーム ツールと連携してコスト管理と運用ワークフローを合理化します。最新のツールは、ガバナンス、監査証跡、シングル サインオン (SSO) やロールベースのアクセス制御 (RBAC) などのセキュリティ機能をオーケストレーション層に直接統合します。これらの機能は、SOC 2 や ISO 27001 などのコンプライアンス要件を満たすために不可欠です。

OpenAI 互換 API のサポートを提供するプラットフォームにより、チームはワークフローを全面的に見直すことなく LLM プロバイダーまたはモデルを切り替えることができ、新しいテクノロジーの出現に合わせた柔軟性が確保されます。管理された環境では、権限、SLA、一元化されたメタデータ追跡、承認制御などの機能を組み込むことで、チームの運用がさらに強化されます。これらのシステムは、組織に合わせて拡張するだけでなく、規制基準を満たすために必要な透明性と制御を維持し、すべてのチーム メンバーが適切なアクセス権を持ち、すべてのアクションが監査のために記録されることを保証します。

効果的な AI ワークフローを構築するには、構造化されたスケーラブルなアプローチと組み合わせた強力なモデルが必要です。前に説明した 7 つのプラクティスは、ばらばらの AI イニシアチブを、合理化されたエンタープライズ対応のプロセスに変換するのに役立ちます。多様な LLM を組み込み、継続的なコスト監視を維持し、モジュール設計を活用することで、ボトルネックを解消し、ニーズに合わせて進化するワークフローを作成できます。ガバナンスから始めることで、あらゆる AI の決定が追跡可能でコンプライアンスに準拠していることが保証され、コミュニティ主導のプロンプトと自動化されたテスト サイクルにより、品質を損なうことなく開発がスピードアップされます。これらの戦略は、効率的で信頼性の高い AI 運用のバックボーンを形成します。

前に強調したように、これらの方法により、オンボーディングやインシデント管理などのワークフロー全体で効率を 20% ~ 50% 向上させることができます。リアルタイムのコスト追跡と従量課金制モデルを組み合わせることで、支出を使用状況に合わせて維持し、予算超過を回避しながらシームレスなスケーリングをサポートします。自動化とフィードバック ループを統合することで、AI システムは自己最適化を行い、異常を特定し、改善を提案し、複雑なタスクを自律的に管理できます。

統合ガバナンスと適応型アーキテクチャへの移行は、強固な基盤の上にワークフローを構築することの重要性を強調しています。標準化されたツール、明確なコンポーネント境界、および詳細なトレースにより、新しいモデルや機能が登場してもシステムの柔軟性が維持されます。スケーラブルで反復可能なプロセスに焦点を当てることで、定期的なオーバーホールを行わずにパイロット プロジェクトから本格的な運用に移行できます。

これらの戦略を組み合わせることで、断片化した実験が効率的で責任ある、コストを意識したワークフローに変わります。 AI ワークフローを制御する準備はできていますか? Prompts.ai を使用すると、モデルを保護し、コストを管理し、簡単に拡張できます。 35 を超えるトップ モデルへのアクセス、組み込みの FinOps コントロールの利用、エンタープライズ グレードのガバナンスの実装がすべて単一のインターフェイス内で行われます。 Prompts.ai はツールの無秩序な増加を排除し、コンプライアンスを確保し、チームがイノベーションに集中できるようにして、AI の混乱を合理化された ROI 重視の運用に変えます。

最適なラージ言語モデル (LLM) を選択するには、まず、執筆、コーディング、カスタマー サポート、その他のアプリケーションなど、具体的なニーズを明確に特定することから始めます。パフォーマンス、コスト、プライバシーなどの要素を考慮した構造化されたアプローチを使用してモデルを評価します。リスクが最小限のタスクの場合は、より高速で予算に優しいモデルを優先します。一方で、一か八かのタスクでは、より信頼性が高く、適切な監視が含まれるモデルが必要です。ベンチマークは、選択したモデルがタスク要件と運用目標の両方を満たしていることを確認するための重要なステップです。

AI コストを管理するには、モニタリングが不可欠です トークンの使用法 それが起こるように。これには、リクエスト、プロンプト、モデル呼び出しの追跡が含まれます。これらの指標を常に把握することで、非効率を特定し、リソースの使用を最適化するために調整を行い、コストとパフォーマンスのバランスを維持できます。

モデルのドリフトを先取りするには、パフォーマンス メトリクスとデータ品質をリアルタイムで注意深く監視する自動監視システムをセットアップします。これらのツールは、データ分布や予測精度の変化を調べることで、概念ドリフト、共変量シフト、ラベル ドリフトなどの変化を特定できます。ドリフトが検出されると、事前定義された再トレーニング トリガーが作動してモデルを迅速に更新し、一貫した検証と MLOps プロセス内でのスムーズな統合を維持します。