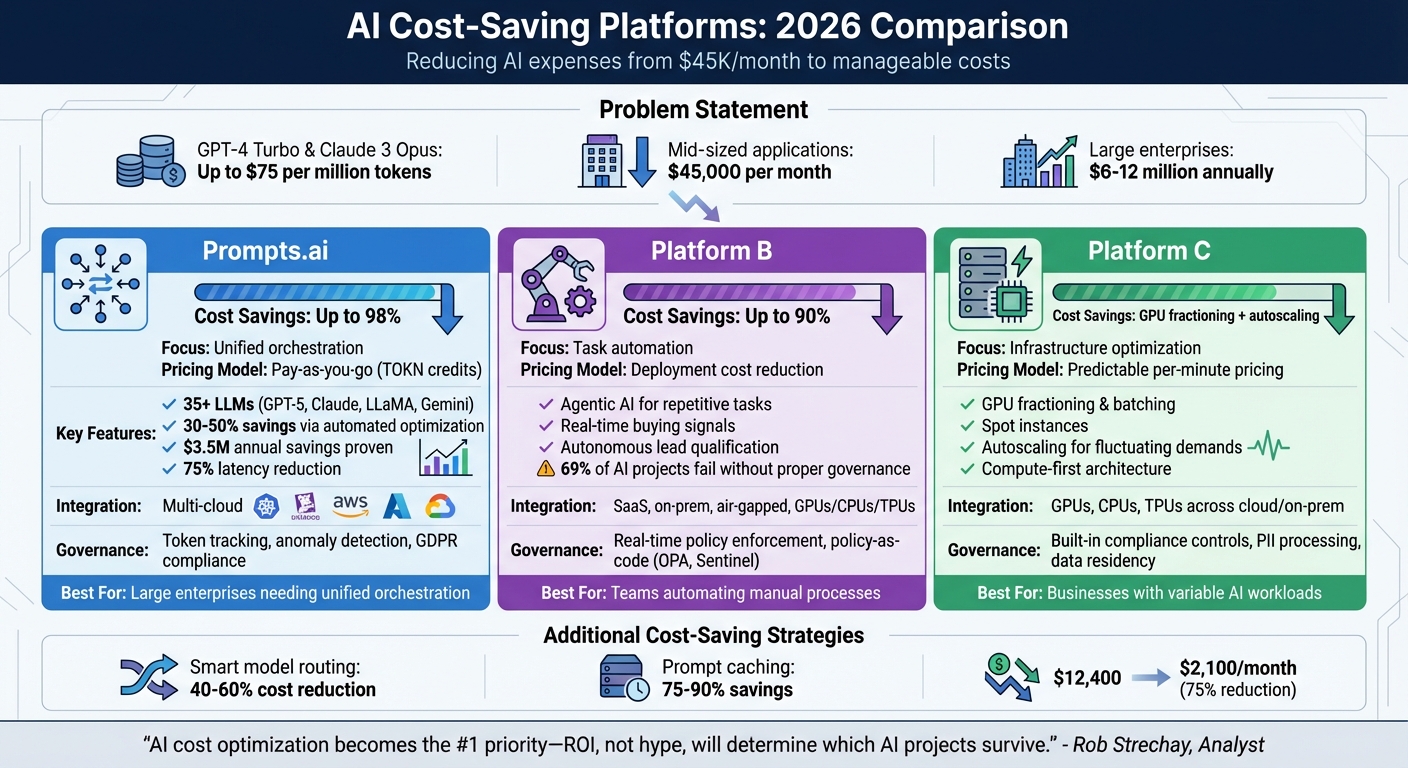

D’ici 2026, la gestion des coûts de l’IA est devenue une priorité absolue pour les entreprises. Avec des modèles comme GPT-4 Turbo et Claude 3 Opus coûtant jusqu'à 75 $ par million de jetons, les dépenses peuvent rapidement devenir incontrôlables - atteignant 45 000 $ par mois pour les applications de taille moyenne et $6–12 million annually pour les grandes entreprises. Pour résoudre ce problème, des plateformes comme Invites.ai, Platform B et Platform C proposent des solutions permettant de réduire les coûts grâce à une orchestration, une automatisation et une gestion unifiées. optimisation des infrastructures. Les principaux points à retenir sont les suivants :

Ces plates-formes rationalisent les flux de travail, réduisent les dépenses et garantissent la conformité, aidant ainsi les entreprises à maintenir leurs performances tout en respectant leur budget.

| Fonctionnalité/Plateforme | Invites.ai | Plateforme B | Plateforme C |

|---|---|---|---|

| Économies de coûts | Jusqu'à 98% | Jusqu'à 90% | Fractionnement GPU, mise à l'échelle automatique |

| Se concentrer | Orchestration unifiée | Automatisation des tâches | Optimisation des infrastructures |

| Modèle de tarification | Paiement à l'utilisation (crédits TOKN) | Réduction des coûts de déploiement | Tarification à la minute prévisible |

| Intégration | Multi-cloud, Kubernetes, Datadog | SaaS, sur site, isolé | GPU, CPU, TPU |

| Gouvernance | Suivi des jetons, détection des anomalies | Application des politiques en temps réel | Contrôles de conformité intégrés |

Choosing the right platform depends on your organization’s needs, whether it's reducing costs, improving workflows, or managing compliance effectively.

__XLATE_9__

Prompts.ai rassemble plus de 35 des grands modèles de langage les plus avancés, tels que GPT-5, Claude, LLaMA et Gemini, dans une plateforme d'orchestration unifiée. En éliminant le besoin de contrats et d'abonnements auprès de plusieurs fournisseurs, il permet aux organisations de réduire les coûts des logiciels d'IA jusqu'à 98 %. La plateforme fonctionne sur un système de paiement à l'utilisation utilisant des crédits TOKN, garantissant que les utilisateurs ne paient que pour ce qu'ils utilisent, sans frais mensuels récurrents.

Prompts.ai delivers 30–50% savings through automated resource optimization, which adjusts compute, storage, and network resources to the exact needs of the organization. Proven implementations have shown annual savings of $3.5 million by applying these optimizations to AI training and inference workloads. The platform’s FinOps layer provides detailed cost tracking, allowing teams to pinpoint anomalies and fine-tune spending at a granular level - whether by token, inference, or API call.

Les contrôles des coûts en temps réel permettent d'éviter les dépassements de budget en fixant des plafonds de dépenses pour les équipes et les projets. La mise à l'échelle automatisée du GPU pendant les heures de pointe et hors pointe réduit la latence jusqu'à 75 %, tout en réduisant les dépenses liées aux services d'IA cloud. Pour les pipelines basés sur Kubernetes, Prompts.ai automatise l'utilisation des instances ponctuelles et la planification des charges de travail, en regroupant efficacement les charges de travail sur des instances rentables sans compromettre les performances du modèle. Ses capacités d'intégration transparentes garantissent également la compatibilité avec l'infrastructure existante.

Prompts.ai se connecte sans effort à des plateformes telles qu'AWS, Azure, Google Cloud, Kubernetes, AWS Lambda, Amazon EC2, Snowflake et Datadog, permettant des flux de travail fluides dans votre configuration actuelle. Il prend en charge les flux de données en temps réel pour les grands modèles de langage et automatise le provisionnement, ce qui permet aux développeurs d'intégrer plus facilement des outils de surveillance tels que Datadog ou de mettre à l'échelle les points de terminaison d'inférence lors des pics de trafic. Ces intégrations améliorent non seulement l'allocation des ressources, mais minimisent également les frais opérationnels. En permettant des comparaisons de modèles côte à côte, les équipes peuvent sélectionner l'option la plus rentable pour leurs besoins, tandis que les flux de travail rapides unifiés éliminent les tracas liés à la jonglerie entre plusieurs outils.

Au-delà des économies de coûts et de l'intégration, Prompts.ai comprend des outils de gouvernance qui garantissent un suivi précis des coûts et la conformité aux normes réglementaires. Des fonctionnalités telles que le marquage virtuel pour la répartition des coûts et la détection des anomalies basée sur l'apprentissage automatique fonctionnent sans nécessiter de modifications de l'infrastructure existante. La plateforme prend en charge les modèles de démonstration et adhère aux réglementations telles que le RGPD dans les environnements multi-cloud, garantissant ainsi une gouvernance des coûts vérifiable. Chaque interaction de l'IA est enregistrée, offrant aux entreprises une visibilité complète sur l'utilisation du modèle, les activités de l'équipe et la gestion des données.

Prompts.ai est conçu pour gérer facilement les charges de travail croissantes d’IA, en prenant en charge les configurations multi-cloud qui évoluent sans effort. Les organisations peuvent intégrer de nouveaux modèles, utilisateurs et équipes en quelques minutes seulement sans perturber les flux de travail actuels. Son architecture est conçue pour les déploiements au niveau de l'entreprise, capable de gérer plus de 100 000 changements de production tout en maintenant des performances constantes. Cela en fait une solution idéale pour les entreprises qui passent de projets pilotes à petite échelle à des opérations d’IA à grande échelle dans plusieurs départements.

La plate-forme B est conçue pour réduire les coûts de l'IA en prenant en charge les tâches répétitives grâce à l'automatisation. Plutôt que de se concentrer uniquement sur les ajustements de l'infrastructure, il utilise l'IA agentique pour gérer des activités chronophages telles que la recherche, la saisie de données et les mises à jour CRM. Cela permet aux équipes de se concentrer sur un travail plus efficace tout en réduisant les coûts opérationnels.

En automatisant les processus manuels, la plateforme B réduit considérablement les dépenses. Son IA agentique fonctionne de manière autonome, réagissant aux signaux d'achat en temps réel au lieu de s'appuyer sur des playbooks rigides. Cela lui permet d’identifier des prospects qualifiés et de rédiger efficacement des messages personnalisés. Les entreprises utilisant ce système ont signalé une baisse allant jusqu'à 90 % des coûts de déploiement de l'IA[3].

La plate-forme B agit comme une plateforme de contrôle centralisée pour gérer les charges de travail d'IA sur diverses infrastructures, notamment les plates-formes SaaS, les VPC cloud, les systèmes sur site et même les environnements isolés. Compatible avec les GPU, CPU et TPU, il ne nécessite aucune configuration spécialisée. La plateforme s'intègre parfaitement aux outils d'IA existants via une interface utilisateur, un SDK et une CLI intuitifs, ce qui facilite la création et la configuration de modèles. Cette approche permet aux organisations d'améliorer leurs configurations actuelles sans avoir besoin de modifications majeures de l'infrastructure.

La plateforme garantit la conformité en automatisant la collecte de preuves et en appliquant les politiques en temps réel dans les environnements cloud. À l'aide d'outils de stratégie en tant que code tels qu'OPA, HashiCorp Sentinel et AWS Config, il intègre la gouvernance dans les pipelines CI/CD et IaC. La détection automatisée des dérives compare l'infrastructure active aux états déclarés, signalant et résolvant les ressources non gérées ou les problèmes de sécurité. Chaque artefact de modèle est lié à son commit Git et à son ID de plan Terraform, créant ainsi une piste d'audit détaillée. Alors que 69 % des projets d'IA ne parviennent pas à être déployés en raison d'obstacles d'intégration et de gouvernance[3], ces fonctionnalités permettent d'éviter les actions non autorisées et de maintenir les normes réglementaires.

La plate-forme B fournit un plan de contrôle unifié pour gérer les configurations d'IA multi-cloud. Il simplifie la mise à l'échelle en standardisant les rôles et le balisage IAM tout en utilisant des boucles de réconciliation pour optimiser les ressources pour les charges de travail croissantes. Étant donné que 94 % des organisations considèrent l'orchestration des processus comme la clé du succès de l'IA[3], ce système rationalisé prend en charge le passage de petits projets pilotes à des déploiements d'entreprise à grande échelle sans ajouter de complexité inutile. Son approche centralisée garantit la disponibilité de mesures de réduction des coûts à mesure que les opérations se développent.

La plate-forme C se concentre sur la réduction des coûts en optimisant la couche d'infrastructure. Il emploie Fractionnement et batching GPU pour tirer le meilleur parti des ressources GPU. En regroupant plusieurs charges de travail, cela augmente le débit, garantissant que les entreprises ne paient que pour les ressources qu'elles utilisent activement, plutôt que de maintenir la capacité inutilisée.

Cette plateforme réduit les dépenses grâce à instances ponctuelles et mise à l'échelle automatique. La mise à l'échelle automatique minimise les ressources de calcul pendant les périodes d'inactivité, ce qui est idéal pour les entreprises dont les demandes en IA sont fluctuantes. Au lieu de s'appuyer sur une tarification par jeton coûteuse, il offre un modèle de tarification à la minute prévisible, ce qui rend les coûts plus gérables à mesure que l'utilisation évolue. De plus, en colocalisant l'inférence GPU avec les points de présence télécoms, cela élimine le besoin de recourir à plusieurs fournisseurs tiers, simplifiant ainsi l'intégration et réduisant les coûts associés. Ces fonctionnalités s'alignent sur une stratégie de déploiement flexible pour s'adapter aux différents besoins de l'entreprise.

La plateforme C utilise un architecture axée sur le calcul qui prend en charge le déploiement sur les GPU, les CPU et les TPU. Son plan de contrôle unifié permet une orchestration transparente des charges de travail d'IA sur les plates-formes SaaS, les VPC cloud, les configurations sur site et même les environnements isolés, le tout sans dépendance vis-à-vis d'un fournisseur. Cette approche permet aux organisations de tirer parti de leur infrastructure existante tout en accédant à une bibliothèque de modèles et de flux de travail prédéfinis. La plateforme rationalise les opérations en supprimant le besoin de configurations complexes.

La plate-forme comprend des contrôles intégrés pour gérer des tâches telles que le traitement des informations personnelles, le consentement à l'enregistrement des appels et les exigences de résidence des données. Son architecture de pile unifiée simplifie la conformité en maintenant les normes réglementaires sans ajouter de complexité supplémentaire. En consolidant les fonctions de gouvernance sur une plateforme unique, les entreprises peuvent répondre efficacement aux besoins de conformité et garder les coûts sous contrôle.

Lors de la sélection d'une plateforme, il est essentiel de peser les compromis pour tirer le meilleur parti de votre investissement en IA. S'appuyant sur des stratégies de réduction des coûts antérieures, cette section examine les principaux domaines dans lesquels les plates-formes diffèrent.

Réduction des coûts: Smart model routing can cut costs by 40–60% by diverting simpler queries to more affordable models, such as DeepSeek or Gemini Flash. Additionally, using prompt caching for repetitive tasks can save 75–90%. For example, in late 2025, a team reduced their monthly expenses by 75%, dropping from $12,400 to $2,100 by routing queries to cost-efficient models.

Capacités d'intégration: Platforms offering extensive connectors - some supporting over 70 vector databases and 100+ data ingestion sources - are highly adaptable to existing systems. However, these abstract layers may introduce 15–25% latency compared to direct model calls, which could be a concern for real-time applications.

__XLATE_35__

Gouvernance et conformité: Pour les secteurs soumis à des réglementations strictes, les plates-formes comprenant des pistes d'audit, des outils d'explicabilité et des contrôles de résidence des données sont essentielles. La décision se résume souvent à trouver un équilibre entre flexibilité et contrôle. Les solutions auto-hébergées offrent une confidentialité améliorée mais nécessitent plus d'expertise technique, tandis que les plates-formes SaaS offrent la commodité au détriment potentiel de la souveraineté des données. Ces considérations de gouvernance ont un impact significatif sur l’évolutivité dans la pratique.

Évolutivité: Les modèles de tarification basés sur l'exécution sont souvent plus économiques pour les flux de travail d'IA complexes à mesure que les charges de travail augmentent, tandis que des fonctionnalités telles que la persistance de l'état et l'exécution durable - utilisées par OpenAI pour Codex en production - permettent aux agents de gérer des tâches de longue durée sans perdre de contexte. À l’inverse, les frameworks plus petits sont mieux adaptés aux déploiements en périphérie, même s’ils manquent de certaines fonctionnalités de niveau entreprise.

En fin de compte, le succès en 2026 dépendra de la manière dont vous alignerez les capacités de la plateforme avec vos besoins spécifiques en termes de coût, d’intégration, de conformité et d’évolutivité.

__XLATE_41__

- __XLATE_113__

Choosing the right platform to maximize cost savings and streamline operations in 2026 depends heavily on your organization’s size and specific needs. The strategies discussed - ranging from unified orchestration to intelligent model routing - are key for platforms designed to support seamless AI workflows. For large enterprises, orchestration layers offering centralized governance, token tracking, and vendor management are essential for coordinating multiple teams and maintaining compliance. On the other hand, small to mid-sized businesses often find greater value in using smaller, specialized models and tools tailored to specific tasks, like invoice processing or demand forecasting, without the complexity of large-scale integrations.

La maîtrise des coûts reste un moteur de l’efficacité opérationnelle. Comme le dit Rob Strechay, analyste, « l'optimisation des coûts de l'IA devient la priorité n°1 : le retour sur investissement, et non le battage médiatique, déterminera quels projets d'IA survivront. » Ces stratégies d'optimisation ouvrent la voie à des approches personnalisées adaptées aux organisations de toutes tailles.

For smaller teams, immediate savings can be achieved with prompt caching and straightforward model routing. High-volume operations, however, gain more from advanced techniques like semantic caching and intelligent routing, which ensure premium models are reserved for complex tasks. Enterprises managing large-scale AI initiatives require robust governance tools - such as budget alerts, audit trails, and token approval systems - to keep spending under control. Notably, while technology accounts for only 20% of an AI initiative’s value, redesigning workflows delivers the remaining 80%, making operational adjustments equally critical.

À une époque où la rentabilité n’est pas négociable, l’adoption de la souveraineté de l’IA – en exécutant des modèles sur une infrastructure privée – offre aux organisations un moyen de réduire leurs dépenses tout en protégeant les données sensibles. Les plates-formes qui prospéreront en 2026 seront celles qui s'intégreront de manière transparente aux flux de travail opérationnels, permettant ainsi de réaliser de réelles économies tout en maintenant les normes de performance et de conformité.

Prompts.ai aide les entreprises à réduire leurs dépenses en matière d'IA grâce à routage intelligent des invites et optimisation du flux de travail. En dirigeant les tâches les plus simples vers des modèles moins coûteux et en réservant les modèles avancés aux tâches plus exigeantes ou critiques, cette approche permet de réduire les frais basés sur les jetons. En moyenne, les entreprises ont déclaré des économies d'environ 6,5 %.

La plate-forme comprend également des outils tels que le suivi des coûts en temps réel, l'accès à plus de 35 modèles d'IA et un routage basé sur des règles pour simplifier les processus. Des fonctionnalités telles que des API unifiées pour la gestion de plusieurs fournisseurs et des stratégies de mise en cache qui réutilisent les sorties antérieures contribuent également à minimiser la consommation de ressources et les coûts. Ces outils garantissent que les flux de travail d'IA restent efficaces et rentables tout en conservant des performances élevées.

Prompts.ai brille par son Outils d'orchestration axés sur l'IA, conçu pour rationaliser les flux de travail sur une variété de modèles, d'ensembles de données et d'applications d'IA. Ses fonctionnalités remarquables incluent suivi des coûts en temps réel and adherence to strict security standards such as SOC 2 Type II and HIPAA. With support for over 35 AI models, it’s a strong option for businesses aiming to enhance AI-driven operations while keeping costs and security in check.

En revanche, d’autres plates-formes répondent souvent à des objectifs d’automatisation plus larges. Certains excellent dans automatisation sans code, offrant des intégrations d'applications étendues qui s'adressent aux équipes non techniques gérant divers flux de travail. D’autres donnent la priorité gestion sécurisée des flux de travail de l'IA, en se concentrant sur la réduction de la prolifération des outils, la simplification des processus et la fourniture d'une visibilité approfondie des coûts.

Prompts.ai est particulièrement adapté aux entreprises qui ont besoin de des solutions de flux de travail d'IA efficaces, sécurisées et respectueuses du budget, tandis que les plates-formes alternatives pourraient mieux servir ceux qui ont des exigences générales d'automatisation ou de conformité de niche.

La gouvernance et la conformité jouent un rôle crucial dans la sélection de la bonne plateforme d’IA permettant de réduire les coûts. Ils garantissent que vos flux de travail d'IA respectent les normes juridiques, éthiques et organisationnelles, ce qui est essentiel pour protéger les données sensibles, éviter les amendes et maintenir la confiance.

Un cadre de gouvernance solide permet aux entreprises de superviser et de gérer efficacement les opérations d’IA. Il garantit le respect des politiques tout en gardant les coûts sous contrôle. Cette approche réduit le risque de mauvaise utilisation des ressources et aligne les initiatives d'IA sur les objectifs de l'entreprise et les exigences réglementaires. En donnant la priorité à la gouvernance, les organisations peuvent atténuer les risques tout en réalisant une plus grande efficacité et des économies de coûts.