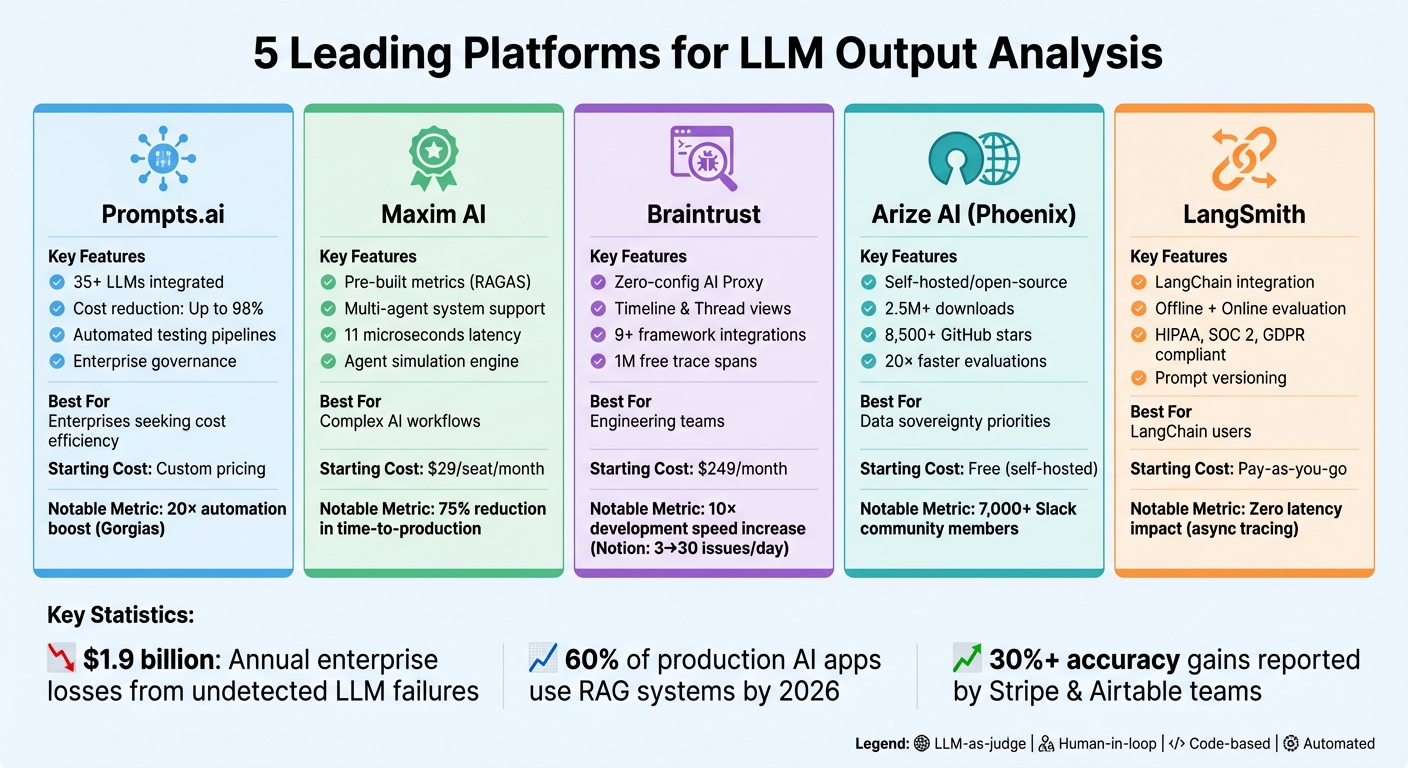

Les grands modèles linguistiques (LLM) sont puissants mais imprévisibles, produisant souvent des résultats incohérents ou coûteux. Pour relever ces défis, les organisations s'appuient sur des outils spécialisés d'évaluation, de suivi et de gestion des coûts. Cet article présente cinq plates-formes qui rationalisent l'analyse des résultats du LLM :

Chaque plateforme aborde des aspects uniques des flux de travail LLM, de l'amélioration de la précision à la réduction des coûts et à la garantie de la conformité.

| Plate-forme | Principales fonctionnalités | Idéal pour | Coût de départ |

|---|---|---|---|

| Invites.ai | Accès LLM centralisé, outils FinOps économiques | Entreprises en quête de rentabilité | Tarification personnalisée |

| Maxime IA | Métriques prédéfinies, prise en charge du système multi-agents | Équipes gérant des flux de travail d’IA complexes | 29 $/siège/mois |

| Confiance cérébrale | Outils de débogage, tests de conversation multi-tours | Equipes d'ingénierie | 249 $/mois |

| Arize IA | Open source, traçage détaillé, vérifications des hallucinations | Organisations donnant la priorité au contrôle des données | Gratuit (auto-hébergé) |

| LangSmith | Intégration LangChain, versioning rapide | Utilisateurs de LangChain | Paiement à l'utilisation |

Ces plates-formes simplifient la gestion du LLM, garantissant des opérations d'IA évolutives, fiables et rentables.

__XLATE_5__

Prompts.ai brings together 35+ top-tier LLMs - including GPT‑5, Claude, LLaMA, and Gemini - into one unified platform designed for enterprise-level prompt engineering and detailed output analysis. It simplifies evaluation with automated testing pipelines.

Prompts.ai propose des pipelines d'évaluation capables d'exécuter plus de 20 tests sur des ensembles de données d'invite. Celles-ci incluent des méthodes telles que les assertions LLM (utilisant l'IA pour noter les résultats), les contrôles de similarité sémantique via la similarité cosinus, les évaluations de correspondance exacte et la correspondance de modèles basée sur les expressions régulières. Les équipes peuvent également intégrer des évaluations humaines via un tableau de bord convivial, permettant aux experts du domaine d'évaluer manuellement les résultats dans le cadre de l'apprentissage par renforcement à partir des commentaires humains.

For instance, Gorgias, a customer support platform, used Prompts.ai to scale its AI-powered helpdesk to support millions of shoppers. This led to a 20× boost in automation. Their ML engineers and support teams run daily regression tests on backtest datasets to catch potential issues before deployment.

Ces capacités de tests rigoureux garantissent une intégration fluide dans les flux de travail actuels.

Prompts.ai’s evaluation pipelines seamlessly integrate with CI/CD workflows and enable backtesting against historical production data. The platform supports connections through external HTTP endpoints, custom Python/JavaScript scripts, and Model Context Protocol (MCP) actions.

Speak, une application d'apprentissage des langues, a exploité ces fonctionnalités d'automatisation pour condenser des mois de développement de programmes en une seule semaine. Cette efficacité leur a permis de lancer des fonctionnalités basées sur l'IA sur 10 nouveaux marchés en même temps.

Prompts.ai aide également les équipes à optimiser les coûts en proposant des vues de comparaison de modèles côte à côte. Ces comparaisons permettent aux utilisateurs de peser les compromis entre les coûts des API, la latence et les scores de qualité. Les équipes peuvent résumer les résultats ou utiliser des modèles plus petits et plus rapides pour les tâches intermédiaires afin de réduire l'utilisation des jetons. NoRedInk, qui dessert 60 % des districts scolaires américains, utilise ces fonctionnalités économiques pour fournir des commentaires générés par l'IA sur plus d'un million de notes d'élèves, tout en maintenant la qualité des enseignants.

Prompts.ai améliore la collaboration en équipant toutes les parties prenantes d'outils pour affiner les résultats du LLM. Un éditeur visuel sans code permet aux utilisateurs non techniques de modifier et de tester les invites sans faire appel à des ingénieurs. Le registre d’invite centralisé garantit une gestion efficace des versions.

ParentLab, par exemple, a économisé plus de 400 heures d'ingénierie en seulement six mois en permettant à des experts non techniques de gérer 700 révisions rapides.

__XLATE_12____XLATE_13__

La plateforme rassemble également les évaluations des utilisateurs et les traduit en scores de performances, créant ainsi une boucle de rétroaction continue pour améliorer la qualité des résultats sur tous les modèles intégrés.

Maxim AI fournit des outils de test et de surveillance approfondis, combinant des évaluations pilotées par des machines avec des commentaires humains pour aider les équipes à gérer des flux de travail d'IA complexes. Ses fonctionnalités sont conçues pour garantir des évaluations approfondies, essentielles au maintien de solides performances LLM.

Maxim AI utilise un cadre d'évaluation robuste qui comprend des tests déterministes, des méthodes statistiques et des outils de jugement automatisés. Le Magasin d'évaluateur propose des métriques prédéfinies telles que RAGAS, adaptées aux systèmes de génération augmentée par récupération - composants clés dans environ 60 % des applications d'IA de production d'ici 2026. De plus, métriques au niveau du nœud help identify failures in retrieval and generation processes. The platform’s Simulation d'agents Le moteur permet des tests de conversation à plusieurs tours et la création de personnalités d'utilisateur pour les évaluations préalables au déploiement. Des entreprises telles que Clinc et Mindtickle ont signalé une réduction de 75 % des délais de production en adoptant ces normes de qualité.

Maxim AI’s evaluation tools integrate effortlessly with today’s development environments. It supports SDKs in Python, TypeScript, Java, and Go, while offering compatibility with platforms like LangChain, LangGraph, Crew AI, OpenAI, Anthropic, Mistral, and AWS Bedrock. The platform also adheres to OpenTélémétrie normes pour le traçage distribué et se connecte à des outils tels que Slack et PagerDuty pour des alertes en temps réel. Les utilisateurs d'entreprise bénéficient d'options de déploiement qui incluent l'hébergement Cloud et In-VPC, toutes répondant aux exigences de conformité SOC2, HIPAA et GDPR.

Le Passerelle Bifrost LLM utilise la mise en cache sémantique pour réduire les dépenses, tout en surveillant l'utilisation des jetons et les coûts des API pour identifier et gérer les flux de travail coûteux. Cela garantit des opérations efficaces à mesure que la production évolue.

Maxim AI’s interface utilisateur sans code permet aux chefs de produits et aux concepteurs d'expérimenter des invites et de mener des évaluations de manière indépendante. Kellie Maloney, responsable produit chez Rise Science, a partagé :

__XLATE_29__

La plate-forme comprend également des files d'attente d'annotations pour les révisions humaines, un CMS Prompt centralisé avec contrôle de version et RBAC avec prise en charge SAML/SSO. Les équipes qui exploitent ces outils de collaboration ont multiplié par cinq la vitesse d'expédition, rationalisant les itérations et accélérant les déploiements de production.

Braintrust combine des expériences hors ligne avec une notation en ligne pour donner aux équipes une vue complète des performances LLM, du développement au déploiement.

Braintrust propose plusieurs façons d'évaluer la qualité des résultats sur une échelle de 0 à 1. Les équipes peuvent utiliser des notateurs automatisés pour des tâches telles que les contrôles de factualité et de similarité, s'appuyer sur des évaluations LLM en tant que juge ou mettre en œuvre une logique de code personnalisée adaptée à leurs besoins spécifiques. La plateforme comprend Vues chronologiques avec des diagrammes de Gantt pour identifier les goulots d'étranglement, Vues du fil de discussion pour le débogage des conversations à plusieurs tours et des visualisations de traces basées sur le langage naturel affichées sous forme de composants React en bac à sable. Il prend également en charge l'exécution de plusieurs essais pour chaque entrée, aidant ainsi les équipes à mesurer la variance et à maintenir la cohérence.

Braintrust s'intègre parfaitement aux principaux frameworks d'IA, offrant une prise en charge native pour 9+ frameworks majeurs, tels que OpenTelemetry, Vercel AI SDK, OpenAI Agent SDK, Instructor, LangChain, LangGraph, Google ADK, Mastra et Pydantic AI. Il utilise un "wrap" approche d'intégration - les exemples incluent envelopperAISDK pour Vercel AI SDK (couvrant les versions v3 à v6 bêta) et wrap_openai pour l'instructeur. La plateforme adhère à Conventions sémantiques OpenTelemetry GenAI, mappant automatiquement les détails tels que l'utilisation des jetons et les identifiants de modèle aux champs Braintrust. Il fonctionne de manière transparente avec les principaux fournisseurs LLM, notamment OpenAI, Anthropic et Google Gemini. Les développeurs peuvent également utiliser le Éval() fonction ou la CLI avec le --montre indicateur pour réexécuter automatiquement les évaluations chaque fois que les fichiers sont mis à jour pendant le développement.

Braintrust va au-delà de l'évaluation en favorisant la collaboration en équipe avec des outils intégrés. C'est synchronisation bidirectionnelle garantit que les chefs de produit et les ingénieurs peuvent travailler sur les invites de manière interchangeable entre le code et l'interface utilisateur. Le Aire de jeux offre un espace sans code où les équipes peuvent tester les invites, comparer les modèles côte à côte et partager des configurations pour des itérations rapides. Des outils d'annotation dédiés permettent aux équipes de fournir des commentaires humains, en ajoutant des étiquettes ou des corrections directement aux traces et aux sorties du modèle. Des annotateurs externes peuvent être invités à évaluer la qualité des différentes versions du modèle, tandis que les arriérés d'évaluation partagés centralisent les ensembles de données et les grilles de notation, éliminant ainsi le besoin d'un suivi manuel sur une feuille de calcul.

Phoenix d'Arize AI est une plate-forme open source conçue pour donner aux équipes un contrôle complet sur l'évaluation des grands modèles de langage (LLM). Construit avec OpenTelemetry à la base, Phoenix a attiré l'attention avec plus de 2,5 millions de téléchargements et plus de 8 500 étoiles GitHub. Il offre un traçage détaillé pour suivre chaque étape d'un flux de travail LLM, ce qui facilite l'identification des problèmes.

Phoenix emploie le LLM en tant que juge approche, en utilisant des modèles de base d'OpenAI, Anthropic et Gemini pour évaluer d'autres applications LLM pour des facteurs tels que la pertinence, la toxicité et les performances globales. Il est livré avec des évaluateurs prédéfinis pour les tâches courantes telles que la génération augmentée par récupération (RAG) et l'appel de fonctions. Une caractéristique remarquable est son capacité d'explication, où les modèles d'évaluation fournissent un raisonnement clair derrière leurs scores, aidant ainsi les développeurs à comprendre la logique derrière chaque évaluation. Des outils supplémentaires incluent des vérifications déterministes basées sur le code, des annotations humaines directement dans l'interface et regroupement d'ensembles de données qui utilise des intégrations pour regrouper visuellement des questions et des réponses sémantiquement similaires. Ce regroupement permet d'isoler les domaines dans lesquels les modèles sont sous-performants.

__XLATE_63__

Ces outils d'évaluation s'intègrent parfaitement à l'écosystème de développement plus large de la plateforme.

Phoenix prend en charge l'auto-instrumentation pour les frameworks populaires tels que LlamaIndex, LangChain, DSPy, Mastra et Vercel AI SDK. Il fonctionne avec Python, TypeScript et Java, et sa conception native OpenTelemetry garantit la compatibilité avec les outils d'observabilité existants sans enfermer les utilisateurs dans des fournisseurs spécifiques. Les équipes peuvent également intégrer des évaluations de bibliothèques tierces telles que Ragas, Deepeval ou Cleanlab, offrant ainsi une flexibilité dans leurs flux de travail.

Phoenix est conçu pour être efficace, offrant Des évaluations jusqu'à 20 fois plus rapides grâce à la concurrence et au traitement par lots. Son Prompt Playground fournit un environnement de test dans lequel les équipes peuvent affiner les invites et comparer les variantes de modèles côte à côte avant le déploiement, réduisant ainsi le risque d'erreurs de production coûteuses.

En tant que plateforme entièrement open source et auto-hébergable, Phoenix garantit aux équipes de conserver un contrôle total sur leurs données. Des fonctionnalités comme files d'attente d'annotations humaines permettre d’ajouter directement des étiquettes de vérité terrain aux traces, favorisant ainsi une meilleure collaboration. Le Centre d'invite gère la gestion des versions, le stockage et le déploiement rapides dans les environnements, tandis que le Bavarder L'outil permet aux équipes d'évaluer et de discuter de segments de flux de travail spécifiques pour découvrir les problèmes de performances. Avec une communauté Slack de plus de 7 000 membres, les utilisateurs ont accès à un réseau pour dépanner et partager des informations.

__XLATE_76__

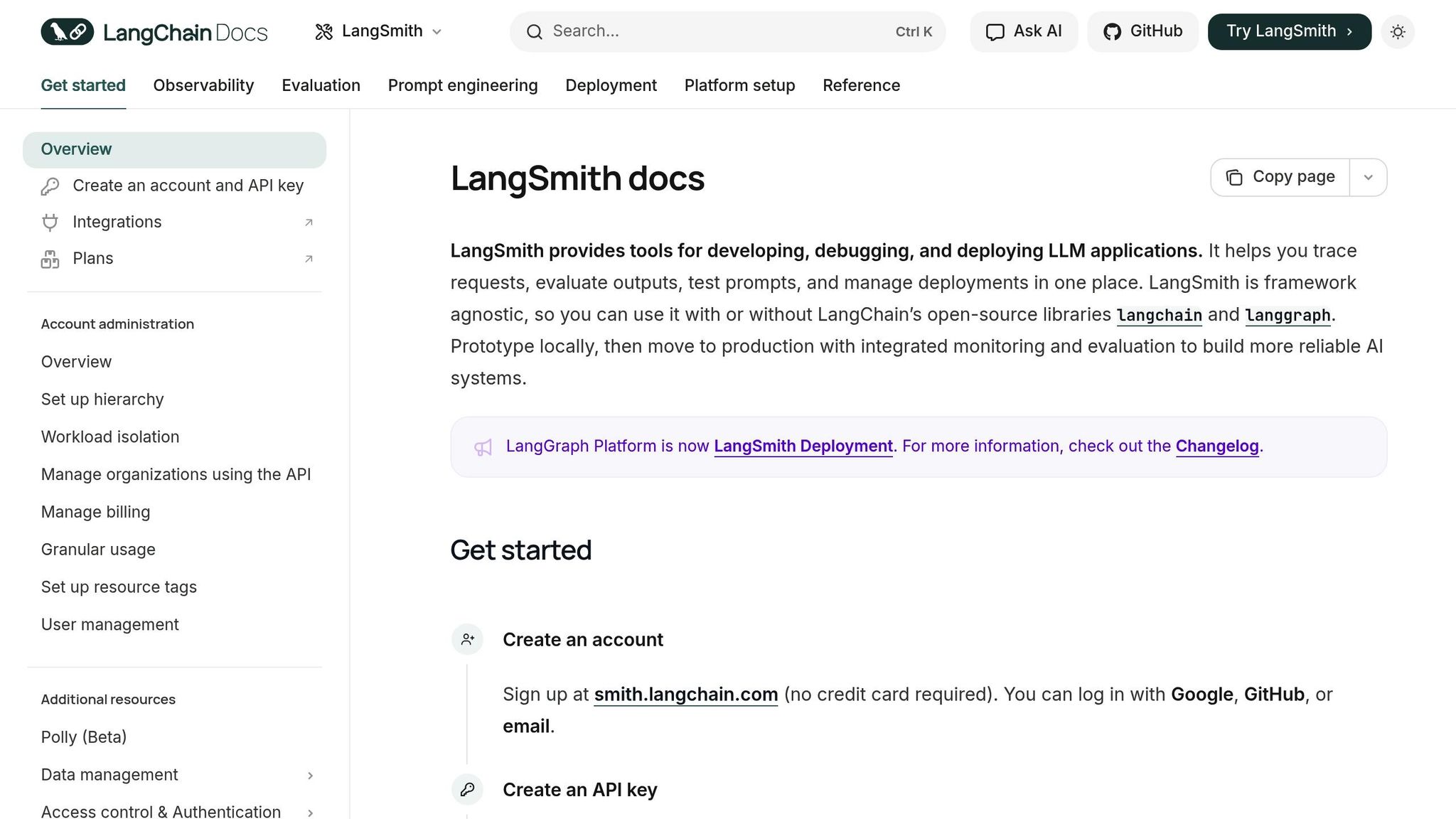

LangSmith est une plateforme polyvalente conçue pour fonctionner de manière transparente avec ou sans LangChain, la rendant adaptable à n'importe quelle pile LLM. Il se connecte sans effort à des outils tels que OpenAI, Anthropic, CrewAI, Vercel AI SDK et Pydantic AI, offrant une flexibilité aux équipes utilisant déjà des frameworks spécifiques. La plateforme répond aux normes de conformité telles que HIPAA, SOC 2 Type 2 et GDPR, et utilise un processus asynchrone pour envoyer des traces, garantissant ainsi aucune latence supplémentaire pour les utilisateurs finaux.

Offres LangSmith deux modes d'évaluation pour répondre à différents besoins : évaluation hors ligne pour tester des ensembles de données sélectionnés pendant le développement et évaluation en ligne pour surveiller le trafic de production en direct. Il prend en charge quatre types d'évaluateurs :

La plateforme comprend des outils d'analyse avancés comme Vue différentielle, qui met en évidence les différences entre les résultats du modèle et les textes de référence, ainsi que des comparaisons côte à côte pour l'analyse comparative des performances. Il fournit également regroupement de métadonnées, permettant l'analyse de mesures telles que l'exactitude ou le coût par catégories telles que le domaine ou le type d'utilisateur. LangSmith s'intègre à l'open source ouvertures package, offrant des évaluateurs prédéfinis pour évaluer l’exactitude et la concision.

Ces fonctionnalités facilitent l'intégration de LangSmith dans les flux de travail et les outils de développement existants.

LangSmith simplifie le traçage avec le @traçable décorateur ou wrappers clients qui capturent automatiquement les entrées et les sorties. Il prend en charge l'intégration avec les SDK Python et TypeScript/JavaScript, une API REST et des frameworks de test tels que pytest, Vitest et Jest, facilitant l'intégration d'évaluations dans les pipelines CI/CD. De plus, l'intégration d'OpenTelemetry permet aux équipes d'envoyer des traces des pipelines d'observabilité existants directement à LangSmith.

LangSmith améliore la collaboration en équipe grâce à des outils intuitifs de feedback et d'annotation. Files d'attente d'annotations permettre l'acheminement automatique d'exécutions spécifiques vers des experts en la matière pour un examen manuel et une notation basée sur des critères personnalisés. Le Centre d'invite sert d'espace centralisé permettant aux équipes d'itérer, de versionner et de partager des invites, avec des fonctionnalités de suivi des modifications et de restauration pour maintenir la cohérence tout au long du développement. Les fonctionnalités d'annotation en ligne permettent aux membres de l'équipe de signaler les problèmes ou de fournir des commentaires ciblés sur la qualité des réponses, améliorant ainsi à la fois la précision de l'évaluation et l'efficacité du flux de travail.

La plateforme offre également une gestion détaillée des utilisateurs et une isolation de la charge de travail, garantissant une collaboration fluide entre les équipes. Les utilisateurs peuvent s'inscrire gratuitement sur smith.langchain.com - aucune carte de crédit n'est requise. Pour une utilisation en production, LangSmith fonctionne sur une base de paiement à l'utilisation, avec des forfaits d'entreprise disponibles pour l'auto-hébergement sur des clusters Kubernetes sur AWS, GCP ou Azure.

Lors de l'évaluation des plateformes d'évaluation LLM, il est essentiel de prendre en compte la compatibilité technique, le coût et les méthodes d'évaluation. Voici un aperçu plus approfondi des options :

Invites.ai rassemble plus de 35 modèles leaders sous une seule interface sécurisée, offrant des contrôles FinOps qui peuvent réduire les coûts des logiciels d'IA jusqu'à 98 %. Confiance cérébrale simplifie la configuration avec un proxy AI sans configuration, capturant les journaux via une URL de base unique. Il comprend 1 million de traçages gratuits, avec des forfaits payants à partir de 249 $/mois. Maxime IA s'intègre parfaitement aux piles d'observabilité existantes, en se concentrant sur la notation de qualité plutôt que sur le traçage complet. Il propose un forfait gratuit jusqu'à 10 000 journaux par mois et des forfaits payants à partir de 29 $ par siège/mois. Arize Phoenix prend en charge l'auto-hébergement pour la confidentialité des données, en s'intégrant à des outils tels que RAGAS et Giskard pour une analyse plus approfondie des métriques. LangSmith est conçu pour les utilisateurs de LangChain, offrant une observabilité avancée, bien que les prix du support d'entreprise varient. Notamment, Notion a décuplé sa vitesse de développement avec Braintrust, passant de 3 problèmes par jour à 30.

L'approche unique de chaque plateforme simplifie la prise de décision en fonction de vos besoins d'évaluation spécifiques. Voici comment ils se comparent en termes de méthodes d'évaluation, d'intégration et de déploiement :

La complexité de l'intégration joue également un rôle clé. La configuration basée sur un proxy de Braintrust est simple : il suffit de mettre à jour l'URL de base de votre API. Maxim AI s'intègre aux outils d'observabilité existants, tandis que l'intégration étroite de LangChain de LangSmith répond aux besoins d'observabilité spécialisés. Arize Phoenix se distingue des organisations qui privilégient la souveraineté des données, en proposant une solution open source auto-hébergée. Parallèlement, Prompts.ai fournit des contrôles de gouvernance de niveau entreprise et des pistes d'audit complètes pour un fonctionnement sécurisé.

__XLATE_111__

Pour des informations rapides, les déploiements basés sur proxy et les intégrations approfondies rationalisent le processus. Les utilisateurs de LangChain trouveront LangSmith un choix naturel, tandis que les organisations gérant des données sensibles peuvent se tourner vers des solutions open source comme Arize Phoenix ou Prompts.ai pour des capacités de gouvernance et d'audit robustes.

Sur la base des évaluations fournies, chaque plate-forme offre des avantages distincts pour affiner l'analyse des résultats LLM. Invites.ai offre aux entreprises un accès centralisé aux modèles de pointe, associé à des contrôles FinOps qui peuvent réduire les coûts de l'IA jusqu'à 98 %, tout en garantissant de solides capacités de gouvernance et d'audit. Confiance cérébrale est conçu pour les équipes d'ingénierie au rythme rapide, avec des entreprises comme Notion signalant une multiplication par 10 de la vitesse de développement, augmentant ainsi la résolution des problèmes de 3 à 30 par jour. De même, les équipes de Stripe et Airtable ont observé des gains de précision de plus de 30 % quelques semaines après l'adoption de la plateforme.

Pour ceux profondément intégrés dans l’écosystème LangChain, LangSmith offre une intégration sans effort et des options de prototypage rapides. Maxime IA s'adresse aux équipes qui se concentrent sur la gestion de systèmes multi-agents complexes, en proposant des outils de notation de précision et une passerelle à faible latence qui n'introduit que 11 microsecondes de surcharge à un volume de 5 000 requêtes par seconde. Entre-temps, Arize Phoenix est idéal pour les organisations donnant la priorité à la souveraineté des données, offrant une solution open source auto-hébergée qui s'intègre parfaitement aux systèmes d'observabilité existants.

Chaque plateforme répond à des défis critiques en matière de performances LLM et de gestion des coûts. Les entreprises étant confrontées à des pertes potentielles de 1,9 milliard de dollars par an en raison de défaillances non détectées du LLM en production, la nécessité d'aller au-delà des évaluations subjectives vers des mesures mesurables et basées sur les données est devenue essentielle pour garantir la fiabilité et l'efficacité.

Ces outils élèvent le développement LLM au rang de discipline d'ingénierie structurée. Que votre objectif soit de gérer des milliards d'événements chaque mois, de rationaliser la collaboration entre les équipes ou de maintenir le contrôle de l'infrastructure auto-hébergée, le choix de la bonne plateforme garantit que vos flux de travail LLM atteignent la fiabilité, la qualité et la rentabilité requises pour atteindre vos objectifs.

Ces plateformes sont conçues pour aider les organisations à réduire leurs dépenses en IA en proposant des outils permettant de surveiller et d'affiner l'utilisation des grands modèles de langage (LLM). Par exemple, des solutions telles que Prompts.ai permettent aux utilisateurs de suivre l'utilisation des jetons en temps réel, ce qui facilite la détection et la réduction de la consommation inutile de jetons. Cela permet d'éviter des dépenses excessives en appels d'API excessifs, ce qui conduit à une meilleure gestion des coûts.

Au-delà du contrôle des coûts, ces plateformes fournissent également des informations précieuses sur les performances et la qualité des résultats. Ils peuvent aider à détecter et à prévenir des problèmes tels que des hallucinations ou des erreurs, qui pourraient autrement entraîner des retouches coûteuses. En analysant les tendances d'utilisation et en identifiant les inefficacités, les organisations peuvent rationaliser les flux de travail, réduire les coûts opérationnels et garantir des résultats cohérents et de haute qualité. Tout cela prend en charge des décisions plus intelligentes et basées sur les données pour gérer efficacement les budgets d’IA.

Les plates-formes LLM offrent différentes manières de se connecter de manière transparente aux outils et aux flux de travail, répondant à différents besoins. De nombreuses plates-formes prennent en charge l'intégration native via des SDK tels que Python et JavaScript, ainsi que des frameworks tels que LangChain et LangServe. Cela rend l’intégration des LLM dans des applications personnalisées simple et efficace. Pour la surveillance, les plateformes prennent souvent en charge des standards ouverts comme OpenTelemetry, garantissant la compatibilité avec l'infrastructure existante.

Certaines plates-formes s'intègrent également aux outils CI/CD tels que GitHub Actions et Jenkins, simplifiant ainsi les processus de test et de déploiement. Pour les organisations qui privilégient le contrôle de leur environnement, des options d'auto-hébergement sont disponibles, permettant la personnalisation tout en préservant la sécurité des données. Ces fonctionnalités d'intégration permettent aux utilisateurs d'améliorer leur efficacité, de surveiller efficacement les performances et de mettre en œuvre des LLM en toute sécurité au sein de leurs opérations.

Pour ceux qui accordent une grande importance à confidentialité et contrôle des données, OnPrem.LLM offre une excellente solution. Conçue spécifiquement pour les tâches sensibles à la confidentialité, cette plate-forme permet aux grands modèles de langage (LLM) de gérer en toute sécurité les données confidentielles ou restreintes dans des paramètres hors ligne. En permettant une exécution entièrement locale, il réduit considérablement les risques d'exposition des données, tout en offrant également une intégration cloud en option pour les configurations hybrides lorsque cela est nécessaire.

Avec son interface intuitive et sans code, OnPrem.LLM garantit l'accessibilité aux utilisateurs sans expertise technique, tout en maintenant une supervision complète de la gestion des données. Cela en fait un choix idéal pour les organisations travaillant dans des secteurs réglementés ou sensibles où la protection des informations est une priorité absolue.