Orchestration de l’IA en 2026 est devenu une nécessité pour gérer des flux de travail complexes, coordonner des agents d'IA spécialisés et s'intégrer aux systèmes d'entreprise tels que les outils CRM, ERP et ITSM. Les entreprises exploitent désormais des plates-formes qui non seulement connectent plusieurs modèles d’IA, mais optimisent également les coûts, garantissent la conformité et offrent une évolutivité transparente. Avec plus 50% des entreprises censés adopter ces plateformes, la sélection du bon outil est devenue essentielle pour atteindre une efficacité opérationnelle et des résultats mesurables.

Chaque plateforme offre des atouts uniques, allant de la rentabilité à une gouvernance et une évolutivité avancées. Que vous automatisiez des flux de travail ou coordonniez des agents d'IA, ces outils permettent aux entreprises de faire évoluer leurs opérations tout en maintenant le contrôle et la sécurité.

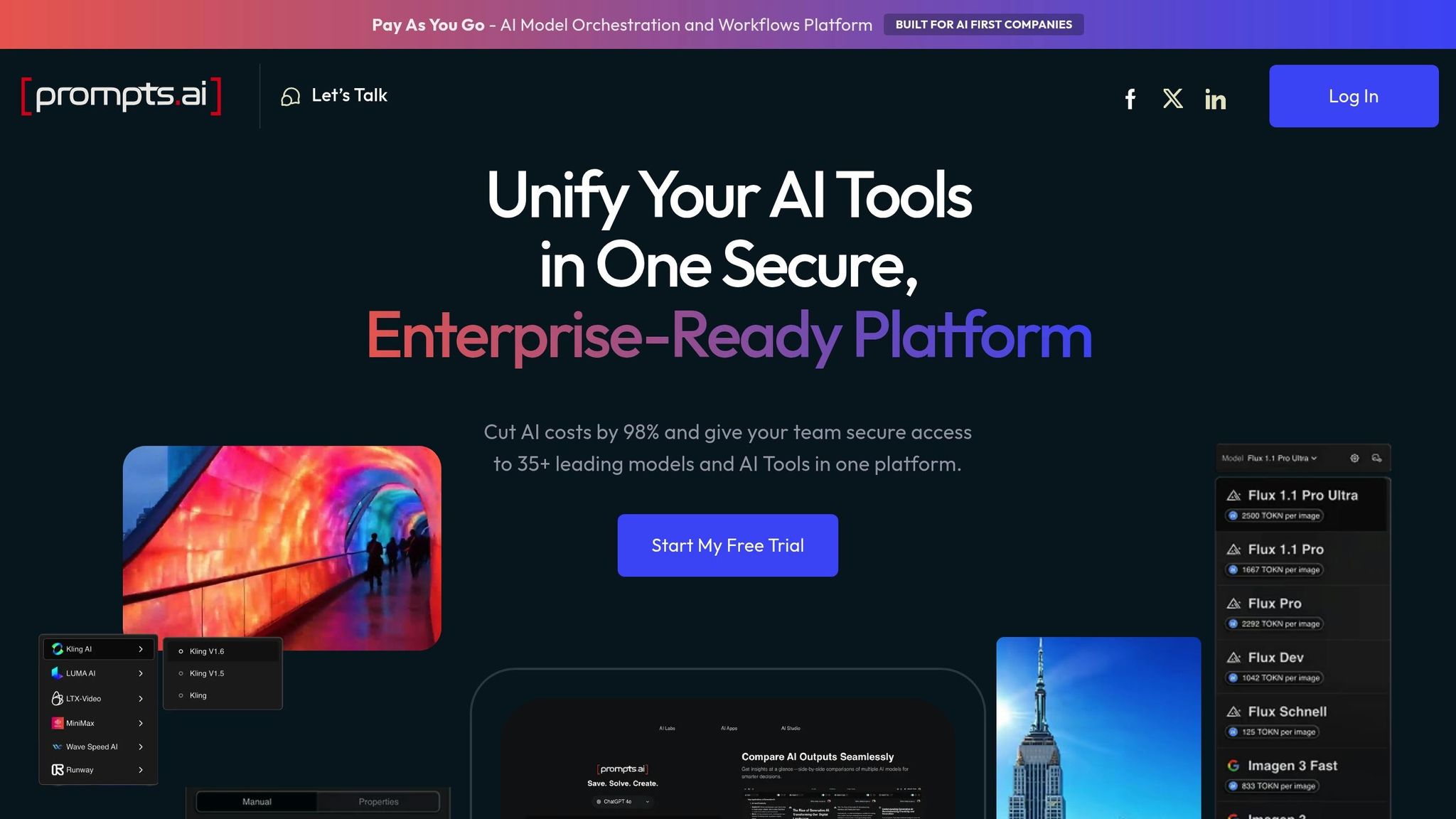

Prompts.ai rassemble 35 grands modèles linguistiques leaders - tels que GPT-5, Claude 4, LLaMA 3 et Gemini - en une plateforme unifiée et prête pour l'entreprise. Cette configuration simplifie l'automatisation du flux de travail, élimine le besoin de plusieurs outils et réduit considérablement les coûts des logiciels d'IA en jusqu'à 98%, tout en permettant aux utilisateurs de changer de modèle de manière dynamique en fonction de leurs tâches.

Le moteur d'inférence unifié de la plateforme s'intègre de manière transparente aux API natives pour plus de 50 grands modèles de langage. Cela permet un changement de modèle dynamique au sein des flux de travail sans nécessiter de modifications de code, réduisant ainsi la latence de jusqu'à 40% dans des pipelines multimodèles. Par exemple, Netflix a utilisé Prompts.ai pour automatiser 80 % de ses workflows de contenu, ce qui entraîne une Augmentation de 25 % de l'engagement. La conception plug-and-play permet aux équipes d'enchaîner des modèles pour une prise de décision en temps réel, optimisant ainsi les performances pour des besoins spécifiques. Cette approche améliore non seulement l’efficacité, mais permet également de réaliser des économies substantielles.

Prompts.ai utilise un modèle de facturation au paiement par jeton, avec des tarifs compris entre 0,0001 $ et 0,001 $ pour 1 000 jetons (USD). Son système d'inférence à mise à l'échelle automatique, combiné à une distillation modèle, réduit les coûts de 60%. De plus, les mécanismes de mise en cache empêchent les appels d'API redondants en réutilisant les réponses rapides. Un rapport Forrester de 2025 a souligné que les entreprises de taille moyenne utilisant des automatisations quotidiennes réduisaient leurs dépenses LLM de 50%. Par exemple, les entreprises traitant 1 milliard de jetons par mois économiser autour $10,000. Les projections de Gartner pour 2026 positionnent Prompts.ai comme un leader dans la réduction du coût total de possession de l'orchestration de l'IA.

Prompts.ai donne la priorité à la conformité de l'entreprise avec des fonctionnalités telles que contrôle d'accès basé sur les rôles (RBAC), Cryptage AES-256, et des journaux d'audit détaillés qui répondent SOC 2, RGPD et HIPAA normes. La plate-forme intègre également des garde-corps IA pour détecter les biais et filtrer la toxicité, bloquant ainsi 95% des émissions nocives dans des secteurs sensibles comme la finance. Des audits indépendants confirment ces capacités. Les experts de Gartner ont noté que les classificateurs de risque de Prompts.ai s'alignent sur les exigences à haut risque de la loi européenne sur l'IA, y compris les rapports de conformité automatisés qui enregistrent 100 % des inférences pour la traçabilité. Cette approche globale est essentielle pour éviter des amendes qui pourraient atteindre 7% du chiffre d'affaires annuel, garantissant une évolutivité sécurisée dans un environnement réglementé à l’échelle mondiale.

Avec l'orchestration Kubernetes et le déploiement sans serveur, Prompts.ai peut gérer plus d'un million d'inférences par seconde, répondant aux besoins des entreprises mondiales aux demandes variables. La plateforme soutient une communauté florissante de Plus de 200 000 développeurs et donne accès à Plus de 500 plugins GitHub (avec plus de 50 000 étoiles). D’ici 2026, la plateforme devrait capturer 25% du marché avec 5 millions d'utilisateurs, alimenté par Croissance de 300 % d'une année sur l'autre. VentureBeat rapporte que Prompts.ai sert déjà Plus de 1 000 entreprises clientes, avec des délais de mise en œuvre en moyenne inférieurs à 24 heures lors de l'utilisation de modèles de communauté et du tableau de bord sans code pour le prototypage de flux de travail. Cette combinaison d'évolutivité et d'engagement actif de la communauté positionne Prompts.ai comme un leader des solutions de flux de travail d'IA.

Plateforme B, dite LangGraph, organise les flux de travail de l'IA comme graphiques orientés, où chaque nœud représente une étape spécifique et les bords déterminent la séquence d'exécution. Cette conception permet des cycles, un traitement parallèle et un branchement conditionnel, ce qui la rend bien adaptée à la gestion de flux de travail complexes et itératifs. Il prend également en charge l'exécution dynamique et le raffinement continu dans les systèmes multi-agents.

LangGraph s'intègre à plus de 1 000 outils à travers l’écosystème LangChain. Il utilise un protocole d'agent ouvert, permettant une communication transparente entre les agents à travers des frameworks tels que CrewAI et Microsoft Agent Framework via des API standardisées. Début 2026, LangGraph a atteint v1.0 GA statut, marquant sa préparation pour une utilisation en production dans des environnements multi-agents.

LangGraph emploie un architecture hybride qui sépare le plan de contrôle de l'orchestration de l'environnement d'exécution. Cette configuration garantit aux utilisateurs de conserver un contrôle total sur leur infrastructure d'exécution et leurs données sensibles, tandis que LangGraph gère uniquement les métadonnées d'orchestration. La plate-forme n'accède jamais au code source du flux de travail ni ne traite les données réelles, protégeant ainsi les informations exclusives. De plus, toutes les métadonnées d'orchestration sont chiffrées pendant le transit et au repos, répondant ainsi aux normes de sécurité strictes requises par les secteurs réglementés. Cette approche favorise l'évolutivité et garantit des opérations tolérantes aux pannes.

The platform’s checkpointing feature stores workflow states in databases such as PostgreSQL ou Rédis, enabling recovery, human intervention, and in-depth debugging. LangGraph’s precise control over transitions and decision-making processes makes it particularly effective for agentic RAG pipelines that require explicit state management.

La plateforme C, connue sous le nom de Prefect, propose l'orchestration de l'IA via une architecture hybride qui sépare le contrôle de l'exécution. Bien que l'interface d'orchestration fonctionne comme un service géré, tous les flux de travail d'IA et le traitement des données restent au sein de votre infrastructure privée, qu'il s'agisse d'un VPC, de Kubernetes ou d'une configuration sur site. Cette approche donne la priorité aux déploiements sécurisés et à la souveraineté des données, garantissant que le code de flux de travail sensible, les clés API et les données de formation ne quittent jamais votre réseau.

Prefect se connecte aux systèmes d'IA à l'aide de son noyau open source, qui possède plus de 6 000 000 de téléchargements mensuels dès début 2026. Cette flexibilité permet aux équipes d’intégrer divers grands modèles de langage et outils d’IA tout en conservant un contrôle total sur l’exécution. Les travailleurs locaux gèrent l'orchestration via des connexions sortantes uniquement, éliminant ainsi le besoin d'accès entrant ou de ports de pare-feu ouverts.

Prefect est conçu en pensant à la sécurité de l'entreprise. Il tient Certification SOC 2 Type II, est conforme à RGPD, et est Prêt pour la HIPAA, ce qui le rend idéal pour des secteurs comme la finance et la santé. Les données restent chiffrées en transit (TLS 1.2+) et au repos avec des clés de chiffrement uniques pour chaque espace de travail. La plate-forme prend en charge RBAC, l'authentification unique (SSO) via SAML 2.0 ou OIDC et la synchronisation d'annuaire SCIM. De plus, il propose des journaux d'audit détaillés avec des périodes de conservation personnalisables pour surveiller l'activité des utilisateurs et les modifications du système.

__XLATE_83__

Ce cadre de sécurité complet prend en charge à la fois l’efficacité opérationnelle et l’évolutivité.

Prefect’s open-source base has garnered significant attention, with over 18 000 étoiles et 372+ contributeurs sur GitHub. Son évolutivité est évidente dans les applications du monde réel, telles que la mise en œuvre de Snorkel AI, qui a géré 1 000 flux par heure et des dizaines de milliers d'exécutions quotidiennes. Smit Shah, directeur de l'ingénierie chez Snorkel AI, a expliqué comment ils ont atteint un Amélioration du débit 20x tout en conservant un environnement Kubernetes auto-hébergé pour préserver le contrôle des données. Prefect fonctionne également sur GCP et AWS avec une haute disponibilité multi-AZ, ce qui en fait un choix solide pour les opérations d'IA à l'échelle de l'entreprise.

__XLATE_93__

__XLATE_94__

Cette section présente les atouts et les défis des principales plates-formes d'orchestration d'IA, en mettant en évidence leurs compromis en termes de fonctionnalité, de coût et de convivialité. À mesure que l’orchestration de l’IA continue d’évoluer, ces plates-formes reflètent des priorités de conception distinctes qui répondent à différents niveaux d’expertise technique et de besoins en matière de flux de travail. Les informations présentées ici s'appuient sur des discussions antérieures sur l'intégration de modèles, la gestion des coûts et l'évolutivité sécurisée.

LangGraph v1.0 offre un contrôle détaillé grâce à son exécution basée sur des graphiques et à la persistance de l'état, ce qui le rend bien adapté aux flux de travail de décision complexes. Cependant, la maîtrise de la plateforme nécessite généralement 2–3 weeks, ce qui peut constituer un obstacle pour les nouveaux utilisateurs. Son modèle de tarification par nœud, combiné à la prise en charge du protocole d'agent ouvert, garantit la compatibilité entre les frameworks.

n8n fournit un modèle de tarification rentable basé sur l'exécution, idéal pour les tâches répétitives d'IA. Il dispose d'une intégration native LangChain et prend en charge l'auto-hébergement pour protéger la confidentialité des données. Les équipes peuvent devenir compétentes dans 1–2 weeks, mais ses capacités au niveau de l'entreprise sont quelque peu limitées.

Temporel est devenue une solution incontournable pour « l'exécution durable des agents », excellant dans les scénarios qui impliquent des pauses humaines sur des périodes prolongées ou des tâches nécessitant une résilience aux redémarrages du serveur. OpenAI exploite Temporal for Codex en production, en particulier pour gérer les tâches avec état de longue durée. Son architecture événementielle garantit évolutivité et fiabilité, même si une mise en œuvre efficace nécessite un haut niveau d'expertise technique.

Ces comparaisons soulignent l'importance d'équilibrer des facteurs tels que le contrôle, le coût et la facilité d'utilisation pour s'aligner sur les besoins du projet.

| Plate-forme | Courbe d'apprentissage | Idéal pour | Modèle de tarification | Limite clé |

|---|---|---|---|---|

| LangGraph v1.0 | 2–3 weeks | Flux de travail de décision complexes | Paiement par nœud | Courbe d’apprentissage abrupte |

| n8n | 1–2 weeks | Opérations informatiques/utilisateurs expérimentés techniques | Basé sur l'exécution | Fonctionnalités d'entreprise limitées |

| Temporel | 1–2 weeks | Exécution d'agent durable | Basé sur l'utilisation | Exige des compétences techniques |

| CrewAI v1.8 | 1 semaine | Prototypage rapide | Coutume | Contrôle limité |

Les projets d'orchestration personnalisés nécessitent souvent 3–5 times more time que d'utiliser ces plateformes, ce qui rend le choix du bon outil essentiel pour respecter le calendrier et gérer efficacement les ressources.

Choose a platform that complements your team’s skills and fits your workflow requirements. LangGraph v1.0 est idéal pour gérer des flux de travail complexes qui exigent un contrôle d’état précis. n8n se distingue par sa tarification rentable basée sur l'exécution et ses capacités d'auto-hébergement, ce qui en fait un choix pratique pour les équipes d'exploitation informatique. Temporel excelle dans la gestion de flux de travail durables et critiques, garantissant la fiabilité même pendant les redémarrages du serveur ou les pauses prolongées. CrewAI v1.8 prend en charge le prototypage rapide en permettant aux équipes de définir des agents en fonction de rôles et d'objectifs spécifiques grâce à une collaboration basée sur les rôles.

Pour les entreprises soucieuses d'intégrer facilement de grands modèles de langage, des plates-formes telles que Substrat amazonien, LangChaîne, et Zapier fournir une connectivité robuste aux modèles de base et aux outils d’entreprise.

La création d'un système d'orchestration personnalisé nécessite souvent beaucoup plus de ressources que l'exploitation de plates-formes établies. Opter pour une solution qui équilibre la force technique avec une intégration fluide peut contribuer à accélérer les initiatives d’IA et à offrir des avantages commerciaux tangibles.

To select the most suitable AI orchestration platform, start by evaluating your team’s specific needs, such as the complexity of workflows, the number of LLMs in use, and your budget constraints. Focus on platforms that offer essential features like centralized model management, cost monitoring, and governance tools.

Platforms that enable workflow automation, ensure compliance, and allow for scalability should take priority. Ease of use is another critical factor - no-code tools are ideal for teams without technical expertise, while open-source platforms may better serve technical teams looking for customization. Lastly, confirm that the platform meets your organization’s security and compliance standards.

Before implementing AI and orchestration platforms, it’s critical to prioritize sécurité et conformité pour protéger les données et respecter la réglementation. Recherchez des fonctionnalités telles que le contrôle d'accès basé sur les rôles (RBAC), la surveillance en temps réel et le chiffrement des données au repos et en transit. Assurez-vous que la plateforme est conforme aux normes telles que le RGPD, la HIPAA ou le SOC 2. Des protections supplémentaires telles que les journaux d'audit, l'authentification multifacteur (MFA) et les intégrations d'API sécurisées sont essentielles pour maintenir l'intégrité opérationnelle et répondre aux exigences réglementaires.

Pour réduire les dépenses associées aux grands modèles de langage (LLM) tout en conservant leurs performances intactes, envisagez des stratégies telles que mise en cache rapide, ce qui élimine les traitements redondants, et routage du modèle, qui attribue des tâches à des modèles plus rentables. Des plateformes comme invites.ai simplifiez ce processus en offrant une gestion centralisée des modèles, un suivi des coûts en temps réel et une sélection dynamique de modèles. En intégrant ces méthodes, vous pouvez gérer efficacement les coûts tout en conservant des résultats de haute qualité.