En 2026, les plates-formes de flux de travail d'IA remodèlent le fonctionnement des entreprises, passant de la simple automatisation des tâches à des systèmes plus intelligents et axés sur la décision, alimentés par de grands modèles de langage (LLM). Ces outils rationalisent les opérations, réduisent les coûts et s'intègrent parfaitement aux écosystèmes technologiques existants, résolvant ainsi des problèmes tels que la prolifération des outils et le manque de compatibilité. Vous trouverez ci-dessous les principales plateformes qui mènent cette transformation :

Ces plateformes répondent à des besoins critiques tels que la rentabilité, l’évolutivité et la gouvernance, ce qui en fait des outils essentiels pour les entreprises qui naviguent dans un avenir axé sur l’IA.

Prompts.ai rassemble plus de 35 grands modèles de langage (LLM) - comme GPT-5, Claude, LLaMA, Gemini, Grok-4 et Flux Pro - dans une plateforme unique et sécurisée. Cela élimine les tracas liés à la jonglerie entre plusieurs abonnements, connexions et systèmes de facturation. Voici comment ses fonctionnalités simplifient les flux de travail de l'IA et améliorent la productivité.

Prompts.ai’s design allows users to switch between models effortlessly without reconfiguring workflows or managing separate API keys. This means you can directly compare GPT-5’s strengths to those of Claude or Gemini, then direct production tasks to the model that fits your needs best. Each model has unique strengths - some excel in creative tasks, while others are better suited for data analysis or coding. This flexibility ensures you always have the right tool for the job.

Au-delà de ses capacités d'intégration, Prompts.ai contribue à réduire les coûts grâce à son modèle de facturation simple et basé sur l'utilisation. En mettant en œuvre un système de suivi unifié pour l'utilisation des jetons, la plate-forme propose des crédits TOKN payants, éliminant ainsi le besoin de frais récurrents. De nombreuses organisations ont réduit leurs dépenses en logiciels d'IA jusqu'à 98 % en consolidant plusieurs outils sur cette plateforme unique et transparente.

Prompts.ai adapts to the needs of individuals, teams, and enterprises alike. Plans start at $29 per month for individual users, while enterprise plans range from $99 to $129 per member. There’s even a $99 Family Plan, recognizing that AI automation is increasingly valuable for both personal and professional use. This scalability ensures that users only pay for what they need, whether they’re automating workflows for a small team or an entire organization.

Pour les opérations en croissance, une gouvernance sécurisée est une priorité absolue. Prompts.ai est construit avec des fonctionnalités de niveau entreprise, fournissant une piste d'audit pour chaque interaction avec l'IA afin de répondre aux besoins de conformité. Les données sensibles restent au sein de l’organisation, évitant ainsi leur exposition à plusieurs services tiers. Les tableaux de bord en temps réel donnent aux administrateurs une visibilité sur les dépenses, le contrôle d'accès et la possibilité de lier directement les coûts de l'IA aux résultats commerciaux. Ces outils sont cruciaux pour maintenir la transparence et le contrôle des opérations basées sur l’IA.

Vellum AI adopte une approche différente en se concentrant sur l'orchestration des flux de travail natifs de l'IA plutôt que sur la simple automatisation de tâches individuelles. Il permet aux utilisateurs de décrire un processus dans un langage simple et la plateforme génère automatiquement la structure du flux de travail, éliminant ainsi le besoin de configuration manuelle des nœuds. Cette fonctionnalité « d'invite à créer » permet de gagner un temps considérable, en particulier pour les équipes qui expérimentent plusieurs concepts d'agents.

Grâce à sa conception indépendante du modèle, Vellum permet une commutation transparente entre les LLM pour équilibrer le coût, la vitesse et la qualité sans nécessiter une reconstruction complète du flux de travail. La plate-forme prend en charge des fonctionnalités avancées telles que la génération augmentée par récupération (RAG), le routage sémantique et l'orchestration d'agents en plusieurs étapes. Il permet aux utilisateurs d'enchaîner les invites, de sorte que la sortie d'un modèle devienne l'entrée d'un autre, permettant ainsi des pipelines de raisonnement complexes. Les outils de gestion de versions et d'évaluation intégrés facilitent le test et l'affinement des variantes d'invite.

Vellum est conçu pour rassembler les équipes techniques et non techniques. Les chefs de produit et le personnel opérationnel peuvent utiliser son générateur visuel pour créer des agents, tandis que les ingénieurs peuvent améliorer les flux de travail à l'aide d'une logique personnalisée avec les SDK TypeScript ou Python. Par exemple, RelyHealth a utilisé Vellum pour déployer des centaines d'agents de santé personnalisés, réduisant ainsi leur délai de déploiement de 100 fois. Max Bryan, vice-président de la technologie et du design, a partagé :

__XLATE_8__

Nous avons multiplié par 2 notre calendrier de 9 mois et obtenu une précision à toute épreuve grâce à notre assistant virtuel. Vellum a joué un rôle déterminant pour rendre nos données exploitables et fiables.

The platform’s strong governance features ensure that rapid deployment doesn’t compromise security.

Vellum offre une sécurité de niveau entreprise avec un contrôle d'accès basé sur les rôles (RBAC), une intégration SSO/SAML et des journaux d'audit immuables qui suivent chaque invite et sortie. Il est conforme aux normes SOC 2, GDPR, HIPAA et ISO 27001. Les options de déploiement incluent le cloud public, le VPC privé, les configurations sur site et même les environnements isolés pour les secteurs soumis à des réglementations strictes. Les portes d'approbation humaines permettent de suspendre les actions sensibles pour examen, garantissant ainsi la responsabilité. Notamment, 78 % des responsables opérationnels citent les outils d’explicabilité et de débogage comme facteurs critiques dans leurs décisions d’achat.

Le prix commence à 25 $/mois pour le forfait Pro, 79 $/utilisateur/mois pour les forfaits Business et une tarification Entreprise personnalisée pour des crédits illimités et une assistance dédiée.

Zapier connecte les tâches d'IA dans plus de 8 000 applications, gérant plus de 23 millions de tâches d'IA par mois pour plus d'un million d'entreprises. Les utilisateurs peuvent choisir parmi des fournisseurs LLM tels que GPT, Anthropic, Gemini et Azure OpenAI, ou opter pour des options gratuites intégrées telles que GPT-4o mini et Gemini 2.0 Flash. En remplaçant les flux de travail statiques par une prise de décision dynamique basée sur l'IA, Zapier offre une expérience d'automatisation plus adaptative.

La fonctionnalité Agents in Zaps de Zapier permet à l'IA de prendre des décisions sur la manière d'atteindre ses objectifs de manière autonome, en allant au-delà des flux de travail rigides. Ces agents peuvent effectuer des tâches telles que des recherches sur le Web, la rédaction de messages et la mise à jour de bases de données sans intervention manuelle. La plate-forme prend également en charge le traitement des images, de l'audio et de la vidéo directement dans les flux de travail. Grâce au connecteur Model Context Protocol (MCP), les développeurs peuvent intégrer de manière transparente des outils d'IA externes dans l'écosystème de plus de 8 000 applications de Zapier sans avoir besoin de configurations d'API complexes. Pour plus de contrôle, les étapes d'approbation humaines - telles que les évaluations basées sur Slack - permettent aux équipes de vérifier les actions générées par l'IA avant qu'elles ne soient finalisées, améliorant ainsi à la fois la précision et la confiance dans l'automatisation.

Zapier démontre sa valeur dans la mise à l'échelle des opérations grâce à des applications du monde réel. Par exemple:

Ces exemples montrent comment l’automatisation de l’IA peut générer de l’efficacité et un impact financier dans divers secteurs.

__XLATE_16__

"Zapier donne l'impression que notre équipe de trois personnes est une équipe de dix." - Marcus Saito, responsable de l'informatique et de l'automatisation de l'IA, Remote

Zapier adhère aux normes SOC 2 Type II, GDPR, GDPR UK et CCPA, avec des garanties pour garantir que les modèles d'IA tiers n'utilisent pas les données des clients à des fins de formation. La plate-forme propose des outils de gouvernance centralisés tels que Domain Capture pour une visibilité complète de l'utilisation, des contrôles d'application pour restreindre des intégrations d'IA spécifiques et des autorisations détaillées au niveau de l'équipe, de l'application et des données. Les mesures de sécurité incluent Enterprise SSO (SAML 2.0), SCIM, l'authentification à deux facteurs, la liste d'autorisation IP et le peering VPC pour une connectivité interne sécurisée. Les données sont protégées par des protocoles de cryptage et de transport de premier plan, garantissant la transparence des modifications du flux de travail. Le prix commence à 19,99 $/mois pour les forfaits Professionnel, à 69 $/mois pour les forfaits Équipe, avec des options de tarification personnalisées disponibles pour les forfaits Entreprise incluant un nombre illimité d'utilisateurs.

Connectez plus de 3 000 applications à l’aide d’un canevas visuel qui affiche vos flux de travail d’automatisation. Contrairement aux outils linéaires traditionnels, Make utilise une automatisation basée sur des scénarios, qui intègre une logique de branchement, des filtres et des flux de travail multi-chemins flexibles. Son constructeur visuel est particulièrement apte à gérer les transformations de données, grâce à des fonctionnalités telles que les itérateurs et les agrégateurs. Cela en fait un choix judicieux pour traiter de gros volumes de données sans nécessiter de compétences en codage.

Make fournit des modules natifs pour des outils populaires comme OpenAI (ChatGPT, DALL-E, Whisper) et Google Gemini, tout en prenant également en charge tout modèle compatible OpenAI via son module HTTP. En 2026, la plateforme a introduit Make AI Agents, des automatisations axées sur les objectifs qui sélectionnent de manière autonome les outils pour atteindre les objectifs définis. Ces agents exploitent les scénarios Make existants pour gérer les tâches sans intervention manuelle. De plus, Make fonctionne comme un serveur MCP (Model Context Protocol), permettant aux modèles d'IA externes, tels que Claude, d'exécuter en toute sécurité des scénarios Make en tant qu'outils pour des tâches du monde réel.

À l’avenir, l’assistant Make Maia permettra aux utilisateurs de créer des flux de travail complexes simplement en les décrivant en langage naturel. Cette fonctionnalité permettra de créer des automatisations de manière conversationnelle, réduisant ainsi le besoin de configuration pratique et simplifiant le processus pour les utilisateurs.

Make utilise un modèle de tarification basé sur les opérations, facturant par exécution de module plutôt que par flux de travail terminé. Le forfait Free comprend 1 000 opérations par mois et 2 scénarios actifs. Les forfaits payants commencent à 9 $/mois pour le forfait Core (10 000 opérations, scénarios illimités), 16 $/mois pour Pro (qui ajoute un support prioritaire) et 29 $/mois pour Teams (avec des fonctionnalités multi-utilisateurs). Des opérations supplémentaires peuvent être achetées pour environ 1 $ pour 1 000 opérations. Ce modèle peut être très économique pour les flux de travail complexes avec une logique de branchement, car vous ne payez que pour les modules exécutés. Cependant, les étapes d'IA peuvent consommer plusieurs crédits par exécution, en fonction de leur complexité.

Make’s pricing model and operational framework support scalability, from simple automations to enterprise-level workflows. The platform ensures data integrity with ACID transactions and offers tools for bulk data processing. It boasts a 99.9% infrastructure availability rate and average response times under 200ms for standard integrations. Examples of its scalability in action include:

__XLATE_23__

Le responsable des opérations de Teleclinic a déclaré : « Make nous a vraiment aidé à faire évoluer nos opérations, à éliminer les frictions de nos processus, à réduire les coûts et à soulager notre équipe d'assistance.

__XLATE_25__

Le directeur de l'exploitation de Shop Accelerator Martech a fait remarquer : « Cela génère une efficacité sans précédent au sein de notre entreprise d'une manière que nous n'avions jamais imaginée. Il s'agit d'avoir un employé supplémentaire (ou 10) pour une fraction du coût. »

The upcoming Make Grid feature, set to launch in 2026, will act as a "Command Center", providing a visual overview of an organization’s entire automation ecosystem. This tool will help teams identify bottlenecks and monitor workflow performance in real time.

Make adheres to SOC 2 Type II, GDPR, and SCIM standards, offering Single Sign-On (SSO) and a secure connection manager that stores API keys securely instead of embedding them directly in workflows. The "Scenario Run Replay" feature allows users to replay failed executions with the original data, speeding up troubleshooting processes. Enterprise plans include advanced governance options and dedicated support, though some users have noted that the platform’s role-based access control (RBAC) is less detailed compared to other enterprise solutions. To minimize risks, critical modules should include manual error-handling configurations to prevent silent data loss during API disruptions. For organizations with strict compliance needs, redirecting execution data to an external logging service may be advisable, as Make’s native logs are retained only for a limited time based on the plan.

n8n se distingue comme une plate-forme conçue pour les développeurs, offrant à la fois des options hébergées dans le cloud et auto-hébergées. Il fonctionne sur un modèle de tarification basé sur l'exécution, dans lequel une exécution de flux de travail équivaut à une exécution, quel que soit le nombre d'étapes qu'il comprend. Cela en fait un choix pratique pour gérer des flux de travail d’IA complexes et en plusieurs étapes sans les coûts plus élevés souvent associés à la tarification basée sur les tâches.

n8n fournit une intégration native de LangChain, permettant aux utilisateurs de créer des systèmes d'IA multi-agents avancés et des pipelines RAG (Retrieval-Augmented Generation) directement dans son éditeur visuel. Avec AI Agent Node, les LLM standards peuvent être transformés en agents axés sur des objectifs, capables d'utiliser des outils, de prendre des décisions et de conserver de la mémoire dans des flux de travail complexes. La plate-forme prend en charge une gamme de LLM, notamment OpenAI, Anthropic (Claude), Google Gemini, DeepSeek, Groq et Hugging Face, ainsi que des intégrations de bases de données vectorielles telles que pgvector, Pinecone, Chroma, Qdrant et Weaviate. Son AI Workflow Builder peut même convertir automatiquement les descriptions en langage naturel en flux de travail fonctionnels. En enchaînant les requêtes d'IA et en utilisant des modèles moins chers pour les étapes intermédiaires, les utilisateurs peuvent réduire les coûts des API de 30 à 50 %.

n8n’s execution-based pricing ensures affordability for even the most complex workflows. Technical users can access the self-hosted Community Edition for free, with unlimited workflows and executions. For cloud-hosted options, the Cloud Starter plan begins at $20/month for 2,500 executions, while Cloud Pro offers 10,000 executions for $50/month. For businesses, the self-hosted Business plan costs $800/month, offering advanced features, while Enterprise pricing is customized for organizations requiring features like advanced RBAC, SSO, and dedicated support. By charging per workflow execution instead of per step, n8n can save organizations over $500 per month on high-volume workflows compared to task-based pricing models.

n8n is built to handle up to 220 workflow executions per second per instance. Its Queue Mode leverages Redis to distribute execution across multiple worker processes, enabling horizontal scaling to meet increasing demands for fast and efficient AI workflows. For instance, in 2025, Dennis Zahrt, Director of Global IT Service Delivery at Delivery Hero, implemented a user management workflow that saved the company 200 hours each month. Similarly, Luka Pilic, Marketplace Tech Lead at StepStone, reported a dramatic improvement in efficiency, completing two weeks’ worth of API integration and data transformation work in just two hours.

__XLATE_29__

"Il me faut 2 heures maximum pour connecter les API et transformer les données dont nous avons besoin. On ne peut pas faire ça aussi vite dans le code." - Luka Pilic, responsable technique du marché, StepStone

n8n donne la priorité à la sécurité en s'intégrant à des gestionnaires de secrets externes tels qu'AWS Secrets Manager, Azure Key Vault, Google Cloud Platform, HashiCorp Vault et Infisical, garantissant ainsi que les informations d'identification sensibles restent hors de la plateforme. Pour les utilisateurs optant pour l'auto-hébergement via Docker ou Kubernetes, toutes les données, informations d'identification et journaux de flux de travail restent dans leur propre pare-feu, garantissant ainsi la conformité aux réglementations telles que HIPAA, GDPR et SOC 2. Les utilisateurs d'entreprise bénéficient d'un RBAC avancé via des « Projets », qui restreignent l'accès à des flux de travail et des informations d'identification spécifiques en fonction des rôles. De plus, le contrôle de source basé sur Git permet un mouvement sécurisé des flux de travail entre les environnements de développement, de préparation et de production.

Gumloop est une plate-forme spécialement conçue pour aider les équipes à exploiter facilement les grands modèles de langage (LLM). Au cœur de ce système se trouve Gummie, un assistant IA qui convertit les instructions en langage naturel en flux de travail pleinement fonctionnels. Cette capacité s’est avérée inestimable pour les organisations. Fidji Simo, PDG d'Instacart, a déclaré : « Gumloop a joué un rôle essentiel en aidant toutes les équipes d'Instacart - y compris celles sans compétences techniques - à adopter l'IA et à automatiser leurs flux de travail, ce qui a considérablement amélioré notre efficacité opérationnelle.

Gumloop supports model-agnostic workflows, allowing users to switch seamlessly between models like GPT-4o, Claude 3.7 Sonnet, Deepseek V3 R1, and Gemini 2.5 Pro within a single automation. Unlike many platforms that require users to manage API keys separately, Gumloop simplifies the process by including LLM costs in its subscription plans. The AI Router node intelligently assigns tasks to the right models, while the Model Context Protocol (MCP) server enables connections to custom APIs, extending the platform’s capabilities beyond its 125+ built-in nodes. This setup ensures predictable pricing and smooth integration.

Gumloop’s pricing structure is designed for flexibility and clarity:

En regroupant les coûts de l'API LLM dans ses plans d'abonnement plutôt que de facturer par tâche, Gumloop simplifie la budgétisation, permettant aux organisations de faire évoluer plus facilement leurs flux de travail d'IA sans dépenses imprévues.

Gumloop’s structure is designed to grow alongside organizations of any size. It uses a hierarchical approach, with Organizations providing centralized control and Workspaces enabling collaboration across departments like Sales, Marketing, and Operations. The platform also supports agentic workflows, where AI agents can assess tasks dynamically and trigger workflows based on context instead of following rigid sequences. Bryant Chou of Webflow remarked, "Gumloop wins time back across an org. It puts the tools into the hands of people who understand a task and lets them completely automate it away." Additionally, the platform’s ability to auto-scale and execute workflows in parallel ensures it can handle the demands of enterprise operations.

Gumloop donne la priorité à la sécurité et à la conformité pour répondre aux besoins de l'organisation. Il adhère aux normes SOC 2 et GDPR et comprend des outils pour un contrôle de niveau entreprise. Les administrateurs peuvent appliquer des listes d'autorisation/refus de modèles d'IA, garantissant ainsi la conformité aux réglementations telles que HIPAA en restreignant certains modèles ou fournisseurs. Le mode Incognito améliore la confidentialité en effaçant toutes les entrées, sorties et intermédiaires en temps réel. Les politiques de sécurité centralisées sont en outre prises en charge par des informations d'identification au niveau de l'organisation, qui remplacent les clés personnelles ou d'espace de travail pour empêcher tout accès non autorisé. Pour les organisations nécessitant une sécurité maximale, les déploiements VPC permettent à Gumloop de fonctionner au sein de leur propre infrastructure cloud. Une journalisation d'audit complète suit chaque action sur la plateforme, offrant une vue transparente du flux de données et des modifications administratives via un tableau de bord ou une API.

Lindy.ai se démarque dans le paysage de l'automatisation en créant des agents d'IA qui réfléchissent et s'adaptent au lieu de suivre des scripts rigides et prédéfinis. Grâce à son approche innovante de « codage dynamique », les utilisateurs peuvent décrire le comportement d'un agent dans un anglais simple, et la plateforme le transforme rapidement en une solution prête pour la production - parfois en seulement 5 minutes. Cela permet aux entreprises de réduire les tâches répétitives en déployant des agents dotés de mémoire et d'adaptabilité.

La plate-forme exploite GPT et Claude pour alimenter des agents capables d'analyser du texte, de générer des résultats et de comprendre l'intention de l'utilisateur. Contrairement aux outils d'automatisation traditionnels qui échouent face à des contextes changeants, les agents Lindy.ai utilisent la mémoire pour naviguer dans des scénarios complexes, y compris des cas extrêmes qui nécessitent souvent une intervention humaine. Avec la prise en charge de plus de 3 000 intégrations natives – et jusqu'à 7 000+ dans certaines configurations – Lindy.ai se connecte de manière transparente aux systèmes CRM, aux plateformes de messagerie et aux outils de calendrier. Le PDG Flo Crivello souligne cette capacité :

__XLATE_37__

Les flux de travail basés sur l'IA peuvent gérer ces cas extrêmes et s'adapter pour maintenir l'automatisation.

Sa fonctionnalité Autopilot améliore les fonctionnalités en fournissant aux agents leurs propres ordinateurs basés sur le cloud, leur permettant d'exécuter des tâches au-delà des intégrations API classiques. De plus, la coordination multi-agents permet à des agents spécialisés de collaborer sur des processus métier complexes, comblant ainsi le fossé entre l'automatisation et la prise de décision en temps réel.

Lindy.ai propose un modèle de tarification basé sur les tâches, facturant l'exécution des tâches plutôt que par utilisateur, ce qui en fait un choix économique pour les équipes ayant des demandes d'utilisation élevées. Les niveaux de tarification comprennent :

Les frais supplémentaires incluent les appels téléphoniques AI à 20 crédits par minute et les numéros de téléphone AI à 10 $ par numéro et par mois, offrant une flexibilité pour les tâches spécialisées.

Lindy.ai est conçu pour évoluer sans effort, s'adaptant à la fois aux utilisateurs individuels et aux grandes entreprises. Les comptes d'équipe permettent le partage et le déploiement sécurisés d'agents IA dans tous les départements, tandis que la fonctionnalité Agent Swarms permet à un seul agent de se cloner et d'effectuer des centaines de tâches simultanément, telles que la gestion de campagnes de sensibilisation personnalisées. Pour les flux de travail nécessitant de la précision, la fonctionnalité Human-in-the-Loop (HITL) permet à l'IA de gérer la majorité des tâches, mais de s'arrêter pour un examen humain aux points critiques, ce qui la rend idéale pour les opérations sensibles dans des domaines tels que la finance, les ressources humaines ou le support client.

Lindy.ai donne la priorité à la sécurité et à la conformité, en répondant à des normes rigoureuses telles que SOC 2, HIPAA, GDPR et PIPEDA. La plateforme comprend un centre de confiance et des outils de gestion des secrets pour répondre aux exigences de sécurité au niveau de l'entreprise. Grâce aux comptes d'équipe, les organisations peuvent configurer des autorisations et des contrôles pour garantir que les agents fonctionnent de manière sûre et prévisible. Pour les prestataires de soins de santé, Lindy.ai propose un outil de prise de notes conforme à la HIPAA, adapté à la documentation médicale, répondant aux besoins uniques des secteurs réglementés comme la santé et la finance.

StackAI fournit une plate-forme sans code qui relie les grands modèles de langage (LLM) aux données d'entreprise via un canevas visuel 2D intuitif. Les équipes commerciales peuvent facilement créer des flux de travail à l'aide d'outils de glisser-déposer, tandis que les développeurs ont la possibilité d'améliorer ces flux de travail avec des nœuds Python pour une personnalisation plus approfondie. En 2025, Stefan Galluppi, CIO de LifeMD, a utilisé StackAI pour simplifier les flux de travail complexes de l'IA, démontrant ainsi l'efficacité de la plateforme.

Cette conception conviviale prend en charge une intégration transparente avec les principaux LLM.

StackAI prend en charge nativement les principaux LLM, notamment OpenAI, Anthropic (Claude), Mistral, Google, Meta, Azure OpenAI et les modèles locaux via des points de terminaison. Son routage AI-Native introduit des nœuds logiques pour la prise de décision if/else et les invites dynamiques, permettant un routage automatisé des tâches basé sur les sorties LLM. Un nœud de base de connaissances intégré simplifie le processus de génération augmentée de récupération (RAG) en gérant le regroupement, l'intégration, l'indexation et la récupération avec des citations, couvrant 90 % des cas d'utilisation de RAG prêts à l'emploi.

La plate-forme excelle également dans le traitement des données non structurées, offrant des outils d'analyse PDF, de web scraping et d'OCR. Cela transforme les données brutes en informations structurées qui peuvent être déployées sous forme de chatbots, de formulaires Web, de processeurs par lots pour les tâches en masse ou d'API REST pour l'intégration back-end. Par exemple, au MIT Martin Trust Center, Doug Williams, Gen AI Lead, a créé des assistants IA pour les étudiants en quelques semaines seulement, révolutionnant leur expérience d'apprentissage sans nécessiter de compétences en codage. De même, Brian Hayt, directeur de BI chez Noblereach, a réduit le temps nécessaire pour générer des rapports entièrement cités pour les subventions et les recherches concurrentielles d'une semaine à seulement cinq minutes.

StackAI propose une structure tarifaire claire et flexible avec trois niveaux : un plan gratuit pour le prototypage précoce, un modèle SaaS basé sur l'utilisation pour les opérations de mise à l'échelle et un plan d'entreprise personnalisé adapté aux déploiements à grande échelle, y compris des options de cloud privé ou sur site.

Cette tarification flexible garantit que StackAI peut prendre en charge les utilisateurs à chaque étape, des prototypes à petite échelle aux applications d'entreprise.

La plateforme s'adapte aux besoins des particuliers et des entreprises, avec plus de 100 modèles prédéfinis pour un déploiement rapide. Les outils d'entreprise incluent le SSO, la protection par mot de passe, les domaines personnalisés et les analyses centralisées pour surveiller l'utilisation et les performances des jetons. Les développeurs peuvent étendre les flux de travail avec du code personnalisé ou des nœuds API, tandis que les utilisateurs non techniques bénéficient du constructeur visuel simple. Guillermo Rauch, PDG de Vercel, souligne son accessibilité :

__XLATE_51__

StackAI concrétise la promesse des agents IA. Pour tout le monde, à grande échelle, d’un simple pointer-cliquer.

Cet équilibre entre simplicité et fonctionnalités avancées fait de StackAI un outil puissant pour les organisations de toutes tailles.

StackAI donne la priorité à la sécurité avec un modèle de gouvernance à 8 couches qui comprend RBAC, des contrôles au niveau des dossiers, la gestion des versions de projet, le SSO, les connexions chiffrées, les analyses de production et l'AMF. La plateforme est conforme aux normes SOC 2 Type II, HIPAA et GDPR, avec une certification ISO 27001 en cours. Des fonctionnalités telles que la détection et la rédaction des informations personnelles, les politiques de conservation des données et un engagement strict à ne pas utiliser les données des utilisateurs pour la formation de modèles dans le cadre de contrats d'entreprise garantissent la confidentialité des données. Pour les secteurs ayant des exigences strictes en matière de résidence des données, tels que la défense et la finance, StackAI prend en charge les déploiements sur site et dans le cloud privé. De plus, les flux de travail d'approbation manuels garantissent qu'aucun agent IA n'est mis en service sans un examen approprié.

Cette approche globale de la gouvernance et de la sécurité fait de StackAI un choix de confiance pour les organisations appliquant des normes élevées de conformité et de confidentialité.

Pipedream is a platform designed with developers in mind, blending serverless infrastructure with AI-driven workflow automation. It’s trusted by over 1,000,000 developers, from small startups to Fortune 500 companies, handling billions of events and supporting data pipelines that process over 10,000,000 events per second. After being acquired by Workday in December 2025, Pipedream has strengthened its focus on enterprise-level stability and governance, giving developers more control and flexibility in automation. This foundation supports its advanced AI integration capabilities.

The platform’s code-centric design is a key feature, allowing developers to write custom Node.js, Python, Go, or Bash code directly within workflows. It also supports the use of any npm or PyPI package in a serverless environment. This flexibility makes it easier for developers to prototype quickly without the limitations often found in no-code platforms.

Pipedream intègre des outils d'IA tels que « Créer avec l'IA », « Modifier avec l'IA » et « Déboguer avec l'IA » - optimisés par String.com - pour aider les développeurs à créer, modifier et dépanner les flux de travail à l'aide d'invites en langage naturel et de corrections d'erreurs automatisées.

The platform supports the Model Context Protocol (MCP), which includes a Docs MCP Server. This feature enables AI assistants like Claude and development environments such as VSCode to search Pipedream documentation and generate precise integration code. Pre-built actions are available for popular LLMs like OpenAI and Claude, handling tasks such as text classification, summarization, and embeddings. Developers can also write their own code to interact with any LLM API using Pipedream’s serverless environment.

Pipedream utilise une structure tarifaire basée sur les crédits, dans laquelle 1 crédit équivaut à 30 secondes de temps de calcul.

Pour les entreprises, une tarification personnalisée est disponible avec des fonctionnalités supplémentaires telles que la conformité HIPAA et les journaux d'audit.

Pipedream est conçu pour l'évolutivité, offrant des fonctionnalités telles que la mémoire réglable, les délais d'attente personnalisés, les limites de débit et la gestion des démarrages à froid. Il prend en charge les modèles basés sur des événements et les déclencheurs en temps réel, ce qui le rend idéal pour le traitement de gros volumes de données et l'automatisation du back-end. Avec plus de 3 000 intégrations d’applications et une gestion intégrée de l’authentification, les équipes peuvent créer des flux de travail complexes sans se soucier de la gestion manuelle des informations d’identification.

Pour les équipes de développeurs, la plateforme fournit des outils tels que GitHub Sync, l'intégration de VS Code et le déploiement de serveurs MCP. Les notes d'étape permettent aux développeurs d'ajouter des explications basées sur les démarques directement aux étapes du flux de travail, améliorant ainsi la communication et la documentation de l'équipe.

Pipedream donne la priorité à la gouvernance et à la sécurité ainsi qu'aux performances. La plateforme est certifiée SOC 2 Type II, conforme à la HIPAA et répond aux normes GDPR. Il comprend un accord de traitement des données (DPA) pour la gestion des données sensibles. Les principales fonctionnalités de sécurité incluent :

Pour les utilisateurs d'entreprise, des options supplémentaires telles que SAML SSO, SCIM pour la gestion des identités et l'authentification à deux facteurs (2FA) sont disponibles. La journalisation d'audit est incluse dans le niveau Entreprise, fournissant des informations sur les exécutions et les modifications des flux de travail. De plus, les déclencheurs et actions disponibles à la source améliorent la transparence des examens de sécurité.

Workato is a platform designed to handle complex, cross-departmental processes for enterprises. It’s trusted by over 2,000 brands, including Broadcom, Zendesk, and Atlassian, to manage workflows that require high uptime and strict governance.

La plate-forme comprend le Workato Agentic & Genie Framework, qui utilise l'automatisation basée sur l'IA pour aller au-delà des capacités de base des chatbots. Ces agents d'IA spécialisés, appelés « Génies », peuvent récupérer des données, déclencher des actions sur plus de 8 500 applications et gérer des processus dynamiques. L'AI Connector, développé en collaboration avec Anthropic et OpenAI, exploite des modèles tels que Sonnet 4 d'Anthropic et GPT-4o mini d'OpenAI pour des tâches telles que l'analyse de texte, la rédaction d'e-mails, le résumé et la traduction.

At the heart of Workato’s AI capabilities is Workato Genie, which uses generative AI to interpret user intent, incorporate real-time enterprise data, and execute tasks autonomously. Bhaskar Roy, Chief of AI Products & Solutions at Workato, highlights its impact:

__XLATE_64__

« Avec Workato Agentic, les entreprises peuvent désormais créer et gérer rapidement des agents IA avec low-code/no-code pour booster la productivité et améliorer l'efficacité opérationnelle dans l'ensemble de leur organisation. »

Workato comprend également AIRO (AI Orchestrator), un assistant basé sur l'IA qui aide les utilisateurs à créer et à affiner des flux de travail en utilisant le langage naturel. Les actions d'IA préconfigurées offrent des fonctionnalités LLM intégrées, tandis que Agent Studio achemine les décisions sensibles aux humains via Slack ou Microsoft Teams pour approbation. Pour les espaces de travail clients, les actions du connecteur AI sont limitées à 60 requêtes par minute.

The platform offers pre-built applications known as Genie Apps, such as ITGenie for handling helpdesk tickets and SalesGenie to boost sales productivity. These Genies adapt based on user interactions, ensuring that learning remains specific to the customer’s environment to protect data privacy.

L'intégration de l'IA de Workato est associée à la capacité d'évoluer efficacement dans les grandes organisations.

Workato’s workflows are designed to scale across enterprises and mid-sized businesses, connecting with over 8,500 apps, databases, and ERP systems. With orchestration patterns capable of managing more than 850 billion actions, the platform also supports Data Pipelines for high-volume replication to data warehouses like Snowflake and Databricks. These pipelines use parallel execution and automatic schema updates to handle large datasets efficiently.

Les modèles de décision simplifient la logique métier complexe, telle que la tarification dynamique ou la notation des prospects, en stockant les règles dans des tableaux centralisés en dehors des flux de travail individuels. Cette approche simplifie l’audit et les mises à jour. Pendant ce temps, les tables de données - une mise à niveau des tables de recherche - stockent des ensembles de données beaucoup plus volumineux avec une fonctionnalité de recherche avancée.

Workato’s global infrastructure supports local data residency with data centers in the EU, Australia, and Singapore. The platform is available in eight languages, including Japanese, Korean, and Spanish, and maintains a 99.9% uptime SLA for critical operations. It has been recognized as a Leader in the Gartner® Magic Quadrant™ for iPaaS seven times, with two instances of being positioned furthest in "Vision" as of 2025.

Pour compléter son évolutivité, Workato donne la priorité à la gouvernance et à la sécurité.

Workato’s Enterprise MCP Gateway serves as a secure control layer between AI tools and business systems, enforcing policies and ensuring visibility during runtime. AI agents operate under user-specific OAuth credentials, limiting access to authorized data. Additional safeguards include PII masking and de-identification within workflows.

Les administrateurs peuvent définir des « compétences de confiance », qui sont des recettes ou des connecteurs pré-approuvés que les agents peuvent utiliser, empêchant ainsi les appels d'API non autorisés. RBAC 2.0 garantit des autorisations précises au niveau du projet, évitant ainsi une expansion inutile des rôles. La plate-forme comprend également des mesures de sécurité avancées telles que le cryptage BYOK, la rotation horaire des clés et l'isolation des conteneurs avec mTLS. Les certifications incluent la conformité SOC 2 Type II, ISO 27001, PCI DSS et RGPD.

Des pistes d'audit en temps réel et des approbations humaines garantissent la responsabilité de toutes les actions des agents. La fonctionnalité Examens et approbations rationalise le déploiement des recettes dans les environnements de développement, de test et de production. Une organisation a déclaré traiter les demandes de mutation d'employés 98 % plus rapidement grâce à Workato.

Workato suit un modèle de tarification axé sur l'entreprise, sans tarifs accessibles au public. La tarification est adaptée en fonction de facteurs tels que le nombre de tâches, l'utilisation avancée du connecteur et le nombre d'utilisateurs. Les petites entreprises dépensent généralement entre 500 et 3 000 $ par mois, les entreprises de taille intermédiaire entre 3 000 et 10 000 $ et les grandes entreprises dépassent souvent les 10 000 $ par mois pour les intégrations et le support personnalisés. La plateforme est conçue pour les organisations qui nécessitent une gouvernance avancée et une gestion de processus complexes.

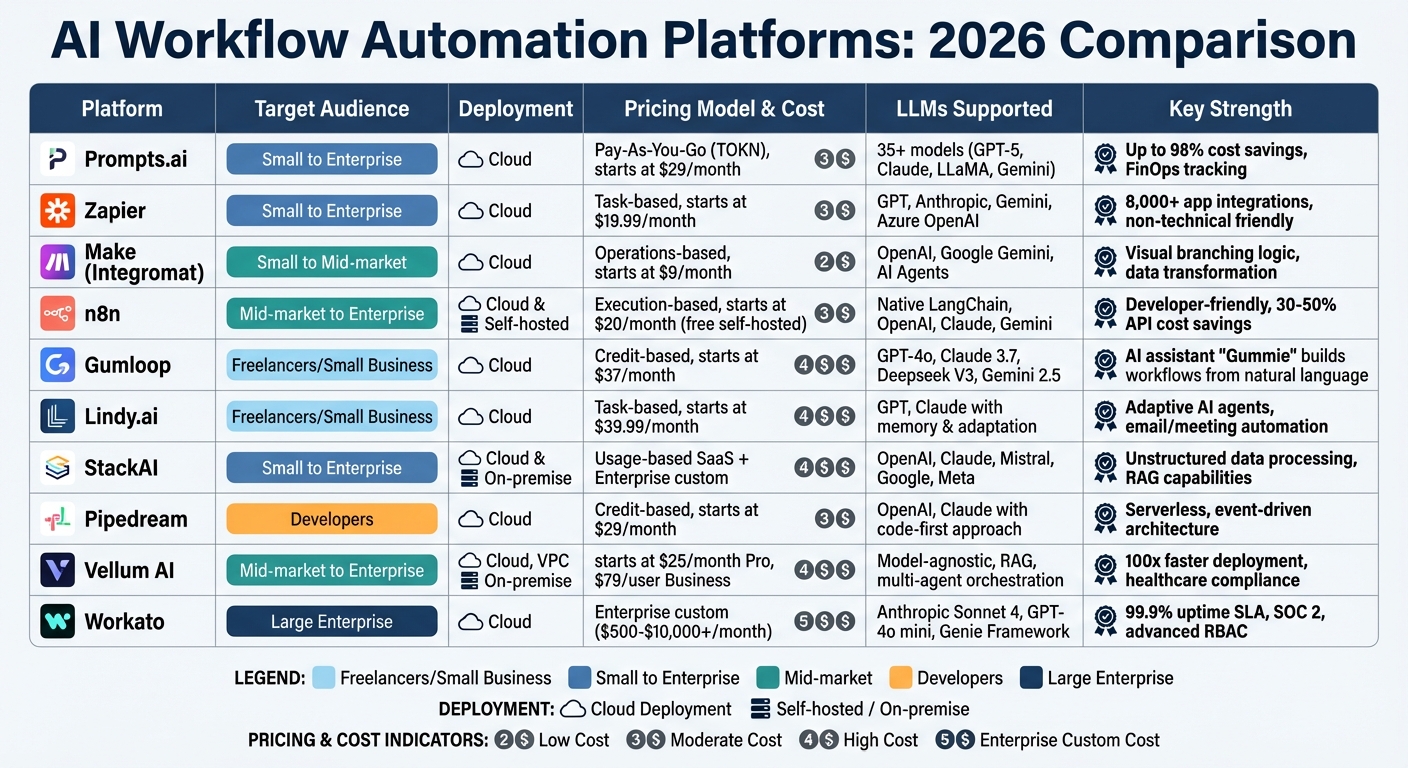

Comparaison de la plateforme AI Workflow : fonctionnalités, prix et fonctionnalités Public cible 2026

Choosing the right AI workflow platform depends on your team’s size, technical expertise, budget, and governance requirements. To simplify the decision-making process, the table below provides a side-by-side comparison of key features across various platforms.

Cette comparaison met en évidence la manière dont chaque plate-forme répond aux besoins spécifiques de l'entreprise, en équilibrant les modèles de tarification et la flexibilité de déploiement. Par exemple, n8n offre des coûts et une flexibilité prévisibles grâce à son option auto-hébergée gratuite, ce qui le rend attrayant pour les équipes techniques. En revanche, les plateformes comme Zapier privilégient la facilité d'utilisation pour les utilisateurs non techniques, mais peuvent devenir coûteuses en cas de volumes de tâches élevés.

Lors de l’examen des options de déploiement, la confidentialité des données est un facteur clé. Contrairement à la plupart des plates-formes uniquement cloud, n8n permet l'auto-hébergement, donnant aux équipes un contrôle total sur leur infrastructure. D'un autre côté, les solutions d'entreprise telles que Workato se concentrent sur une gouvernance et une conformité avancées, ce qui les rend idéales pour gérer des flux de travail sensibles et à volume élevé. Ces distinctions garantissent que les entreprises peuvent aligner les capacités de la plateforme sur leurs priorités opérationnelles.

Choosing the right AI workflow platform in 2026 requires aligning your team's technical skills with your organization’s scale and compliance needs. For non-technical teams, tools like Zapier or Lindy.ai offer intuitive, prompt-based environments. On the other hand, developer-heavy organizations often prefer platforms like n8n or Pipedream, which provide greater customization through code extensions. A key differentiator among these platforms is how they manage workflow maintenance, a theme that has been explored throughout this guide.

L'évolution de l'automatisation de base vers des flux de travail d'IA autonomes introduit de nouvelles exigences : gestion de la prise de décision sémantique, génération augmentée par récupération et orchestration multi-agents. Comme le dit Nicolas Zeeb :

__XLATE_77__

La voie à suivre en 2026 fait un grand pas en avant, passant du statut de discipline réservée au développement de l’automatisation de l’IA à celui d’un sport d’équipe.

Ce changement souligne l'importance des plates-formes alliant flexibilité technique et fonctionnalités de gouvernance, permettant aux ingénieurs et aux experts en la matière de collaborer efficacement. Ces défis soulignent l’importance des mesures de performance et de la transparence opérationnelle.

Les plates-formes prêtes pour la production se distinguent par des fonctionnalités telles que la journalisation en temps réel, le contrôle des versions et des structures de prix claires. Alors que 95 % des projets pilotes d’IA générative ne parviennent pas à passer en production en raison de limitations de l’infrastructure, les outils prenant en charge l’observabilité et la prévisibilité des coûts sont essentiels. De nombreuses organisations obtiennent des résultats au niveau de la production en 2 à 6 semaines en commençant par des pilotes ciblés, en intégrant le routage sémantique dès le début et en introduisant des tests de régression dès la troisième semaine.

Au-delà des capacités techniques, la conformité réglementaire et en matière de sécurité est cruciale pour l’adoption par l’entreprise. Des fonctionnalités telles que le contrôle d'accès basé sur les rôles (RBAC), la conformité SOC 2, les pistes d'audit et les options de déploiement flexibles garantissent que les plates-formes peuvent évoluer tout en répondant aux exigences réglementaires. Comme souligné précédemment, des plateformes telles que Prompts.ai et Workato intègrent efficacement ces contrôles pour répondre aux divers besoins des entreprises.

Alors que les agents d’IA pourraient apporter une valeur de 450 milliards de dollars d’ici 2028, seules 2 % des organisations les ont pleinement adoptés. Les plates-formes abordées dans ce guide constituent la base permettant de combler cette lacune, en transformant des expériences d'IA isolées en flux de travail évolutifs et mesurables qui font progresser la productivité.

En 2026, les plateformes de flux de travail d’IA apporteront des avantages révolutionnaires aux entreprises et aux professionnels. Ils simplifient l'automatisation des tâches complexes, améliorent l'efficacité des flux de travail et centralisent la gestion de divers modèles d'IA. Ces capacités entraînent d’importantes réductions de coûts et une productivité jusqu’à dix fois supérieure.

Au-delà de l’efficacité, ces plateformes s’attaquent à des problèmes urgents tels que la conformité, la sécurité et le défi de l’intégration de plusieurs outils. En unifiant les modèles d'IA et en automatisant les processus de gouvernance, ils garantissent le bon fonctionnement des opérations. Ils s'intègrent également sans effort aux grands modèles de langage avancés, permettant aux organisations de faire évoluer efficacement leurs opérations tout en gardant le contrôle et la surveillance de leurs flux de travail d'IA. Cette combinaison d'efficacité et de surveillance rend ces plates-formes essentielles pour accroître la productivité et maintenir des normes opérationnelles élevées.

Prompts.ai permet aux entreprises de réduire leurs dépenses tout en restant transparentes en offrant un suivi des coûts en temps réel et un modèle de tarification flexible par répartition. Ces outils permettent aux entreprises de surveiller de près leurs dépenses et de ne payer que pour les ressources qu'elles utilisent activement, garantissant ainsi que les dépenses restent prévisibles et adaptables.

En plus de cela, Prompts.ai met l'accent sur la sécurité et la conformité, avec les normes de conformité SOC 2 Type II et HIPAA. Ces mesures contribuent à réduire le risque de revers réglementaires coûteux. En combinant une gestion efficace des coûts avec de solides garanties de conformité, Prompts.ai aide les organisations à rationaliser leurs flux de travail sans faire face à des obstacles financiers inattendus.

Les plates-formes de flux de travail d'IA donnent la priorité à des protocoles de sécurité solides pour protéger les informations sensibles et respecter les réglementations du secteur. Les mesures clés incluent le cryptage pour protéger les données en transit et au repos, les contrôles d'accès basés sur les rôles pour gérer les autorisations des utilisateurs et la conformité avec des cadres tels que SOC 2 et RGPD.

De nombreuses plates-formes offrent également des fonctionnalités avancées telles que la détection des menaces en temps réel, la gestion sécurisée des clés et des certifications qui valident l'accent mis sur la sécurité. Ces outils contribuent à réduire les risques tels que les accès non autorisés, les violations de données et le vol de modèles d'IA, permettant aux entreprises de gérer en toute confiance les flux de travail basés sur l'IA.