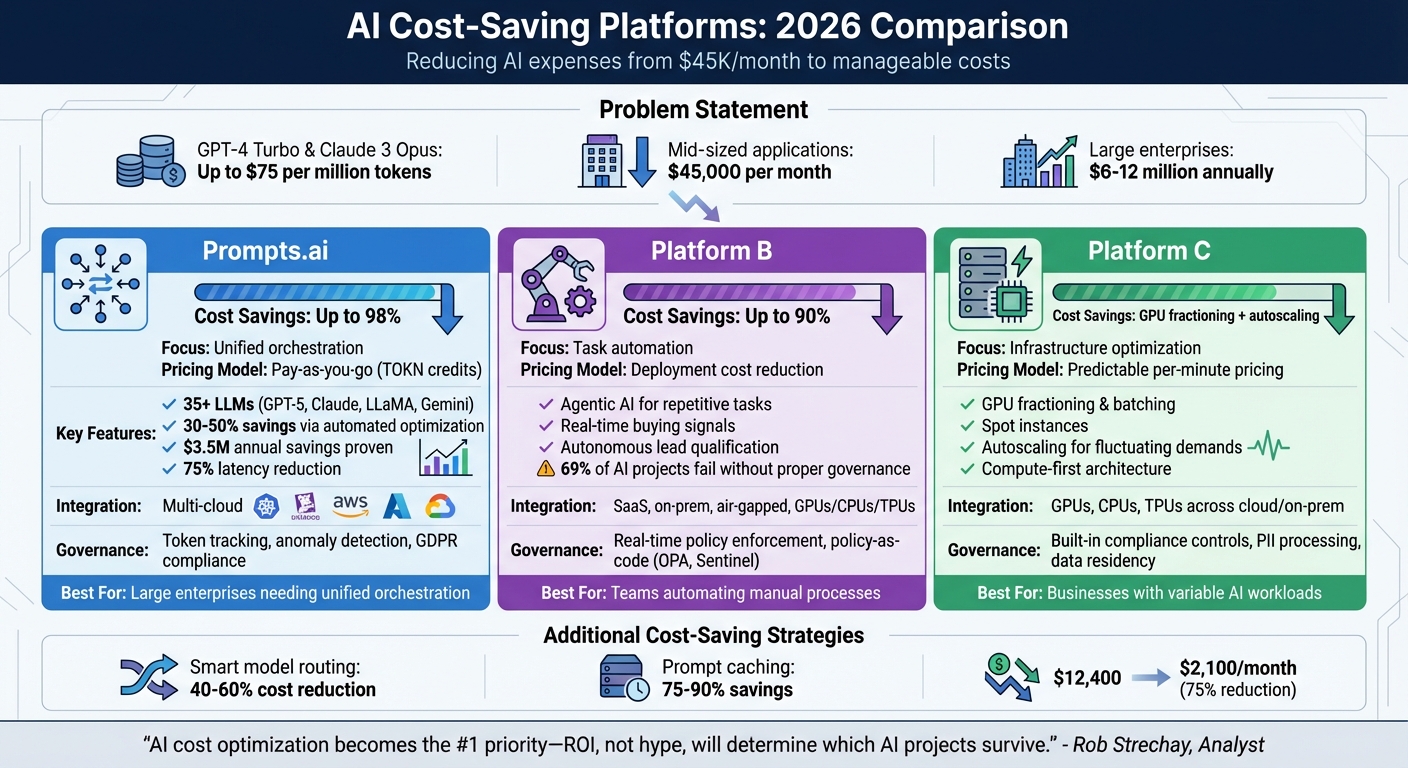

Para 2026, la gestión de los costes de la IA se habrá convertido en una máxima prioridad para las empresas. Con modelos como GPT-4 Turbo y Claude 3 Opus que cuestan hasta $75 por millón de tokens, los gastos pueden rápidamente salirse de control, alcanzando $45,000 por mes para aplicaciones de tamaño mediano y $6–12 million annually para grandes empresas. Para abordar esto, plataformas como Indicaciones.ai, Platform B y Platform C ofrecen soluciones para reducir costos mediante orquestación unificada, automatización y optimización de infraestructura. Las conclusiones clave incluyen:

Estas plataformas agilizan los flujos de trabajo, reducen los gastos y garantizan el cumplimiento, lo que ayuda a las empresas a mantener el rendimiento sin salirse del presupuesto.

| Característica/Plataforma | Indicaciones.ai | Plataforma B | Plataforma C |

|---|---|---|---|

| Ahorro de costos | Hasta 98% | Hasta 90% | Fraccionamiento de GPU, escalado automático |

| Enfocar | Orquestación unificada | Automatización de tareas | Optimización de infraestructura |

| Modelo de precios | Pago por uso (créditos TOKN) | Reducción de costos de implementación | Precios por minuto predecibles |

| Integración | Multinube, Kubernetes, Datadog | SaaS, local, aislado | GPU, CPU, TPU |

| Gobernancia | Seguimiento de tokens, detección de anomalías | Aplicación de políticas en tiempo real | Controles de cumplimiento integrados |

Choosing the right platform depends on your organization’s needs, whether it's reducing costs, improving workflows, or managing compliance effectively.

__XLATE_9__

Prompts.ai reúne más de 35 de los modelos de lenguajes grandes más avanzados, como GPT-5, Claude, LLaMA y Gemini, en una plataforma de orquestación unificada. Al eliminar la necesidad de suscripciones y contratos con múltiples proveedores, permite a las organizaciones reducir los costos de software de IA hasta en un 98%. La plataforma opera con un sistema de pago por uso que utiliza créditos TOKN, lo que garantiza que los usuarios solo paguen por lo que usan, sin tarifas mensuales recurrentes.

Prompts.ai delivers 30–50% savings through automated resource optimization, which adjusts compute, storage, and network resources to the exact needs of the organization. Proven implementations have shown annual savings of $3.5 million by applying these optimizations to AI training and inference workloads. The platform’s FinOps layer provides detailed cost tracking, allowing teams to pinpoint anomalies and fine-tune spending at a granular level - whether by token, inference, or API call.

Los controles de costos en tiempo real ayudan a evitar excesos presupuestarios al establecer límites de gasto para equipos y proyectos. El escalado automatizado de GPU durante las horas pico y de menor actividad reduce la latencia hasta en un 75 %, al tiempo que reduce los gastos del servicio de IA en la nube. Para las canalizaciones basadas en Kubernetes, Prompts.ai automatiza el uso de instancias puntuales y la programación de cargas de trabajo, empaquetando cargas de trabajo de manera eficiente en instancias rentables sin comprometer el rendimiento del modelo. Sus capacidades de integración perfecta también garantizan la compatibilidad con la infraestructura existente.

Prompts.ai se conecta sin esfuerzo con plataformas como AWS, Azure, Google Cloud, Kubernetes, AWS Lambda, Amazon EC2, Snowflake y Datadog, lo que permite flujos de trabajo fluidos en su configuración actual. Admite flujos de datos en tiempo real para modelos de lenguaje grandes y automatiza el aprovisionamiento, lo que facilita a los desarrolladores la integración de herramientas de monitoreo como Datadog o la escala de puntos finales de inferencia durante picos de tráfico. Estas integraciones no solo mejoran la asignación de recursos sino que también minimizan los gastos operativos. Al permitir comparaciones de modelos en paralelo, los equipos pueden seleccionar la opción más rentable para sus necesidades, mientras que los flujos de trabajo unificados eliminan la molestia de tener que hacer malabarismos con múltiples herramientas.

Más allá del ahorro de costos y la integración, Prompts.ai incluye herramientas de gobernanza que garantizan un seguimiento preciso de los costos y el cumplimiento de los estándares regulatorios. Funciones como el etiquetado virtual para la asignación de costos y la detección de anomalías basada en aprendizaje automático funcionan sin requerir cambios en la infraestructura existente. La plataforma admite modelos de presentación y cumple con regulaciones como GDPR en entornos de múltiples nubes, lo que garantiza una gestión de costos auditable. Cada interacción de IA se registra, lo que brinda a las empresas una visibilidad completa del uso del modelo, las actividades del equipo y la gestión de datos.

Prompts.ai está diseñado para manejar cargas de trabajo de IA en crecimiento con facilidad y admite configuraciones de múltiples nubes que escalan sin esfuerzo. Las organizaciones pueden incorporar nuevos modelos, usuarios y equipos en solo minutos sin interrumpir los flujos de trabajo actuales. Su arquitectura está diseñada para implementaciones a nivel empresarial, capaz de gestionar más de 100.000 cambios de producción manteniendo un rendimiento constante. Esto la convierte en una solución ideal para empresas que pasan de proyectos piloto a pequeña escala a operaciones de IA a gran escala en varios departamentos.

La Plataforma B está diseñada para reducir los costos de la IA al hacerse cargo de tareas repetitivas mediante la automatización. En lugar de concentrarse únicamente en ajustes de infraestructura, utiliza IA agente para manejar actividades que requieren mucho tiempo, como investigación, entrada de datos y actualizaciones de CRM. Esto permite a los equipos centrarse en un trabajo más impactante y al mismo tiempo reducir los costos operativos.

Al automatizar los procesos manuales, la Plataforma B reduce significativamente los gastos. Su IA agente funciona de forma autónoma, reaccionando a señales de compra en tiempo real en lugar de depender de guías rígidas. Esto le permite identificar clientes potenciales calificados y elaborar mensajes personalizados de manera efectiva. Las empresas que utilizan este sistema han informado de una caída de hasta el 90 % en los costes de implementación de la IA[3].

La Plataforma B actúa como un centro de control centralizado para gestionar cargas de trabajo de IA en varias infraestructuras, incluidas plataformas SaaS, VPC en la nube, sistemas locales e incluso entornos aislados. Compatible con GPU, CPU y TPU, no requiere configuraciones especializadas. La plataforma se integra perfectamente con las herramientas de IA existentes a través de una interfaz de usuario, un SDK y una CLI intuitivos, lo que facilita la creación y configuración de modelos. Este enfoque permite a las organizaciones mejorar sus configuraciones actuales sin la necesidad de realizar grandes cambios en la infraestructura.

La plataforma garantiza el cumplimiento al automatizar la recopilación de pruebas y hacer cumplir las políticas en tiempo real en todos los entornos de nube. Utilizando herramientas de políticas como código como OPA, HashiCorp Sentinel y AWS Config, integra la gobernanza en los canales de CI/CD e IaC. La detección de deriva automatizada compara la infraestructura activa con los estados declarados, señalando y abordando recursos no administrados o problemas de seguridad. Cada artefacto del modelo está vinculado a su confirmación de Git y al ID del plan de Terraform, lo que crea un seguimiento de auditoría detallado. Dado que el 69 % de los proyectos de IA no logran implementarse debido a obstáculos de integración y gobernanza[3], estas características ayudan a evitar acciones no autorizadas y mantener los estándares regulatorios.

La Plataforma B proporciona un plano de control unificado para gestionar configuraciones de IA de múltiples nubes. Simplifica el escalado al estandarizar los roles y el etiquetado de IAM mientras utiliza bucles de reconciliación para optimizar los recursos para cargas de trabajo en crecimiento. Dado que el 94% de las organizaciones considera que la orquestación de procesos es clave para el éxito de la IA[3], este sistema optimizado admite la ampliación desde pequeños pilotos hasta implementaciones empresariales a gran escala sin agregar complejidad innecesaria. Su enfoque centralizado garantiza la preparación para medidas de ahorro de costos a medida que se expanden las operaciones.

La Plataforma C se centra en reducir costos optimizando la capa de infraestructura. emplea Fraccionamiento y procesamiento por lotes de GPU para aprovechar al máximo los recursos de la GPU. Al agrupar varias cargas de trabajo, aumenta el rendimiento, lo que garantiza que las empresas solo paguen por los recursos que utilizan activamente, en lugar de mantener la capacidad no utilizada.

Esta plataforma reduce gastos a través de instancias puntuales y escalado automático. El escalado automático minimiza los recursos informáticos durante los períodos de inactividad, lo que es ideal para empresas con demandas fluctuantes de IA. En lugar de depender de costosos precios por token, ofrece una modelo de precios por minuto predecible, lo que hace que los costos sean más manejables a medida que aumenta el uso. Además, al colocar la inferencia de GPU con puntos de presencia de telecomunicaciones, se elimina la necesidad de múltiples proveedores externos, lo que simplifica la integración y reduce los costos asociados. Estas características se alinean con una estrategia de implementación flexible para adaptarse a diversas necesidades comerciales.

La plataforma C utiliza un arquitectura de computación primero que admite la implementación en GPU, CPU y TPU. Su plano de control unificado permite una orquestación perfecta de cargas de trabajo de IA en plataformas SaaS, VPC en la nube, configuraciones locales e incluso entornos aislados, todo sin depender de un proveedor. Este enfoque permite a las organizaciones aprovechar su infraestructura existente mientras acceden a una biblioteca de modelos y flujos de trabajo prediseñados. La plataforma agiliza las operaciones al eliminar la necesidad de configuraciones complejas.

La plataforma incluye controles integrados para manejar tareas como el procesamiento de PII, el consentimiento de grabación de llamadas y los requisitos de residencia de datos. Su arquitectura de pila unificada simplifica el cumplimiento al mantener los estándares regulatorios sin agregar complejidad adicional. Al consolidar las funciones de gobernanza en una única plataforma, las empresas pueden satisfacer las necesidades de cumplimiento de manera eficiente y mantener los costos bajo control.

Al seleccionar una plataforma, es esencial sopesar las ventajas y desventajas para aprovechar al máximo su inversión en IA. Basándose en estrategias anteriores de ahorro de costos, esta sección examina áreas clave en las que difieren las plataformas.

Reducción de costos: Smart model routing can cut costs by 40–60% by diverting simpler queries to more affordable models, such as DeepSeek or Gemini Flash. Additionally, using prompt caching for repetitive tasks can save 75–90%. For example, in late 2025, a team reduced their monthly expenses by 75%, dropping from $12,400 to $2,100 by routing queries to cost-efficient models.

Capacidades de integración: Platforms offering extensive connectors - some supporting over 70 vector databases and 100+ data ingestion sources - are highly adaptable to existing systems. However, these abstract layers may introduce 15–25% latency compared to direct model calls, which could be a concern for real-time applications.

__XLATE_35__

Gobernanza y cumplimiento: Para industrias con regulaciones estrictas, las plataformas que incluyen pistas de auditoría, herramientas de explicabilidad y controles de residencia de datos son vitales. La decisión a menudo se reduce a equilibrar la flexibilidad con el control. Las soluciones autohospedables brindan mayor privacidad pero exigen más experiencia técnica, mientras que las plataformas SaaS ofrecen conveniencia al costo potencial de la soberanía de los datos. Estas consideraciones de gobernanza afectan significativamente la escalabilidad en el uso práctico.

Escalabilidad: Los modelos de precios basados en la ejecución suelen ser más económicos para flujos de trabajo complejos de IA a medida que aumentan las cargas de trabajo, mientras que características como la persistencia del estado y la ejecución duradera, utilizadas por OpenAI para Codex en producción, permiten a los agentes gestionar tareas de larga duración sin perder el contexto. Por el contrario, los marcos más pequeños son más adecuados para implementaciones perimetrales, incluso si carecen de algunas características de nivel empresarial.

En última instancia, el éxito en 2026 dependerá de qué tan bien alinee las capacidades de la plataforma con sus necesidades específicas en términos de costo, integración, cumplimiento y escalabilidad.

__XLATE_41__

- __XLATE_113__

Choosing the right platform to maximize cost savings and streamline operations in 2026 depends heavily on your organization’s size and specific needs. The strategies discussed - ranging from unified orchestration to intelligent model routing - are key for platforms designed to support seamless AI workflows. For large enterprises, orchestration layers offering centralized governance, token tracking, and vendor management are essential for coordinating multiple teams and maintaining compliance. On the other hand, small to mid-sized businesses often find greater value in using smaller, specialized models and tools tailored to specific tasks, like invoice processing or demand forecasting, without the complexity of large-scale integrations.

El control de costos sigue siendo una fuerza impulsora detrás de la eficiencia operativa. Como dice Rob Strechay, analista, "la optimización de costos de la IA se convierte en la prioridad número uno: el retorno de la inversión, no las exageraciones, determinará qué proyectos de IA sobrevivirán". Estas estrategias de optimización allanan el camino para enfoques personalizados que se adaptan a organizaciones de todos los tamaños.

For smaller teams, immediate savings can be achieved with prompt caching and straightforward model routing. High-volume operations, however, gain more from advanced techniques like semantic caching and intelligent routing, which ensure premium models are reserved for complex tasks. Enterprises managing large-scale AI initiatives require robust governance tools - such as budget alerts, audit trails, and token approval systems - to keep spending under control. Notably, while technology accounts for only 20% of an AI initiative’s value, redesigning workflows delivers the remaining 80%, making operational adjustments equally critical.

En una era en la que la rentabilidad no es negociable, la adopción de la soberanía de la IA (ejecutar modelos en infraestructura privada) ofrece a las organizaciones una forma de reducir gastos y al mismo tiempo proteger los datos confidenciales. Las plataformas que prosperarán en 2026 serán aquellas que se integren perfectamente con los flujos de trabajo operativos, generando ahorros de costos reales y al mismo tiempo manteniendo los estándares de rendimiento y cumplimiento.

Prompts.ai ayuda a las empresas a reducir los gastos de IA a través de enrutamiento rápido inteligente y optimización del flujo de trabajo. Al dirigir tareas más simples a modelos menos costosos y reservar modelos avanzados para trabajos más exigentes o críticos, este enfoque ayuda a reducir las tarifas basadas en tokens. En promedio, las empresas han reportado ahorros de aproximadamente el 6,5%.

La plataforma también incluye herramientas como seguimiento de costos en tiempo real, acceso a más de 35 modelos de IA y enrutamiento basado en reglas para simplificar los procesos. Funciones como API unificadas para administrar múltiples proveedores y estrategias de almacenamiento en caché que reutilizan resultados anteriores ayudan a minimizar aún más el consumo de recursos y los costos. Estas herramientas garantizan que los flujos de trabajo de IA sigan siendo eficientes y rentables, manteniendo al mismo tiempo un alto rendimiento.

Prompts.ai brilla con su Herramientas de orquestación centradas en la IA, diseñado para optimizar los flujos de trabajo en una variedad de modelos, conjuntos de datos y aplicaciones de IA. Sus características destacadas incluyen seguimiento de costos en tiempo real and adherence to strict security standards such as SOC 2 Type II and HIPAA. With support for over 35 AI models, it’s a strong option for businesses aiming to enhance AI-driven operations while keeping costs and security in check.

Por el contrario, otras plataformas suelen abordar objetivos de automatización más amplios. Algunos sobresalen en automatización sin código, que ofrece amplias integraciones de aplicaciones que atienden a equipos no técnicos que gestionan diversos flujos de trabajo. Otros priorizan gestión segura del flujo de trabajo de IA, centrándose en reducir la dispersión de herramientas, simplificar procesos y proporcionar una visibilidad detallada de los costos.

Prompts.ai es particularmente adecuado para empresas que necesitan Soluciones de flujo de trabajo de IA eficientes, seguras y económicas, mientras que las plataformas alternativas podrían servir mejor a aquellos con requisitos de automatización general o de cumplimiento de nichos específicos.

La gobernanza y el cumplimiento desempeñan un papel crucial a la hora de seleccionar la plataforma de IA adecuada para ahorrar costes. Garantizan que sus flujos de trabajo de IA cumplan con los estándares legales, éticos y organizacionales, lo cual es clave para proteger datos confidenciales, evitar multas y mantener la confianza.

Un marco de gobernanza sólido permite a las empresas supervisar y gestionar las operaciones de IA de manera eficiente. Garantiza que se sigan las políticas mientras se mantienen los costos bajo control. Este enfoque reduce el riesgo de uso indebido de recursos y alinea las iniciativas de IA con los objetivos empresariales y las demandas regulatorias. Al priorizar la gobernanza, las organizaciones pueden mitigar los riesgos y al mismo tiempo lograr una mayor eficiencia y ahorro de costos.