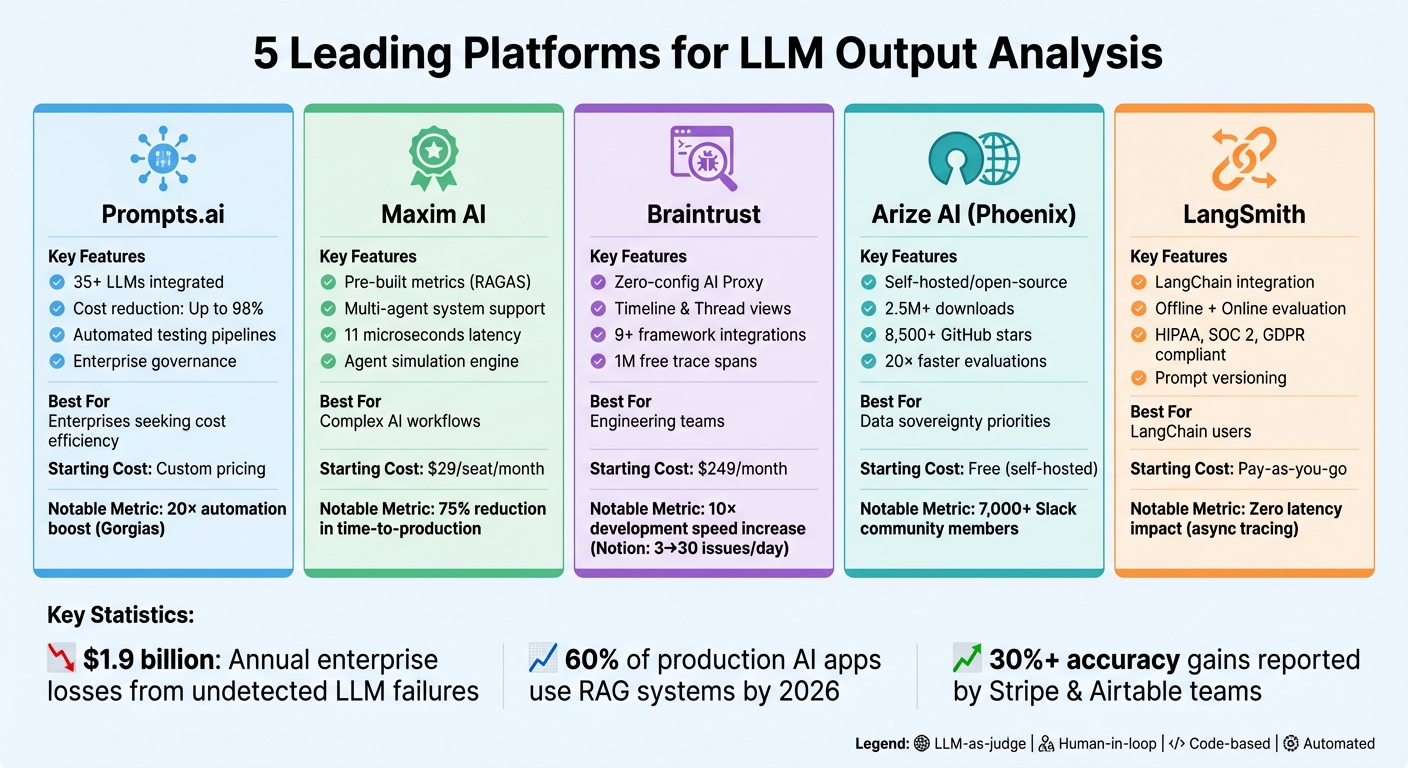

Los modelos de lenguaje grande (LLM) son poderosos pero impredecibles y a menudo producen resultados inconsistentes o costosos. Para abordar estos desafíos, las organizaciones dependen de herramientas especializadas para la evaluación, el seguimiento y la gestión de costos. Este artículo presenta cinco plataformas que agilizan el análisis de resultados de LLM:

Cada plataforma aborda aspectos únicos de los flujos de trabajo de LLM, desde mejorar la precisión hasta reducir costos y garantizar el cumplimiento.

| Plataforma | Características clave | Mejor para | Costo inicial |

|---|---|---|---|

| Indicaciones.ai | Acceso centralizado a LLM y herramientas FinOps que ahorran costos | Empresas que buscan rentabilidad | Precios personalizados |

| Máxima IA | Métricas prediseñadas, soporte de sistema multiagente | Equipos que gestionan flujos de trabajo complejos de IA | $29/asiento/mes |

| Confianza cerebral | Herramientas de depuración, pruebas de conversación de varios turnos | Equipos de ingeniería | $249/mes |

| Arize AI | Controles de alucinaciones y rastreo detallado de código abierto | Organizaciones que priorizan el control de datos | Gratis (autohospedado) |

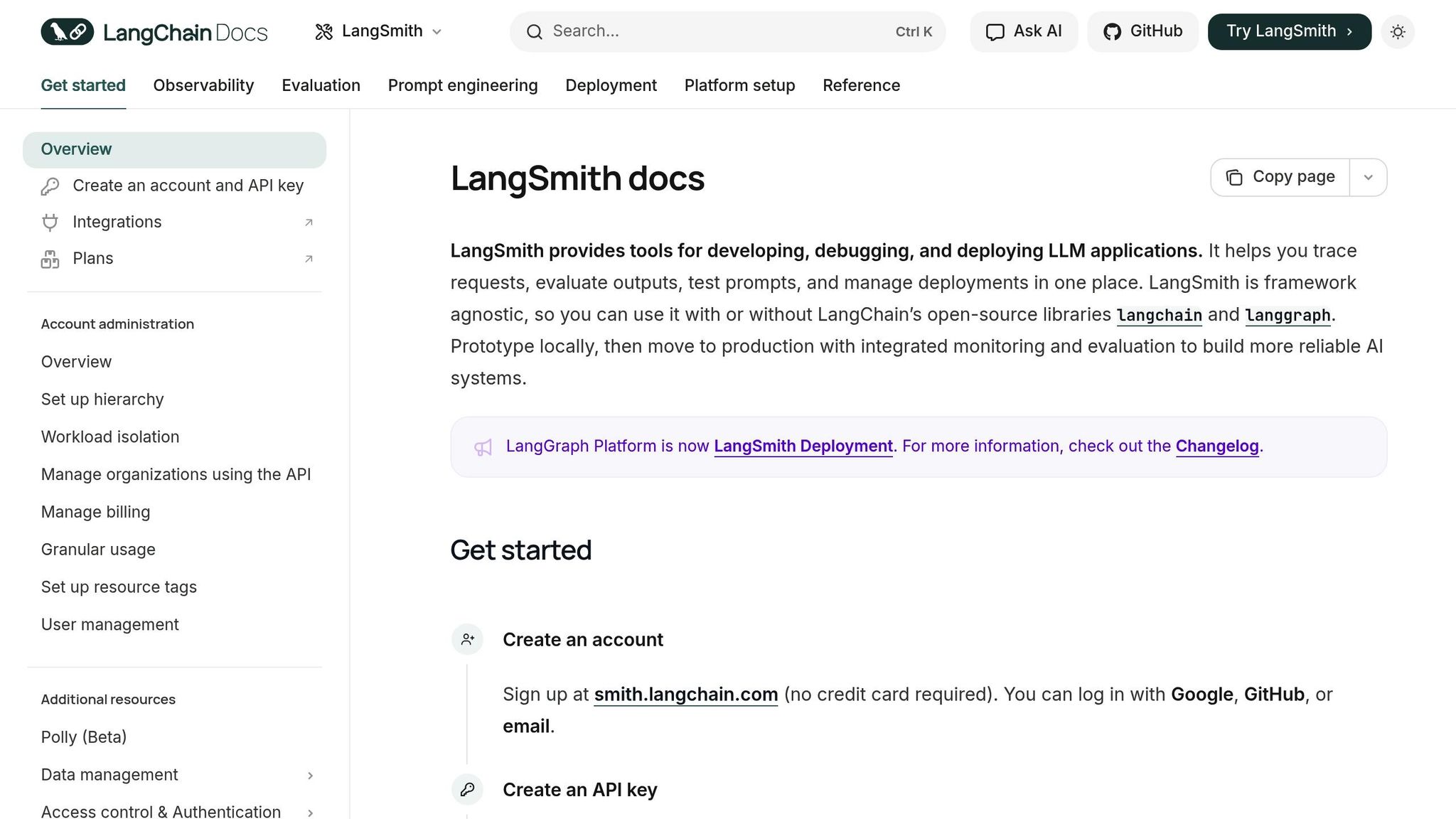

| LangSmith | Integración de LangChain, control de versiones rápido | Usuarios de LangChain | Pago por uso |

Estas plataformas simplifican la gestión de LLM y garantizan operaciones de IA escalables, confiables y rentables.

__XLATE_5__

Prompts.ai brings together 35+ top-tier LLMs - including GPT‑5, Claude, LLaMA, and Gemini - into one unified platform designed for enterprise-level prompt engineering and detailed output analysis. It simplifies evaluation with automated testing pipelines.

Prompts.ai presenta canales de evaluación capaces de ejecutar más de 20 pruebas en conjuntos de datos rápidos. Estos incluyen métodos como afirmaciones LLM (usando IA para calificar los resultados), verificaciones de similitud semántica mediante similitud de cosenos, evaluaciones de coincidencia exacta y coincidencia de patrones basada en expresiones regulares. Los equipos también pueden incorporar evaluaciones humanas a través de un panel fácil de usar, lo que permite a los expertos en el dominio evaluar manualmente los resultados como parte del aprendizaje reforzado a partir de los comentarios humanos.

For instance, Gorgias, a customer support platform, used Prompts.ai to scale its AI-powered helpdesk to support millions of shoppers. This led to a 20× boost in automation. Their ML engineers and support teams run daily regression tests on backtest datasets to catch potential issues before deployment.

Estas rigurosas capacidades de prueba garantizan una integración fluida en los flujos de trabajo actuales.

Prompts.ai’s evaluation pipelines seamlessly integrate with CI/CD workflows and enable backtesting against historical production data. The platform supports connections through external HTTP endpoints, custom Python/JavaScript scripts, and Model Context Protocol (MCP) actions.

Speak, una aplicación de aprendizaje de idiomas, aprovechó estas funciones de automatización para condensar meses de desarrollo curricular en solo una semana. Esta eficiencia les permitió lanzar funciones impulsadas por IA en 10 nuevos mercados al mismo tiempo.

Prompts.ai también ayuda a los equipos a optimizar los costos al ofrecer vistas comparativas de modelos en paralelo. Estas comparaciones permiten a los usuarios sopesar las compensaciones entre los costos de API, la latencia y los puntajes de calidad. Los equipos pueden resumir los resultados o utilizar modelos más pequeños y más rápidos para tareas intermedias para reducir el uso de tokens. NoRedInk, que presta servicios al 60% de los distritos escolares de EE. UU., utiliza estas funciones de ahorro de costos para proporcionar comentarios generados por IA sobre más de 1 millón de calificaciones de estudiantes, manteniendo al mismo tiempo la calidad a nivel de docente.

Prompts.ai mejora la colaboración al equipar a todas las partes interesadas con herramientas para perfeccionar los resultados del LLM. Un editor visual sin código permite a los usuarios no técnicos editar y probar indicaciones sin depender de ingenieros. El Prompt Registry centralizado garantiza una gestión eficiente de las versiones.

ParentLab, por ejemplo, ahorró más de 400 horas de ingeniería en sólo seis meses al permitir que expertos en dominios no técnicos gestionaran 700 revisiones rápidas.

__XLATE_12____XLATE_13__

La plataforma también recopila calificaciones de los usuarios y las traduce en puntuaciones de rendimiento, creando un circuito de retroalimentación continuo para mejorar la calidad de los resultados en todos los modelos integrados.

Maxim AI proporciona herramientas de monitoreo y pruebas en profundidad, combinando evaluaciones impulsadas por máquinas con comentarios humanos para ayudar a los equipos a administrar complejos flujos de trabajo de IA. Sus características están diseñadas para garantizar evaluaciones exhaustivas, que son cruciales para mantener un sólido desempeño en LLM.

Maxim AI utiliza un marco de evaluación sólido que incluye pruebas deterministas, métodos estadísticos y herramientas de evaluación automatizadas. El Tienda de evaluadores ofrece métricas prediseñadas como RAGAS, diseñadas para sistemas de generación aumentada de recuperación, componentes clave en aproximadamente el 60% de las aplicaciones de IA de producción para 2026. Además, métricas a nivel de nodo help identify failures in retrieval and generation processes. The platform’s Simulación de agente El motor permite realizar pruebas de conversaciones en varios turnos y crear personajes de usuario para evaluaciones previas a la implementación. Empresas como Clinc y Mindtickle han informado de una reducción del 75 % en el tiempo de producción al adoptar estos estándares de calidad.

Maxim AI’s evaluation tools integrate effortlessly with today’s development environments. It supports SDKs in Python, TypeScript, Java, and Go, while offering compatibility with platforms like LangChain, LangGraph, Crew AI, OpenAI, Anthropic, Mistral, and AWS Bedrock. The platform also adheres to OpenTelemetría estándares para seguimiento distribuido y se conecta con herramientas como Slack y PagerDuty para alertas en tiempo real. Los usuarios empresariales se benefician de opciones de implementación que incluyen alojamiento en la nube y en VPC, y todos cumplen con los requisitos de cumplimiento de SOC2, HIPAA y GDPR.

El Puerta de enlace Bifrost LLM utiliza el almacenamiento en caché semántico para reducir los gastos, mientras monitorea el uso de tokens y los costos de API para identificar y abordar flujos de trabajo costosos. Esto garantiza operaciones eficientes a medida que aumenta la producción.

Maxim AI’s interfaz de usuario sin código permite a los gerentes de productos y diseñadores experimentar con indicaciones y realizar evaluaciones de forma independiente. Kellie Maloney, líder de producto de Rise Science, compartió:

__XLATE_29__

La plataforma también incluye colas de anotaciones para revisiones humanas en el circuito, un Prompt CMS centralizado con control de versiones y RBAC con soporte SAML/SSO. Los equipos que aprovechan estas herramientas de colaboración han logrado quintuplicar la velocidad de envío, simplificando la iteración y acelerando los lanzamientos de producción.

Braintrust combina experimentos fuera de línea con puntuación en línea para brindar a los equipos una visión completa del desempeño del LLM desde el desarrollo hasta la implementación.

Braintrust proporciona múltiples formas de evaluar la calidad de los resultados en una escala de 0 a 1. Los equipos pueden utilizar puntuadores automatizados para tareas como comprobaciones de factualidad y similitud, confiar en evaluaciones de LLM como juez o implementar una lógica de código personalizada adaptada a sus necesidades específicas. La plataforma incluye Vistas de la línea de tiempo con diagramas de Gantt para identificar cuellos de botella, Vistas del hilo para depurar conversaciones de varios turnos y visualizaciones de seguimiento basadas en lenguaje natural que se muestran como componentes de React en espacio aislado. También admite la ejecución de múltiples pruebas para cada entrada, lo que ayuda a los equipos a medir la variación y mantener la coherencia.

Braintrust se integra perfectamente con los principales marcos de IA y ofrece soporte nativo para Más de 9 marcos principales, como OpenTelemetry, Vercel AI SDK, OpenAI Agent SDK, Instructor, LangChain, LangGraph, Google ADK, Mastra y Pydantic AI. Utiliza una envoltura "envoltura". enfoque para la integración: los ejemplos incluyen envolverAISDK para Vercel AI SDK (que cubre las versiones v3 a v6 beta) y envoltura_openai para Instructor. La plataforma se adhiere a Convenciones semánticas de OpenTelemetry GenAI, asignando automáticamente detalles como el uso de tokens y los identificadores de modelos a los campos de Braintrust. Funciona a la perfección con los principales proveedores de LLM, incluidos OpenAI, Anthropic y Google Gemini. Los desarrolladores también pueden utilizar el evaluar() función o la CLI con el --mirar bandera para volver a ejecutar las evaluaciones automáticamente cada vez que los archivos se actualicen durante el desarrollo.

Braintrust va más allá de la evaluación al fomentar la colaboración en equipo con herramientas integradas. Es sincronización bidireccional garantiza que los gerentes de producto y los ingenieros puedan trabajar en indicaciones de manera intercambiable entre el código y la interfaz de usuario. El Patio de juegos ofrece un espacio sin código donde los equipos pueden probar indicaciones, comparar modelos uno al lado del otro y compartir configuraciones para iteraciones rápidas. Las herramientas de anotación dedicadas permiten a los equipos proporcionar retroalimentación humana, agregando etiquetas o correcciones directamente a los seguimientos y resultados del modelo. Se puede invitar a anotadores externos a evaluar la calidad en diferentes versiones de modelos, mientras que los trabajos pendientes de evaluación compartidos centralizan conjuntos de datos y rúbricas de puntuación, eliminando la necesidad de realizar un seguimiento manual en hojas de cálculo.

Phoenix de Arize AI es una plataforma de código abierto diseñada para brindar a los equipos un control integral sobre la evaluación de grandes modelos de lenguaje (LLM). Creado con OpenTelemetry como núcleo, Phoenix ha llamado la atención con más de 2,5 millones de descargas y más de 8500 estrellas de GitHub. Ofrece seguimiento detallado para realizar un seguimiento de cada paso del flujo de trabajo de un LLM, lo que facilita la identificación de dónde surgen los problemas.

Phoenix emplea el LLM-como-juez enfoque, utilizando modelos básicos de OpenAI, Anthropic y Gemini para evaluar otras aplicaciones de LLM en busca de factores como relevancia, toxicidad y rendimiento general. Viene con evaluadores prediseñados para tareas comunes como recuperación-generación aumentada (RAG) y llamada de funciones. Una característica destacada es su capacidad de explicación, donde los modelos de evaluación brindan un razonamiento claro detrás de sus puntuaciones, lo que ayuda a los desarrolladores a comprender la lógica detrás de cada evaluación. Las herramientas adicionales incluyen comprobaciones deterministas basadas en código, anotaciones humanas directamente dentro de la interfaz y agrupación de conjuntos de datos que utiliza incrustaciones para agrupar visualmente preguntas y respuestas semánticamente similares. Esta agrupación ayuda a aislar áreas donde los modelos tienen un rendimiento inferior.

__XLATE_63__

Estas herramientas de evaluación se integran perfectamente con el ecosistema de desarrollo más amplio de la plataforma.

Phoenix admite la instrumentación automática para marcos populares como LlamaIndex, LangChain, DSPy, Mastra y Vercel AI SDK. Funciona con Python, TypeScript y Java, y su diseño nativo de OpenTelemetry garantiza la compatibilidad con herramientas de observabilidad existentes sin bloquear a los usuarios en proveedores específicos. Los equipos también pueden incorporar evaluaciones de bibliotecas de terceros como Ragas, Deepeval o Cleanlab, lo que ofrece flexibilidad en sus flujos de trabajo.

Phoenix está diseñado para la eficiencia y ofrece ejecuciones de evaluación hasta 20 veces más rápidas mediante concurrencia y procesamiento por lotes. Su Prompt Playground proporciona un entorno de prueba donde los equipos pueden perfeccionar las indicaciones y comparar variantes de modelos en paralelo antes de la implementación, lo que reduce el riesgo de costosos errores de producción.

Como plataforma totalmente de código abierto y autohospedable, Phoenix garantiza que los equipos mantengan un control total sobre sus datos. Características como colas de anotaciones humanas Permitir que se agreguen etiquetas de verdad sobre el terreno directamente a los rastros, fomentando una mejor colaboración. El Centro rápido gestiona el control rápido de versiones, el almacenamiento y la implementación en todos los entornos, mientras que el Chat de intervalo La herramienta permite a los equipos evaluar y discutir segmentos de flujo de trabajo específicos para descubrir problemas de rendimiento. Con una comunidad de Slack de más de 7000 miembros, los usuarios tienen acceso a una red para solucionar problemas y compartir información.

__XLATE_76__

LangSmith es una plataforma versátil diseñada para funcionar perfectamente con o sin LangChain, lo que la hace adaptable a cualquier pila LLM. Se conecta sin esfuerzo con herramientas como OpenAI, Anthropic, CrewAI, Vercel AI SDK y Pydantic AI, lo que brinda flexibilidad a los equipos que ya utilizan marcos específicos. La plataforma cumple con estándares de cumplimiento como HIPAA, SOC 2 Tipo 2 y GDPR, y utiliza un proceso asincrónico para enviar seguimientos, lo que garantiza que no haya latencia adicional para los usuarios finales.

LangSmith ofrece dos modos de evaluación para satisfacer diferentes necesidades: Evaluación fuera de línea para probar conjuntos de datos seleccionados durante el desarrollo y Evaluación en línea para monitorear el tráfico de producción en vivo. Admite cuatro tipos de evaluadores:

La plataforma incluye herramientas de análisis avanzadas como Vista diferencial, que destaca las diferencias entre los resultados del modelo y los textos de referencia, y comparaciones en paralelo para realizar evaluaciones comparativas del rendimiento. También proporciona agrupación de metadatos, lo que permite el análisis de métricas como la precisión o el costo por categorías como área temática o tipo de usuario. LangSmith se integra con el código abierto aperturas paquete, que ofrece evaluadores prediseñados para evaluar la corrección y la brevedad.

Estas características facilitan la integración de LangSmith en flujos de trabajo y herramientas de desarrollo existentes.

LangSmith simplifica el rastreo con el @trazable Decoradores o envoltorios de cliente que capturan automáticamente entradas y salidas. Admite la integración con los SDK de Python y TypeScript/JavaScript, una API REST y marcos de prueba como pytest, Vitest y Jest, lo que facilita la integración de evaluaciones en canalizaciones de CI/CD. Además, la integración de OpenTelemetry permite a los equipos enviar seguimientos de los canales de observabilidad existentes directamente a LangSmith.

LangSmith mejora la colaboración en equipo con herramientas intuitivas de comentarios y anotaciones. Colas de anotaciones habilite el enrutamiento automático de ejecuciones específicas a expertos en la materia para su revisión manual y puntuación basada en criterios personalizados. El Centro rápido sirve como un espacio centralizado para que los equipos iteren, versionen y compartan indicaciones, completo con funciones de seguimiento de cambios y reversión para mantener la coherencia durante todo el desarrollo. Las capacidades de anotación en línea permiten a los miembros del equipo señalar problemas o proporcionar comentarios específicos sobre la calidad de la respuesta, lo que mejora tanto la precisión de la evaluación como la eficiencia del flujo de trabajo.

La plataforma también ofrece gestión detallada de usuarios y aislamiento de cargas de trabajo, lo que garantiza una colaboración fluida entre equipos. Los usuarios pueden registrarse de forma gratuita en smith.langchain.com; no se requiere tarjeta de crédito. Para uso en producción, LangSmith opera mediante pago por uso, con planes empresariales disponibles para autohospedaje en clústeres de Kubernetes en AWS, GCP o Azure.

Al evaluar plataformas para la evaluación de LLM, es esencial considerar la compatibilidad técnica, el costo y los métodos de evaluación. He aquí un vistazo más de cerca a las opciones:

Indicaciones.ai reúne más de 35 modelos líderes en una interfaz segura y ofrece controles FinOps que pueden reducir los costos del software de IA hasta en un 98 %. Confianza cerebral simplifica la configuración con un proxy AI sin configuración, capturando registros a través de una única URL base. Incluye 1 millón de tramos de seguimiento gratuitos, con planes pagos desde $249/mes. Máxima IA se integra perfectamente con las pilas de observabilidad existentes, centrándose en la puntuación de calidad sobre el seguimiento completo. Ofrece un plan gratuito para hasta 10,000 registros por mes y planes pagos desde $29 por puesto/mes. Arize Fénix admite el autohospedaje para la privacidad de los datos, integrándose con herramientas como RAGAS y Giskard para un análisis de métricas más profundo. LangSmith está diseñado para los usuarios de LangChain y proporciona observabilidad avanzada, aunque los precios de soporte empresarial varían. En particular, Notion mejoró diez veces su velocidad de desarrollo con Braintrust, pasando de resolver 3 problemas diarios a 30.

El enfoque único de cada plataforma simplifica la toma de decisiones en función de sus necesidades de evaluación específicas. Así es como se comparan en términos de métodos de evaluación, integración e implementación:

La complejidad de la integración también juega un papel clave. La configuración basada en proxy de Braintrust es sencilla: simplemente actualice la URL base de su API. Maxim AI se integra con las herramientas de observabilidad existentes, mientras que la estrecha integración de LangChain de LangSmith satisface las necesidades de observabilidad especializadas. Arize Phoenix se destaca por las organizaciones que priorizan la soberanía de los datos y ofrecen una solución autohospedada y de código abierto. Mientras tanto, Prompts.ai proporciona controles de gobernanza de nivel empresarial y pistas de auditoría completas para un funcionamiento seguro.

__XLATE_111__

Para obtener información rápida, las implementaciones basadas en proxy y las integraciones profundas agilizan el proceso. Los usuarios de LangChain encontrarán en LangSmith una opción natural, mientras que las organizaciones que gestionan datos confidenciales pueden inclinarse por soluciones de código abierto como Arize Phoenix o Prompts.ai para obtener capacidades sólidas de gobernanza y auditoría.

Según las evaluaciones proporcionadas, cada plataforma ofrece distintas ventajas para perfeccionar el análisis de resultados de LLM. Indicaciones.ai ofrece a las empresas acceso centralizado a modelos líderes, junto con controles FinOps que pueden reducir los costos de IA hasta en un 98%, al tiempo que garantiza capacidades sólidas de gobernanza y auditoría. Confianza cerebral está diseñado para equipos de ingeniería de ritmo rápido, y empresas como Notion informan un aumento de 10 veces en la velocidad de desarrollo, lo que aumenta la resolución de problemas de 3 a 30 por día. De manera similar, los equipos de Stripe y Airtable observaron ganancias de precisión de más del 30 % a las pocas semanas de adoptar la plataforma.

Para aquellos profundamente integrados en el ecosistema LangChain, LangSmith Proporciona integración sin esfuerzo y opciones rápidas de creación de prototipos. Máxima IA está dirigido a equipos que se centran en la gestión de sistemas complejos de múltiples agentes, ofreciendo herramientas de puntuación de precisión y una puerta de enlace de baja latencia que introduce solo 11 microsegundos de sobrecarga a un volumen de 5000 solicitudes por segundo. Mientras tanto, Arize Fénix es ideal para organizaciones que priorizan la soberanía de los datos, ya que ofrece una solución de código abierto autohospedada que se adapta perfectamente a los sistemas de observabilidad existentes.

Cada plataforma aborda desafíos críticos en el desempeño de LLM y la gestión de costos. Dado que las empresas se enfrentan a posibles pérdidas de 1.900 millones de dólares al año Debido a fallas no detectadas de LLM en producción, la necesidad de ir más allá de las evaluaciones subjetivas a métricas mensurables basadas en datos se ha vuelto esencial para garantizar la confiabilidad y la eficiencia.

Estas herramientas elevan el desarrollo de LLM a una disciplina de ingeniería estructurada. Ya sea que su enfoque sea manejar billones de eventos mensuales, optimizar la colaboración entre equipos o mantener el control sobre la infraestructura autohospedada, elegir la plataforma adecuada garantiza que sus flujos de trabajo de LLM alcancen la confiabilidad, la calidad y la rentabilidad necesarias para alcanzar sus objetivos.

Estas plataformas están diseñadas para ayudar a las organizaciones a reducir los gastos de IA al ofrecer herramientas para monitorear y ajustar el uso de modelos de lenguaje grandes (LLM). Por ejemplo, soluciones como Prompts.ai permiten a los usuarios realizar un seguimiento del uso de tokens en tiempo real, lo que facilita la detección y reducción del consumo innecesario de tokens. Esto ayuda a evitar gastos excesivos en llamadas API excesivas, lo que lleva a una mejor gestión de costos.

Más allá del control de costos, estas plataformas también brindan información valiosa sobre el rendimiento y la calidad de los resultados. Pueden ayudar a detectar y prevenir problemas como alucinaciones o errores, que de otro modo podrían dar lugar a costosas modificaciones. Al analizar las tendencias de uso y detectar ineficiencias, las organizaciones pueden optimizar los flujos de trabajo, reducir los costos operativos y garantizar resultados consistentes y de alta calidad. Todo esto respalda decisiones más inteligentes basadas en datos para gestionar los presupuestos de IA de forma eficaz.

Las plataformas LLM brindan varias formas de conectarse sin problemas con herramientas y flujos de trabajo, atendiendo a diferentes necesidades. Muchas plataformas admiten la integración nativa a través de SDK como Python y JavaScript, junto con marcos como LangChain y LangServe. Esto hace que integrar LLM en aplicaciones personalizadas sea sencillo y eficiente. Para el monitoreo, las plataformas suelen admitir estándares abiertos como OpenTelemetry, lo que garantiza la compatibilidad con la infraestructura existente.

Algunas plataformas también se integran con herramientas de CI/CD como GitHub Actions y Jenkins, lo que simplifica los procesos de prueba e implementación. Para las organizaciones que priorizan el control de su entorno, hay opciones de autohospedaje disponibles, que permiten la personalización manteniendo la seguridad de los datos. Estas funciones de integración permiten a los usuarios aumentar la eficiencia, monitorear el desempeño de manera efectiva e implementar LLM de forma segura dentro de sus operaciones.

Para aquellos que ponen una prima en privacidad y control de datos, OnPrem.LLM ofrece una excelente solución. Diseñada específicamente para tareas sensibles a la privacidad, esta plataforma permite que los modelos de lenguaje grandes (LLM) manejen datos confidenciales o restringidos de forma segura en entornos fuera de línea. Al permitir la ejecución totalmente local, se reduce significativamente las posibilidades de exposición de los datos y, al mismo tiempo, se ofrece integración opcional en la nube para configuraciones híbridas cuando sea necesario.

Con su interfaz intuitiva y sin código, OnPrem.LLM garantiza la accesibilidad para usuarios sin experiencia técnica, al mismo tiempo que mantiene una supervisión completa de la gestión de datos. Esto lo convierte en una opción ideal para organizaciones en industrias reguladas o sensibles donde proteger la información es una máxima prioridad.