Orquestación de la IA en 2026 se ha convertido en una necesidad para gestionar flujos de trabajo complejos, coordinar agentes de IA especializados e integrarse con sistemas empresariales como CRM, ERP y herramientas ITSM. Las empresas ahora están aprovechando plataformas que no solo conectan múltiples modelos de IA sino que también optimizan los costos, garantizan el cumplimiento y brindan una escalabilidad perfecta. con más 50% de las empresas Se espera que las empresas adopten estas plataformas, seleccionar la herramienta adecuada se ha vuelto fundamental para lograr eficiencia operativa y resultados mensurables.

Cada plataforma ofrece fortalezas únicas, desde rentabilidad hasta gobernanza avanzada y escalabilidad. Ya sea que esté automatizando flujos de trabajo o coordinando agentes de IA, estas herramientas permiten a las empresas escalar sus operaciones mientras mantienen el control y la seguridad.

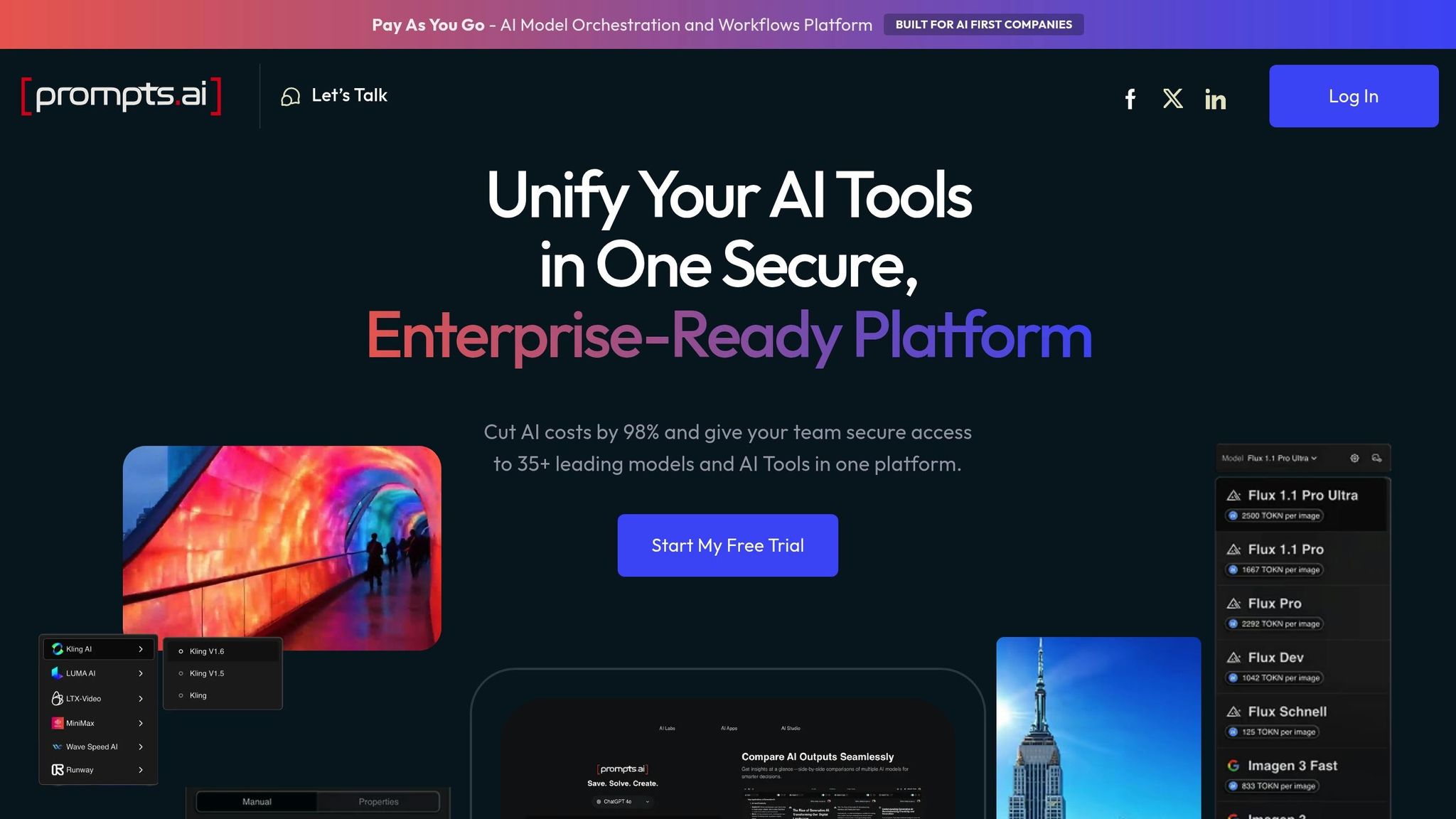

Prompts.ai reúne 35 modelos de lenguaje grandes líderes - como GPT-5, Claude 4, LLaMA 3 y Gemini - en una plataforma unificada y lista para la empresa. Esta configuración simplifica la automatización del flujo de trabajo, elimina la necesidad de múltiples herramientas y reduce drásticamente los costos del software de IA. hasta 98%, todo ello mientras permite a los usuarios cambiar de modelo dinámicamente según sus tareas.

El motor de inferencia unificado de la plataforma se integra perfectamente con las API nativas para más de 50 modelos de lenguaje grandes. Esto permite el cambio dinámico de modelos dentro de los flujos de trabajo sin requerir ningún cambio de código, reduciendo la latencia en hasta 40% en ductos multimodelo. Por ejemplo, Netflix usó Prompts.ai para automatizar 80% de sus flujos de trabajo de contenido, resultando en un 25% de aumento en el compromiso. El diseño plug-and-play permite a los equipos encadenar modelos para tomar decisiones en tiempo real, optimizando el rendimiento para necesidades específicas. Este enfoque no sólo mejora la eficiencia sino que también ofrece ahorros sustanciales de costos.

Prompts.ai utiliza un modelo de facturación de pago por token, con tasas entre $0,0001 y $0,001 por 1000 tokens (DÓLAR ESTADOUNIDENSE). Su sistema de inferencia de escala automática, combinado con la destilación de modelos, reduce los costos en 60%. Además, los mecanismos de almacenamiento en caché evitan llamadas API redundantes mediante la reutilización de respuestas rápidas. Un informe de Forrester de 2025 destacó que las medianas empresas que utilizan automatizaciones diarias reducen sus gastos de LLM en 50%. Por ejemplo, las empresas que procesan Mil millones de tokens mensuales guardar alrededor $10,000. Las proyecciones de Gartner para 2026 posicionan a Prompts.ai como líder en la reducción del costo total de propiedad para la orquestación de IA.

Prompts.ai prioriza el cumplimiento empresarial con funciones como control de acceso basado en roles (RBAC), Cifrado AES-256y registros de auditoría detallados que cumplen SOC 2, RGPD e HIPAA estándares. La plataforma también incorpora barreras de seguridad de IA para detectar sesgos y filtrar la toxicidad, bloqueando 95% de los productos nocivos en sectores sensibles como el financiero. Auditorías independientes confirman estas capacidades. Los expertos de Gartner han señalado que los clasificadores de riesgo de Prompts.ai se alinean con los requisitos de alto riesgo de la Ley de IA de la UE, incluidos los informes de cumplimiento automatizados que registran 100% de las inferencias para la trazabilidad. Este enfoque integral es fundamental para evitar multas que podrían alcanzar 7% de los ingresos anuales, garantizando una escalabilidad segura en un entorno regulado globalmente.

Con la orquestación de Kubernetes y la implementación sin servidor, Prompts.ai puede manejar más de 1 millón de inferencias por segundo, acomodando las necesidades de empresas globales con demandas variables. La plataforma apoya a una próspera comunidad de Más de 200.000 desarrolladores y ofrece acceso a Más de 500 complementos de GitHub (con más de 50.000 estrellas). Para 2026, se espera que la plataforma capture 25% del mercado con 5 millones de usuarios, impulsado por 300% de crecimiento año tras año. VentureBeat informa que Prompts.ai ya funciona Más de 1000 clientes empresariales, con tiempos de implementación promedio inferiores a 24 horas al utilizar plantillas comunitarias y el panel sin código para la creación de prototipos de flujo de trabajo. Esta combinación de escalabilidad y participación activa de la comunidad posiciona a Prompts.ai como líder en soluciones de flujo de trabajo de IA.

Plataforma B, conocida como LangGraph, organiza los flujos de trabajo de IA como grafos dirigidos, donde cada nodo representa un paso específico y los bordes determinan la secuencia de ejecución. Este diseño permite ciclos, procesamiento paralelo y bifurcaciones condicionales, lo que lo hace muy adecuado para manejar flujos de trabajo complejos e iterativos. También admite la ejecución dinámica y el refinamiento continuo en sistemas multiagente.

LangGraph se integra con más de 1.000 herramientas a través del ecosistema LangChain. Utiliza un protocolo de agente abierto, lo que permite una comunicación fluida entre agentes a través de marcos como CrewAI y Microsoft Agent Framework a través de API estandarizadas. A principios de 2026, LangGraph alcanzó v1.0 GA estado, lo que marca su preparación para el uso en producción en entornos de múltiples agentes.

LangGraph emplea un arquitectura híbrida que separa el plano de control de orquestación del entorno de ejecución. Esta configuración garantiza que los usuarios mantengan un control total sobre su infraestructura de ejecución y sus datos confidenciales, mientras que LangGraph solo maneja metadatos de orquestación. La plataforma nunca accede al código fuente del flujo de trabajo ni procesa los datos reales, salvaguardando la información patentada. Además, todos los metadatos de orquestación se cifran tanto durante el tránsito como en reposo, cumpliendo con los estrictos estándares de seguridad requeridos por las industrias reguladas. Este enfoque promueve la escalabilidad y garantiza operaciones tolerantes a fallas.

The platform’s checkpointing feature stores workflow states in databases such as PostgreSQL o Redis, enabling recovery, human intervention, and in-depth debugging. LangGraph’s precise control over transitions and decision-making processes makes it particularly effective for agentic RAG pipelines that require explicit state management.

La Plataforma C, conocida como Prefect, ofrece orquestación de IA a través de una arquitectura híbrida que separa el control de la ejecución. Si bien la interfaz de orquestación funciona como un servicio administrado, todos los flujos de trabajo de IA y el procesamiento de datos permanecen dentro de su infraestructura privada, ya sea una VPC, Kubernetes o una configuración local. Este enfoque prioriza las implementaciones seguras y la soberanía de los datos, garantizando que el código de flujo de trabajo confidencial, las claves API y los datos de capacitación nunca abandonen su red.

Prefect se conecta con los sistemas de IA utilizando su núcleo de código abierto, que cuenta con más de 6.000.000 de descargas mensuales a partir de principios de 2026. Esta flexibilidad permite a los equipos integrar varios modelos de lenguaje grandes y herramientas de inteligencia artificial mientras mantienen el control total sobre la ejecución. Los trabajadores locales manejan la orquestación a través de conexiones exclusivamente salientes, eliminando la necesidad de acceso entrante o puertos de firewall abiertos.

Prefect se creó teniendo en cuenta la seguridad empresarial. se sostiene Certificación SOC 2 Tipo II, cumple con RGPD, y es Listo para HIPAA, lo que lo hace ideal para industrias como las finanzas y la atención médica. Los datos permanecen cifrados en tránsito (TLS 1.2+) y en reposo con claves de cifrado únicas para cada espacio de trabajo. La plataforma admite RBAC, inicio de sesión único (SSO) a través de SAML 2.0 u OIDC y sincronización de directorios SCIM. Además, ofrece registros de auditoría detallados con períodos de retención personalizables para monitorear la actividad del usuario y los cambios del sistema.

__XLATE_83__

Este marco de seguridad integral respalda tanto la eficiencia operativa como la escalabilidad.

Prefect’s open-source base has garnered significant attention, with over 18.000 estrellas y 372+ contribuyentes en GitHub. Su escalabilidad es evidente en aplicaciones del mundo real, como la implementación de Snorkel AI, que manejó más 1.000 flujos por hora y decenas de miles de ejecuciones diarias. Smit Shah, director de ingeniería de Snorkel AI, compartió cómo lograron un Mejora del rendimiento 20 veces mayor manteniendo al mismo tiempo un entorno de Kubernetes autohospedado para preservar el control de los datos. Prefect también opera en GCP y AWS con alta disponibilidad multi-AZ, lo que lo convierte en una opción sólida para operaciones de IA a escala empresarial.

__XLATE_93__

__XLATE_94__

Esta sección desglosa las fortalezas y desafíos de las plataformas clave de orquestación de IA, destacando sus compensaciones en funcionalidad, costo y usabilidad. A medida que la orquestación de la IA continúa evolucionando, estas plataformas reflejan distintas prioridades de diseño que atienden a distintos niveles de experiencia técnica y necesidades de flujo de trabajo. Los conocimientos aquí se basan en discusiones anteriores sobre la integración de modelos, la gestión de costos y la escalabilidad segura.

LangGraph v1.0 ofrece control detallado a través de su ejecución basada en gráficos y persistencia de estado, lo que lo hace ideal para flujos de trabajo de decisiones complejos. Sin embargo, dominar la plataforma normalmente requiere 2–3 weeks, lo que puede ser un obstáculo para los nuevos usuarios. Su modelo de precios de pago por nodo, combinado con la compatibilidad con el protocolo de agente abierto, garantiza la compatibilidad entre marcos.

n8n proporciona un modelo de precios basado en la ejecución rentable, ideal para tareas repetitivas de IA. Cuenta con integración nativa de LangChain y admite el autohospedaje para proteger la privacidad de los datos. Los equipos pueden llegar a ser competentes en 1–2 weeks, pero sus capacidades a nivel empresarial son algo limitadas.

Temporal se ha convertido en una solución de referencia para la "ejecución duradera de agentes", sobresaliendo en escenarios que involucran pausas humanas durante períodos prolongados o tareas que requieren resistencia a los reinicios del servidor. OpenAI aprovecha Temporal para Codex en producción, particularmente para gestionar tareas con estado de larga duración. Su arquitectura basada en eventos garantiza escalabilidad y confiabilidad, aunque una implementación efectiva requiere un alto nivel de experiencia técnica.

Estas comparaciones subrayan la importancia de equilibrar factores como el control, el costo y la facilidad de uso para alinearse con las necesidades del proyecto.

| Plataforma | Curva de aprendizaje | Mejor para | Modelo de precios | Limitación clave |

|---|---|---|---|---|

| LangGraph v1.0 | 2–3 weeks | Flujos de trabajo de decisiones complejos | Pago por nodo | Curva de aprendizaje pronunciada |

| n8n | 1–2 weeks | Usuarios avanzados técnicos y de operaciones de TI | Basado en ejecución | Funciones empresariales limitadas |

| Temporal | 1–2 weeks | Ejecución duradera del agente | Basado en el uso | Exige competencia técnica |

| TripulaciónAI v1.8 | 1 semana | creación rápida de prototipos | Costumbre | Control limitado |

Los proyectos de orquestación personalizados a menudo requieren 3–5 times more time en lugar de utilizar estas plataformas, lo que hace que la elección de la herramienta adecuada sea fundamental para cumplir con el cronograma y administrar los recursos de manera efectiva.

Choose a platform that complements your team’s skills and fits your workflow requirements. LangGraph v1.0 Es ideal para gestionar flujos de trabajo complejos que exigen un control de estado preciso. n8n destaca por su precio rentable basado en la ejecución y sus capacidades de autohospedaje, lo que lo convierte en una opción práctica para los equipos de operaciones de TI. Temporal destaca en el manejo de flujos de trabajo duraderos y de misión crítica, garantizando confiabilidad incluso durante reinicios del servidor o pausas prolongadas. TripulaciónAI v1.8 admite la creación rápida de prototipos al permitir que los equipos definan agentes en función de roles y objetivos específicos a través de la colaboración basada en roles.

Para empresas centradas en integrar grandes modelos de lenguaje sin esfuerzo, plataformas como Roca Amazónica, LangChain, y Zapier Proporcionar una conectividad sólida a modelos básicos y herramientas empresariales.

La creación de un sistema de orquestación personalizado a menudo requiere muchos más recursos en comparación con el aprovechamiento de plataformas establecidas. Optar por una solución que equilibre la solidez técnica con una integración fluida puede ayudar a acelerar las iniciativas de IA y ofrecer beneficios comerciales tangibles.

To select the most suitable AI orchestration platform, start by evaluating your team’s specific needs, such as the complexity of workflows, the number of LLMs in use, and your budget constraints. Focus on platforms that offer essential features like centralized model management, cost monitoring, and governance tools.

Platforms that enable workflow automation, ensure compliance, and allow for scalability should take priority. Ease of use is another critical factor - no-code tools are ideal for teams without technical expertise, while open-source platforms may better serve technical teams looking for customization. Lastly, confirm that the platform meets your organization’s security and compliance standards.

Before implementing AI and orchestration platforms, it’s critical to prioritize seguridad y cumplimiento para salvaguardar los datos y cumplir con las regulaciones. Busque funciones como control de acceso basado en roles (RBAC), monitoreo en tiempo real y cifrado de datos tanto en reposo como en tránsito. Asegúrese de que la plataforma se alinee con estándares como GDPR, HIPAA o SOC 2. Salvaguardas adicionales como registros de auditoría, autenticación multifactor (MFA) e integraciones API seguras son esenciales para mantener la integridad operativa y cumplir con los requisitos regulatorios.

Para reducir los gastos asociados con los modelos de lenguajes grandes (LLM) y mantener intacto su rendimiento, considere estrategias como almacenamiento en caché rápido, lo que elimina el procesamiento redundante, y enrutamiento del modelo, que asigna tareas a modelos más rentables. Plataformas como indicaciones.ai Simplifique este proceso ofreciendo gestión centralizada de modelos, monitoreo de costos en tiempo real y selección dinámica de modelos. Al integrar estos métodos, puede gestionar los costos de manera efectiva y al mismo tiempo mantener resultados de alta calidad.