Las plataformas de flujo de trabajo de IA en 2026 están remodelando la forma en que operan las empresas, yendo más allá de la simple automatización de tareas hacia sistemas más inteligentes basados en decisiones impulsados por grandes modelos de lenguaje (LLM). Estas herramientas agilizan las operaciones, reducen costos y se integran perfectamente con los ecosistemas tecnológicos existentes, resolviendo desafíos como la dispersión de herramientas y la falta de compatibilidad. A continuación se muestran las principales plataformas que lideran esta transformación:

Estas plataformas abordan necesidades críticas como la rentabilidad, la escalabilidad y la gobernanza, lo que las convierte en herramientas esenciales para las empresas que navegan por el futuro impulsado por la IA.

Prompts.ai reúne más de 35 modelos de lenguajes grandes (LLM), como GPT-5, Claude, LLaMA, Gemini, Grok-4 y Flux Pro, en una plataforma única y segura. Esto elimina la molestia de tener que hacer malabarismos con múltiples suscripciones, inicios de sesión y sistemas de facturación. Así es como sus funciones simplifican los flujos de trabajo de IA y mejoran la productividad.

Prompts.ai’s design allows users to switch between models effortlessly without reconfiguring workflows or managing separate API keys. This means you can directly compare GPT-5’s strengths to those of Claude or Gemini, then direct production tasks to the model that fits your needs best. Each model has unique strengths - some excel in creative tasks, while others are better suited for data analysis or coding. This flexibility ensures you always have the right tool for the job.

Más allá de sus capacidades de integración, Prompts.ai ayuda a reducir costos con su sencillo modelo de facturación basado en el uso. Al implementar un sistema de seguimiento unificado para el uso de tokens, la plataforma ofrece créditos TOKN de pago por uso, lo que elimina la necesidad de tarifas recurrentes. Muchas organizaciones han reducido sus gastos en software de IA hasta en un 98 % al consolidar múltiples herramientas en esta plataforma única y transparente.

Prompts.ai adapts to the needs of individuals, teams, and enterprises alike. Plans start at $29 per month for individual users, while enterprise plans range from $99 to $129 per member. There’s even a $99 Family Plan, recognizing that AI automation is increasingly valuable for both personal and professional use. This scalability ensures that users only pay for what they need, whether they’re automating workflows for a small team or an entire organization.

Para operaciones en crecimiento, la gobernanza segura es una prioridad absoluta. Prompts.ai está creado con funciones de nivel empresarial, lo que proporciona un seguimiento de auditoría para cada interacción de IA para respaldar las necesidades de cumplimiento. Los datos confidenciales permanecen dentro de la organización, evitando la exposición a múltiples servicios de terceros. Los paneles en tiempo real brindan a los administradores visibilidad de los gastos, el control de acceso y la capacidad de vincular los costos de la IA directamente con los resultados comerciales. Estas herramientas son cruciales para mantener la transparencia y el control en las operaciones impulsadas por la IA.

Vellum AI adopta un enfoque diferente al centrarse en la orquestación del flujo de trabajo nativo de la IA en lugar de simplemente automatizar tareas individuales. Permite a los usuarios describir un proceso en lenguaje sencillo y la plataforma genera automáticamente la estructura del flujo de trabajo, eliminando la necesidad de configurar manualmente los nodos. Esta característica de "solicitud de creación" ahorra mucho tiempo, especialmente para los equipos que experimentan con conceptos de múltiples agentes.

Con su diseño independiente del modelo, Vellum permite un cambio fluido entre LLM para equilibrar el costo, la velocidad y la calidad sin requerir una reconstrucción completa del flujo de trabajo. La plataforma admite funciones avanzadas como generación aumentada de recuperación (RAG), enrutamiento semántico y orquestación de agentes de varios pasos. Permite a los usuarios encadenar indicaciones, de modo que el resultado de un modelo se convierta en el insumo de otro, lo que permite procesos de razonamiento complejos. Las herramientas integradas de evaluación y control de versiones facilitan la prueba y el perfeccionamiento de las variaciones de solicitudes.

Vellum está diseñado para reunir equipos técnicos y no técnicos. Los gerentes de producto y el personal de operaciones pueden usar su creador visual para crear agentes, mientras que los ingenieros pueden mejorar los flujos de trabajo usando lógica personalizada con SDK de TypeScript o Python. Por ejemplo, RelyHealth utilizó Vellum para implementar cientos de agentes de atención médica personalizados, reduciendo su cronograma de implementación en 100 veces. Max Bryan, vicepresidente de tecnología y diseño, compartió:

__XLATE_8__

Aceleramos nuestro cronograma de 9 meses al doble y logramos una precisión a prueba de balas con nuestro asistente virtual. Vellum ha sido fundamental para que nuestros datos sean procesables y confiables.

The platform’s strong governance features ensure that rapid deployment doesn’t compromise security.

Vellum proporciona seguridad de nivel empresarial con control de acceso basado en roles (RBAC), integración SSO/SAML y registros de auditoría inmutables que rastrean cada mensaje y salida. Cumple con los estándares SOC 2, GDPR, HIPAA e ISO 27001. Las opciones de implementación incluyen nube pública, VPC privada, configuraciones locales e incluso entornos aislados para industrias con regulaciones estrictas. Las puertas de aprobación con intervención humana permiten que las acciones sensibles se detengan para su revisión, lo que garantiza la rendición de cuentas. En particular, el 78% de los líderes de operaciones citan la explicabilidad y las herramientas de depuración como factores críticos en sus decisiones de compra.

Los precios comienzan en $25/mes para el plan Pro, $79/usuario/mes para los planes Business y precios Enterprise personalizados para créditos ilimitados y soporte dedicado.

Zapier conecta tareas de IA en más de 8000 aplicaciones y maneja más de 23 millones de tareas de IA mensualmente para más de 1 millón de empresas. Los usuarios pueden seleccionar entre proveedores de LLM como GPT, Anthropic, Gemini y Azure OpenAI, u optar por opciones gratuitas integradas como GPT-4o mini y Gemini 2.0 Flash. Al reemplazar los flujos de trabajo estáticos con una toma de decisiones dinámica impulsada por IA, Zapier ofrece una experiencia de automatización más adaptable.

La función Agents in Zaps de Zapier permite a la IA tomar decisiones sobre cómo lograr objetivos de forma autónoma, yendo más allá de los flujos de trabajo rígidos. Estos agentes pueden realizar tareas como búsquedas web, redactar mensajes y actualizar bases de datos sin intervención manual. La plataforma también admite el procesamiento de imágenes, audio y vídeo directamente dentro de los flujos de trabajo. Con el conector Model Context Protocol (MCP), los desarrolladores pueden integrar sin problemas herramientas de IA externas en el ecosistema de Zapier de más de 8000 aplicaciones sin necesidad de configuraciones API complejas. Para mayor control, los pasos de aprobación realizados por humanos, como las revisiones basadas en Slack, permiten a los equipos verificar las acciones generadas por IA antes de finalizarlas, lo que mejora tanto la precisión como la confianza en la automatización.

Zapier demuestra su valor en la ampliación de operaciones a través de aplicaciones del mundo real. Por ejemplo:

Estos ejemplos resaltan cómo la automatización de la IA puede impulsar la eficiencia y el impacto financiero en diversas industrias.

__XLATE_16__

"Zapier hace que nuestro equipo de tres parezca un equipo de diez." - Marcus Saito, jefe de automatización de TI e IA, remoto

Zapier cumple con los estándares SOC 2 Tipo II, GDPR, GDPR UK y CCPA, con salvaguardas para garantizar que los modelos de IA de terceros no utilicen datos de clientes para capacitación. La plataforma ofrece herramientas de gobernanza centralizada como Domain Capture para una visibilidad total del uso, controles de aplicaciones para restringir integraciones específicas de IA y permisos detallados a nivel de equipo, aplicación y datos. Las medidas de seguridad incluyen Enterprise SSO (SAML 2.0), SCIM, autenticación de dos factores, listas de IP permitidas y emparejamiento de VPC para una conectividad interna segura. Los datos están protegidos con protocolos de transporte y cifrado de primer nivel, lo que garantiza la transparencia en los cambios del flujo de trabajo. Los precios comienzan en $19.99/mes para planes Professional, $69/mes para planes Team, con opciones de precios personalizadas disponibles para planes Enterprise que incluyen usuarios ilimitados.

Make conecta más de 3000 aplicaciones mediante un lienzo visual que muestra sus flujos de trabajo de automatización. A diferencia de las herramientas lineales tradicionales, Make emplea automatización basada en escenarios, que incorpora lógica de ramificación, filtros y flujos de trabajo flexibles de múltiples rutas. Su creador visual es especialmente hábil en el manejo de transformaciones de datos, gracias a funciones como iteradores y agregadores. Esto lo convierte en una buena opción para procesar grandes volúmenes de datos sin necesidad de habilidades de codificación.

Make proporciona módulos nativos para herramientas populares como OpenAI (ChatGPT, DALL-E, Whisper) y Google Gemini, al tiempo que admite cualquier modelo compatible con OpenAI a través de su módulo HTTP. En 2026, la plataforma introdujo Make AI Agents: automatizaciones basadas en objetivos que seleccionan herramientas de forma autónoma para lograr objetivos definidos. Estos agentes aprovechan los escenarios de Make existentes para manejar tareas sin intervención manual. Además, Make funciona como un servidor Model Context Protocol (MCP), lo que permite que los modelos de IA externos, como Claude, ejecuten de forma segura escenarios de Make como herramientas para tareas del mundo real.

De cara al futuro, el asistente Make Maia permitirá a los usuarios crear flujos de trabajo complejos simplemente describiéndolos en lenguaje natural. Esta característica permitirá que las automatizaciones se creen de forma conversacional, lo que reducirá la necesidad de configuración práctica y simplificará el proceso para los usuarios.

Make utiliza un modelo de precios basado en operaciones, cobrando por ejecución de módulo en lugar de por flujo de trabajo completado. El plan Gratuito incluye 1.000 operaciones al mes y 2 escenarios activos. Los planes pagos comienzan en $9/mes para el plan Core (10,000 operaciones, escenarios ilimitados), $16/mes para Pro (que agrega soporte prioritario) y $29/mes para Teams (con capacidades multiusuario). Se pueden comprar operaciones adicionales por aproximadamente $1 por cada 1000 operaciones. Este modelo puede resultar muy económico para flujos de trabajo complejos con lógica de ramificación, ya que solo se paga por los módulos que se ejecutan. Sin embargo, los pasos de la IA pueden consumir varios créditos por ejecución, según su complejidad.

Make’s pricing model and operational framework support scalability, from simple automations to enterprise-level workflows. The platform ensures data integrity with ACID transactions and offers tools for bulk data processing. It boasts a 99.9% infrastructure availability rate and average response times under 200ms for standard integrations. Examples of its scalability in action include:

__XLATE_23__

El jefe de operaciones de Teleclinic compartió: "Make realmente nos ayudó a escalar nuestras operaciones, eliminar la fricción de nuestros procesos, reducir costos y aliviar a nuestro equipo de soporte".

__XLATE_25__

El director de operaciones de Shop Accelerator Martech comentó: "Make impulsa una eficiencia sin precedentes dentro de nuestro negocio de maneras que nunca imaginamos. Es tener un empleado adicional (o 10) por una fracción del costo".

The upcoming Make Grid feature, set to launch in 2026, will act as a "Command Center", providing a visual overview of an organization’s entire automation ecosystem. This tool will help teams identify bottlenecks and monitor workflow performance in real time.

Make adheres to SOC 2 Type II, GDPR, and SCIM standards, offering Single Sign-On (SSO) and a secure connection manager that stores API keys securely instead of embedding them directly in workflows. The "Scenario Run Replay" feature allows users to replay failed executions with the original data, speeding up troubleshooting processes. Enterprise plans include advanced governance options and dedicated support, though some users have noted that the platform’s role-based access control (RBAC) is less detailed compared to other enterprise solutions. To minimize risks, critical modules should include manual error-handling configurations to prevent silent data loss during API disruptions. For organizations with strict compliance needs, redirecting execution data to an external logging service may be advisable, as Make’s native logs are retained only for a limited time based on the plan.

n8n se destaca como una plataforma diseñada pensando en los desarrolladores, que ofrece opciones tanto alojadas en la nube como autohospedadas. Opera con un modelo de precios basado en la ejecución, donde una ejecución de flujo de trabajo equivale a una ejecución, sin importar cuántos pasos incluya. Esto lo convierte en una opción práctica para gestionar flujos de trabajo de IA complejos y de varios pasos sin los costos más altos que a menudo se asocian con los precios basados en tareas.

n8n proporciona integración nativa de LangChain, lo que permite a los usuarios crear sistemas avanzados de inteligencia artificial de múltiples agentes y canalizaciones RAG (recuperación-generación aumentada) directamente dentro de su editor visual. Con AI Agent Node, los LLM estándar se pueden transformar en agentes impulsados por objetivos capaces de utilizar herramientas, tomar decisiones y retener memoria en flujos de trabajo complejos. La plataforma admite una variedad de LLM, incluidos OpenAI, Anthropic (Claude), Google Gemini, DeepSeek, Groq y Hugging Face, junto con integraciones de bases de datos vectoriales como pgvector, Pinecone, Chroma, Qdrant y Weaviate. Su AI Workflow Builder puede incluso convertir automáticamente descripciones en lenguaje natural en flujos de trabajo funcionales. Al encadenar solicitudes de IA y utilizar modelos más baratos para los pasos intermedios, los usuarios pueden reducir los costos de API entre un 30% y un 50%.

n8n’s execution-based pricing ensures affordability for even the most complex workflows. Technical users can access the self-hosted Community Edition for free, with unlimited workflows and executions. For cloud-hosted options, the Cloud Starter plan begins at $20/month for 2,500 executions, while Cloud Pro offers 10,000 executions for $50/month. For businesses, the self-hosted Business plan costs $800/month, offering advanced features, while Enterprise pricing is customized for organizations requiring features like advanced RBAC, SSO, and dedicated support. By charging per workflow execution instead of per step, n8n can save organizations over $500 per month on high-volume workflows compared to task-based pricing models.

n8n is built to handle up to 220 workflow executions per second per instance. Its Queue Mode leverages Redis to distribute execution across multiple worker processes, enabling horizontal scaling to meet increasing demands for fast and efficient AI workflows. For instance, in 2025, Dennis Zahrt, Director of Global IT Service Delivery at Delivery Hero, implemented a user management workflow that saved the company 200 hours each month. Similarly, Luka Pilic, Marketplace Tech Lead at StepStone, reported a dramatic improvement in efficiency, completing two weeks’ worth of API integration and data transformation work in just two hours.

__XLATE_29__

"Me lleva un máximo de 2 horas conectar las API y transformar los datos que necesitamos. No se puede hacer esto tan rápido en código". - Luka Pilic, líder tecnológico del mercado, StepStone

n8n prioriza la seguridad al integrarse con administradores de secretos externos como AWS Secrets Manager, Azure Key Vault, Google Cloud Platform, HashiCorp Vault e Infisical, lo que garantiza que las credenciales confidenciales permanezcan fuera de la plataforma. Para los usuarios que optan por el autohospedaje a través de Docker o Kubernetes, todos los datos, credenciales y registros del flujo de trabajo permanecen dentro de su propio firewall, lo que respalda el cumplimiento de regulaciones como HIPAA, GDPR y SOC 2. Los usuarios empresariales se benefician de RBAC avanzado a través de "Proyectos", que restringen el acceso a flujos de trabajo y credenciales específicos según los roles. Además, el control de fuente basado en Git permite el movimiento seguro de flujos de trabajo entre entornos de desarrollo, ensayo y producción.

Gumloop es una plataforma diseñada específicamente para ayudar a los equipos a aprovechar modelos de lenguajes grandes (LLM) con facilidad. En el corazón de este sistema se encuentra Gummie, un asistente de inteligencia artificial que convierte instrucciones en lenguaje natural en flujos de trabajo completamente funcionales. Esta capacidad ha demostrado ser invaluable para las organizaciones. Fidji Simo, director ejecutivo de Instacart, compartió: "Gumloop ha sido fundamental para ayudar a todos los equipos de Instacart, incluidos aquellos sin habilidades técnicas, a adoptar la IA y automatizar sus flujos de trabajo, lo que ha mejorado enormemente nuestra eficiencia operativa".

Gumloop supports model-agnostic workflows, allowing users to switch seamlessly between models like GPT-4o, Claude 3.7 Sonnet, Deepseek V3 R1, and Gemini 2.5 Pro within a single automation. Unlike many platforms that require users to manage API keys separately, Gumloop simplifies the process by including LLM costs in its subscription plans. The AI Router node intelligently assigns tasks to the right models, while the Model Context Protocol (MCP) server enables connections to custom APIs, extending the platform’s capabilities beyond its 125+ built-in nodes. This setup ensures predictable pricing and smooth integration.

Gumloop’s pricing structure is designed for flexibility and clarity:

Al incluir los costos de la API de LLM en sus planes de suscripción en lugar de cobrar por tarea, Gumloop simplifica la elaboración de presupuestos, lo que facilita a las organizaciones escalar sus flujos de trabajo de IA sin gastos inesperados.

Gumloop’s structure is designed to grow alongside organizations of any size. It uses a hierarchical approach, with Organizations providing centralized control and Workspaces enabling collaboration across departments like Sales, Marketing, and Operations. The platform also supports agentic workflows, where AI agents can assess tasks dynamically and trigger workflows based on context instead of following rigid sequences. Bryant Chou of Webflow remarked, "Gumloop wins time back across an org. It puts the tools into the hands of people who understand a task and lets them completely automate it away." Additionally, the platform’s ability to auto-scale and execute workflows in parallel ensures it can handle the demands of enterprise operations.

Gumloop prioriza la seguridad y el cumplimiento para satisfacer las necesidades organizacionales. Cumple con los estándares SOC 2 y GDPR e incluye herramientas para control de nivel empresarial. Los administradores pueden hacer cumplir las listas de permisos/denegaciones de modelos de IA, garantizando el cumplimiento de regulaciones como HIPAA al restringir ciertos modelos o proveedores. El modo incógnito mejora la privacidad al borrar todas las entradas, salidas e intermediarios en tiempo real. Las políticas de seguridad centralizadas están respaldadas además por credenciales a nivel de organización, que anulan las claves personales o del espacio de trabajo para evitar el acceso no autorizado. Para las organizaciones que requieren máxima seguridad, las implementaciones de VPC permiten a Gumloop operar dentro de su propia infraestructura de nube. El registro de auditoría integral rastrea cada acción en la plataforma y ofrece una vista transparente del flujo de datos y los cambios administrativos, ya sea a través de un panel o API.

Lindy.ai se destaca en el panorama de la automatización al crear agentes de inteligencia artificial que piensan y se adaptan en lugar de seguir guiones rígidos y preestablecidos. Con su innovador enfoque de "codificación de vibración", los usuarios pueden describir el comportamiento de un agente en un lenguaje sencillo y la plataforma lo transforma rápidamente en una solución lista para producción, a veces en tan solo 5 minutos. Esto permite a las empresas reducir las tareas repetitivas mediante la implementación de agentes equipados con memoria y adaptabilidad.

La plataforma aprovecha GPT y Claude para potenciar agentes capaces de analizar texto, generar resultados y comprender la intención del usuario. A diferencia de las herramientas de automatización tradicionales que fallan cuando se enfrentan a contextos cambiantes, los agentes de Lindy.ai utilizan la memoria para navegar por escenarios complejos, incluidos casos extremos que a menudo requieren intervención humana. Con soporte para más de 3000 integraciones nativas (y hasta más de 7000 en ciertas configuraciones), Lindy.ai se conecta perfectamente con sistemas CRM, plataformas de correo electrónico y herramientas de calendario. El CEO Flo Crivello destaca esta capacidad:

__XLATE_37__

Los flujos de trabajo impulsados por IA pueden manejar esos casos extremos y adaptarse para mantener la automatización en marcha.

Su función Autopilot mejora la funcionalidad al proporcionar a los agentes sus propias computadoras basadas en la nube, lo que les permite ejecutar tareas más allá de las integraciones API típicas. Además, la coordinación de múltiples agentes permite que agentes especializados colaboren en procesos comerciales complejos, cerrando la brecha entre la automatización y la toma de decisiones en tiempo real.

Lindy.ai ofrece un modelo de precios basado en tareas, que cobra por la ejecución de las tareas en lugar de por usuario, lo que lo convierte en una opción económica para equipos con altas demandas de uso. Los niveles de precios incluyen:

Los cargos adicionales incluyen llamadas telefónicas AI a 20 créditos por minuto y números de teléfono AI a $10 por número al mes, lo que ofrece flexibilidad para tareas especializadas.

Lindy.ai está diseñado para escalar sin esfuerzo y adaptarse tanto a usuarios individuales como a grandes empresas. Las cuentas de equipo permiten compartir e implementar de forma segura agentes de IA entre departamentos, mientras que la función Agent Swarms permite que un solo agente se clone a sí mismo y realice cientos de tareas simultáneamente, como administrar campañas de divulgación personalizadas. Para flujos de trabajo que requieren precisión, la función Human-in-the-Loop (HITL) permite que la IA maneje la mayoría de las tareas, pero se detiene para la revisión humana en puntos críticos, lo que la hace ideal para operaciones sensibles en áreas como finanzas, recursos humanos o atención al cliente.

Lindy.ai prioriza la seguridad y el cumplimiento, cumpliendo con estándares rigurosos como SOC 2, HIPAA, GDPR y PIPEDA. La plataforma incluye un Centro de confianza y herramientas de gestión de secretos para abordar los requisitos de seguridad a nivel empresarial. A través de cuentas de equipo, las organizaciones pueden configurar permisos y controles para garantizar que los agentes operen de forma segura y predecible. Para los proveedores de atención médica, Lindy.ai ofrece un anotador compatible con HIPAA diseñado para documentación médica, que aborda las necesidades únicas de industrias reguladas como la atención médica y las finanzas.

StackAI proporciona una plataforma sin código que une grandes modelos de lenguaje (LLM) con datos empresariales a través de un lienzo visual 2D intuitivo. Los equipos empresariales pueden crear fácilmente flujos de trabajo utilizando herramientas de arrastrar y soltar, mientras que los desarrolladores tienen la flexibilidad de mejorar estos flujos de trabajo con nodos Python para una mayor personalización. En 2025, Stefan Galluppi, CIO de LifeMD, utilizó StackAI para simplificar complejos flujos de trabajo de IA, demostrando la eficacia de la plataforma.

Este diseño fácil de usar admite una integración perfecta con los principales LLM.

StackAI admite de forma nativa los principales LLM, incluidos OpenAI, Anthropic (Claude), Mistral, Google, Meta, Azure OpenAI y modelos locales a través de puntos finales. Su enrutamiento nativo de IA introduce nodos lógicos para la toma de decisiones si/de lo contrario e indicaciones dinámicas, lo que permite el enrutamiento automatizado de tareas basado en resultados de LLM. Un nodo de base de conocimientos integrado simplifica el proceso de recuperación-generación aumentada (RAG) al manejar la fragmentación, incrustación, indexación y recuperación con citas, cubriendo el 90% de los casos de uso de RAG listos para usar.

La plataforma también se destaca en el procesamiento de datos no estructurados y ofrece herramientas para análisis de PDF, web scraping y OCR. Esto transforma los datos sin procesar en información estructurada que se puede implementar como chatbots, formularios web, procesadores por lotes para tareas masivas o API REST para la integración de backend. Por ejemplo, en el MIT Martin Trust Center, Doug Williams, líder de Gen AI, creó asistentes de IA para estudiantes en solo unas semanas, revolucionando su experiencia de aprendizaje sin necesidad de habilidades de codificación. De manera similar, Brian Hayt, director de BI en Noblereach, redujo el tiempo necesario para generar informes completos para subvenciones e investigaciones competitivas de una semana a solo cinco minutos.

StackAI ofrece una estructura de precios clara y flexible con tres niveles: un plan gratuito para la creación de prototipos en etapas iniciales, un modelo SaaS basado en el uso para escalar operaciones y un plan empresarial personalizado diseñado para implementaciones a gran escala, incluida la nube privada o las opciones locales.

Este precio flexible garantiza que StackAI pueda brindar soporte a los usuarios en cada etapa, desde prototipos a pequeña escala hasta aplicaciones de nivel empresarial.

La plataforma se adapta a las necesidades individuales y empresariales y cuenta con más de 100 plantillas prediseñadas para una implementación rápida. Las herramientas de nivel empresarial incluyen SSO, protección con contraseña, dominios personalizados y análisis centralizados para monitorear el uso y el rendimiento de los tokens. Los desarrolladores pueden ampliar los flujos de trabajo con código personalizado o nodos API, mientras que los usuarios no técnicos se benefician del sencillo generador visual. Guillermo Rauch, CEO de Vercel, destaca su accesibilidad:

__XLATE_51__

StackAI hace realidad la promesa de los agentes de IA. Para todos, a escala, con solo apuntar y hacer clic.

Este equilibrio entre simplicidad y funcionalidad avanzada hace de StackAI una herramienta poderosa para organizaciones de todos los tamaños.

StackAI prioriza la seguridad con un modelo de gobernanza de 8 capas que incluye RBAC, controles a nivel de carpeta, control de versiones de proyectos, SSO, conexiones cifradas, análisis de producción y MFA. La plataforma cumple con los estándares SOC 2 Tipo II, HIPAA y GDPR, con la certificación ISO 27001 en proceso. Funciones como la detección y redacción de PII, las políticas de retención de datos y un compromiso estricto de no utilizar datos de usuario para la capacitación de modelos en virtud de contratos empresariales garantizan la privacidad de los datos. Para industrias con estrictos requisitos de residencia de datos, como defensa y finanzas, StackAI admite implementaciones de nube privada y local. Además, los flujos de trabajo de aprobación manual garantizan que ningún agente de IA entre en funcionamiento sin una revisión adecuada.

Este enfoque integral de gobernanza y seguridad convierte a StackAI en una opción confiable para organizaciones con altos estándares de cumplimiento y privacidad.

Pipedream is a platform designed with developers in mind, blending serverless infrastructure with AI-driven workflow automation. It’s trusted by over 1,000,000 developers, from small startups to Fortune 500 companies, handling billions of events and supporting data pipelines that process over 10,000,000 events per second. After being acquired by Workday in December 2025, Pipedream has strengthened its focus on enterprise-level stability and governance, giving developers more control and flexibility in automation. This foundation supports its advanced AI integration capabilities.

The platform’s code-centric design is a key feature, allowing developers to write custom Node.js, Python, Go, or Bash code directly within workflows. It also supports the use of any npm or PyPI package in a serverless environment. This flexibility makes it easier for developers to prototype quickly without the limitations often found in no-code platforms.

Pipedream incorpora herramientas de IA como "Crear con IA", "Editar con IA" y "Depurar con IA", impulsadas por String.com, para ayudar a los desarrolladores a crear, modificar y solucionar problemas de flujos de trabajo utilizando indicaciones en lenguaje natural y correcciones de errores automatizadas.

The platform supports the Model Context Protocol (MCP), which includes a Docs MCP Server. This feature enables AI assistants like Claude and development environments such as VSCode to search Pipedream documentation and generate precise integration code. Pre-built actions are available for popular LLMs like OpenAI and Claude, handling tasks such as text classification, summarization, and embeddings. Developers can also write their own code to interact with any LLM API using Pipedream’s serverless environment.

Pipedream utiliza una estructura de precios basada en créditos donde 1 crédito equivale a 30 segundos de tiempo de cálculo.

Para las empresas, hay disponibles precios personalizados con funciones adicionales como cumplimiento de HIPAA y registros de auditoría.

Pipedream está diseñado para brindar escalabilidad y ofrece funciones como memoria ajustable, tiempos de espera personalizados, límites de velocidad y administración de arranque en frío. Admite patrones controlados por eventos y activadores en tiempo real, lo que lo hace ideal para el procesamiento de datos de gran volumen y la automatización de backend. Con más de 3000 integraciones de aplicaciones y gestión de autenticación integrada, los equipos pueden crear flujos de trabajo complejos sin preocuparse por el manejo manual de credenciales.

Para los equipos de desarrolladores, la plataforma proporciona herramientas como GitHub Sync, integración de VS Code e implementación de servidores MCP. Las notas de pasos permiten a los desarrolladores agregar explicaciones basadas en rebajas directamente a los pasos del flujo de trabajo, mejorando la comunicación y la documentación del equipo.

Pipedream prioriza la gobernanza y la seguridad además del rendimiento. La plataforma tiene certificación SOC 2 Tipo II, cumple con HIPAA y cumple con los estándares GDPR. Incluye un Acuerdo de procesamiento de datos (DPA) para administrar datos confidenciales. Las características clave de seguridad incluyen:

Para los usuarios empresariales, se encuentran disponibles opciones adicionales como SAML SSO, SCIM para gestión de identidad y autenticación de dos factores (2FA). El registro de auditoría se incluye en el nivel Enterprise y proporciona información sobre las ejecuciones y los cambios del flujo de trabajo. Además, los activadores y acciones disponibles en el origen mejoran la transparencia de las revisiones de seguridad.

Workato is a platform designed to handle complex, cross-departmental processes for enterprises. It’s trusted by over 2,000 brands, including Broadcom, Zendesk, and Atlassian, to manage workflows that require high uptime and strict governance.

La plataforma presenta Workato Agentic & Genie Framework, que utiliza la automatización impulsada por IA para ir más allá de las capacidades básicas del chatbot. Estos agentes de IA especializados, llamados "Genios", pueden recuperar datos, desencadenar acciones en más de 8500 aplicaciones y gestionar procesos dinámicos. AI Connector, desarrollado en colaboración con Anthropic y OpenAI, aprovecha modelos como Sonnet 4 de Anthropic y GPT-4o mini de OpenAI para tareas como análisis de texto, redacción de correos electrónicos, resúmenes y traducción.

At the heart of Workato’s AI capabilities is Workato Genie, which uses generative AI to interpret user intent, incorporate real-time enterprise data, and execute tasks autonomously. Bhaskar Roy, Chief of AI Products & Solutions at Workato, highlights its impact:

__XLATE_64__

"Con Workato Agentic, las empresas ahora pueden crear y gestionar rápidamente agentes de IA con código bajo o sin código para potenciar la productividad e impulsar la eficiencia operativa en toda su organización".

Workato también incluye AIRO (AI Orchestrator), un asistente impulsado por IA que ayuda a los usuarios a crear y perfeccionar flujos de trabajo utilizando lenguaje natural. Las acciones de IA preconfiguradas ofrecen capacidades LLM integradas, mientras que Agent Studio envía decisiones confidenciales a humanos a través de Slack o Microsoft Teams para su aprobación. Para los espacios de trabajo de los clientes, las acciones del conector AI están limitadas a 60 solicitudes por minuto.

The platform offers pre-built applications known as Genie Apps, such as ITGenie for handling helpdesk tickets and SalesGenie to boost sales productivity. These Genies adapt based on user interactions, ensuring that learning remains specific to the customer’s environment to protect data privacy.

La integración de IA de Workato se combina con la capacidad de escalar de manera efectiva en grandes organizaciones.

Workato’s workflows are designed to scale across enterprises and mid-sized businesses, connecting with over 8,500 apps, databases, and ERP systems. With orchestration patterns capable of managing more than 850 billion actions, the platform also supports Data Pipelines for high-volume replication to data warehouses like Snowflake and Databricks. These pipelines use parallel execution and automatic schema updates to handle large datasets efficiently.

Los modelos de decisión simplifican la lógica empresarial compleja, como la fijación de precios dinámicos o la puntuación de clientes potenciales, al almacenar reglas en tablas centralizadas fuera de los flujos de trabajo individuales. Este enfoque simplifica la auditoría y las actualizaciones. Mientras tanto, las tablas de datos, una actualización de las tablas de búsqueda, almacenan conjuntos de datos significativamente más grandes con funcionalidad de búsqueda avanzada.

Workato’s global infrastructure supports local data residency with data centers in the EU, Australia, and Singapore. The platform is available in eight languages, including Japanese, Korean, and Spanish, and maintains a 99.9% uptime SLA for critical operations. It has been recognized as a Leader in the Gartner® Magic Quadrant™ for iPaaS seven times, with two instances of being positioned furthest in "Vision" as of 2025.

Para complementar su escalabilidad, Workato prioriza la gobernanza y la seguridad.

Workato’s Enterprise MCP Gateway serves as a secure control layer between AI tools and business systems, enforcing policies and ensuring visibility during runtime. AI agents operate under user-specific OAuth credentials, limiting access to authorized data. Additional safeguards include PII masking and de-identification within workflows.

Los administradores pueden definir "habilidades confiables", que son recetas o conectores preaprobados que los agentes pueden usar, evitando llamadas API no autorizadas. RBAC 2.0 garantiza permisos precisos a nivel de proyecto, evitando una expansión innecesaria de roles. La plataforma también incluye medidas de seguridad avanzadas como cifrado BYOK, rotación de claves cada hora y aislamiento de contenedores con mTLS. Las certificaciones incluyen SOC 2 Tipo II, ISO 27001, PCI DSS y cumplimiento de GDPR.

Los seguimientos de auditoría en tiempo real y las aprobaciones humanas garantizan la responsabilidad de todas las acciones de los agentes. La función Revisiones y aprobaciones agiliza la implementación de recetas en entornos de desarrollo, pruebas y producción. Una organización informó que procesa las solicitudes de reubicación de empleados un 98 % más rápido con Workato.

Workato sigue un modelo de precios centrado en la empresa, sin tarifas disponibles públicamente. Los precios se adaptan en función de factores como la cantidad de tareas, el uso del conector avanzado y la cantidad de usuarios. Las pequeñas empresas suelen gastar entre $ 500 y $ 3000 por mes, las empresas medianas entre $ 3000 y $ 10 000 y las grandes empresas a menudo superan los $ 10 000 mensuales en integraciones y soporte personalizados. La plataforma está diseñada para organizaciones que requieren gobernanza avanzada y gestión de procesos complejos.

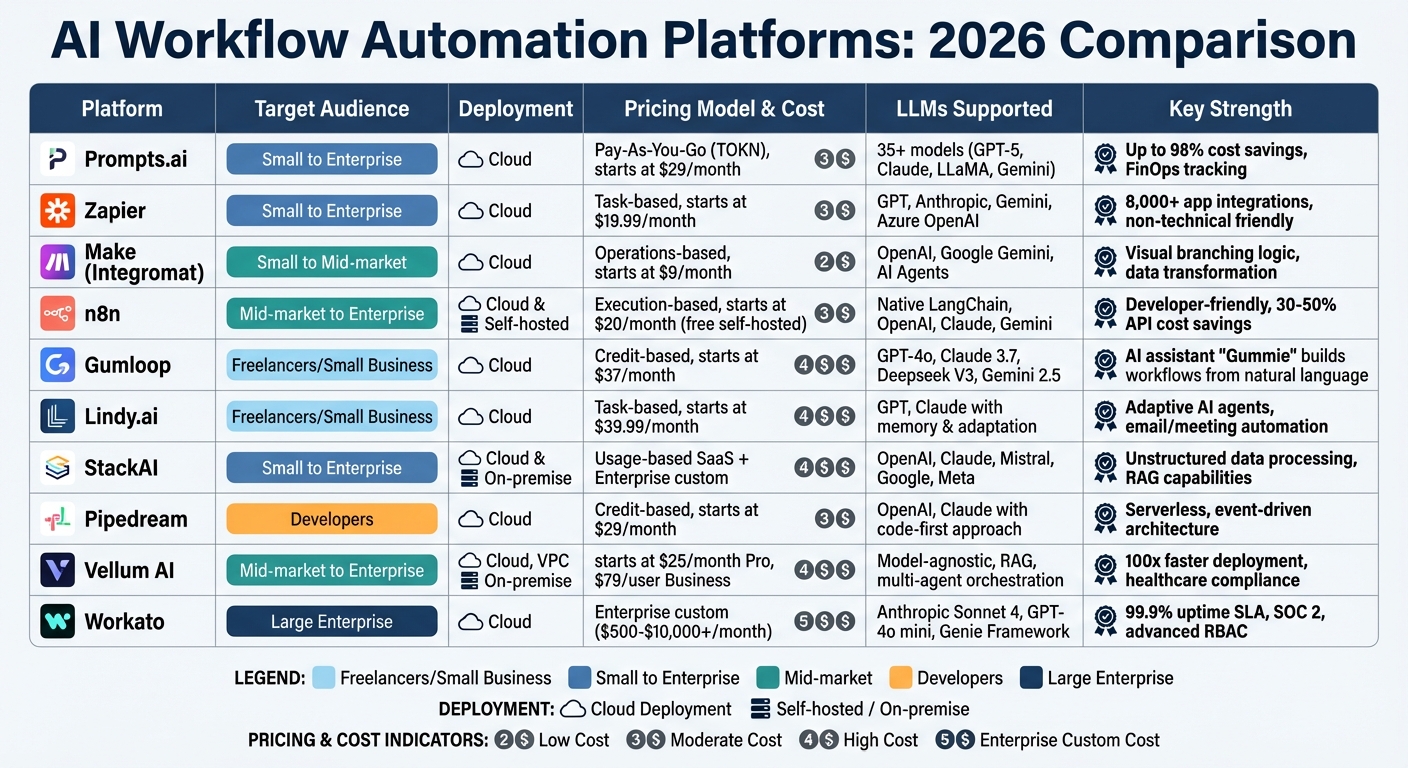

Comparación de plataformas de flujo de trabajo de IA: características, precios y características Público objetivo 2026

Choosing the right AI workflow platform depends on your team’s size, technical expertise, budget, and governance requirements. To simplify the decision-making process, the table below provides a side-by-side comparison of key features across various platforms.

Esta comparación destaca cómo cada plataforma satisface necesidades comerciales específicas, equilibrando los modelos de precios y la flexibilidad de implementación. Por ejemplo, n8n ofrece costos predecibles y flexibilidad con su opción gratuita de alojamiento propio, lo que lo hace atractivo para los equipos técnicos. Por el contrario, plataformas como Zapier priorizan la facilidad de uso para usuarios no técnicos, pero pueden resultar costosas con un gran volumen de tareas.

Al considerar las opciones de implementación, la privacidad de los datos es un factor clave. A diferencia de la mayoría de las plataformas basadas únicamente en la nube, n8n permite el autohospedaje, lo que brinda a los equipos control total sobre su infraestructura. Por otro lado, las soluciones empresariales como Workato se centran en la gobernanza y el cumplimiento avanzados, lo que las hace ideales para gestionar flujos de trabajo sensibles y de gran volumen. Estas distinciones garantizan que las empresas puedan alinear las capacidades de la plataforma con sus prioridades operativas.

Choosing the right AI workflow platform in 2026 requires aligning your team's technical skills with your organization’s scale and compliance needs. For non-technical teams, tools like Zapier or Lindy.ai offer intuitive, prompt-based environments. On the other hand, developer-heavy organizations often prefer platforms like n8n or Pipedream, which provide greater customization through code extensions. A key differentiator among these platforms is how they manage workflow maintenance, a theme that has been explored throughout this guide.

La evolución de la automatización básica a los flujos de trabajo autónomos de IA introduce nuevas demandas: manejo de la toma de decisiones semántica, generación de recuperación aumentada y orquestación de múltiples agentes. Como dice Nicolas Zeeb:

__XLATE_77__

El camino a seguir en 2026 es dar un gran salto desde ser una disciplina exclusiva para desarrolladores de automatización de IA a un deporte de equipo.

Este cambio enfatiza la importancia de las plataformas que combinan flexibilidad técnica con características de gobernanza, lo que permite a los ingenieros y expertos en la materia colaborar de manera efectiva. Estos desafíos resaltan la importancia de las métricas de desempeño y la transparencia operativa.

Las plataformas listas para producción se destacan por características como registro en tiempo real, control de versiones y estructuras de precios claras. Dado que el 95% de los pilotos de IA generativa no logran pasar a producción debido a limitaciones de infraestructura, las herramientas que respaldan la observabilidad y la previsibilidad de costos son esenciales. Muchas organizaciones logran resultados a nivel de producción en un plazo de 2 a 6 semanas comenzando con pilotos enfocados, incorporando enrutamiento semántico desde el principio e introduciendo pruebas de regresión hacia la tercera semana.

Más allá de las capacidades técnicas, el cumplimiento normativo y de seguridad es crucial para la adopción empresarial. Funciones como el control de acceso basado en roles (RBAC), el cumplimiento de SOC 2, los registros de auditoría y las opciones de implementación flexibles garantizan que las plataformas puedan escalar y al mismo tiempo cumplir con los requisitos normativos. Como se destacó anteriormente, plataformas como Prompts.ai y Workato integran eficazmente estos controles para abordar diversas necesidades empresariales.

Si bien los agentes de IA podrían aportar un valor de 450 mil millones de dólares para 2028, solo el 2% de las organizaciones los ha adoptado plenamente. Las plataformas analizadas en esta guía proporcionan la base para cerrar esta brecha, transformando experimentos aislados de IA en flujos de trabajo escalables y mensurables que impulsan la productividad.

Las plataformas de flujo de trabajo de IA en 2026 brindarán ventajas revolucionarias tanto a empresas como a profesionales. Simplifican la automatización de tareas complejas, mejoran la eficiencia del flujo de trabajo y centralizan la gestión de varios modelos de IA. Estas capacidades conducen a importantes reducciones de costos y a un aumento de hasta diez veces la productividad.

Más allá de la eficiencia, estas plataformas abordan cuestiones apremiantes como el cumplimiento, la seguridad y el desafío de integrar múltiples herramientas. Al unificar los modelos de IA y automatizar los procesos de gobernanza, garantizan operaciones fluidas. También se integran sin esfuerzo con modelos de lenguajes grandes y avanzados, lo que permite a las organizaciones escalar sus operaciones de manera efectiva mientras mantienen el control y la supervisión de sus flujos de trabajo de IA. Esta combinación de eficiencia y supervisión hace que estas plataformas sean esenciales para impulsar la productividad y mantener altos estándares operativos.

Prompts.ai permite a las empresas reducir gastos sin dejar de ser transparentes al ofrecer seguimiento de costos en tiempo real y un modelo de precios flexible de pago por uso. Estas herramientas permiten a las empresas vigilar de cerca sus gastos y pagar solo por los recursos que utilizan activamente, garantizando que los gastos sigan siendo predecibles y adaptables.

Además de eso, Prompts.ai enfatiza la seguridad y el cumplimiento, presentando los estándares de cumplimiento SOC 2 Tipo II y HIPAA. Estas medidas ayudan a reducir el riesgo de costosos reveses regulatorios. Al combinar una gestión de costos eficaz con sólidas garantías de cumplimiento, Prompts.ai ayuda a las organizaciones a optimizar sus flujos de trabajo sin enfrentar obstáculos financieros inesperados.

Las plataformas de flujo de trabajo de IA dan prioridad a protocolos de seguridad sólidos para proteger la información confidencial y cumplir con las regulaciones de la industria. Las medidas clave incluyen cifrado para proteger los datos tanto en tránsito como en reposo, controles de acceso basados en roles para gestionar los permisos de los usuarios y el cumplimiento de marcos como SOC 2 y GDPR.

Muchas plataformas también ofrecen funciones avanzadas, como detección de amenazas en tiempo real, gestión segura de claves y certificaciones que validan su enfoque en la seguridad. Estas herramientas ayudan a reducir riesgos como el acceso no autorizado, las filtraciones de datos y el robo de modelos de IA, lo que permite a las empresas gestionar con confianza los flujos de trabajo impulsados por la IA.