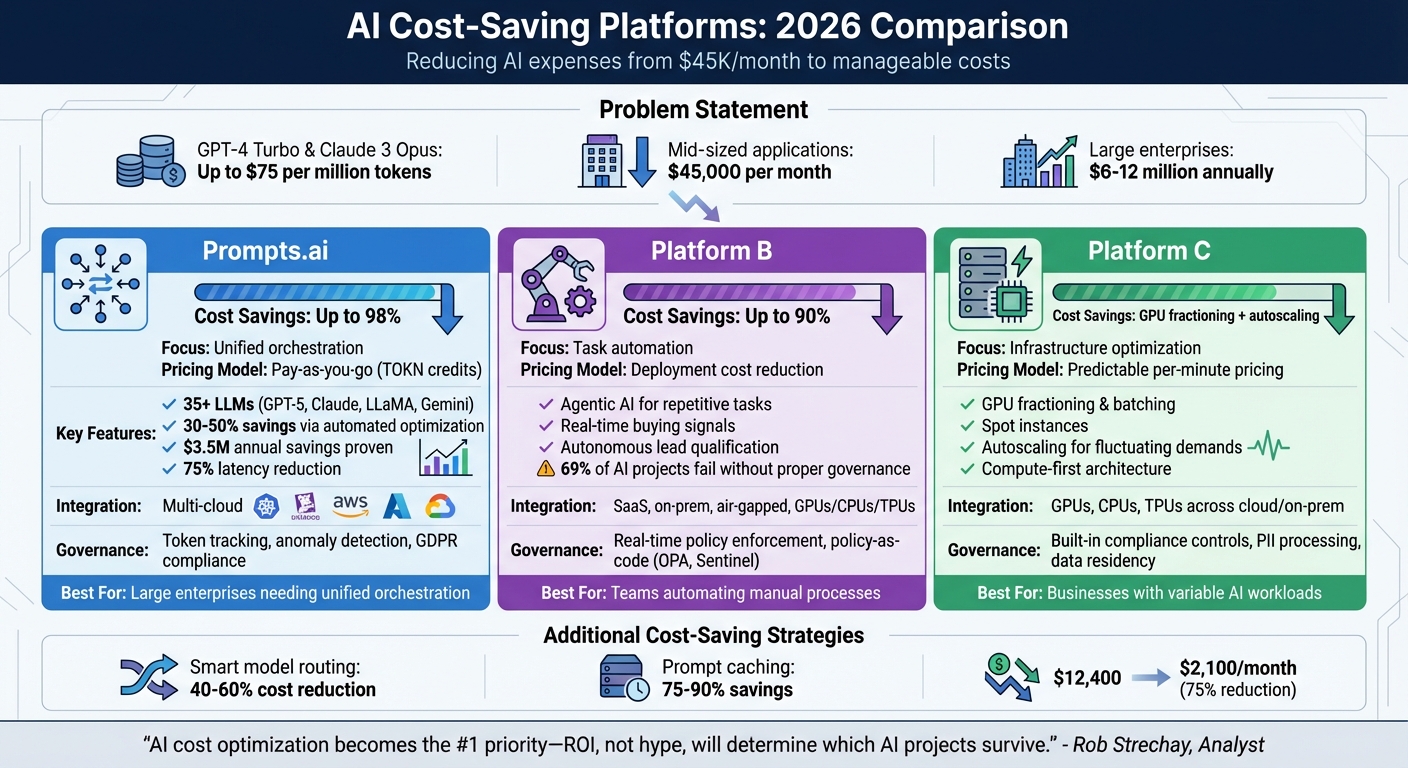

Bis 2026 hat die Verwaltung der KI-Kosten für Unternehmen höchste Priorität. Bei Modellen wie GPT-4 Turbo und Claude 3 Opus, die bis zu 75 US-Dollar pro Million Token kosten, können die Kosten schnell außer Kontrolle geraten 45.000 US-Dollar pro Monat für mittelgroße Anwendungen und $6–12 million annually für große Unternehmen. Um dieses Problem anzugehen, bieten Plattformen wie Prompts.ai, Plattform B und Plattform C bieten Lösungen zur Kostensenkung durch einheitliche Orchestrierung, Automatisierung usw Infrastrukturoptimierung. Zu den wichtigsten Erkenntnissen gehören:

Diese Plattformen rationalisieren Arbeitsabläufe, reduzieren Kosten und stellen Compliance sicher und helfen Unternehmen dabei, ihre Leistung aufrechtzuerhalten und gleichzeitig das Budget einzuhalten.

| Funktion/Plattform | Prompts.ai | Plattform B | Plattform C |

|---|---|---|---|

| Kosteneinsparungen | Bis zu 98 % | Bis zu 90 % | GPU-Fraktionierung, automatische Skalierung |

| Fokus | Einheitliche Orchestrierung | Aufgabenautomatisierung | Infrastrukturoptimierung |

| Preismodell | Pay-as-you-go (TOKN-Guthaben) | Reduzierung der Bereitstellungskosten | Vorhersehbare Minutenpreise |

| Integration | Multi-Cloud, Kubernetes, Datadog | SaaS, vor Ort, Air-Gap | GPUs, CPUs, TPUs |

| Regierungsführung | Token-Verfolgung, Anomalieerkennung | Richtliniendurchsetzung in Echtzeit | Integrierte Compliance-Kontrollen |

Choosing the right platform depends on your organization’s needs, whether it's reducing costs, improving workflows, or managing compliance effectively.

__XLATE_9__

Prompts.ai vereint mehr als 35 der fortschrittlichsten großen Sprachmodelle wie GPT-5, Claude, LLaMA und Gemini in einer einheitlichen Orchestrierungsplattform. Da keine Verträge und Abonnements mehrerer Anbieter mehr erforderlich sind, können Unternehmen die Kosten für KI-Software um bis zu 98 % senken. Die Plattform basiert auf einem Pay-as-you-go-System mit TOKN-Guthaben, das sicherstellt, dass Benutzer nur für das bezahlen, was sie nutzen, ohne wiederkehrende monatliche Gebühren.

Prompts.ai delivers 30–50% savings through automated resource optimization, which adjusts compute, storage, and network resources to the exact needs of the organization. Proven implementations have shown annual savings of $3.5 million by applying these optimizations to AI training and inference workloads. The platform’s FinOps layer provides detailed cost tracking, allowing teams to pinpoint anomalies and fine-tune spending at a granular level - whether by token, inference, or API call.

Kostenkontrollen in Echtzeit helfen, Budgetüberschreitungen zu vermeiden, indem sie Ausgabenobergrenzen für Teams und Projekte festlegen. Die automatisierte GPU-Skalierung während Spitzen- und Nebenzeiten reduziert die Latenz um bis zu 75 % und senkt gleichzeitig die Kosten für Cloud-KI-Dienste. Für Kubernetes-basierte Pipelines automatisiert Prompts.ai die Spot-Instance-Nutzung und Workload-Planung und packt Workloads effizient auf kostengünstige Instanzen, ohne die Modellleistung zu beeinträchtigen. Seine nahtlosen Integrationsfähigkeiten gewährleisten außerdem die Kompatibilität mit der bestehenden Infrastruktur.

Prompts.ai verbindet sich mühelos mit Plattformen wie AWS, Azure, Google Cloud, Kubernetes, AWS Lambda, Amazon EC2, Snowflake und Datadog und ermöglicht so reibungslose Arbeitsabläufe in Ihrem aktuellen Setup. Es unterstützt Echtzeit-Datenflüsse für große Sprachmodelle und automatisiert die Bereitstellung, wodurch es für Entwickler einfacher wird, Überwachungstools wie Datadog zu integrieren oder Inferenzendpunkte bei Verkehrsspitzen zu skalieren. Diese Integrationen verbessern nicht nur die Ressourcenzuweisung, sondern minimieren auch den Betriebsaufwand. Durch die Möglichkeit paralleler Modellvergleiche können Teams die kostengünstigste Option für ihre Anforderungen auswählen, während einheitliche Prompt-Workflows den Aufwand des Jonglierens mit mehreren Tools überflüssig machen.

Über Kosteneinsparungen und Integration hinaus umfasst Prompts.ai Governance-Tools, die eine präzise Kostenverfolgung und die Einhaltung gesetzlicher Standards gewährleisten. Funktionen wie virtuelles Tagging zur Kostenzuordnung und auf maschinellem Lernen basierende Anomalieerkennung funktionieren, ohne dass Änderungen an der vorhandenen Infrastruktur erforderlich sind. Die Plattform unterstützt Showback-Modelle und hält Vorschriften wie die DSGVO in Multi-Cloud-Umgebungen ein, um eine überprüfbare Kostenkontrolle zu gewährleisten. Jede KI-Interaktion wird protokolliert, was Unternehmen einen vollständigen Einblick in die Modellnutzung, Teamaktivitäten und Datenverwaltung bietet.

Prompts.ai ist darauf ausgelegt, wachsende KI-Arbeitslasten problemlos zu bewältigen und unterstützt Multi-Cloud-Setups, die sich mühelos skalieren lassen. Unternehmen können in nur wenigen Minuten neue Modelle, Benutzer und Teams einbinden, ohne aktuelle Arbeitsabläufe zu stören. Seine Architektur ist für Bereitstellungen auf Unternehmensebene konzipiert und in der Lage, über 100.000 Produktionsänderungen bei gleichbleibender Leistung zu verwalten. Dies macht es zu einer idealen Lösung für Unternehmen, die von kleinen Pilotprojekten zu umfassenden KI-Operationen über mehrere Abteilungen hinweg übergehen.

Plattform B ist darauf ausgelegt, die KI-Kosten zu senken, indem sie sich wiederholende Aufgaben durch Automatisierung übernimmt. Anstatt sich ausschließlich auf Infrastrukturoptimierungen zu konzentrieren, nutzt es agentische KI, um zeitintensive Aktivitäten wie Recherche, Dateneingabe und CRM-Aktualisierungen abzuwickeln. Dadurch können sich Teams auf wirkungsvollere Arbeit konzentrieren und gleichzeitig die Betriebskosten senken.

Durch die Automatisierung manueller Prozesse reduziert Plattform B die Kosten erheblich. Seine Agenten-KI arbeitet autonom und reagiert auf Kaufsignale in Echtzeit, anstatt sich auf starre Spielregeln zu verlassen. Dies ermöglicht es, qualifizierte Leads zu identifizieren und maßgeschneiderte Nachrichten effektiv zu verfassen. Unternehmen, die dieses System nutzen, haben einen Rückgang der KI-Bereitstellungskosten um bis zu 90 % gemeldet[3].

Plattform B fungiert als zentrale Kontrollzentrale für die Verwaltung von KI-Workloads in verschiedenen Infrastrukturen, einschließlich SaaS-Plattformen, Cloud-VPCs, lokalen Systemen und sogar Air-Gap-Umgebungen. Es ist mit GPUs, CPUs und TPUs kompatibel und erfordert keine speziellen Konfigurationen. Die Plattform lässt sich über eine intuitive Benutzeroberfläche, ein SDK und eine CLI nahtlos in bestehende KI-Tools integrieren und erleichtert so die Erstellung und Konfiguration von Modellen. Dieser Ansatz ermöglicht es Unternehmen, ihre aktuellen Setups zu verbessern, ohne dass umfangreiche Änderungen an der Infrastruktur erforderlich sind.

Die Plattform stellt die Einhaltung von Vorschriften sicher, indem sie die Beweiserfassung automatisiert und Richtlinien in Echtzeit in allen Cloud-Umgebungen durchsetzt. Mithilfe von Policy-as-Code-Tools wie OPA, HashiCorp Sentinel und AWS Config bettet es Governance in CI/CD- und IaC-Pipelines ein. Die automatische Abweichungserkennung vergleicht die Live-Infrastruktur mit den deklarierten Zuständen und markiert und behebt nicht verwaltete Ressourcen oder Sicherheitsprobleme. Jedes Modellartefakt ist an seinen Git-Commit und seine Terraform-Plan-ID gebunden, wodurch ein detaillierter Prüfpfad erstellt wird. Da 69 % der KI-Projekte aufgrund von Integrations- und Governance-Hürden[3] nicht zur Umsetzung gelangen, tragen diese Funktionen dazu bei, unbefugte Aktionen zu vermeiden und regulatorische Standards einzuhalten.

Plattform B bietet eine einheitliche Steuerungsebene für die Verwaltung von Multi-Cloud-KI-Setups. Es vereinfacht die Skalierung durch Standardisierung von IAM-Rollen und Tagging und nutzt gleichzeitig Abstimmungsschleifen, um Ressourcen für wachsende Arbeitslasten zu optimieren. Angesichts der Tatsache, dass 94 % der Unternehmen die Orchestrierung von Prozessen als Schlüssel zum KI-Erfolg ansehen[3], unterstützt dieses optimierte System die Skalierung von kleinen Pilotprojekten bis hin zu groß angelegten Unternehmensbereitstellungen, ohne unnötige Komplexität hinzuzufügen. Der zentralisierte Ansatz gewährleistet die Bereitschaft für kostensparende Maßnahmen, wenn der Betrieb expandiert.

Plattform C konzentriert sich auf die Kostensenkung durch Optimierung der Infrastrukturebene. Es beschäftigt GPU-Fraktionierung und Batching um die GPU-Ressourcen optimal zu nutzen. Durch die Gruppierung mehrerer Workloads wird der Durchsatz erhöht und sichergestellt, dass Unternehmen nur für die Ressourcen zahlen, die sie aktiv nutzen, und nicht ungenutzte Kapazitäten vorhalten.

Diese Plattform reduziert die Kosten durch Spot-Instanzen und automatische Skalierung. Autoscaling minimiert die Rechenressourcen während Leerlaufzeiten, was ideal für Unternehmen mit schwankenden KI-Anforderungen ist. Anstatt sich auf teure Preise pro Token zu verlassen, bietet es eine vorhersehbares Preismodell pro MinuteDadurch werden die Kosten bei steigender Nutzung besser überschaubar. Darüber hinaus wird durch die Zusammenführung von GPU-Inferenz mit Telekommunikations-Präsenzpunkten die Notwendigkeit mehrerer Drittanbieter überflüssig, was die Integration vereinfacht und die damit verbundenen Kosten senkt. Diese Funktionen stehen im Einklang mit einer flexiblen Bereitstellungsstrategie zur Anpassung an verschiedene Geschäftsanforderungen.

Plattform C verwendet a Compute-First-Architektur das die Bereitstellung auf GPUs, CPUs und TPUs unterstützt. Seine einheitliche Steuerungsebene ermöglicht die nahtlose Orchestrierung von KI-Workloads über SaaS-Plattformen, Cloud-VPCs, On-Premises-Setups und sogar Air-Gap-Umgebungen hinweg, und das alles ohne Bindung an einen Anbieter. Dieser Ansatz ermöglicht es Unternehmen, ihre bestehende Infrastruktur zu nutzen und gleichzeitig auf eine Bibliothek vorgefertigter Modelle und Arbeitsabläufe zuzugreifen. Die Plattform rationalisiert den Betrieb, indem sie komplexe Konfigurationen überflüssig macht.

Die Plattform umfasst integrierte Steuerelemente für die Handhabung von Aufgaben wie der PII-Verarbeitung, der Einwilligung zur Anrufaufzeichnung und den Anforderungen an den Datenspeicherort. Seine einheitliche Stack-Architektur vereinfacht die Compliance durch Einhaltung gesetzlicher Standards ohne zusätzliche Komplexität. Durch die Konsolidierung von Governance-Funktionen auf einer einzigen Plattform können Unternehmen Compliance-Anforderungen effizient erfüllen und die Kosten unter Kontrolle halten.

Bei der Auswahl einer Plattform ist es wichtig, die Kompromisse abzuwägen, um den größtmöglichen Nutzen aus Ihrer KI-Investition zu ziehen. Aufbauend auf früheren Kosteneinsparungsstrategien werden in diesem Abschnitt wichtige Bereiche untersucht, in denen sich Plattformen unterscheiden.

Kostenreduzierung: Smart model routing can cut costs by 40–60% by diverting simpler queries to more affordable models, such as DeepSeek or Gemini Flash. Additionally, using prompt caching for repetitive tasks can save 75–90%. For example, in late 2025, a team reduced their monthly expenses by 75%, dropping from $12,400 to $2,100 by routing queries to cost-efficient models.

Integrationsmöglichkeiten: Platforms offering extensive connectors - some supporting over 70 vector databases and 100+ data ingestion sources - are highly adaptable to existing systems. However, these abstract layers may introduce 15–25% latency compared to direct model calls, which could be a concern for real-time applications.

__XLATE_35__

Governance und Compliance: Für Branchen mit strengen Vorschriften sind Plattformen, die Audit-Trails, Erklärbarkeitstools und Datenresidenzkontrollen umfassen, von entscheidender Bedeutung. Bei der Entscheidung geht es oft darum, Flexibilität und Kontrolle in Einklang zu bringen. Selbsthosting-Lösungen bieten einen verbesserten Datenschutz, erfordern jedoch mehr technisches Fachwissen, während SaaS-Plattformen Komfort auf Kosten der Datensouveränität bieten. Diese Governance-Überlegungen wirken sich erheblich auf die Skalierbarkeit im praktischen Einsatz aus.

Skalierbarkeit: Ausführungsbasierte Preismodelle sind für komplexe KI-Workflows oft wirtschaftlicher, wenn die Arbeitslast steigt, während Funktionen wie Zustandspersistenz und dauerhafte Ausführung – die von OpenAI für Codex in der Produktion verwendet werden – es Agenten ermöglichen, lang laufende Aufgaben zu verwalten, ohne den Kontext zu verlieren. Umgekehrt eignen sich kleinere Frameworks besser für Edge-Bereitstellungen, auch wenn ihnen einige Funktionen auf Unternehmensebene fehlen.

Letztendlich wird der Erfolg im Jahr 2026 davon abhängen, wie gut Sie die Plattformfunktionen an Ihre spezifischen Anforderungen in Bezug auf Kosten, Integration, Compliance und Skalierbarkeit anpassen.

__XLATE_41__

- __XLATE_114__

Choosing the right platform to maximize cost savings and streamline operations in 2026 depends heavily on your organization’s size and specific needs. The strategies discussed - ranging from unified orchestration to intelligent model routing - are key for platforms designed to support seamless AI workflows. For large enterprises, orchestration layers offering centralized governance, token tracking, and vendor management are essential for coordinating multiple teams and maintaining compliance. On the other hand, small to mid-sized businesses often find greater value in using smaller, specialized models and tools tailored to specific tasks, like invoice processing or demand forecasting, without the complexity of large-scale integrations.

Die Kostenkontrolle bleibt eine treibende Kraft für die betriebliche Effizienz. Rob Strechay, Analyst, bringt es auf den Punkt: „Die Optimierung der KI-Kosten wird zur obersten Priorität – der ROI und nicht der Hype wird darüber entscheiden, welche KI-Projekte überleben.“ Diese Optimierungsstrategien ebnen den Weg für maßgeschneiderte Ansätze, die Unternehmen jeder Größe gerecht werden.

For smaller teams, immediate savings can be achieved with prompt caching and straightforward model routing. High-volume operations, however, gain more from advanced techniques like semantic caching and intelligent routing, which ensure premium models are reserved for complex tasks. Enterprises managing large-scale AI initiatives require robust governance tools - such as budget alerts, audit trails, and token approval systems - to keep spending under control. Notably, while technology accounts for only 20% of an AI initiative’s value, redesigning workflows delivers the remaining 80%, making operational adjustments equally critical.

In einer Zeit, in der Kosteneffizienz nicht verhandelbar ist, bietet die Übernahme der KI-Souveränität – das Ausführen von Modellen auf privater Infrastruktur – Unternehmen eine Möglichkeit, Kosten zu senken und gleichzeitig sensible Daten zu schützen. Die Plattformen, die im Jahr 2026 florieren, werden diejenigen sein, die sich nahtlos in betriebliche Arbeitsabläufe integrieren lassen und echte Kosteneinsparungen bei gleichzeitiger Beibehaltung von Leistungs- und Compliance-Standards ermöglichen.

Prompts.ai hilft Unternehmen dabei, ihre KI-Kosten zu senken Intelligentes Prompt-Routing Und Workflow-Optimierung. Durch die Umleitung einfacherer Aufgaben auf kostengünstigere Modelle und die Reservierung fortgeschrittener Modelle für anspruchsvollere oder kritischere Aufgaben trägt dieser Ansatz dazu bei, tokenbasierte Gebühren zu senken. Im Durchschnitt meldeten Unternehmen Einsparungen von etwa 6,5 %.

Die Plattform umfasst außerdem Tools wie Echtzeit-Kostenverfolgung, Zugriff auf über 35 KI-Modelle und regelbasiertes Routing zur Vereinfachung von Prozessen. Funktionen wie einheitliche APIs zur Verwaltung mehrerer Anbieter und Caching-Strategien, die frühere Ausgaben wiederverwenden, tragen zusätzlich dazu bei, den Ressourcenverbrauch und die Kosten zu minimieren. Diese Tools stellen sicher, dass KI-Workflows effizient und kosteneffektiv bleiben und gleichzeitig eine hohe Leistung gewährleisten.

Prompts.ai glänzt mit seiner KI-fokussierte Orchestrierungstools, entwickelt, um Arbeitsabläufe über eine Vielzahl von KI-Modellen, Datensätzen und Anwendungen hinweg zu optimieren. Zu seinen herausragenden Merkmalen gehören: Kostenverfolgung in Echtzeit and adherence to strict security standards such as SOC 2 Type II and HIPAA. With support for over 35 AI models, it’s a strong option for businesses aiming to enhance AI-driven operations while keeping costs and security in check.

Im Gegensatz dazu verfolgen andere Plattformen häufig umfassendere Automatisierungsziele. Einige zeichnen sich dadurch aus No-Code-Automatisierungund bietet umfangreiche App-Integrationen, die sich an technisch nicht versierte Teams richten, die verschiedene Arbeitsabläufe verwalten. Andere priorisieren sicheres KI-Workflow-Management, wobei der Schwerpunkt auf der Reduzierung der Werkzeugvielfalt, der Vereinfachung von Prozessen und der Bereitstellung detaillierter Kostentransparenz liegt.

Prompts.ai eignet sich besonders für Unternehmen mit Bedarf effiziente, sichere und budgetbewusste KI-Workflow-Lösungen, während alternative Plattformen möglicherweise besser für diejenigen mit allgemeinen Automatisierungs- oder Nischen-Compliance-Anforderungen geeignet sind.

Governance und Compliance spielen eine entscheidende Rolle bei der Auswahl der richtigen kostensparenden KI-Plattform. Sie stellen sicher, dass Ihre KI-Workflows rechtlichen, ethischen und organisatorischen Standards entsprechen, was für den Schutz sensibler Daten, die Vermeidung von Bußgeldern und die Aufrechterhaltung des Vertrauens von entscheidender Bedeutung ist.

Ein solides Governance-Framework ermöglicht es Unternehmen, KI-Operationen effizient zu überwachen und zu verwalten. Es stellt sicher, dass Richtlinien eingehalten werden und gleichzeitig die Kosten unter Kontrolle bleiben. Dieser Ansatz reduziert das Risiko des Ressourcenmissbrauchs und richtet KI-Initiativen an Unternehmenszielen und regulatorischen Anforderungen aus. Durch die Priorisierung der Governance können Unternehmen Risiken mindern und gleichzeitig eine höhere Effizienz und Kosteneinsparungen erzielen.