KI-Orchestrierung im Jahr 2026 hat sich zu einer Notwendigkeit für die Verwaltung komplexer Arbeitsabläufe, die Koordination spezialisierter KI-Agenten und die Integration in Unternehmenssysteme wie CRM-, ERP- und ITSM-Tools entwickelt. Unternehmen nutzen jetzt Plattformen, die nicht nur mehrere KI-Modelle verbinden, sondern auch Kosten optimieren, Compliance gewährleisten und nahtlose Skalierbarkeit bieten. Mit über 50 % der Unternehmen Wenn von Unternehmen erwartet wird, dass sie diese Plattformen übernehmen, ist die Auswahl des richtigen Tools für die Erzielung betrieblicher Effizienz und messbarer Ergebnisse von entscheidender Bedeutung.

Jede Plattform bietet einzigartige Stärken, von Kosteneffizienz bis hin zu fortschrittlicher Governance und Skalierbarkeit. Unabhängig davon, ob Sie Arbeitsabläufe automatisieren oder KI-Agenten koordinieren, ermöglichen diese Tools Unternehmen, ihre Abläufe zu skalieren und gleichzeitig die Kontrolle und Sicherheit zu wahren.

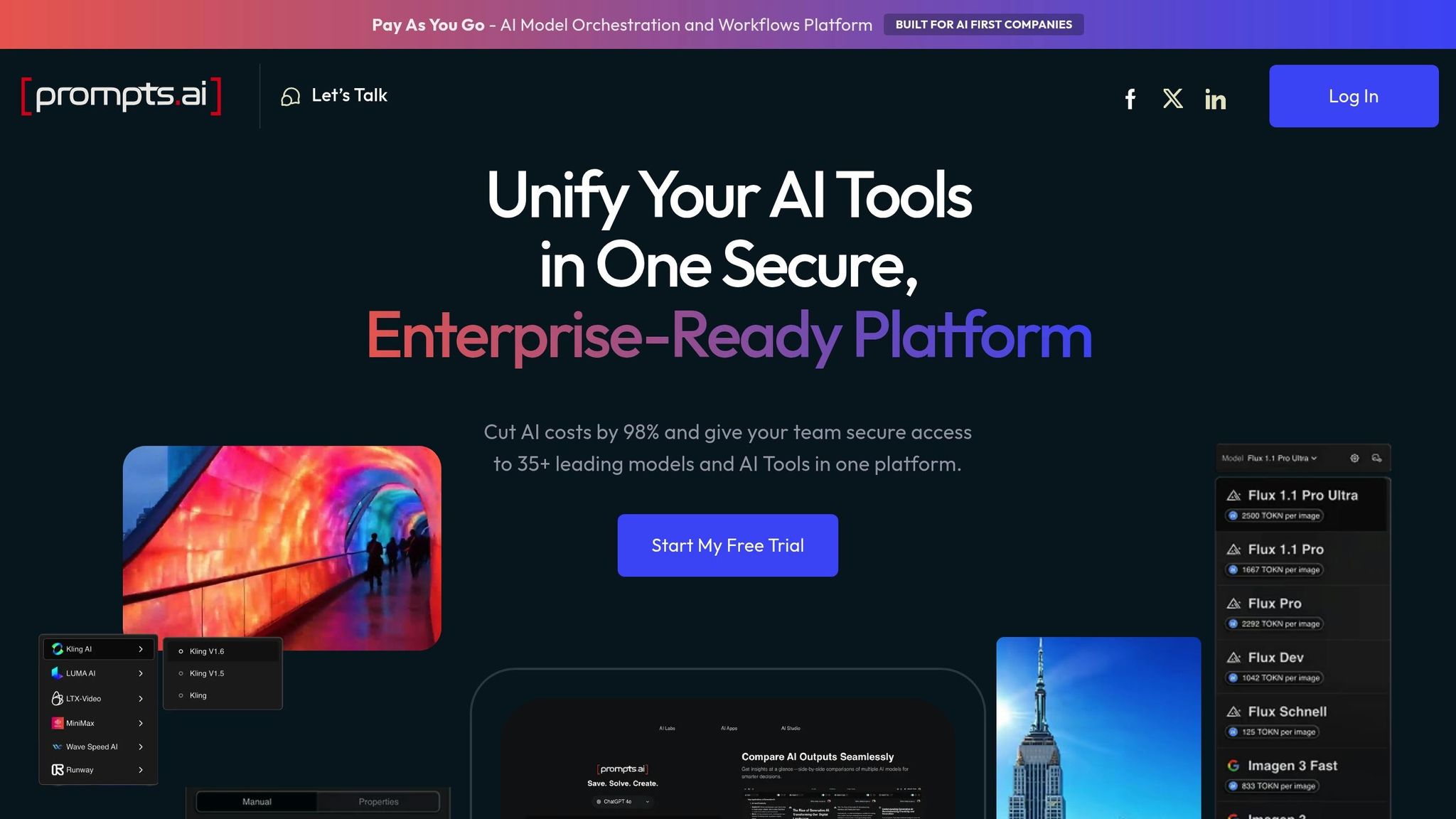

Prompts.ai bringt zusammen 35 führende große Sprachmodelle – wie GPT-5, Claude 4, LLaMA 3 und Gemini – in eine einheitliche, unternehmensfähige Plattform. Dieses Setup vereinfacht die Workflow-Automatisierung, macht den Einsatz mehrerer Tools überflüssig und senkt die Kosten für KI-Software erheblich bis zu 98 %, und das alles, während Benutzer je nach Aufgaben dynamisch zwischen Modellen wechseln können.

Die einheitliche Inferenz-Engine der Plattform lässt sich nahtlos in native APIs für über 50 große Sprachmodelle integrieren. Dies ermöglicht einen dynamischen Modellwechsel innerhalb von Workflows, ohne dass Codeänderungen erforderlich sind, wodurch die Latenz verkürzt wird bis zu 40 % in Multimodell-Pipelines. Netflix nutzte beispielsweise Prompts.ai zur Automatisierung 80 % seiner Content-Workflows, was zu a führt 25 % Steigerung des Engagements. Das Plug-and-Play-Design ermöglicht es Teams, Modelle für die Entscheidungsfindung in Echtzeit zu verketten und so die Leistung für spezifische Anforderungen zu optimieren. Dieser Ansatz verbessert nicht nur die Effizienz, sondern führt auch zu erheblichen Kosteneinsparungen.

Prompts.ai verwendet a Pay-per-Token-Abrechnungsmodell, mit Preisen zwischen 0,0001 $ und 0,001 $ pro 1.000 Token (USD). Sein automatisch skalierendes Inferenzsystem reduziert in Kombination mit der Modelldestillation die Kosten um 60%. Darüber hinaus verhindern Caching-Mechanismen redundante API-Aufrufe, indem sie prompte Antworten wiederverwenden. In einem Forrester-Bericht aus dem Jahr 2025 wurde hervorgehoben, dass mittelständische Unternehmen, die tägliche Automatisierungen nutzen, ihre LLM-Kosten senken 50%. Zum Beispiel Geschäftsabwicklung 1 Milliarde Token monatlich rundherum sparen $10,000. Die Prognosen von Gartner für 2026 positionieren Prompts.ai als führend bei der Reduzierung der Gesamtbetriebskosten für die KI-Orchestrierung.

Prompts.ai priorisiert die Unternehmenscompliance mit Funktionen wie Rollenbasierte Zugriffskontrolle (RBAC), AES-256-Verschlüsselungund detaillierte Prüfprotokolle, die den Anforderungen entsprechen SOC 2, DSGVO und HIPAA Standards. Die Plattform enthält außerdem KI-Leitplanken, um Voreingenommenheit zu erkennen und Toxizität und Blockierung zu filtern 95 % der schädlichen Emissionen in sensiblen Branchen wie dem Finanzwesen. Unabhängige Audits bestätigen diese Fähigkeiten. Gartner-Experten haben festgestellt, dass die Risikoklassifikatoren von Prompts.ai den Hochrisikoanforderungen des EU AI Act entsprechen, einschließlich automatisierter Compliance-Berichte, die protokollieren 100 % der Schlussfolgerungen für die Rückverfolgbarkeit. Dieser umfassende Ansatz ist entscheidend, um mögliche Bußgelder zu vermeiden 7 % des Jahresumsatzes, um eine sichere Skalierbarkeit in einer global regulierten Umgebung zu gewährleisten.

Mit Kubernetes-Orchestrierung und serverloser Bereitstellung kann Prompts.ai damit umgehen über 1 Million Schlussfolgerungen pro Sekunde, um den Bedürfnissen globaler Unternehmen mit unterschiedlichen Anforderungen gerecht zu werden. Die Plattform unterstützt eine blühende Community von Über 200.000 Entwickler und bietet Zugang zu Über 500 GitHub-Plugins (mit über 50.000 Sternen). Bis 2026 soll die Plattform erobert werden 25 % des Marktes mit 5 Millionen Benutzer, angetrieben von 300 % Wachstum im Jahresvergleich. VentureBeat berichtet, dass Prompts.ai bereits bedient Über 1.000 Unternehmenskunden, wobei die Implementierungszeiten durchschnittlich weniger als betragen 24 Stunden bei der Verwendung von Community-Vorlagen und dem No-Code-Dashboard für Workflow-Prototyping. Diese Kombination aus Skalierbarkeit und aktivem Community-Engagement macht Prompts.ai zu einem führenden Anbieter von KI-Workflow-Lösungen.

Plattform B, bekannt als LangGraph, organisiert KI-Workflows als gerichtete Graphen, wobei jeder Knoten einen bestimmten Schritt darstellt und die Kanten die Ausführungsreihenfolge bestimmen. Dieses Design ermöglicht Zyklen, parallele Verarbeitung und bedingte Verzweigungen und eignet sich daher gut für die Handhabung komplexer und iterativer Arbeitsabläufe. Es unterstützt auch die dynamische Ausführung und kontinuierliche Verfeinerung in Multiagentensystemen.

LangGraph lässt sich in mehr als integrieren 1.000 Werkzeuge durch das LangChain-Ökosystem. Es nutzt ein offenes Agentenprotokoll und ermöglicht so eine nahtlose Kommunikation zwischen Agenten über Frameworks wie CrewAI und das Microsoft Agent Framework hinweg über standardisierte APIs. Anfang 2026 erreichte LangGraph v1.0 GA Status, der seine Bereitschaft für den Produktionseinsatz in Umgebungen mit mehreren Agenten markiert.

LangGraph beschäftigt a Hybridarchitektur Dadurch wird die Orchestrierungssteuerungsebene von der Ausführungsumgebung getrennt. Dieses Setup stellt sicher, dass Benutzer die volle Kontrolle über ihre Ausführungsinfrastruktur und sensible Daten behalten, während LangGraph nur Orchestrierungsmetadaten verarbeitet. Die Plattform greift niemals auf den Quellcode des Workflows zu und verarbeitet die tatsächlichen Daten nicht, um geschützte Informationen zu schützen. Darüber hinaus werden alle Orchestrierungsmetadaten sowohl während der Übertragung als auch im Ruhezustand verschlüsselt und erfüllen so die strengen Sicherheitsstandards, die von regulierten Branchen gefordert werden. Dieser Ansatz fördert die Skalierbarkeit und gewährleistet fehlertolerante Abläufe.

The platform’s checkpointing feature stores workflow states in databases such as PostgreSQL oder Redis, enabling recovery, human intervention, and in-depth debugging. LangGraph’s precise control over transitions and decision-making processes makes it particularly effective for agentic RAG pipelines that require explicit state management.

Plattform C, bekannt als Prefect, bietet KI-Orchestrierung durch eine Hybridarchitektur, die Kontrolle und Ausführung trennt. Während die Orchestrierungsschnittstelle als verwalteter Dienst fungiert, verbleiben alle KI-Workflows und die Datenverarbeitung in Ihrer privaten Infrastruktur – unabhängig davon, ob es sich um eine VPC-, Kubernetes- oder lokale Einrichtung handelt. Dieser Ansatz priorisiert sichere Bereitstellungen und Datensouveränität und stellt sicher, dass vertraulicher Workflow-Code, API-Schlüssel und Trainingsdaten niemals Ihr Netzwerk verlassen.

Prefect verbindet sich mit KI-Systemen über seinen Open-Source-Kern, der über mehrere Funktionen verfügt 6.000.000 monatliche Downloads ab Anfang 2026. Diese Flexibilität ermöglicht es Teams, verschiedene große Sprachmodelle und KI-Tools zu integrieren und gleichzeitig die volle Kontrolle über die Ausführung zu behalten. Lokale Mitarbeiter kümmern sich um die Orchestrierung über ausschließlich ausgehende Verbindungen, sodass kein eingehender Zugriff oder offene Firewall-Ports erforderlich sind.

Prefect wurde mit Blick auf die Unternehmenssicherheit entwickelt. Es hält SOC 2 Typ II-Zertifizierung, entspricht DSGVO, und ist HIPAA-bereit, was es ideal für Branchen wie Finanzen und Gesundheitswesen macht. Die Daten bleiben während der Übertragung (TLS 1.2+) und im Ruhezustand mit eindeutigen Verschlüsselungsschlüsseln für jeden Arbeitsbereich verschlüsselt. Die Plattform unterstützt RBAC, Single Sign-On (SSO) über SAML 2.0 oder OIDC und SCIM-Verzeichnissynchronisierung. Darüber hinaus bietet es detaillierte Audit-Protokolle mit anpassbaren Aufbewahrungsfristen zur Überwachung von Benutzeraktivitäten und Systemänderungen.

__XLATE_83__

Dieses umfassende Sicherheits-Framework unterstützt sowohl die betriebliche Effizienz als auch die Skalierbarkeit.

Prefect’s open-source base has garnered significant attention, with over 18.000 Sterne Und Über 372 Mitwirkende auf GitHub. Seine Skalierbarkeit zeigt sich in realen Anwendungen, wie beispielsweise der Implementierung von Snorkel AI, die überstanden hat 1.000 Durchflüsse pro Stunde und Zehntausende täglicher Hinrichtungen. Smit Shah, Director of Engineering bei Snorkel AI, erzählte, wie sie eine erreicht haben 20-fache Durchsatzverbesserung Gleichzeitig wird eine selbstgehostete Kubernetes-Umgebung beibehalten, um die Datenkontrolle zu wahren. Prefect läuft auch auf GCP und AWS mit Multi-AZ-Hochverfügbarkeit, was es zu einer robusten Wahl für KI-Operationen im Unternehmensmaßstab macht.

__XLATE_93__

__XLATE_94__

In diesem Abschnitt werden die Stärken und Herausforderungen der wichtigsten KI-Orchestrierungsplattformen aufgeschlüsselt und ihre Kompromisse in Bezug auf Funktionalität, Kosten und Benutzerfreundlichkeit hervorgehoben. Während sich die KI-Orchestrierung weiterentwickelt, spiegeln diese Plattformen unterschiedliche Designprioritäten wider, die unterschiedlichen technischen Fachkenntnissen und Workflow-Anforderungen gerecht werden. Die Erkenntnisse hier bauen auf früheren Diskussionen über Modellintegration, Kostenmanagement und sichere Skalierbarkeit auf.

LangGraph v1.0 bietet detaillierte Kontrolle durch seine graphbasierte Ausführung und Zustandspersistenz und eignet sich daher gut für komplexe Entscheidungsabläufe. Die Beherrschung der Plattform erfordert jedoch normalerweise Folgendes 2–3 weeks, was für neue Benutzer eine Hürde darstellen kann. Sein Pay-per-Node-Preismodell gewährleistet in Kombination mit der Unterstützung des offenen Agent Protocol die Kompatibilität zwischen Frameworks.

n8n bietet ein kosteneffizientes, ausführungsbasiertes Preismodell, ideal für sich wiederholende KI-Aufgaben. Es verfügt über eine native LangChain-Integration und unterstützt Selbsthosting zum Schutz der Privatsphäre. Teams können darin kompetent werden 1–2 weeks, aber seine Fähigkeiten auf Unternehmensebene sind etwas eingeschränkt.

Zeitlich hat sich zu einer Lösung der Wahl für „Durable Agent Execution“ entwickelt und eignet sich hervorragend für Szenarien, in denen es über längere Zeiträume zu „Human-in-the-Loop“-Pausen oder zu Aufgaben kommt, die Widerstandsfähigkeit gegenüber Serverneustarts erfordern. OpenAI nutzt Temporal für Codex in der Produktion, insbesondere für die Verwaltung lang laufender zustandsbehafteter Aufgaben. Seine ereignisgesteuerte Architektur gewährleistet Skalierbarkeit und Zuverlässigkeit, eine effektive Implementierung erfordert jedoch ein hohes Maß an technischem Fachwissen.

Diese Vergleiche unterstreichen, wie wichtig es ist, Faktoren wie Kontrolle, Kosten und Benutzerfreundlichkeit in Einklang zu bringen, um sie an die Projektanforderungen anzupassen.

| Plattform | Lernkurve | Am besten für | Preismodell | Schlüsselbeschränkung |

|---|---|---|---|---|

| LangGraph v1.0 | 2–3 weeks | Komplexe Entscheidungsabläufe | Bezahlung pro Knoten | Steile Lernkurve |

| n8n | 1–2 weeks | IT-Betrieb/Technische Power-User | Ausführungsbasiert | Eingeschränkte Enterprise-Funktionen |

| Zeitlich | 1–2 weeks | Dauerhafte Agentenausführung | Nutzungsbasiert | Erfordert technisches Können |

| CrewAI v1.8 | 1 Woche | Schnelles Prototyping | Brauch | Begrenzte Kontrolle |

Benutzerdefinierte Orchestrierungsprojekte erfordern häufig 3–5 times more time als diese Plattformen zu nutzen, ist die Wahl des richtigen Tools von entscheidender Bedeutung, um den Zeitplan einzuhalten und Ressourcen effektiv zu verwalten.

Choose a platform that complements your team’s skills and fits your workflow requirements. LangGraph v1.0 ist ideal für die Verwaltung komplexer Arbeitsabläufe, die eine präzise Statuskontrolle erfordern. n8n zeichnet sich durch seine kostengünstige, ausführungsbasierte Preisgestaltung und Selbsthosting-Funktionen aus und ist damit eine praktische Wahl für IT-Betriebsteams. Zeitlich zeichnet sich durch die Bewältigung dauerhafter, geschäftskritischer Arbeitsabläufe aus und gewährleistet Zuverlässigkeit auch bei Serverneustarts oder längeren Pausen. CrewAI v1.8 unterstützt Rapid Prototyping, indem es Teams durch rollenbasierte Zusammenarbeit ermöglicht, Agenten basierend auf bestimmten Rollen und Zielen zu definieren.

Für Unternehmen, die sich auf die mühelose Integration großer Sprachmodelle konzentrieren, sind Plattformen wie Amazonas-Grundgestein, LangChain, Und Zapier Bereitstellung robuster Konnektivität zu Basismodellen und Unternehmenstools.

Der Aufbau eines benutzerdefinierten Orchestrierungssystems erfordert im Vergleich zur Nutzung etablierter Plattformen häufig erheblich mehr Ressourcen. Die Entscheidung für eine Lösung, die technische Stärke mit reibungsloser Integration vereint, kann dazu beitragen, KI-Initiativen zu beschleunigen und greifbare Geschäftsvorteile zu erzielen.

To select the most suitable AI orchestration platform, start by evaluating your team’s specific needs, such as the complexity of workflows, the number of LLMs in use, and your budget constraints. Focus on platforms that offer essential features like centralized model management, cost monitoring, and governance tools.

Platforms that enable workflow automation, ensure compliance, and allow for scalability should take priority. Ease of use is another critical factor - no-code tools are ideal for teams without technical expertise, while open-source platforms may better serve technical teams looking for customization. Lastly, confirm that the platform meets your organization’s security and compliance standards.

Before implementing AI and orchestration platforms, it’s critical to prioritize Sicherheit und Compliance um Daten zu schützen und Vorschriften einzuhalten. Suchen Sie nach Funktionen wie rollenbasierter Zugriffskontrolle (RBAC), Echtzeitüberwachung und Verschlüsselung für ruhende und übertragene Daten. Stellen Sie sicher, dass die Plattform Standards wie DSGVO, HIPAA oder SOC 2 entspricht. Zusätzliche Schutzmaßnahmen wie Audit-Protokolle, Multi-Faktor-Authentifizierung (MFA) und sichere API-Integrationen sind für die Aufrechterhaltung der Betriebsintegrität und die Erfüllung regulatorischer Anforderungen unerlässlich.

Um die mit großen Sprachmodellen (LLMs) verbundenen Kosten zu senken und gleichzeitig deren Leistung aufrechtzuerhalten, sollten Sie Strategien in Betracht ziehen wie: sofortiges Caching, wodurch redundante Verarbeitung vermieden wird, und Modellrouting, wodurch Aufgaben kostengünstigeren Modellen zugewiesen werden. Plattformen wie prompts.ai Vereinfachen Sie diesen Prozess, indem Sie eine zentrale Modellverwaltung, Echtzeit-Kostenüberwachung und dynamische Modellauswahl anbieten. Durch die Integration dieser Methoden können Sie die Kosten effektiv verwalten und gleichzeitig qualitativ hochwertige Ergebnisse erzielen.