KI-Workflow-Plattformen im Jahr 2026 verändern die Arbeitsweise von Unternehmen und bewegen sich über die einfache Aufgabenautomatisierung hinaus hin zu intelligenteren, entscheidungsgesteuerten Systemen, die auf großen Sprachmodellen (LLMs) basieren. Diese Tools rationalisieren Abläufe, senken Kosten und lassen sich nahtlos in bestehende Technologie-Ökosysteme integrieren und lösen so Herausforderungen wie Werkzeugvielfalt und mangelnde Kompatibilität. Nachfolgend sind die Top-Plattformen aufgeführt, die diesen Wandel vorantreiben:

Diese Plattformen erfüllen wichtige Anforderungen wie Kosteneffizienz, Skalierbarkeit und Governance und sind damit unverzichtbare Werkzeuge für Unternehmen, die sich in der KI-gesteuerten Zukunft zurechtfinden.

Prompts.ai vereint über 35 große Sprachmodelle (LLMs) – wie GPT-5, Claude, LLaMA, Gemini, Grok-4 und Flux Pro – auf einer einzigen, sicheren Plattform. Dadurch entfällt der Aufwand, mehrere Abonnements, Anmeldungen und Abrechnungssysteme unter einen Hut zu bringen. So vereinfachen seine Funktionen KI-Workflows und steigern die Produktivität.

Prompts.ai’s design allows users to switch between models effortlessly without reconfiguring workflows or managing separate API keys. This means you can directly compare GPT-5’s strengths to those of Claude or Gemini, then direct production tasks to the model that fits your needs best. Each model has unique strengths - some excel in creative tasks, while others are better suited for data analysis or coding. This flexibility ensures you always have the right tool for the job.

Über seine Integrationsfähigkeiten hinaus trägt Prompts.ai mit seinem unkomplizierten, nutzungsbasierten Abrechnungsmodell zur Kostensenkung bei. Durch die Implementierung eines einheitlichen Trackingsystems für die Token-Nutzung bietet die Plattform nutzungsbasierte TOKN-Gutschriften an, sodass keine wiederkehrenden Gebühren anfallen. Viele Unternehmen haben ihre Ausgaben für KI-Software durch die Konsolidierung mehrerer Tools auf dieser einzigen, transparenten Plattform um bis zu 98 % gesenkt.

Prompts.ai adapts to the needs of individuals, teams, and enterprises alike. Plans start at $29 per month for individual users, while enterprise plans range from $99 to $129 per member. There’s even a $99 Family Plan, recognizing that AI automation is increasingly valuable for both personal and professional use. This scalability ensures that users only pay for what they need, whether they’re automating workflows for a small team or an entire organization.

Für wachsende Betriebe hat eine sichere Governance oberste Priorität. Prompts.ai ist mit Funktionen der Enterprise-Klasse ausgestattet und bietet einen Prüfpfad für jede KI-Interaktion, um Compliance-Anforderungen zu unterstützen. Sensible Daten bleiben im Unternehmen und werden nicht über mehrere Dienste Dritter offengelegt. Echtzeit-Dashboards geben Administratoren Einblick in Ausgaben, Zugriffskontrolle und die Möglichkeit, KI-Kosten direkt mit Geschäftsergebnissen zu verknüpfen. Diese Tools sind entscheidend für die Aufrechterhaltung der Transparenz und Kontrolle in KI-gesteuerten Abläufen.

Vellum AI verfolgt einen anderen Ansatz, indem es sich auf die AI-native Workflow-Orchestrierung konzentriert, anstatt nur einzelne Aufgaben zu automatisieren. Es ermöglicht Benutzern, einen Prozess in einfacher Sprache zu beschreiben, und die Plattform generiert automatisch die Workflow-Struktur, sodass keine manuelle Knoteneinrichtung erforderlich ist. Diese „Prompt-to-Build“-Funktion spart erheblich Zeit, insbesondere für Teams, die mit mehreren Agentenkonzepten experimentieren.

Mit seinem modellunabhängigen Design ermöglicht Vellum einen nahtlosen Wechsel zwischen LLMs, um Kosten, Geschwindigkeit und Qualität in Einklang zu bringen, ohne dass eine vollständige Neugestaltung des Workflows erforderlich ist. Die Plattform unterstützt erweiterte Funktionen wie Retrieval-Augmented Generation (RAG), semantisches Routing und mehrstufige Agenten-Orchestrierung. Es ermöglicht Benutzern, Eingabeaufforderungen zu verketten, sodass die Ausgabe eines Modells zur Eingabe für ein anderes Modell wird, was komplexe Argumentationspipelines ermöglicht. Integrierte Versionierungs- und Bewertungstools erleichtern das Testen und Verfeinern von Eingabeaufforderungsvarianten.

Vellum wurde entwickelt, um technische und nichttechnische Teams zusammenzubringen. Produktmanager und Betriebsmitarbeiter können den visuellen Builder zum Erstellen von Agenten verwenden, während Ingenieure Arbeitsabläufe mithilfe benutzerdefinierter Logik mit TypeScript- oder Python-SDKs verbessern können. RelyHealth nutzte beispielsweise Vellum, um Hunderte von benutzerdefinierten Gesundheitsagenten bereitzustellen und so den Zeitaufwand für die Bereitstellung um das Hundertfache zu verkürzen. Max Bryan, Vizepräsident für Technologie und Design, teilte mit:

__XLATE_8__

Wir haben unseren 9-Monats-Zeitplan um das Doppelte beschleunigt und mit unserem virtuellen Assistenten eine kugelsichere Genauigkeit erreicht. Vellum hat maßgeblich dazu beigetragen, unsere Daten verwertbar und zuverlässig zu machen.

The platform’s strong governance features ensure that rapid deployment doesn’t compromise security.

Vellum bietet Sicherheit auf Unternehmensniveau mit rollenbasierter Zugriffskontrolle (RBAC), SSO/SAML-Integration und unveränderlichen Prüfprotokollen, die jede Eingabeaufforderung und Ausgabe verfolgen. Es entspricht den Standards SOC 2, DSGVO, HIPAA und ISO 27001. Zu den Bereitstellungsoptionen gehören Public Cloud, Private VPC, On-Premise-Setups und sogar Air-Gap-Umgebungen für Branchen mit strengen Vorschriften. Human-in-the-Loop-Genehmigungs-Gates ermöglichen es, sensible Aktionen zur Überprüfung anzuhalten und so die Verantwortlichkeit sicherzustellen. Bemerkenswerterweise nennen 78 % der Betriebsleiter Erklärbarkeit und Debugging-Tools als entscheidende Faktoren bei ihren Kaufentscheidungen.

Die Preise beginnen bei 25 $/Monat für den Pro-Plan, 79 $/Benutzer/Monat für Business-Pläne und individuelle Enterprise-Preise für unbegrenzte Credits und dedizierten Support.

Zapier verbindet KI-Aufgaben über mehr als 8.000 Apps hinweg und erledigt monatlich über 23 Millionen KI-Aufgaben für über 1 Million Unternehmen. Benutzer können zwischen LLM-Anbietern wie GPT, Anthropic, Gemini und Azure OpenAI wählen oder sich für integrierte kostenlose Optionen wie GPT-4o mini und Gemini 2.0 Flash entscheiden. Durch den Ersatz statischer Arbeitsabläufe durch dynamische, KI-gesteuerte Entscheidungsfindung bietet Zapier ein adaptiveres Automatisierungserlebnis.

Die Agents in Zaps-Funktion von Zapier ermöglicht es der KI, autonom Entscheidungen darüber zu treffen, wie Ziele erreicht werden können, und zwar über starre Arbeitsabläufe hinaus. Diese Agenten können Aufgaben wie Websuchen, das Verfassen von Nachrichten und das Aktualisieren von Datenbanken ohne manuelles Eingreifen ausführen. Die Plattform unterstützt auch die Verarbeitung von Bildern, Audio und Video direkt innerhalb von Workflows. Mit dem Model Context Protocol (MCP)-Connector können Entwickler externe KI-Tools nahtlos in das Zapier-Ökosystem mit über 8.000 Apps integrieren, ohne dass komplexe API-Setups erforderlich sind. Für zusätzliche Kontrolle ermöglichen Human-in-the-Loop-Genehmigungsschritte – wie z. B. Slack-basierte Überprüfungen – den Teams, KI-generierte Aktionen zu überprüfen, bevor sie finalisiert werden, was sowohl die Genauigkeit als auch das Vertrauen in die Automatisierung erhöht.

Zapier demonstriert seinen Wert bei der Skalierung von Abläufen anhand realer Anwendungen. Zum Beispiel:

Diese Beispiele verdeutlichen, wie KI-Automatisierung die Effizienz und die finanziellen Auswirkungen in verschiedenen Branchen steigern kann.

__XLATE_16__

„Zapier lässt unser Dreierteam wie ein Zehnerteam erscheinen.“ - Marcus Saito, Leiter IT- und KI-Automatisierung, Remote

Zapier hält sich an die Standards SOC 2 Typ II, DSGVO, DSGVO UK und CCPA und stellt sicher, dass KI-Modelle von Drittanbietern keine Kundendaten für Schulungen verwenden. Die Plattform bietet zentralisierte Governance-Tools wie Domain Capture für vollständige Nutzungstransparenz, Anwendungskontrollen zur Einschränkung bestimmter KI-Integrationen und detaillierte Berechtigungen auf Team-, App- und Datenebene. Zu den Sicherheitsmaßnahmen gehören Enterprise SSO (SAML 2.0), SCIM, Zwei-Faktor-Authentifizierung, IP-Zulassungsliste und VPC-Peering für sichere interne Konnektivität. Die Daten werden durch erstklassige Verschlüsselung und Transportprotokolle geschützt und sorgen so für Transparenz bei Workflow-Änderungen. Die Preise beginnen bei 19,99 $/Monat für Professional-Pläne und 69 $/Monat für Team-Pläne. Für Enterprise-Pläne mit unbegrenzter Benutzeranzahl stehen benutzerdefinierte Preisoptionen zur Verfügung.

Make verbindet über 3.000 Apps mithilfe einer visuellen Leinwand, die Ihre Automatisierungsworkflows anzeigt. Im Gegensatz zu herkömmlichen linearen Tools verwendet Make eine szenariobasierte Automatisierung, die Verzweigungslogik, Filter und flexible Mehrpfad-Workflows umfasst. Sein visueller Builder eignet sich dank Funktionen wie Iteratoren und Aggregatoren besonders gut für die Handhabung von Datentransformationen. Dies macht es zu einer guten Wahl für die Verarbeitung großer Datenmengen, ohne dass Programmierkenntnisse erforderlich sind.

Make bietet native Module für beliebte Tools wie OpenAI (ChatGPT, DALL-E, Whisper) und Google Gemini und unterstützt über sein HTTP-Modul auch jedes OpenAI-kompatible Modell. Im Jahr 2026 führte die Plattform Make AI Agents ein – zielgesteuerte Automatisierungen, die selbstständig Tools auswählen, um definierte Ziele zu erreichen. Diese Agenten nutzen vorhandene Make-Szenarien, um Aufgaben ohne manuelles Eingreifen zu erledigen. Darüber hinaus fungiert Make als Model Context Protocol (MCP)-Server, der es externen KI-Modellen wie Claude ermöglicht, Make-Szenarien als Werkzeuge für reale Aufgaben sicher auszuführen.

Künftig wird der Make Maia-Assistent es Benutzern ermöglichen, komplexe Arbeitsabläufe zu erstellen, indem sie sie einfach in natürlicher Sprache beschreiben. Mit dieser Funktion können Automatisierungen im Dialog erstellt werden, wodurch die Notwendigkeit einer manuellen Konfiguration verringert und der Prozess für Benutzer vereinfacht wird.

Make verwendet ein betriebsbasiertes Preismodell, bei dem die Kosten pro Modulausführung und nicht pro abgeschlossenem Workflow berechnet werden. Der kostenlose Plan umfasst 1.000 Operationen pro Monat und 2 aktive Szenarien. Bezahlte Pläne beginnen bei 9 $/Monat für den Core-Plan (10.000 Vorgänge, unbegrenzte Szenarien), 16 $/Monat für Pro (der vorrangigen Support hinzufügt) und 29 $/Monat für Teams (mit Mehrbenutzerfunktionen). Zusätzliche Operationen können für etwa 1 US-Dollar pro 1.000 Operationen erworben werden. Bei komplexen Arbeitsabläufen mit Verzweigungslogik kann dieses Modell sehr wirtschaftlich sein, da Sie nur für die ausgeführten Module bezahlen. Allerdings können KI-Schritte je nach Komplexität mehrere Credits pro Ausführung verbrauchen.

Make’s pricing model and operational framework support scalability, from simple automations to enterprise-level workflows. The platform ensures data integrity with ACID transactions and offers tools for bulk data processing. It boasts a 99.9% infrastructure availability rate and average response times under 200ms for standard integrations. Examples of its scalability in action include:

__XLATE_23__

Der Betriebsleiter von Teleclinic teilte mit: „Make hat uns wirklich geholfen, unsere Abläufe zu skalieren, die Reibungsverluste in unseren Prozessen zu verringern, die Kosten zu senken und unser Support-Team zu entlasten.“

__XLATE_25__

Der COO von Shop Accelerator Martech bemerkte: „Make steigert die Effizienz unseres Unternehmens auf eine Weise, die wir uns nie hätten vorstellen können. Es bedeutet, einen zusätzlichen Mitarbeiter (oder 10) zu einem Bruchteil der Kosten zu haben.“

The upcoming Make Grid feature, set to launch in 2026, will act as a "Command Center", providing a visual overview of an organization’s entire automation ecosystem. This tool will help teams identify bottlenecks and monitor workflow performance in real time.

Make adheres to SOC 2 Type II, GDPR, and SCIM standards, offering Single Sign-On (SSO) and a secure connection manager that stores API keys securely instead of embedding them directly in workflows. The "Scenario Run Replay" feature allows users to replay failed executions with the original data, speeding up troubleshooting processes. Enterprise plans include advanced governance options and dedicated support, though some users have noted that the platform’s role-based access control (RBAC) is less detailed compared to other enterprise solutions. To minimize risks, critical modules should include manual error-handling configurations to prevent silent data loss during API disruptions. For organizations with strict compliance needs, redirecting execution data to an external logging service may be advisable, as Make’s native logs are retained only for a limited time based on the plan.

n8n zeichnet sich als Plattform aus, die speziell für Entwickler entwickelt wurde und sowohl in der Cloud gehostete als auch selbst gehostete Optionen bietet. Es basiert auf einem ausführungsbasierten Preismodell, bei dem ein Workflow-Durchlauf einer Ausführung entspricht, unabhängig davon, wie viele Schritte er umfasst. Dies macht es zu einer praktischen Wahl für die Verwaltung komplexer, mehrstufiger KI-Workflows ohne die höheren Kosten, die oft mit einer aufgabenbasierten Preisgestaltung verbunden sind.

n8n bietet eine native LangChain-Integration und ermöglicht es Benutzern, fortschrittliche Multi-Agent-KI-Systeme und RAG-Pipelines (Retrieval-Augmented Generation) direkt in seinem visuellen Editor zu erstellen. Mit dem AI Agent Node können Standard-LLMs in zielorientierte Agenten umgewandelt werden, die in der Lage sind, Tools zu nutzen, Entscheidungen zu treffen und das Gedächtnis über komplexe Arbeitsabläufe hinweg zu behalten. Die Plattform unterstützt eine Reihe von LLMs, darunter OpenAI, Anthropic (Claude), Google Gemini, DeepSeek, Groq und Hugging Face, sowie Vektordatenbankintegrationen wie pgvector, Pinecone, Chroma, Qdrant und Weaviate. Sein AI Workflow Builder kann sogar Beschreibungen in natürlicher Sprache automatisch in funktionale Workflows umwandeln. Durch die Verkettung von KI-Anfragen und die Verwendung günstigerer Modelle für Zwischenschritte können Benutzer die API-Kosten um 30–50 % senken.

n8n’s execution-based pricing ensures affordability for even the most complex workflows. Technical users can access the self-hosted Community Edition for free, with unlimited workflows and executions. For cloud-hosted options, the Cloud Starter plan begins at $20/month for 2,500 executions, while Cloud Pro offers 10,000 executions for $50/month. For businesses, the self-hosted Business plan costs $800/month, offering advanced features, while Enterprise pricing is customized for organizations requiring features like advanced RBAC, SSO, and dedicated support. By charging per workflow execution instead of per step, n8n can save organizations over $500 per month on high-volume workflows compared to task-based pricing models.

n8n is built to handle up to 220 workflow executions per second per instance. Its Queue Mode leverages Redis to distribute execution across multiple worker processes, enabling horizontal scaling to meet increasing demands for fast and efficient AI workflows. For instance, in 2025, Dennis Zahrt, Director of Global IT Service Delivery at Delivery Hero, implemented a user management workflow that saved the company 200 hours each month. Similarly, Luka Pilic, Marketplace Tech Lead at StepStone, reported a dramatic improvement in efficiency, completing two weeks’ worth of API integration and data transformation work in just two hours.

__XLATE_29__

„Ich brauche maximal 2 Stunden, um APIs zu verbinden und die benötigten Daten umzuwandeln. Das geht im Code nicht so schnell.“ - Luka Pilic, Marketplace Tech Lead, StepStone

n8n priorisiert die Sicherheit durch die Integration mit externen Secret-Managern wie AWS Secrets Manager, Azure Key Vault, Google Cloud Platform, HashiCorp Vault und Infisical und stellt so sicher, dass vertrauliche Anmeldeinformationen von der Plattform ferngehalten werden. Für Benutzer, die sich für Selbsthosting über Docker oder Kubernetes entscheiden, bleiben alle Workflow-Daten, Anmeldeinformationen und Protokolle innerhalb ihrer eigenen Firewall und unterstützen so die Einhaltung von Vorschriften wie HIPAA, DSGVO und SOC 2. Unternehmensbenutzer profitieren von erweitertem RBAC durch „Projekte“, die den Zugriff auf bestimmte Workflows und Anmeldeinformationen basierend auf Rollen einschränken. Darüber hinaus ermöglicht die Git-basierte Quellcodeverwaltung die sichere Bewegung von Arbeitsabläufen zwischen Entwicklungs-, Staging- und Produktionsumgebungen.

Gumloop ist eine Plattform, die speziell entwickelt wurde, um Teams dabei zu helfen, große Sprachmodelle (LLMs) problemlos zu nutzen. Das Herzstück dieses Systems ist Gummie, ein KI-Assistent, der Anweisungen in natürlicher Sprache in voll funktionsfähige Arbeitsabläufe umwandelt. Diese Fähigkeit hat sich für Unternehmen als unschätzbar wertvoll erwiesen. Fidji Simo, CEO von Instacart, teilte mit: „Gumloop hat entscheidend dazu beigetragen, allen Teams bei Instacart – auch denen ohne technische Kenntnisse – dabei zu helfen, KI einzuführen und ihre Arbeitsabläufe zu automatisieren, was unsere betriebliche Effizienz erheblich verbessert hat.“

Gumloop supports model-agnostic workflows, allowing users to switch seamlessly between models like GPT-4o, Claude 3.7 Sonnet, Deepseek V3 R1, and Gemini 2.5 Pro within a single automation. Unlike many platforms that require users to manage API keys separately, Gumloop simplifies the process by including LLM costs in its subscription plans. The AI Router node intelligently assigns tasks to the right models, while the Model Context Protocol (MCP) server enables connections to custom APIs, extending the platform’s capabilities beyond its 125+ built-in nodes. This setup ensures predictable pricing and smooth integration.

Gumloop’s pricing structure is designed for flexibility and clarity:

Durch die Bündelung der LLM-API-Kosten in seinen Abonnementplänen, anstatt sie pro Aufgabe abzurechnen, vereinfacht Gumloop die Budgetierung und macht es für Unternehmen einfacher, ihre KI-Workflows ohne unerwartete Kosten zu skalieren.

Gumloop’s structure is designed to grow alongside organizations of any size. It uses a hierarchical approach, with Organizations providing centralized control and Workspaces enabling collaboration across departments like Sales, Marketing, and Operations. The platform also supports agentic workflows, where AI agents can assess tasks dynamically and trigger workflows based on context instead of following rigid sequences. Bryant Chou of Webflow remarked, "Gumloop wins time back across an org. It puts the tools into the hands of people who understand a task and lets them completely automate it away." Additionally, the platform’s ability to auto-scale and execute workflows in parallel ensures it can handle the demands of enterprise operations.

Gumloop legt Wert auf Sicherheit und Compliance, um den Anforderungen des Unternehmens gerecht zu werden. Es entspricht den SOC 2- und DSGVO-Standards und umfasst Tools für die Kontrolle auf Unternehmensniveau. Administratoren können Zulassungs-/Verweigerungslisten für KI-Modelle durchsetzen und so die Einhaltung von Vorschriften wie HIPAA sicherstellen, indem sie bestimmte Modelle oder Anbieter einschränken. Der Inkognito-Modus verbessert die Privatsphäre, indem er alle Eingaben, Ausgaben und Zwischendaten in Echtzeit löscht. Zentralisierte Sicherheitsrichtlinien werden außerdem durch Anmeldeinformationen auf Organisationsebene unterstützt, die persönliche oder geschäftliche Schlüssel außer Kraft setzen, um unbefugten Zugriff zu verhindern. Für Unternehmen, die maximale Sicherheit benötigen, ermöglichen VPC-Bereitstellungen Gumloop den Betrieb innerhalb ihrer eigenen Cloud-Infrastruktur. Eine umfassende Audit-Protokollierung verfolgt jede Aktion auf der Plattform und bietet eine transparente Ansicht des Datenflusses und administrativer Änderungen entweder über ein Dashboard oder eine API.

Lindy.ai zeichnet sich in der Automatisierungslandschaft dadurch aus, dass es KI-Agenten entwickelt, die denken und sich anpassen, anstatt starren, voreingestellten Skripten zu folgen. Mit ihrem innovativen „Vibe-Coding“-Ansatz können Benutzer das Verhalten eines Agenten in einfachem Englisch beschreiben, und die Plattform wandelt dies schnell in eine produktionsreife Lösung um – manchmal in nur 5 Minuten. Dies ermöglicht es Unternehmen, sich wiederholende Aufgaben zu reduzieren, indem sie Agenten einsetzen, die über Speicher und Anpassungsfähigkeit verfügen.

Die Plattform nutzt GPT und Claude, um Agenten zu betreiben, die in der Lage sind, Text zu analysieren, Ausgaben zu generieren und Benutzerabsichten zu verstehen. Im Gegensatz zu herkömmlichen Automatisierungstools, die bei sich ändernden Kontexten ins Stocken geraten, nutzen Lindy.ai-Agenten den Speicher, um durch komplexe Szenarien zu navigieren, einschließlich Grenzfällen, die häufig menschliches Eingreifen erfordern. Mit Unterstützung für über 3.000 native Integrationen – und bis zu 7.000+ in bestimmten Konfigurationen – lässt sich Lindy.ai nahtlos mit CRM-Systemen, E-Mail-Plattformen und Kalendertools verbinden. CEO Flo Crivello hebt diese Fähigkeit hervor:

__XLATE_37__

KI-gestützte Arbeitsabläufe können diese Grenzfälle bewältigen und sich anpassen, um die Automatisierung aufrechtzuerhalten.

Die Autopilot-Funktion erweitert die Funktionalität, indem sie den Agenten ihre eigenen Cloud-basierten Computer zur Verfügung stellt und es ihnen ermöglicht, Aufgaben auszuführen, die über typische API-Integrationen hinausgehen. Darüber hinaus ermöglicht die Multi-Agenten-Koordination spezialisierten Agenten die Zusammenarbeit an komplexen Geschäftsprozessen und schließt so die Lücke zwischen Automatisierung und Echtzeit-Entscheidungsfindung.

Lindy.ai bietet ein aufgabenbasiertes Preismodell, bei dem die Gebühr für die Aufgabenausführung und nicht pro Benutzer berechnet wird, was es zu einer wirtschaftlichen Wahl für Teams mit hohen Nutzungsanforderungen macht. Die Preisstufen umfassen:

Zu den zusätzlichen Gebühren gehören KI-Telefonanrufe für 20 Credits pro Minute und KI-Telefonnummern für 10 US-Dollar pro Nummer und Monat, was Flexibilität für spezielle Aufgaben bietet.

Lindy.ai lässt sich mühelos skalieren und eignet sich sowohl für einzelne Benutzer als auch für große Unternehmen. Teamkonten ermöglichen die sichere gemeinsame Nutzung und Bereitstellung von KI-Agenten über Abteilungen hinweg, während die Agent Swarms-Funktion es einem einzelnen Agenten ermöglicht, sich selbst zu klonen und Hunderte von Aufgaben gleichzeitig auszuführen, beispielsweise die Verwaltung personalisierter Outreach-Kampagnen. Bei Arbeitsabläufen, die Präzision erfordern, ermöglicht die Human-in-the-Loop-Funktion (HITL), dass die KI die meisten Aufgaben erledigt, an kritischen Punkten jedoch eine Pause zur menschlichen Überprüfung einlegt. Dies macht sie ideal für sensible Vorgänge in Bereichen wie Finanzen, Personalwesen oder Kundensupport.

Lindy.ai legt Wert auf Sicherheit und Compliance und erfüllt strenge Standards wie SOC 2, HIPAA, DSGVO und PIPEDA. Die Plattform umfasst ein Trust Center und Secret-Management-Tools, um Sicherheitsanforderungen auf Unternehmensebene zu erfüllen. Über Teamkonten können Unternehmen Berechtigungen und Kontrollen konfigurieren, um sicherzustellen, dass Agenten sicher und vorhersehbar arbeiten. Für Gesundheitsdienstleister bietet Lindy.ai einen HIPAA-konformen Notizzettel, der auf die medizinische Dokumentation zugeschnitten ist und auf die besonderen Anforderungen regulierter Branchen wie Gesundheitswesen und Finanzen eingeht.

StackAI bietet eine No-Code-Plattform, die große Sprachmodelle (LLMs) mit Unternehmensdaten über eine intuitive 2D-visuelle Leinwand verbindet. Geschäftsteams können ganz einfach Arbeitsabläufe mithilfe von Drag-and-Drop-Tools erstellen, während Entwickler die Flexibilität haben, diese Arbeitsabläufe mit Python-Knoten für eine tiefergehende Anpassung zu erweitern. Im Jahr 2025 nutzte Stefan Galluppi, CIO von LifeMD, StackAI, um komplizierte KI-Workflows zu vereinfachen und demonstrierte damit die Effektivität der Plattform.

Dieses benutzerfreundliche Design unterstützt die nahtlose Integration mit führenden LLMs.

StackAI unterstützt nativ Top-LLMs, einschließlich OpenAI, Anthropic (Claude), Mistral, Google, Meta, Azure OpenAI und lokale Modelle über Endpunkte. Sein AI-Native Routing führt Logikknoten für die If/Else-Entscheidungsfindung und dynamische Eingabeaufforderungen ein und ermöglicht so eine automatisierte Aufgabenweiterleitung basierend auf LLM-Ausgaben. Ein integrierter Knowledge Base-Knoten vereinfacht den RAG-Prozess (Retrieval-Augmented Generation), indem er Chunking, Einbettung, Indizierung und den Abruf mit Zitaten übernimmt und 90 % der RAG-Anwendungsfälle sofort abdeckt.

Die Plattform zeichnet sich auch durch die Verarbeitung unstrukturierter Daten aus und bietet Tools für PDF-Parsing, Web Scraping und OCR. Dadurch werden Rohdaten in strukturierte Erkenntnisse umgewandelt, die als Chatbots, Webformulare, Batch-Prozessoren für Massenaufgaben oder REST-APIs für die Backend-Integration bereitgestellt werden können. Am MIT Martin Trust Center beispielsweise hat Doug Williams, Gen AI Lead, in nur wenigen Wochen KI-Assistenten für Studenten entwickelt und so deren Lernerfahrung revolutioniert, ohne dass Programmierkenntnisse erforderlich sind. In ähnlicher Weise konnte Brian Hayt, BI-Direktor bei Noblereach, den Zeitaufwand für die Erstellung vollständig zitierter Berichte für Fördermittel und Wettbewerbsforschung von einer Woche auf nur fünf Minuten reduzieren.

StackAI bietet eine klare und flexible Preisstruktur mit drei Stufen: einen kostenlosen Plan für die Prototypenerstellung im Frühstadium, ein nutzungsbasiertes SaaS-Modell für die Skalierung von Abläufen und einen maßgeschneiderten Enterprise-Plan für groß angelegte Bereitstellungen, einschließlich privater Cloud- oder On-Premise-Optionen.

Diese flexible Preisgestaltung stellt sicher, dass StackAI Benutzer in jeder Phase unterstützen kann, von kleinen Prototypen bis hin zu Anwendungen auf Unternehmensebene.

Die Plattform passt sich sowohl den individuellen als auch den Unternehmensanforderungen an und verfügt über über 100 vorgefertigte Vorlagen für eine schnelle Bereitstellung. Zu den Tools der Enterprise-Klasse gehören SSO, Passwortschutz, benutzerdefinierte Domänen und zentralisierte Analysen zur Überwachung der Token-Nutzung und -Leistung. Entwickler können Arbeitsabläufe mit benutzerdefiniertem Code oder API-Knoten erweitern, während technisch nicht versierte Benutzer vom unkomplizierten visuellen Builder profitieren. Guillermo Rauch, CEO von Vercel, hebt die Zugänglichkeit hervor:

__XLATE_51__

StackAI macht das Versprechen von KI-Agenten wahr. Für alle, maßstabsgetreu, einfach per Mausklick.

Dieses Gleichgewicht aus Einfachheit und erweiterter Funktionalität macht StackAI zu einem leistungsstarken Tool für Unternehmen jeder Größe.

StackAI priorisiert die Sicherheit mit einem 8-Ebenen-Governance-Modell, das RBAC, Kontrollen auf Ordnerebene, Projektversionierung, SSO, verschlüsselte Verbindungen, Produktionsanalysen und MFA umfasst. Die Plattform entspricht den Standards SOC 2 Typ II, HIPAA und DSGVO, die ISO 27001-Zertifizierung ist in Bearbeitung. Funktionen wie PII-Erkennung und -Schwärzung, Richtlinien zur Datenaufbewahrung und die strikte Verpflichtung, Benutzerdaten nicht für Modellschulungen im Rahmen von Unternehmensverträgen zu verwenden, gewährleisten den Datenschutz. Für Branchen mit strengen Anforderungen an die Datenresidenz, wie z. B. Verteidigung und Finanzen, unterstützt StackAI On-Premise- und Private-Cloud-Bereitstellungen. Darüber hinaus stellen manuelle Genehmigungsworkflows sicher, dass kein KI-Agent ohne ordnungsgemäße Prüfung in Betrieb geht.

Dieser umfassende Governance- und Sicherheitsansatz macht StackAI zu einer vertrauenswürdigen Wahl für Unternehmen mit hohen Compliance- und Datenschutzstandards.

Pipedream is a platform designed with developers in mind, blending serverless infrastructure with AI-driven workflow automation. It’s trusted by over 1,000,000 developers, from small startups to Fortune 500 companies, handling billions of events and supporting data pipelines that process over 10,000,000 events per second. After being acquired by Workday in December 2025, Pipedream has strengthened its focus on enterprise-level stability and governance, giving developers more control and flexibility in automation. This foundation supports its advanced AI integration capabilities.

The platform’s code-centric design is a key feature, allowing developers to write custom Node.js, Python, Go, or Bash code directly within workflows. It also supports the use of any npm or PyPI package in a serverless environment. This flexibility makes it easier for developers to prototype quickly without the limitations often found in no-code platforms.

Pipedream umfasst KI-Tools wie „Create with AI“, „Edit with AI“ und „Debug with AI“ – bereitgestellt von String.com – um Entwicklern beim Erstellen, Ändern und Beheben von Arbeitsabläufen mithilfe von Eingabeaufforderungen in natürlicher Sprache und automatisierten Fehlerkorrekturen zu helfen.

The platform supports the Model Context Protocol (MCP), which includes a Docs MCP Server. This feature enables AI assistants like Claude and development environments such as VSCode to search Pipedream documentation and generate precise integration code. Pre-built actions are available for popular LLMs like OpenAI and Claude, handling tasks such as text classification, summarization, and embeddings. Developers can also write their own code to interact with any LLM API using Pipedream’s serverless environment.

Pipedream verwendet eine kreditbasierte Preisstruktur, bei der 1 Kredit 30 Sekunden Rechenzeit entspricht.

Für Unternehmen sind benutzerdefinierte Preise mit zusätzlichen Funktionen wie HIPAA-Konformität und Prüfprotokollen verfügbar.

Pipedream ist auf Skalierbarkeit ausgelegt und bietet Funktionen wie anpassbaren Speicher, benutzerdefinierte Zeitüberschreitungen, Ratenbegrenzungen und Kaltstartverwaltung. Es unterstützt ereignisgesteuerte Muster und Echtzeit-Trigger und eignet sich daher ideal für die Verarbeitung großer Datenmengen und die Backend-Automatisierung. Mit über 3.000 App-Integrationen und integriertem Authentifizierungsmanagement können Teams komplexe Arbeitsabläufe erstellen, ohne sich um die manuelle Handhabung von Anmeldeinformationen kümmern zu müssen.

Für Entwicklerteams bietet die Plattform Tools wie GitHub Sync, VS Code-Integration und MCP-Serverbereitstellung. Mit Schrittnotizen können Entwickler Markdown-basierte Erklärungen direkt zu Workflow-Schritten hinzufügen und so die Kommunikation und Dokumentation im Team verbessern.

Pipedream legt neben der Leistung auch Wert auf Governance und Sicherheit. Die Plattform ist SOC 2 Typ II zertifiziert, HIPAA-konform und erfüllt die DSGVO-Standards. Es enthält eine Datenverarbeitungsvereinbarung (DPA) zur Verwaltung sensibler Daten. Zu den wichtigsten Sicherheitsfunktionen gehören:

Für Unternehmensbenutzer stehen zusätzliche Optionen wie SAML SSO, SCIM für das Identitätsmanagement und Zwei-Faktor-Authentifizierung (2FA) zur Verfügung. Die Audit-Protokollierung ist in der Enterprise-Stufe enthalten und bietet Einblicke in Workflow-Ausführungen und -Änderungen. Darüber hinaus erhöhen aus der Quelle verfügbare Auslöser und Aktionen die Transparenz bei Sicherheitsüberprüfungen.

Workato is a platform designed to handle complex, cross-departmental processes for enterprises. It’s trusted by over 2,000 brands, including Broadcom, Zendesk, and Atlassian, to manage workflows that require high uptime and strict governance.

Die Plattform verfügt über den Workato Agentic & Genie Framework, das KI-gesteuerte Automatisierung nutzt, um über die grundlegenden Chatbot-Funktionen hinauszugehen. Diese spezialisierten KI-Agenten, sogenannte „Genies“, können Daten abrufen, Aktionen in mehr als 8.500 Apps auslösen und dynamische Prozesse verwalten. Der AI Connector, der in Zusammenarbeit mit Anthropic und OpenAI entwickelt wurde, nutzt Modelle wie Sonnet 4 von Anthropic und GPT-4o mini von OpenAI für Aufgaben wie Textanalyse, E-Mail-Entwurf, Zusammenfassung und Übersetzung.

At the heart of Workato’s AI capabilities is Workato Genie, which uses generative AI to interpret user intent, incorporate real-time enterprise data, and execute tasks autonomously. Bhaskar Roy, Chief of AI Products & Solutions at Workato, highlights its impact:

__XLATE_64__

„Mit Workato Agentic können Unternehmen jetzt schnell KI-Agenten mit Low-Code/No-Code erstellen und verwalten, um die Produktivität zu steigern und die betriebliche Effizienz im gesamten Unternehmen zu steigern.“

Workato umfasst außerdem AIRO (AI Orchestrator), einen KI-gestützten Assistenten, der Benutzern hilft, Arbeitsabläufe mithilfe natürlicher Sprache zu erstellen und zu verfeinern. Vorkonfigurierte KI-Aktionen bieten integrierte LLM-Funktionen, während das Agent Studio sensible Entscheidungen über Slack oder Microsoft Teams zur Genehmigung an Menschen weiterleitet. Für Kundenarbeitsbereiche sind AI-Connector-Aktionen auf 60 Anfragen pro Minute begrenzt.

The platform offers pre-built applications known as Genie Apps, such as ITGenie for handling helpdesk tickets and SalesGenie to boost sales productivity. These Genies adapt based on user interactions, ensuring that learning remains specific to the customer’s environment to protect data privacy.

Die KI-Integration von Workato ist gepaart mit der Fähigkeit, in großen Organisationen effektiv zu skalieren.

Workato’s workflows are designed to scale across enterprises and mid-sized businesses, connecting with over 8,500 apps, databases, and ERP systems. With orchestration patterns capable of managing more than 850 billion actions, the platform also supports Data Pipelines for high-volume replication to data warehouses like Snowflake and Databricks. These pipelines use parallel execution and automatic schema updates to handle large datasets efficiently.

Entscheidungsmodelle vereinfachen komplexe Geschäftslogiken wie dynamische Preisgestaltung oder Lead-Bewertung, indem sie Regeln in zentralen Tabellen außerhalb einzelner Arbeitsabläufe speichern. Dieser Ansatz vereinfacht die Prüfung und Aktualisierung. Mittlerweile speichern Datentabellen – ein Upgrade von Lookup Tables – deutlich größere Datensätze mit erweiterten Suchfunktionen.

Workato’s global infrastructure supports local data residency with data centers in the EU, Australia, and Singapore. The platform is available in eight languages, including Japanese, Korean, and Spanish, and maintains a 99.9% uptime SLA for critical operations. It has been recognized as a Leader in the Gartner® Magic Quadrant™ for iPaaS seven times, with two instances of being positioned furthest in "Vision" as of 2025.

Um seine Skalierbarkeit zu ergänzen, legt Workato Wert auf Governance und Sicherheit.

Workato’s Enterprise MCP Gateway serves as a secure control layer between AI tools and business systems, enforcing policies and ensuring visibility during runtime. AI agents operate under user-specific OAuth credentials, limiting access to authorized data. Additional safeguards include PII masking and de-identification within workflows.

Administratoren können „vertrauenswürdige Fähigkeiten“ definieren, bei denen es sich um vorab genehmigte Rezepte oder Konnektoren handelt, die Agenten verwenden können, um so unbefugte API-Aufrufe zu verhindern. RBAC 2.0 gewährleistet präzise Berechtigungen auf Projektebene und vermeidet unnötige Rollenerweiterungen. Die Plattform umfasst außerdem erweiterte Sicherheitsmaßnahmen wie BYOK-Verschlüsselung, stündliche Schlüsselrotation und Containerisolation mit mTLS. Zu den Zertifizierungen gehören SOC 2 Typ II, ISO 27001, PCI DSS und DSGVO-Konformität.

Echtzeit-Prüfprotokolle und Human-in-the-Loop-Genehmigungen gewährleisten die Verantwortlichkeit für alle Agentenaktionen. Die Funktion „Bewertungen und Genehmigungen“ optimiert die Rezeptbereitstellung in Entwicklungs-, Test- und Produktionsumgebungen. Eine Organisation berichtete, dass die Bearbeitung von Umsiedlungsanfragen für Mitarbeiter mithilfe von Workato um 98 % schneller erfolgt sei.

Workato folgt einem unternehmensorientierten Preismodell ohne öffentlich verfügbare Tarife. Die Preise richten sich nach Faktoren wie der Anzahl der Aufgaben, der Nutzung erweiterter Connectors und der Anzahl der Benutzer. Kleine Unternehmen geben normalerweise 500 bis 3.000 US-Dollar pro Monat aus, mittelständische Unternehmen 3.000 bis 10.000 US-Dollar und große Unternehmen zahlen oft mehr als 10.000 US-Dollar pro Monat für benutzerdefinierte Integrationen und Support. Die Plattform ist für Organisationen konzipiert, die eine erweiterte Governance und komplexes Prozessmanagement benötigen.

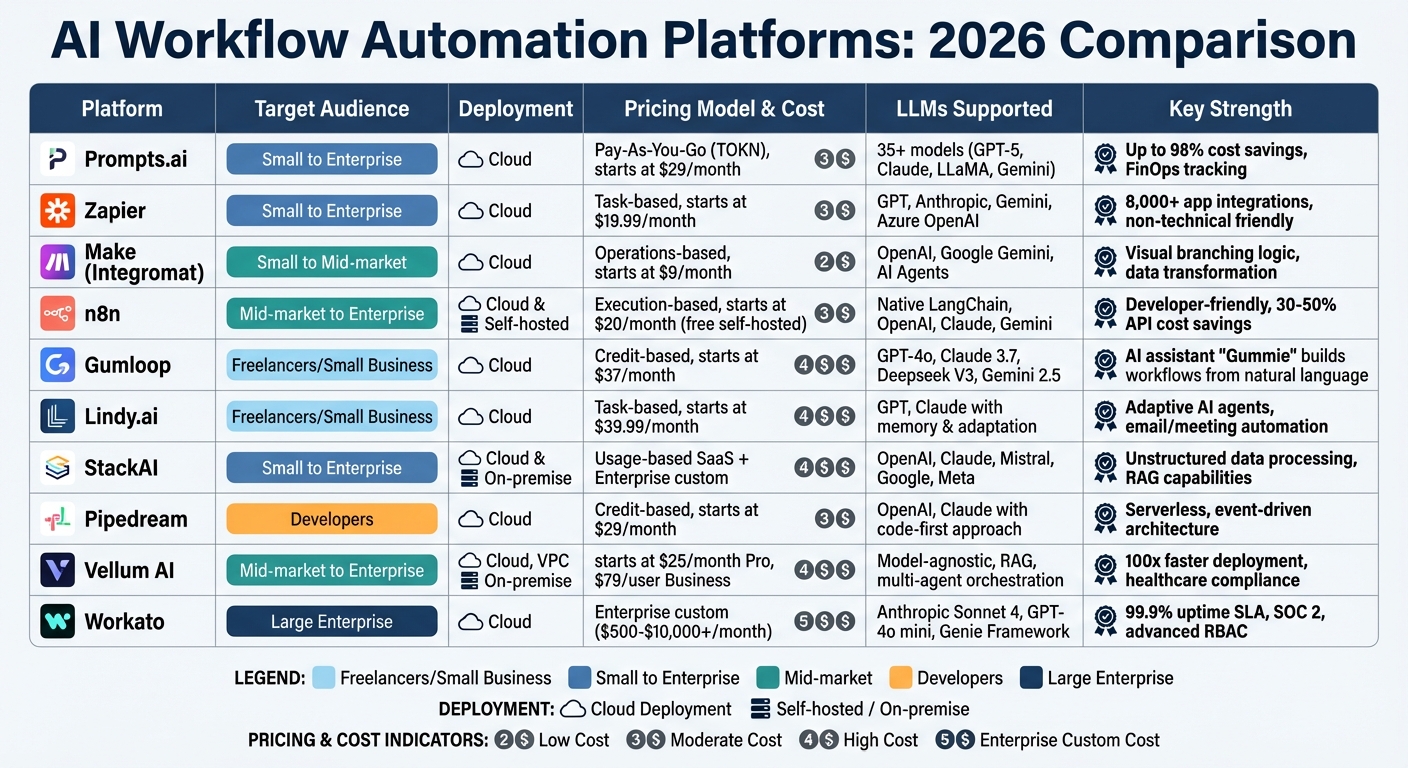

Vergleich der AI-Workflow-Plattform: Funktionen, Preise und Vorteile Zielgruppe 2026

Choosing the right AI workflow platform depends on your team’s size, technical expertise, budget, and governance requirements. To simplify the decision-making process, the table below provides a side-by-side comparison of key features across various platforms.

Dieser Vergleich verdeutlicht, wie jede Plattform auf spezifische Geschäftsanforderungen eingeht und dabei Preismodelle und Bereitstellungsflexibilität in Einklang bringt. Beispielsweise bietet n8n mit seiner kostenlosen, selbst gehosteten Option vorhersehbare Kosten und Flexibilität, was es für technische Teams attraktiv macht. Im Gegensatz dazu priorisieren Plattformen wie Zapier die Benutzerfreundlichkeit für technisch nicht versierte Benutzer, können jedoch bei hohem Aufgabenvolumen kostspielig werden.

Bei der Prüfung von Bereitstellungsoptionen ist der Datenschutz ein Schlüsselfaktor. Im Gegensatz zu den meisten reinen Cloud-Plattformen ermöglicht n8n das Selbsthosting, sodass Teams die volle Kontrolle über ihre Infrastruktur haben. Andererseits konzentrieren sich Unternehmenslösungen wie Workato auf erweiterte Governance und Compliance und eignen sich daher ideal für die Verwaltung sensibler, hochvolumiger Arbeitsabläufe. Diese Unterscheidungen stellen sicher, dass Unternehmen die Plattformfunktionen an ihre betrieblichen Prioritäten anpassen können.

Choosing the right AI workflow platform in 2026 requires aligning your team's technical skills with your organization’s scale and compliance needs. For non-technical teams, tools like Zapier or Lindy.ai offer intuitive, prompt-based environments. On the other hand, developer-heavy organizations often prefer platforms like n8n or Pipedream, which provide greater customization through code extensions. A key differentiator among these platforms is how they manage workflow maintenance, a theme that has been explored throughout this guide.

Die Entwicklung von der Basisautomatisierung zu autonomen KI-Workflows bringt neue Anforderungen mit sich – die Handhabung semantischer Entscheidungsfindung, die abrufgestützte Generierung und die Orchestrierung mehrerer Agenten. Wie Nicolas Zeeb es ausdrückt:

__XLATE_77__

Der Weg nach vorne im Jahr 2026 besteht darin, einen großen Sprung von einer reinen KI-Automatisierungs-Entwicklerdisziplin zu einem Mannschaftssport zu machen.

Dieser Wandel unterstreicht die Bedeutung von Plattformen, die technische Flexibilität mit Governance-Funktionen verbinden und es Ingenieuren und Fachexperten ermöglichen, effektiv zusammenzuarbeiten. Diese Herausforderungen verdeutlichen die Bedeutung von Leistungskennzahlen und betrieblicher Transparenz.

Produktionsreife Plattformen zeichnen sich durch Funktionen wie Echtzeitprotokollierung, Versionskontrolle und klare Preisstrukturen aus. Da 95 % der generativen KI-Pilotprojekte aufgrund von Infrastruktureinschränkungen nicht in die Produktion übergehen, sind Tools, die Beobachtbarkeit und Kostenvorhersagbarkeit unterstützen, unerlässlich. Viele Unternehmen erzielen innerhalb von 2 bis 6 Wochen Ergebnisse auf Produktionsebene, indem sie mit gezielten Pilotprojekten beginnen, frühzeitig semantisches Routing integrieren und in der dritten Woche Regressionstests einführen.

Über die technischen Fähigkeiten hinaus sind die Einhaltung gesetzlicher Vorschriften und Sicherheitsvorschriften für die Akzeptanz in Unternehmen von entscheidender Bedeutung. Funktionen wie rollenbasierte Zugriffskontrolle (RBAC), SOC 2-Konformität, Audit-Trails und flexible Bereitstellungsoptionen stellen sicher, dass Plattformen skalierbar sind und gleichzeitig die gesetzlichen Anforderungen erfüllen. Wie bereits erwähnt, integrieren Plattformen wie Prompts.ai und Workato diese Kontrollen effektiv, um den unterschiedlichen Unternehmensanforderungen gerecht zu werden.

Während KI-Agenten bis 2028 einen Wertbeitrag von 450 Milliarden US-Dollar leisten könnten, haben nur 2 % der Unternehmen sie vollständig angenommen. Die in diesem Leitfaden besprochenen Plattformen bilden die Grundlage, um diese Lücke zu schließen und isolierte KI-Experimente in skalierbare, messbare Arbeitsabläufe umzuwandeln, die die Produktivität vorantreiben.

KI-Workflow-Plattformen im Jahr 2026 bringen bahnbrechende Vorteile für Unternehmen und Fachleute gleichermaßen. Sie vereinfachen die Automatisierung komplexer Aufgaben, verbessern die Workflow-Effizienz und zentralisieren die Verwaltung verschiedener KI-Modelle. Diese Fähigkeiten führen zu erheblichen Kostensenkungen und einer bis zu zehnfachen Produktivitätssteigerung.

Über die Effizienz hinaus gehen diese Plattformen drängende Probleme wie Compliance, Sicherheit und die Herausforderung der Integration mehrerer Tools an. Durch die Vereinheitlichung von KI-Modellen und die Automatisierung von Governance-Prozessen sorgen sie für einen reibungslosen Betrieb. Sie lassen sich außerdem mühelos in fortschrittliche große Sprachmodelle integrieren, sodass Unternehmen ihre Abläufe effektiv skalieren und gleichzeitig die Kontrolle und Überwachung ihrer KI-Workflows behalten können. Diese Kombination aus Effizienz und Kontrolle macht diese Plattformen unverzichtbar für die Steigerung der Produktivität und die Aufrechterhaltung hoher Betriebsstandards.

Prompts.ai ermöglicht es Unternehmen, Kosten zu senken und gleichzeitig transparent zu bleiben, indem es eine Kostenverfolgung in Echtzeit und ein flexibles Pay-as-you-go-Preismodell bietet. Diese Tools ermöglichen es Unternehmen, ihre Ausgaben genau im Auge zu behalten und nur für die Ressourcen zu bezahlen, die sie aktiv nutzen, sodass die Ausgaben vorhersehbar und anpassungsfähig bleiben.

Darüber hinaus legt Prompts.ai Wert auf Sicherheit und Compliance und bietet die Compliance-Standards SOC 2 Typ II und HIPAA. Diese Maßnahmen tragen dazu bei, das Risiko teurer regulatorischer Rückschläge zu verringern. Durch die Kombination von effektivem Kostenmanagement mit starken Compliance-Schutzmaßnahmen hilft Prompts.ai Unternehmen dabei, ihre Arbeitsabläufe zu rationalisieren, ohne auf unerwartete finanzielle Hürden zu stoßen.

KI-Workflow-Plattformen priorisieren starke Sicherheitsprotokolle, um sensible Informationen zu schützen und Branchenvorschriften einzuhalten. Zu den wichtigsten Maßnahmen gehören Verschlüsselung zum Schutz von Daten sowohl bei der Übertragung als auch im Ruhezustand, rollenbasierte Zugriffskontrollen zur Verwaltung von Benutzerberechtigungen und die Einhaltung von Frameworks wie SOC 2 und DSGVO.

Viele Plattformen bieten außerdem erweiterte Funktionen wie Echtzeit-Bedrohungserkennung, sichere Schlüsselverwaltung und Zertifizierungen, die ihren Fokus auf Sicherheit bestätigen. Diese Tools tragen dazu bei, Risiken wie unbefugten Zugriff, Datenschutzverletzungen und den Diebstahl von KI-Modellen zu reduzieren, sodass Unternehmen KI-gestützte Arbeitsabläufe sicher verwalten können.