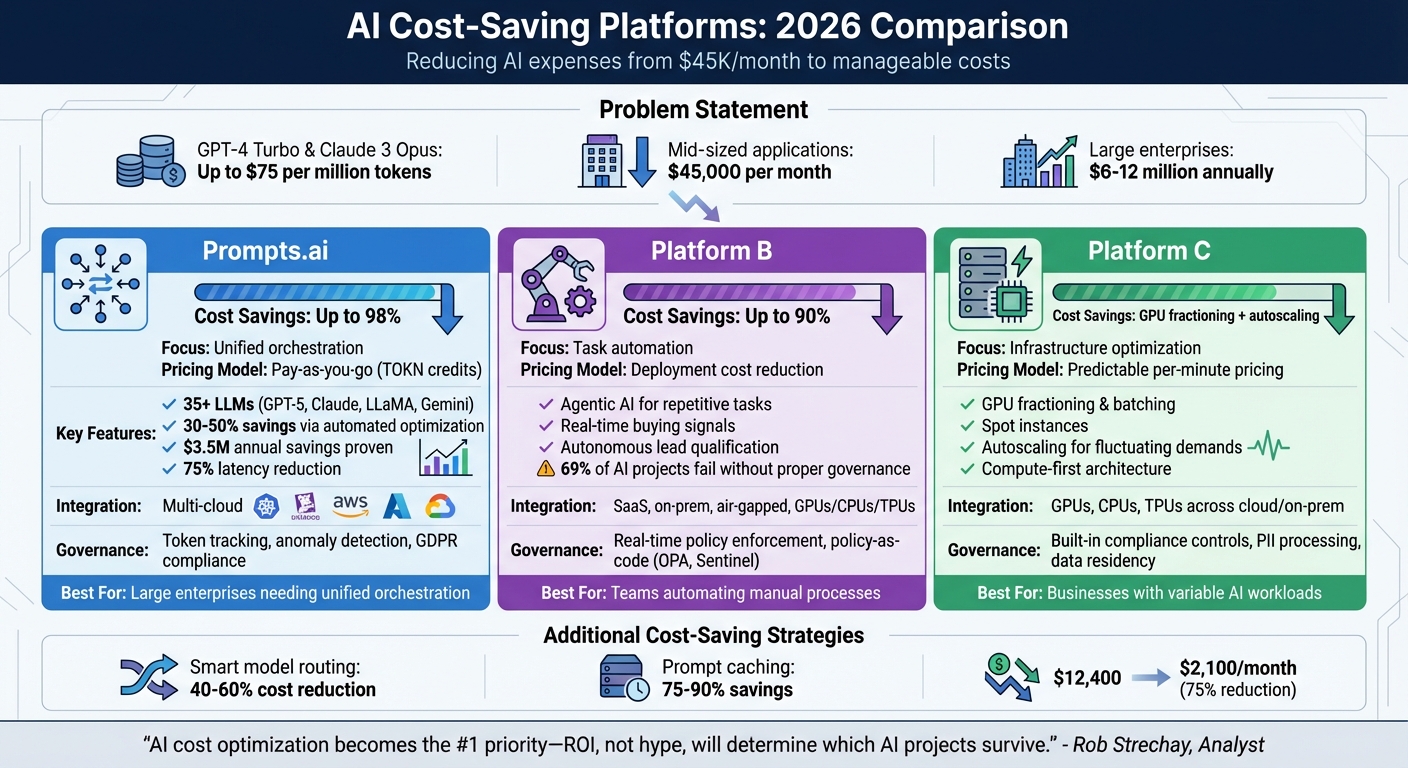

بحلول عام 2026، أصبحت إدارة تكاليف الذكاء الاصطناعي أولوية قصوى للشركات. مع نماذج مثل GPT-4 Turbo وClaude 3 Opus التي تكلف ما يصل إلى 75 دولارًا لكل مليون رمز، يمكن أن تخرج النفقات بسرعة عن نطاق السيطرة - حيث تصل إلى 45000 دولار شهريا للتطبيقات متوسطة الحجم و $6–12 million annually للمؤسسات الكبيرة. لمعالجة هذه المشكلة، منصات مثل Prompts.aiيقدم النظام الأساسي B والنظام C حلولاً لخفض التكاليف من خلال التنسيق الموحد والأتمتة و تحسين البنية التحتية. تشمل الوجبات الرئيسية ما يلي:

تعمل هذه الأنظمة الأساسية على تبسيط سير العمل، وتقليل النفقات، وضمان الامتثال، مما يساعد الشركات على الحفاظ على الأداء مع البقاء في حدود الميزانية.

| الميزة/المنصة | Prompts.ai | المنصة ب | منصة ج |

|---|---|---|---|

| وفورات في التكاليف | ما يصل إلى 98% | ما يصل إلى 90% | تجزئة GPU، والقياس التلقائي |

| ركز | تنسيق موحد | أتمتة المهام | تحسين البنية التحتية |

| نموذج التسعير | الدفع أولاً بأول (أرصدة TOKN) | خفض تكلفة النشر | أسعار يمكن التنبؤ بها للدقيقة |

| اندماج | السحابة المتعددة، Kubernetes، Datadog | SaaS، داخليًا، معزول بالهواء | وحدات معالجة الرسومات، ووحدات المعالجة المركزية، ووحدات TPU |

| الحكم | تتبع الرمز المميز، والكشف عن الشذوذ | إنفاذ السياسات في الوقت الحقيقي | ضوابط الامتثال المضمنة |

Choosing the right platform depends on your organization’s needs, whether it's reducing costs, improving workflows, or managing compliance effectively.

__XLATE_9__

تجمع Prompts.ai أكثر من 35 من نماذج اللغات الكبيرة الأكثر تقدمًا، مثل GPT-5، وClaude، وLLaMA، وGemini، في منصة تنسيق موحدة. ومن خلال التخلص من الحاجة إلى عقود واشتراكات متعددة للبائعين، فإنه يمكّن المؤسسات من خفض تكاليف برامج الذكاء الاصطناعي بنسبة تصل إلى 98%. تعمل المنصة على نظام الدفع أولاً بأول باستخدام أرصدة TOKN، مما يضمن أن يدفع المستخدمون فقط مقابل ما يستخدمونه، دون أي رسوم شهرية متكررة.

Prompts.ai delivers 30–50% savings through automated resource optimization, which adjusts compute, storage, and network resources to the exact needs of the organization. Proven implementations have shown annual savings of $3.5 million by applying these optimizations to AI training and inference workloads. The platform’s FinOps layer provides detailed cost tracking, allowing teams to pinpoint anomalies and fine-tune spending at a granular level - whether by token, inference, or API call.

تساعد عناصر التحكم في التكلفة في الوقت الفعلي على تجنب تجاوزات الميزانية من خلال تحديد حدود الإنفاق للفرق والمشاريع. يؤدي التوسع التلقائي لوحدة معالجة الرسومات أثناء أوقات الذروة وخارجها إلى تقليل زمن الوصول بنسبة تصل إلى 75%، مع خفض نفقات خدمة الذكاء الاصطناعي السحابية. بالنسبة لخطوط الأنابيب المستندة إلى Kubernetes، تقوم Prompts.ai بأتمتة استخدام المثيلات الموضعية وجدولة عبء العمل، وتعبئة أعباء العمل بكفاءة في مثيلات فعالة من حيث التكلفة دون المساس بأداء النموذج. وتضمن إمكانات التكامل السلس أيضًا التوافق مع البنية التحتية الحالية.

يتصل Prompts.ai بسهولة مع منصات مثل AWS وAzure وGoogle Cloud وKubernetes وAWS Lambda وAmazon EC2 وSnowflake وDatadog، مما يتيح سير العمل بسلاسة عبر الإعداد الحالي لديك. وهو يدعم تدفقات البيانات في الوقت الفعلي لنماذج اللغات الكبيرة ويقوم بأتمتة التزويد، مما يسهل على المطورين دمج أدوات المراقبة مثل Datadog أو قياس نقاط نهاية الاستدلال أثناء زيادة حركة المرور. لا تعمل عمليات التكامل هذه على تحسين تخصيص الموارد فحسب، بل تعمل أيضًا على تقليل النفقات التشغيلية. ومن خلال تمكين مقارنات النماذج جنبًا إلى جنب، يمكن للفرق تحديد الخيار الأكثر فعالية من حيث التكلفة لاحتياجاتهم، بينما تعمل مسارات العمل السريعة الموحدة على التخلص من متاعب التوفيق بين الأدوات المتعددة.

بالإضافة إلى توفير التكاليف والتكامل، تتضمن Prompts.ai أدوات حوكمة تضمن تتبعًا دقيقًا للتكاليف والامتثال للمعايير التنظيمية. تعمل ميزات مثل وضع العلامات الافتراضية لتخصيص التكلفة والكشف عن الحالات الشاذة المستندة إلى التعلم الآلي دون الحاجة إلى إجراء تغييرات على البنية التحتية الحالية. تدعم المنصة نماذج العرض وتلتزم باللوائح مثل اللائحة العامة لحماية البيانات (GDPR) عبر البيئات السحابية المتعددة، مما يضمن حوكمة التكلفة القابلة للتدقيق. يتم تسجيل كل تفاعل للذكاء الاصطناعي، مما يوفر للمؤسسات رؤية كاملة لاستخدام النموذج وأنشطة الفريق وإدارة البيانات.

تم تصميم Prompts.ai للتعامل مع أعباء عمل الذكاء الاصطناعي المتزايدة بسهولة، ودعم إعدادات السحابة المتعددة التي يمكن التوسع فيها بسهولة. يمكن للمؤسسات استيعاب النماذج والمستخدمين والفرق الجديدة في دقائق معدودة فقط دون تعطيل سير العمل الحالي. تم تصميم بنيتها لعمليات النشر على مستوى المؤسسة، وهي قادرة على إدارة أكثر من 100000 تغيير في الإنتاج مع الحفاظ على الأداء المتسق. وهذا يجعله حلاً مثاليًا للشركات التي تنتقل من المشاريع التجريبية صغيرة الحجم إلى عمليات الذكاء الاصطناعي واسعة النطاق عبر أقسام متعددة.

تم تصميم النظام الأساسي B لخفض تكاليف الذكاء الاصطناعي من خلال تولي المهام المتكررة من خلال الأتمتة. بدلاً من التركيز فقط على تعديلات البنية التحتية، فإنها تستخدم الذكاء الاصطناعي الوكيل للتعامل مع الأنشطة التي تستغرق وقتًا طويلاً مثل البحث وإدخال البيانات وتحديثات إدارة علاقات العملاء. يتيح ذلك للفرق التركيز على العمل الأكثر تأثيرًا مع خفض تكاليف التشغيل.

من خلال أتمتة العمليات اليدوية، تعمل المنصة B على تقليل النفقات بشكل كبير. ويعمل الذكاء الاصطناعي الخاص بها بشكل مستقل، ويتفاعل مع إشارات الشراء في الوقت الفعلي بدلاً من الاعتماد على قواعد اللعبة الصارمة. وهذا يمكّنها من تحديد العملاء المتوقعين المؤهلين وصياغة رسائل مخصصة بشكل فعال. أبلغت الشركات التي تستخدم هذا النظام عن انخفاض يصل إلى 90% في تكاليف نشر الذكاء الاصطناعي[3].

تعمل المنصة B كمركز تحكم مركزي لإدارة أحمال عمل الذكاء الاصطناعي عبر مختلف البنى التحتية، بما في ذلك منصات SaaS، وVPCs السحابية، والأنظمة المحلية، وحتى البيئات المعزولة بالهواء. متوافق مع وحدات معالجة الرسومات، ووحدات المعالجة المركزية، ووحدات TPU، ولا يتطلب أي تكوينات متخصصة. تتكامل المنصة بسلاسة مع أدوات الذكاء الاصطناعي الحالية من خلال واجهة مستخدم بديهية وSDK وCLI، مما يسهل إنشاء النماذج وتكوينها. يسمح هذا الأسلوب للمؤسسات بتحسين إعداداتها الحالية دون الحاجة إلى تغييرات واسعة النطاق في البنية التحتية.

تضمن المنصة الامتثال من خلال أتمتة جمع الأدلة وإنفاذ السياسات في الوقت الفعلي عبر البيئات السحابية. باستخدام أدوات السياسة كرمز مثل OPA، وHashiCorp Sentinel، وAWS Config، فإنه يدمج الحوكمة في مسارات CI/CD وIaC. يقوم الكشف الآلي عن الانجراف بمقارنة البنية التحتية الحية بالحالات المعلنة، ووضع العلامات ومعالجة الموارد غير المُدارة أو المشكلات الأمنية. يتم ربط كل نموذج من عناصر النموذج بالتزام Git ومعرف خطة Terraform، مما يؤدي إلى إنشاء مسار تدقيق مفصل. مع فشل 69% من مشاريع الذكاء الاصطناعي في الوصول إلى النشر بسبب عقبات التكامل والحوكمة[3]، تساعد هذه الميزات على تجنب الإجراءات غير المصرح بها والحفاظ على المعايير التنظيمية.

توفر المنصة B مستوى تحكم موحدًا لإدارة إعدادات الذكاء الاصطناعي متعددة السحابات. فهو يبسط عملية التوسع من خلال توحيد أدوار IAM ووضع العلامات أثناء استخدام حلقات التسوية لتحسين الموارد من أجل أعباء العمل المتزايدة. ونظرًا لأن 94% من المؤسسات ترى أن تنسيق العمليات هو مفتاح نجاح الذكاء الاصطناعي[3]، فإن هذا النظام المبسط يدعم التوسع من البرامج التجريبية الصغيرة إلى عمليات نشر المؤسسات واسعة النطاق دون إضافة تعقيدات غير ضرورية. ويضمن نهجها المركزي الاستعداد لاتخاذ تدابير توفير التكاليف مع توسع العمليات.

تركز المنصة C على خفض التكاليف عن طريق تحسين طبقة البنية التحتية. يوظف تجزئة GPU وتجميعها لتحقيق أقصى استفادة من موارد GPU. ومن خلال تجميع أعباء العمل المتعددة معًا، فإنه يزيد من الإنتاجية، مما يضمن أن الشركات تدفع فقط مقابل الموارد التي تستخدمها بنشاط، بدلاً من الحفاظ على القدرات غير المستخدمة.

هذه المنصة تقلل النفقات من خلال اكتشاف المثيلات والقياس التلقائي. يعمل القياس التلقائي على تقليل موارد الحوسبة أثناء فترات الخمول، وهو أمر مثالي للشركات ذات متطلبات الذكاء الاصطناعي المتقلبة. بدلاً من الاعتماد على التسعير الباهظ لكل رمز، فإنه يقدم نموذج تسعير يمكن التنبؤ به في الدقيقة، مما يجعل التكاليف أكثر قابلية للإدارة مثل مقاييس الاستخدام. بالإضافة إلى ذلك، من خلال تحديد موقع استدلال وحدة معالجة الرسومات مع نقاط تواجد الاتصالات، فإنه يلغي الحاجة إلى العديد من البائعين الخارجيين، مما يبسط التكامل ويخفض التكاليف المرتبطة. تتوافق هذه الميزات مع استراتيجية نشر مرنة للتكيف مع احتياجات العمل المختلفة.

يستخدم النظام الأساسي C بنية الحساب أولاً يدعم النشر عبر وحدات معالجة الرسومات ووحدات المعالجة المركزية ووحدات TPU. يسمح مستوى التحكم الموحد الخاص بها بالتنسيق السلس لأحمال عمل الذكاء الاصطناعي عبر منصات SaaS، وسحابة VPCs، والإعدادات المحلية، وحتى البيئات المعزولة، كل ذلك دون تقييد البائع. يمكّن هذا النهج المؤسسات من الاستفادة من بنيتها التحتية الحالية أثناء الوصول إلى مكتبة من النماذج ومسارات العمل المعدة مسبقًا. تعمل المنصة على تبسيط العمليات عن طريق إزالة الحاجة إلى التكوينات المعقدة.

يتضمن النظام الأساسي عناصر تحكم مدمجة للتعامل مع المهام مثل معالجة معلومات تحديد الهوية الشخصية (PII)، والموافقة على تسجيل المكالمات، ومتطلبات موقع البيانات. تعمل بنية المكدس الموحدة الخاصة بها على تبسيط الامتثال من خلال الحفاظ على المعايير التنظيمية دون إضافة تعقيد إضافي. ومن خلال دمج وظائف الحوكمة في منصة واحدة، يمكن للشركات تلبية احتياجات الامتثال بكفاءة والحفاظ على التكاليف تحت السيطرة.

عند اختيار منصة، من الضروري الموازنة بين المفاضلات لتحقيق أقصى استفادة من استثمارك في الذكاء الاصطناعي. بناءً على استراتيجيات توفير التكاليف السابقة، يتناول هذا القسم المجالات الرئيسية التي تختلف فيها المنصات.

تخفيض التكلفة: Smart model routing can cut costs by 40–60% by diverting simpler queries to more affordable models, such as DeepSeek or Gemini Flash. Additionally, using prompt caching for repetitive tasks can save 75–90%. For example, in late 2025, a team reduced their monthly expenses by 75%, dropping from $12,400 to $2,100 by routing queries to cost-efficient models.

قدرات التكامل: Platforms offering extensive connectors - some supporting over 70 vector databases and 100+ data ingestion sources - are highly adaptable to existing systems. However, these abstract layers may introduce 15–25% latency compared to direct model calls, which could be a concern for real-time applications.

__XLATE_35__

الحوكمة والامتثال: بالنسبة للصناعات ذات اللوائح الصارمة، تعد الأنظمة الأساسية التي تتضمن مسارات التدقيق وأدوات التوضيح وضوابط موقع البيانات أمرًا حيويًا. غالبًا ما يعود القرار إلى الموازنة بين المرونة والتحكم. توفر الحلول ذاتية الاستضافة خصوصية محسنة ولكنها تتطلب المزيد من الخبرة التقنية، في حين توفر منصات SaaS الراحة على حساب التكلفة المحتملة لسيادة البيانات. تؤثر اعتبارات الحوكمة هذه بشكل كبير على قابلية التوسع في الاستخدام العملي.

قابلية التوسع: غالبًا ما تكون نماذج التسعير القائمة على التنفيذ أكثر اقتصادا بالنسبة لسير عمل الذكاء الاصطناعي المعقد مع زيادة أعباء العمل، في حين أن ميزات مثل استمرار الحالة والتنفيذ الدائم - التي تستخدمها OpenAI لـ Codex في الإنتاج - تمكن الوكلاء من إدارة المهام طويلة الأمد دون فقدان السياق. على العكس من ذلك، تعد الأطر الأصغر حجمًا أكثر ملاءمة لعمليات نشر الحافة، حتى لو كانت تفتقر إلى بعض الميزات على مستوى المؤسسة.

في نهاية المطاف، سيتوقف النجاح في عام 2026 على مدى مواءمتك لقدرات النظام الأساسي مع احتياجاتك المحددة من حيث التكلفة والتكامل والامتثال وقابلية التوسع.

__XLATE_41__

- __XLATE_109__

Choosing the right platform to maximize cost savings and streamline operations in 2026 depends heavily on your organization’s size and specific needs. The strategies discussed - ranging from unified orchestration to intelligent model routing - are key for platforms designed to support seamless AI workflows. For large enterprises, orchestration layers offering centralized governance, token tracking, and vendor management are essential for coordinating multiple teams and maintaining compliance. On the other hand, small to mid-sized businesses often find greater value in using smaller, specialized models and tools tailored to specific tasks, like invoice processing or demand forecasting, without the complexity of large-scale integrations.

يظل التحكم في التكاليف قوة دافعة وراء الكفاءة التشغيلية. وكما قال المحلل Rob Strechay، "يصبح تحسين تكلفة الذكاء الاصطناعي هو الأولوية رقم 1 - عائد الاستثمار، وليس الضجيج، هو الذي سيحدد مشاريع الذكاء الاصطناعي التي ستنجح." تمهد إستراتيجيات التحسين هذه الطريق لأساليب مخصصة تلبي احتياجات المؤسسات من جميع الأحجام.

For smaller teams, immediate savings can be achieved with prompt caching and straightforward model routing. High-volume operations, however, gain more from advanced techniques like semantic caching and intelligent routing, which ensure premium models are reserved for complex tasks. Enterprises managing large-scale AI initiatives require robust governance tools - such as budget alerts, audit trails, and token approval systems - to keep spending under control. Notably, while technology accounts for only 20% of an AI initiative’s value, redesigning workflows delivers the remaining 80%, making operational adjustments equally critical.

في عصر أصبحت فيه كفاءة التكلفة غير قابلة للتفاوض، فإن اعتماد سيادة الذكاء الاصطناعي - تشغيل النماذج على البنية التحتية الخاصة - يوفر للمؤسسات طريقة لتقليل النفقات مع حماية البيانات الحساسة. ستكون المنصات التي تزدهر في عام 2026 هي تلك التي تتكامل بسلاسة مع سير العمل التشغيلي، مما يوفر وفورات حقيقية في التكلفة مع الحفاظ على معايير الأداء والامتثال.

تساعد Prompts.ai الشركات على خفض نفقات الذكاء الاصطناعي من خلال التوجيه الفوري الذكي و تحسين سير العمل. من خلال توجيه المهام الأبسط إلى نماذج أقل تكلفة وحجز النماذج المتقدمة للوظائف الأكثر تطلبًا أو أهمية، يساعد هذا النهج على خفض الرسوم المستندة إلى الرمز المميز. في المتوسط، أعلنت الشركات عن توفير ما يقرب من 6.5٪.

تتضمن المنصة أيضًا أدوات مثل تتبع التكلفة في الوقت الفعلي، والوصول إلى أكثر من 35 نموذجًا للذكاء الاصطناعي، والتوجيه القائم على القواعد لتبسيط العمليات. تساعد الميزات مثل واجهات برمجة التطبيقات الموحدة لإدارة موفري الخدمات المتعددين واستراتيجيات التخزين المؤقت التي تعيد استخدام المخرجات السابقة على تقليل استهلاك الموارد والتكاليف. تضمن هذه الأدوات أن يظل سير عمل الذكاء الاصطناعي فعالاً وفعالاً من حيث التكلفة مع الحفاظ على الأداء العالي.

Prompts.ai يتألق مع أدوات التنسيق التي تركز على الذكاء الاصطناعي، مصمم لتبسيط سير العمل عبر مجموعة متنوعة من نماذج الذكاء الاصطناعي ومجموعات البيانات والتطبيقات. وتشمل ميزاته البارزة تتبع التكلفة في الوقت الحقيقي and adherence to strict security standards such as SOC 2 Type II and HIPAA. With support for over 35 AI models, it’s a strong option for businesses aiming to enhance AI-driven operations while keeping costs and security in check.

في المقابل، غالبًا ما تتناول الأنظمة الأساسية الأخرى أهدافًا أوسع للأتمتة. البعض يتفوق فيها أتمتة بدون كود، تقدم عمليات تكامل واسعة النطاق للتطبيقات التي تلبي احتياجات الفرق غير الفنية التي تدير مسارات عمل متنوعة. والبعض الآخر يعطي الأولوية إدارة سير عمل الذكاء الاصطناعي بشكل آمن، مع التركيز على تقليل انتشار الأدوات، وتبسيط العمليات، وتوفير رؤية متعمقة للتكلفة.

يعد Prompts.ai مناسبًا بشكل خاص للشركات التي تحتاج إلى ذلك حلول سير عمل الذكاء الاصطناعي تتسم بالكفاءة والأمان والميزانية، في حين أن الأنظمة الأساسية البديلة قد تخدم بشكل أفضل أولئك الذين لديهم متطلبات أتمتة عامة أو متطلبات امتثال متخصصة.

تلعب الحوكمة والامتثال دورًا حاسمًا في اختيار النظام الأساسي المناسب لتوفير تكاليف الذكاء الاصطناعي. فهي تضمن التزام سير عمل الذكاء الاصطناعي لديك بالمعايير القانونية والأخلاقية والتنظيمية، وهو أمر أساسي لحماية البيانات الحساسة، وتجنب الغرامات، والحفاظ على الثقة.

يعمل إطار الحوكمة القوي على تمكين الشركات من الإشراف على عمليات الذكاء الاصطناعي وإدارتها بكفاءة. فهو يضمن اتباع السياسات مع إبقاء التكاليف تحت السيطرة. يقلل هذا النهج من مخاطر إساءة استخدام الموارد ويواءم مبادرات الذكاء الاصطناعي مع أهداف المؤسسة والمتطلبات التنظيمية. ومن خلال إعطاء الأولوية للحوكمة، يمكن للمؤسسات تخفيف المخاطر مع تحقيق قدر أكبر من الكفاءة وتوفير التكاليف.