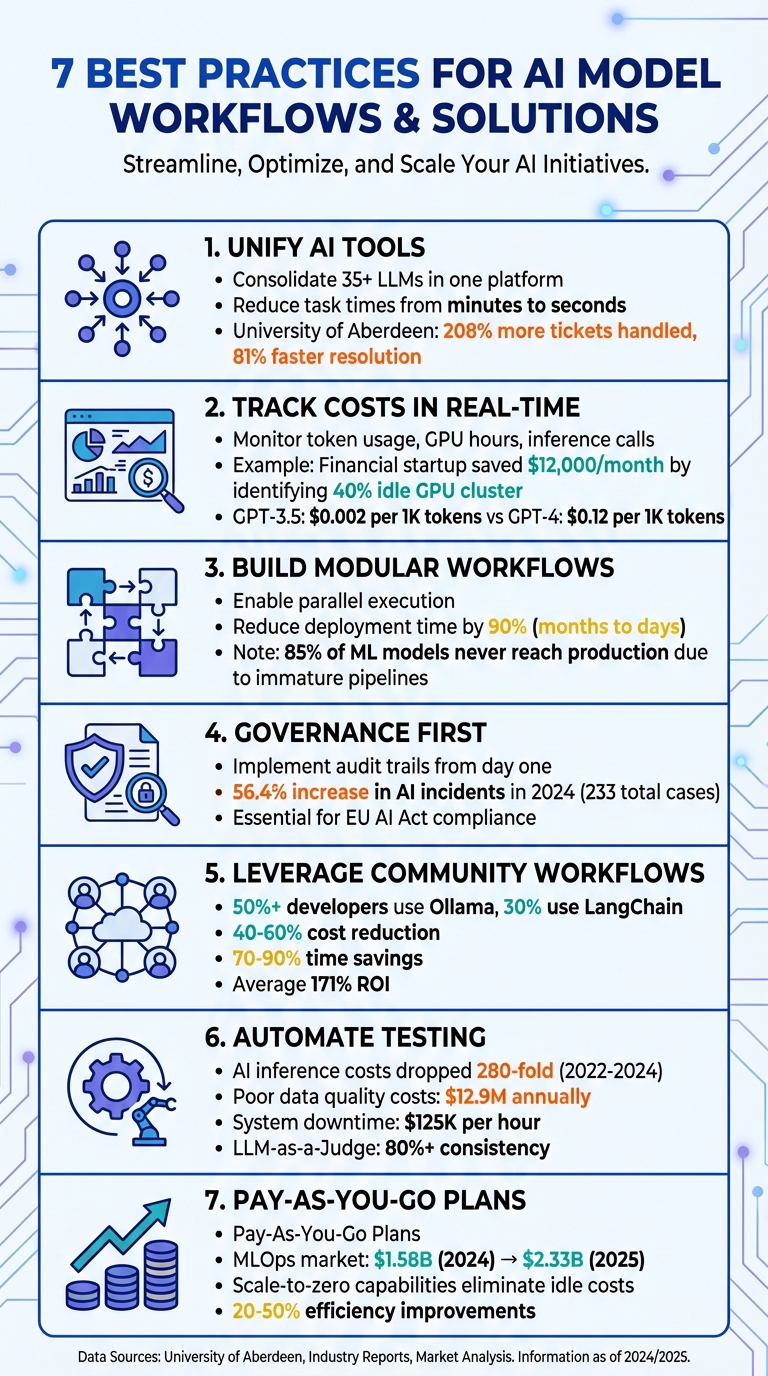

AI workflows in 2026 face challenges like fragmented tools, unchecked model drift, and escalating costs. To overcome these, organizations are adopting smarter, automated workflows that unify tools, improve governance, and optimize spending. Here’s how you can transform your AI operations:

تعمل هذه الممارسات على تبسيط سير العمل وتعزيز الرقابة وخفض التكاليف، مما يمكّن المؤسسات من توسيع نطاق الذكاء الاصطناعي بشكل مسؤول وفعال.

__XLATE_1__

يمكن أن تؤدي إدارة منصات منفصلة لنماذج مثل GPT-5 وClaude وLLaMA وGemini إلى إبطاء العمليات وإنشاء عقبات غير ضرورية. من خلال دمج أكثر من 35 ماجستيرًا في إدارة الأعمال في واجهة واحدة، يزيل Prompts.ai متاعب التوفيق بين عمليات تسجيل الدخول وبيانات الاعتماد المتعددة، مما يقلل أوقات المهام من دقائق إلى مجرد ثوانٍ.

ويؤدي هذا النوع من التكامل إلى تحقيق مكاسب إنتاجية قابلة للقياس. على سبيل المثال، عندما اعتمدت جامعة أبردين نظامًا مدعومًا بالذكاء الاصطناعي في سبتمبر 2025، تمكن فريق تكنولوجيا المعلومات لديها من التعامل مع المزيد من التذاكر بنسبة 208% مع تقليل أوقات الدقة بنسبة 81% [1]. تسلط مثل هذه النتائج الضوء على كيف يسمح النظام المبسط للفرق بالتركيز على النتائج بدلاً من إضاعة الوقت في إدارة الأدوات المجزأة. يمهد هذا النهج الطريق لسير عمل الذكاء الاصطناعي أكثر كفاءة وموثوقية وفعالية من حيث التكلفة.

الواجهة الموحدة لا توفر الوقت فحسب، بل تضمن قدرًا أكبر من الموثوقية والمرونة. ومع إمكانية الوصول إلى جميع النماذج من منصة واحدة، يمكن للفرق التبديل بسلاسة بين المحركات، والحفاظ على الاستمرارية حتى في حالة فشل نموذج واحد أو تقديم نتائج غير دقيقة. يمنع هذا الإعداد الاستباقي العمليات الهاربة، والتي يمكن أن تؤدي إلى ارتفاع تكاليف السحابة بشكل كبير عندما يتكرر الوكلاء الآليون بدون ضوابط مناسبة.

تتيح المنصة أيضًا اختبار الأداء جنبًا إلى جنب، حتى تتمكن من تقييم النموذج الذي يناسب مهام محددة بشكل أفضل. على سبيل المثال، قد يتم توجيه استعلامات دعم العملاء إلى ماجستير إدارة أعمال واحد، والمشاريع الإبداعية إلى أخرى، ومعالجة البيانات إلى ثالثة - تتم إدارة كل ذلك من نفس لوحة المعلومات. يضمن هذا التصميم غير المتوافق مع النموذج أنك غير مقيد بقيود أو أسعار بائع واحد، مما يمنحك الحرية في تحسين الأداء والتكاليف.

تنقل Prompts.ai إدارة التكلفة إلى المستوى التالي من خلال تقديم رؤى في الوقت الفعلي حول استخدام الرمز المميز عبر جميع النماذج. تساعد هذه الشفافية على منع تجاوزات الميزانية قبل حدوثها. تعمل طبقة FinOps المدمجة على تتبع الإنفاق على المستوى الفوري، مما يجعل من السهل تحديد مسارات العمل التي توفر القيمة والتي تستنزف الموارد. أبلغت المؤسسات التي تستخدم أتمتة سير العمل بالذكاء الاصطناعي عن عائد استثمار بنسبة 84% عندما تتمكن من ربط النفقات بنتائج الأعمال. على سبيل المثال، قامت Databricks بتخفيض تذاكر الدعم بنسبة 23% من خلال الفرز الذكي المدعوم بنماذج البيانات النظيفة وتتبع التكلفة الشفاف [1].

تعمل أرصدة TOKN للدفع عند الاستخدام الخاصة بالمنصة على مواءمة النفقات مع الاستخدام الفعلي، مما يلغي الحاجة إلى الدفع مقابل السعة غير المستخدمة. من خلال دمج التكاليف عبر نماذج متعددة، يمكن للفرق توفير ما يصل إلى 98% مقارنة بالحفاظ على اشتراكات منفصلة لكل أداة، مما يؤدي إلى تحقيق وفورات كبيرة عبر المشاريع والأقسام.

تعمل Prompts.ai أيضًا على تعزيز الحوكمة والامتثال، حيث تقدم مسارات تدقيق موحدة تدعم كلاً من المتطلبات التنظيمية وتحسينات سير العمل. تقوم المنصة بتصنيف المهام إلى مستويات مخاطرة، مما يضمن بقاء العمليات عالية المخاطر (مثل مهام المستوى 4 ذات الإمكانات الكارثية) تحت الإشراف البشري حتى تصبح أنظمة الذكاء الاصطناعي موثوقة تمامًا.

بفضل التشفير الشامل وضوابط الوصول الصارمة، تظل البيانات الحساسة محمية من التكوينات الخاطئة أو الانتهاكات. نظرًا لأن 78% من المؤسسات تستخدم الآن الذكاء الاصطناعي في مجال واحد على الأقل من أعمالها [2]، فإن Prompts.ai توفر أمانًا على مستوى المؤسسة مع الحفاظ على السرعة والمرونة التي تحتاجها فرق العمل للابتكار. كل تفاعل آمن وقابل للتتبع والتدقيق، مما يمنح المؤسسات الثقة لتوسيع نطاق الذكاء الاصطناعي بشكل مسؤول.

غالبًا ما تؤدي أعباء عمل الذكاء الاصطناعي إلى نفقات غير متوقعة لا يمكن فهمها بالكامل من خلال الفواتير الشهرية. تعمل FinOps في الوقت الفعلي على تغيير ذلك من خلال تقديم رؤى فورية حول التكاليف عند حدوثها. من خلال تتبع استخدام الرمز المميز، وساعات عمل وحدة معالجة الرسومات، واستدعاءات الاستدلال في الوقت الفعلي تقريبًا، يمكن للفرق تحديد تجاوزات الميزانية ومعالجتها قبل أن تخرج عن نطاق السيطرة.

على سبيل المثال، وجدت شركة ناشئة للتحليلات المالية أن 40% من مجموعتها المكونة من 8 وحدات معالجة رسومية ظلت في وضع الخمول، مما يهدر ما يقرب من 12000 دولار شهريًا. ومن خلال المراقبة في الوقت الفعلي، حدد الفريق عدم الكفاءة في منتصف السباق وأجرى تعديلات لتحسين السعة على الفور.

يعمل التتبع الدقيق حسب الفريق أو المشروع أو العميل على تحسين نماذج رد المبالغ المدفوعة. ومن خلال ربط بيانات التعريف مثل معرفات العملاء بطلبات واجهة برمجة التطبيقات، يصبح الإنفاق أكثر شفافية. وهذا يسمح للإدارات بالدفع فقط مقابل ما تستخدمه، مما يمهد الطريق لعمليات قابلة للتطوير وفعالة من حيث التكلفة.

Real-time tracking doesn’t just monitor costs - it actively supports smarter scaling decisions. Autoscaling can now factor in both performance metrics (like latency) and financial data (such as cost per prediction). For example, during traffic spikes, systems can throttle or reroute requests based on cost signals, ensuring resources are used efficiently.

__XLATE_13__

اعتمدت StreamForge AI هذه الإستراتيجية في سبتمبر 2025 من خلال دمج Kubecost مع Prometheus وعرض بيانات الاستخدام على لوحات معلومات Grafana التي يتم تحديثها كل خمس دقائق. وباستخدام نهج القياس التلقائي للإشارة المزدوجة - موازنة زمن الوصول p95 ومقاييس التكلفة لكل طلب - فقد عززوا بشكل كبير استخدام وحدة معالجة الرسومات وحسّنوا فعالية التكلفة لأكثر من 300 وظيفة تدريب يومية. يساعد هذا النهج في الوقت الفعلي على تجنب التكوينات الخاطئة المكلفة التي قد تستنزف الميزانيات الشهرية.

Centralizing cost tracking across multiple AI providers is essential when managing diverse models. A unified AI gateway simplifies this process by consolidating token usage, latency, and cost data into a single, reliable source. Whether you’re using OpenAI, Anthropic, or self-hosted models, this centralized system eliminates the need to piece together fragmented billing data.

يعد هذا المستوى من التكامل أمرًا بالغ الأهمية لأن النماذج المختلفة لها نقاط سعر مختلفة إلى حد كبير. على سبيل المثال، تبلغ تكلفة GPT-3.5-Turbo حوالي 0.002 دولار أمريكي لكل 1000 رمز مميز، بينما يمكن أن تصل تكلفة GPT-4 إلى 0.12 دولار أمريكي لكل 1000 رمز مميز اعتمادًا على نافذة السياق. يتيح التتبع في الوقت الفعلي للفرق مقارنة هذه التكاليف وتوجيه المهام إلى النموذج الأكثر اقتصادا. سواء كنت تتعامل مع استعلامات العملاء البسيطة أو التحليلات المعقدة، يتم تعيين المهام إلى النموذج الصحيح استنادًا إلى بيانات التكلفة المباشرة، مما يضمن بقاء سير العمل فعالاً وصديقًا للميزانية.

يؤدي تقسيم مسارات عمل الذكاء الاصطناعي إلى مكونات معيارية إلى إحداث ثورة في كيفية نشرها وتوسيع نطاقها. بدلاً من الاعتماد على خط أنابيب واحد وصلب للتعامل مع كل مرحلة، يسمح النهج المعياري بتحديث الأجزاء الفردية أو استبدالها دون تعطيل النظام بأكمله.

يتيح هذا التصميم أيضًا التنفيذ المتوازي، حيث يمكن تشغيل مهام متعددة في نفس الوقت. على سبيل المثال، يمكن لخدمة الترجمة متعددة اللغات معالجة إصدارات اللغات المختلفة في وقت واحد بدلاً من واحدة تلو الأخرى، مما يقلل وقت المعالجة بشكل كبير. يؤدي اعتماد ممارسات MLOps إلى زيادة سرعة النشر، مما يقلل الوقت اللازم لنقل النموذج إلى الإنتاج بنسبة تصل إلى 90%. يمكن لخطوط الأنابيب الآلية تقليص الجداول الزمنية للنشر من أشهر إلى أيام فقط.

ميزة أخرى هي إمكانية إعادة التشغيل. إذا واجهت خطوة معينة، مثل المعالجة اللاحقة، مشكلة، فيمكنك إعادة تشغيل تلك الوحدة فقط باستخدام العناصر المخزنة بدلاً من إعادة سير العمل بالكامل. يعمل أسلوب إعادة التشغيل المستهدف هذا على توفير الوقت والموارد، خاصة بالنسبة للمهام التي تتطلب قوة حسابية كبيرة. تعمل مسارات العمل المعيارية أيضًا على تسهيل توحيد المكونات ودمجها بشكل آمن عبر النظام.

بمجرد وضع الأساس المعياري، يصبح ضمان الاتصال السلس بين المكونات أمرًا ضروريًا. يساعد توحيد تنسيقات الإدخال والإخراج على تجنب الأخطاء المتتالية. على سبيل المثال، إذا قامت وحدة استيعاب البيانات بإخراج ملف JSON محدد بوضوح يتماشى تمامًا مع الإدخال المتوقع لوحدة الاستدلال، فسيتم التخلص من سوء الاتصالات المحتمل.

يؤدي فصل منطق الذكاء الاصطناعي عن منطق السياسة إلى تعزيز قابلية الصيانة. يتيح لك ذلك إدارة سلوك النموذج الديناميكي بشكل مستقل عن قواعد العمل الثابتة، كما هو موضح في إرشادات AWS الإرشادية. يمكن لأدوات مثل Docker أو Kubernetes وضع الوحدات في حاويات، مما يضمن بقائها قابلة للنقل عبر بيئات مختلفة. يمكن أن تعمل الوحدة النمطية الموجودة في حاوية بشكل متسق في التطوير والتشغيل والإنتاج، ويمكنها حتى الانتقال بين موفري الخدمات السحابية دون الحاجة إلى تغييرات. بالنسبة للتنسيق، توفر AWS Step Functions تنسيقًا بدون خادم مع عمليات إعادة المحاولة المضمنة، بينما يوفر Apache Airflow المرونة المستندة إلى Python لإدارة مسارات العمل الأكثر تعقيدًا.

تحقق التصميمات المعيارية أيضًا فوائد مالية من خلال السماح لك بتخصيص الموارد المناسبة لكل مهمة. يمكن الاحتفاظ بنماذج الاستدلال المعقدة، التي تستهلك الكثير من الموارد، للتحليلات الصعبة، في حين يتم التعامل مع المهام الأبسط بواسطة نماذج أقل تكلفة. وهذا يضمن استخدام الموارد الحسابية بحكمة.

يؤدي تتبع البيانات التعريفية على مستوى الوحدة إلى تحسين الشفافية. من خلال إرفاق تفاصيل مثل الطوابع الزمنية وإصدارات النماذج وبيانات التكلفة لكل قطعة أثرية أثناء تحركها عبر المسار، تحصل الفرق على مسار تدقيق واضح. ولا يساعد هذا في تصحيح الأخطاء فحسب، بل يساعد أيضًا في التتبع المالي. تسمح محاذاة التكاليف مع المقاييس الخاصة بالوحدة بوضع ميزانية دقيقة مع الحفاظ على المرونة. بالإضافة إلى ذلك، يمكن أن يساعد وضع حدود لأحجام الدُفعات والتزامن في منع النفقات غير المتوقعة أثناء فترات ارتفاع الطلب.

It’s worth noting that about 85% of machine-learning models never make it to production, often due to immature pipeline structures. Modular, iterative workflows offer a way to overcome this challenge. Teams can start small, validate one module at a time, and gradually scale up, reducing risks and ensuring systems are ready for production.

إن دمج الإدارة في سير عمل الذكاء الاصطناعي الخاص بك منذ البداية يوفر عليك من التعديلات المكلفة في المستقبل. ومن خلال الاعتماد على التقييمات الآلية والشفافية التي تمت مناقشتها سابقًا، يمكنك ضمان دمج الامتثال في عملياتك منذ البداية. بمجرد إنشاء نموذج أو حالة استخدام، قم بإنشاء تذكرة تتبع في أداة سير العمل الخاصة بك وتعيين مستوى المخاطر الأولي. تتطلب التطبيقات عالية المخاطر، مثل نظام التصنيف الائتماني أو أنظمة التوظيف، عمليات موافقة أكثر صرامة ومراقبة وثيقة مقارنة بالأدوات منخفضة المخاطر المستخدمة داخليًا. هذا "التحول إلى اليسار" الاستباقي. يبقيك هذا النهج مستعدًا للمتطلبات التنظيمية، خاصة مع أطر العمل مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي الذي يفرض توثيقًا تفصيليًا لعمليات التدريب والتقييم.

حجر الزاوية في الامتثال هو تتبع النسب، والذي يوفر مسارًا واضحًا وقابلاً للتكرار من البيانات الأولية إلى مخرجات النموذج النهائي. الجمع بين تتبع النسب مع إمكانية تتبع اللقطة، مما يضمن الحفاظ على الحالة الدقيقة للتعليمات البرمجية والبيانات والتكوينات الخاصة بك قبل النشر. يتيح لك ذلك إعادة إنتاج أي إصدار نموذجي حسب الحاجة. تسلط أبحاث الصناعة الضوء على مدى إلحاح هذه التدابير، مع الإشارة إلى زيادة بنسبة 56.4% في الحوادث المتعلقة بالذكاء الاصطناعي في عام 2024، بإجمالي 233 حالة - مما يؤكد الحاجة إلى مسارات تدقيق قوية.

تعمل مسارات التدقيق على تبسيط عملية استكشاف الأخطاء وإصلاحها عن طريق ربط الأخطاء مباشرة بأصولها. بدلاً من غربلة السجلات يدويًا، يمكن للمهندسين استخدام تتبع النسب لتحديد مكان انقطاع خط الأنابيب أو انخفاض جودة البيانات بسرعة. إن أتمتة مهام الحوكمة - مثل فحص الأصول وتقييم المخاطر - لا يضمن الامتثال فحسب، بل يحافظ أيضًا على تحرك مبادرات الذكاء الاصطناعي الخاصة بك بكفاءة أثناء نموها. من خلال أتمتة هذه الخطوات، يمكنك تقليل أوقات الموافقة والحفاظ على الاتساق عبر العمليات.

تعد إدارة البيانات القوية أمرًا ضروريًا للحفاظ على بيانات عالية الجودة. تعمل إدارة البيانات التعريفية المركزية على دمج المعلومات حول جميع أصول الذكاء الاصطناعي في مكان واحد، مما يؤدي إلى إزالة التكرار وضمان العمليات السلسة. عندما يتم تعقب كل مكون، بدءًا من المطالبات وحتى إصدارات النماذج، باستخدام الطوابع الزمنية وتفاصيل التكلفة، تحصل الفرق على فرصة تاريخ التنفيذ الشامل. وهذا يجعل خطوط الأنابيب أسهل في إعادة الإنتاج والتحسين. تعمل سجلات التدقيق التلقائية على تقليل الأخطاء البشرية، مما يؤدي إلى إنشاء سير عمل موثوق وقابل للتكرار.

تتكامل إستراتيجيات الحوكمة هذه بسلاسة مع مسارات العمل المعيارية، مما يضمن أن يظل الامتثال جزءًا أساسيًا من نظامك أثناء توسعه.

تربط طبقة الحوكمة الموحدة بين مسارات العمل المبسطة وشفافية التكلفة، مما يضمن الامتثال في جميع المجالات. تعمل العديد من الأنظمة - مثل Snowflake وDatabricks والأنظمة الأساسية السحابية والبيئات الطرفية - عبر أنظمة أساسية متعددة. وبدون اتباع نهج موحد للحوكمة، فإنك تخاطر بـ "الذكاء الاصطناعي الظلي"، حيث يتم نشر النماذج دون إشراف، مما يجعل التحقق من الامتثال مستحيلاً. إمكانية التتبع عبر الأنظمة يضمن التقاط بيانات وقت التشغيل عبر الاستعلامات ودفاتر الملاحظات والوظائف ولوحات المعلومات، مع الحفاظ على الامتثال أثناء نقل البيانات بين الأنظمة الأساسية. تعمل الواجهات القياسية، مثل بروتوكول السياق النموذجي (MCP) مع البوابات المركزية، على تمكين التسجيل المتسق وتتبع الطلبات عبر الخوادم والمستأجرين. ويمنحك هذا مسارًا كاملاً للتدقيق، بغض النظر عن مكان تنفيذ العمل.

قد يستغرق إنشاء مهام سير العمل من الألف إلى الياء وقتًا طويلاً وغير فعال. الأطر التي يحركها المجتمع مثل لانجشين و أولاما أصبحت الحلول المفضلة، حيث تقدم قوالب معدة مسبقًا لمطالبات التسلسل ودمج الأدوات. يتم اعتماد هذه الأطر على نطاق واسع، حيث يستخدم أكثر من 50% من المطورين شركة Ollama ويعتمد ثلثهم تقريبًا على LangChain لإدارة وكلاء الذكاء الاصطناعي. فهي تستبدل التعليمات البرمجية المخصصة الهشة بوظائف مرنة بدون خادم تعمل بشكل مستقل، مما يسهل إدارتها وتوسيع نطاقها.

الفائدة الرئيسية هي قابلية التوسع دون تعقيد. من خلال الاعتماد على الأنماط التي اختبرها المجتمع، يمكنك تبديل النماذج - مثل الانتقال من GPT إلى Amazon Bedrock - دون إصلاح منطق التوزيع الخاص بك. تعمل هذه المرونة على تسريع النشر مع الحفاظ على الاتساق. تظهر الأبحاث أنه على الرغم من أن التنسيق يمثل أولوية للعديد من المؤسسات، إلا أن القليل منها فقط هو الذي قام بتنفيذه بشكل كامل. توفر مسارات عمل المجتمع حلاً عمليًا، مما يتيح التكامل السلس عبر منصات الذكاء الاصطناعي المختلفة.

تعالج مسارات عمل المجتمع أيضًا التحدي المتمثل في دمج أدوات الذكاء الاصطناعي عبر الأنظمة الأساسية. معايير مثل بروتوكول السياق النموذجي (MCP) معالجة مسألة اتساع المنصة، التي تعتبر مصدر قلق 63% من المديرين التنفيذيين. تسمح هذه البروتوكولات لوكلاء وأدوات الذكاء الاصطناعي بالعمل معًا عبر الأنظمة الأساسية مثل Gmail وSlack وCRMs دون الحاجة إلى إدخال البيانات يدويًا. على سبيل المثال، طلب بسيط باللغة الطبيعية - مثل "تلخيص آخر 10 رسائل بريد إلكتروني من Gmail" - يمكن تشغيل المهام المنظمة من خلال اتصالات واجهة برمجة التطبيقات (API) التي تم تكوينها مسبقًا.

__XLATE_52__

تعد إمكانية التشغيل البيني أمرًا بالغ الأهمية، مع 87% من قادة تكنولوجيا المعلومات تحديدها باعتبارها ضرورية لاعتماد الأنظمة التي تعتمد على الذكاء الاصطناعي. تم تصميم سير عمل المجتمع مع أخذ المرونة في الاعتبار، حيث يقدم ميزات مثل إعادة المحاولة التلقائية، والمهلة، والتنفيذ المتوازي للتعامل مع حالات فشل النموذج المحتملة. وتعتبر هذه الضمانات حيوية، خاصة وأن 87% من المطورين يشعرون بالقلق بشأن دقة الذكاء الاصطناعي، و 81% يشعرون بالقلق إزاء الأمن والخصوصية. بالإضافة إلى تحسين التكامل، تساعد مسارات العمل هذه أيضًا على تقليل التكاليف بشكل كبير.

يمكن أن يؤدي استخدام قوالب المجتمع لتحويل مطالبات اللغة الطبيعية إلى سير عمل آلي إلى خفض التكاليف وتوفير الوقت بشكل كبير. تقرير المنظمات تخفيضات في التكاليف بنسبة 40-60% و توفير الوقت بنسبة 70-90% عندما يعتمدون أتمتة الذكاء الاصطناعي من خلال مسارات العمل هذه. إن البدء بالحلول المختبرة يلغي الحاجة إلى عمليات التجربة والخطأ المكلفة.

تعمل مسارات العمل هذه أيضًا على تعزيز الشفافية من خلال دمج مسارات التدقيق الموحدة وتتبع البيانات التعريفية. يقومون تلقائيًا بتسجيل التفاصيل مثل مصادر البيانات والأذونات وتاريخ قرارات الوكيل. تشمل العديد الإنسان في الحلقة نقاط تفتيش للمراجعة اليدوية للمهام الحساسة أو عالية التكلفة، مما يضمن المراقبة في الأماكن الأكثر أهمية. ومن خلال إدارة تكاليف الاستدلال أثناء التوسع، شهدت الشركات متوسطًا 171% عائد على الاستثمار عند الاستفادة من سير العمل الذي أنشأه المجتمع.

تُعد أتمتة الاختبار والتقييم هي القطعة الأخيرة في إنشاء دورة حياة سلسة للذكاء الاصطناعي. فهو يزيل التأخير الناتج عن الاختبار اليدوي، والذي غالبًا ما يمنع النماذج من الوصول إلى الإنتاج - يفشل 85% من النماذج في النشر بسبب عدم كفاءة العملية. من خلال الاستفادة من مسارات CI/CD/CT (التدريب المستمر) الآلية، تقلص أوقات النشر من أشهر إلى أيام فقط. يمكن لهذه المسارات إعادة تدريب النماذج تلقائيًا عندما تنخفض مقاييس الأداء إلى ما دون الحدود المحددة أو عندما تتوفر بيانات جديدة، مما يلغي الحاجة إلى الإشراف اليدوي المستمر.

الفوائد المالية واضحة. بين عامي 2022 و2024، انخفضت تكاليف استدلال الذكاء الاصطناعي بمقدار 280 ضعفًا، مما يجعل المراقبة المستمرة وإعادة التدريب خيارًا عمليًا. وتساعد خطوط الأنابيب الآلية أيضًا في اكتشاف المشكلات مبكرًا، مما يؤدي إلى تجنب الأخطاء المكلفة. على سبيل المثال، يمكن أن تكلف جودة البيانات الرديئة الشركات 12.9 مليون دولار سنويًا، في حين أن التوقف غير المخطط للنظام يمكن أن يصل إلى 125000 دولار في الساعة. تضمن خطوات التحقق من صحة البيانات التلقائية، مثل تحديد عدم تطابق المخطط أو القيم الخالية أو تحولات التوزيع، معالجة المشكلات في مرحلة العرض، مما يمنع حدوث مشكلات أكبر في المستقبل.

لا تعمل الأتمتة على تسريع سير العمل فحسب، بل تعمل أيضًا على تقليل النفقات غير الضرورية. تضمن خطوط الأنابيب ذاتية الضبط حدوث إعادة التدريب فقط عند الضرورة، مما يقلل من استخدام موارد وحدة معالجة الرسومات باهظة الثمن أثناء فترات الخمول. تعمل أدوات مثل LLM-as-a-Judge على تبسيط عمليات التقييم، وخفض التكاليف مع الحفاظ على الاتساق بنسبة تزيد عن 80% عبر آلاف الاختبارات.

يمكن لاستراتيجيات الاختبار تحسين الميزانيات بشكل أكبر. تتيح لك محاكاة الاختبارات باستخدام أدوات مثل Dev Proxy اختبار الضغط على نقاط النهاية دون تكبد رسوم لكل مكالمة. يساعد البدء بالنماذج الأصغر ومجموعات البيانات التمثيلية في التحقق من صحة الأفكار قبل الالتزام بالتقييمات واسعة النطاق. بالإضافة إلى ذلك، يوفر وضع علامات على الموارد السحابية حسب المشروع أو الفريق أو إصدار النموذج رؤى مفصلة للفوترة، مما يسهل تحديد مسارات العمل التي تستحق الاستثمار.

كما يعمل الاختبار الآلي على تعزيز الحوكمة من خلال إنشاء مسارات التدقيق التي يتطلبها المنظمون. تضمن بوابات الإدارة توقف سير العمل مؤقتًا حتى يتم التحقق من صحة الأصول المهمة - مثل المخططات والبيانات الأساسية. تخضع كل لقطة نموذجية لتقييم قياسي للمخاطر، مع تسجيل النتائج تلقائيًا وإصدار تذاكر بسبب الفشل للتتبع.

يمكن للأتمتة مراقبة ثلاثة أنواع رئيسية من الانجراف: انجراف البيانات (التحولات في توزيعات المدخلات)، انجراف الأداء (انخفاض في الدقة أو أوقات استجابة أبطأ)، و الانجراف السلامة (زيادة السمية أو التعرض للمعلومات الحساسة). Alerts flag these issues early, preventing them from affecting end users. بالإضافة إلى ذلك، تسمح مفاتيح التوقف للفرق بتعطيل المسارات أو الميزات النموذجية التي بها مشكلات بسرعة أثناء الحوادث، مما يوضح نهجًا عمليًا للحوكمة يضمن بقاء الأنظمة تحت السيطرة عندما يكون الأمر أكثر أهمية.

تعد خطط الدفع أولاً بأول طريقة ذكية لإدارة نفقات الذكاء الاصطناعي مع تمكين الفرق من النمو والتكيف دون عناء. تعتمد هذه الخطط على إستراتيجيات مثل تتبع التكلفة وقابلية التوسع المعيارية لضمان استخدام الموارد بكفاءة.

With pay-as-you-go pricing, you’re only charged for the tokens and compute time you actually use. Real-time dashboards provide insights into token consumption, latencies, and outcomes, helping to pinpoint inefficiencies and eliminate unnecessary spending. When combined with scale-to-zero capabilities, this model becomes even more effective - idle inference endpoints automatically shut down, so you’re not paying for unused GPU resources.

For tasks that aren’t time-sensitive, such as exploratory data analysis or offline model training, spot pricing offers a lower-cost alternative to on-demand rates. These savings add up, especially when paired with tools that track usage and performance in real time, allowing teams to fine-tune their compute needs and stay within budget.

Elastic compute ensures that your workflows can adapt to changing demands without manual adjustments. Features like autoscaling node pools and serverless architectures handle fluctuating workloads seamlessly, so there’s no need to overprovision resources for peak usage. By separating model artifacts from application code and using cloud storage, pods can start up almost instantly, making scaling operations faster and more efficient.

This approach is particularly valuable when transitioning from pilot projects to full-scale production. As the global MLOps market grows - expected to rise from $1.58 billion in 2024 to $2.33 billion by 2025 - organizations need scalable systems that won’t require constant rebuilding. Pay-as-you-go plans align costs with actual usage, making it easier to expand models, users, or teams without driving up expenses.

تعمل خطط الدفع أولاً بأول جنبًا إلى جنب مع أدوات الفريق المتقدمة لتبسيط إدارة التكلفة وسير العمل التشغيلي. Modern tools integrate governance, audit trails, and security features like single sign-on (SSO) and role-based access control (RBAC) directly into the orchestration layer. تعتبر هذه القدرات ضرورية لتلبية متطلبات الامتثال مثل SOC 2 أو ISO 27001.

تسمح الأنظمة الأساسية التي تقدم الدعم لواجهات برمجة التطبيقات المتوافقة مع OpenAI للفرق بالتبديل بين موفري أو نماذج LLM دون إصلاح سير العمل، مما يضمن المرونة مع ظهور تقنيات جديدة. تعمل البيئات المُدارة على تحسين عمليات الفريق من خلال دمج ميزات مثل الأذونات واتفاقيات مستوى الخدمة وتتبع بيانات التعريف المركزية وضوابط الترخيص. لا تتوسع هذه الأنظمة جنبًا إلى جنب مع مؤسستك فحسب، بل تحافظ أيضًا على الشفافية والتحكم اللازمين للوفاء بالمعايير التنظيمية، مما يضمن حصول كل عضو في الفريق على حق الوصول الصحيح وتسجيل كل إجراء للتدقيق.

يتطلب بناء مسارات عمل فعالة للذكاء الاصطناعي نماذج قوية مقترنة بنهج منظم وقابل للتطوير. تساعد الممارسات السبع التي تمت مناقشتها سابقًا في تحويل مبادرات الذكاء الاصطناعي المفككة إلى عمليات مبسطة وجاهزة للمؤسسات. من خلال دمج درجات LLM المتنوعة، والحفاظ على المراقبة المستمرة للتكاليف، والاستفادة من التصميمات المعيارية، يمكنك إزالة الاختناقات وإنشاء سير عمل يتطور جنبًا إلى جنب مع احتياجاتك. إن البدء بالحوكمة يضمن أن يكون كل قرار يتعلق بالذكاء الاصطناعي قابلاً للتتبع ومتوافقًا، بينما تعمل المطالبات التي يحركها المجتمع ودورات الاختبار الآلية على تسريع عملية التطوير دون المساس بالجودة. تشكل هذه الاستراتيجيات العمود الفقري لعمليات الذكاء الاصطناعي الفعالة والموثوقة.

كما تم توضيحه سابقًا، يمكن لهذه الأساليب تحسين الكفاءة بنسبة 20% إلى 50% عبر سير العمل مثل الإعداد وإدارة الحوادث. يعمل تتبع التكلفة في الوقت الفعلي، مقترنًا بنماذج الدفع أولاً بأول، على الحفاظ على توافق النفقات مع الاستخدام، وتجنب تجاوز الميزانية مع دعم التوسع السلس. من خلال دمج الأتمتة وحلقات التغذية الراجعة، يمكن لأنظمة الذكاء الاصطناعي التحسين الذاتي، وتحديد الحالات الشاذة، واقتراح التحسينات، وإدارة المهام المعقدة بشكل مستقل.

ويؤكد التحرك نحو الحوكمة المتكاملة والبنيات التكيفية على أهمية بناء سير العمل على أسس متينة. تضمن الأدوات القياسية وحدود المكونات الواضحة والتتبعات التفصيلية بقاء أنظمتك مرنة مع ظهور نماذج وقدرات جديدة. من خلال التركيز على العمليات القابلة للتوسع والتكرار، يمكنك الانتقال من المشاريع التجريبية إلى الإنتاج واسع النطاق دون إصلاحات مستمرة.

تعمل هذه الاستراتيجيات معًا على تحويل التجارب المجزأة إلى سير عمل فعال وخاضع للمساءلة ومراعي للتكلفة. هل أنت مستعد للتحكم في سير عمل الذكاء الاصطناعي لديك؟ باستخدام Prompts.ai، يمكنك تأمين نماذجك وإدارة التكاليف والتوسع دون عناء. يمكنك الوصول إلى أكثر من 35 نموذجًا متميزًا، واستخدام عناصر تحكم FinOps المضمنة، وتنفيذ الحوكمة على مستوى المؤسسة - كل ذلك من خلال واجهة واحدة. تقضي Prompts.ai على انتشار الأدوات، وتضمن الامتثال، وتتيح لفريقك التركيز على الابتكار، وتحويل فوضى الذكاء الاصطناعي إلى عملية مبسطة تعتمد على عائد الاستثمار.

لاختيار نموذج اللغة الكبيرة الأكثر ملاءمة (LLM)، ابدأ بتحديد احتياجاتك المحددة بوضوح - سواء كانت تتعلق بالكتابة أو البرمجة أو دعم العملاء أو أي تطبيق آخر. قم بتقييم النماذج باستخدام نهج منظم يأخذ في الاعتبار عوامل مثل الأداء والتكلفة والخصوصية. بالنسبة للمهام ذات الحد الأدنى من المخاطر، قم بإعطاء الأولوية للنماذج الأسرع والأكثر ملائمة للميزانية. ومن ناحية أخرى، تتطلب المهام عالية المخاطر نماذج أكثر موثوقية وتتضمن إشرافًا مناسبًا. تعد المقارنة المعيارية خطوة حاسمة للتأكد من أن النموذج المختار يلبي متطلبات المهمة والأهداف التشغيلية.

لإبقاء تكاليف الذكاء الاصطناعي تحت السيطرة، من الضروري مراقبتها استخدام الرمز المميز كما يحدث. يتضمن ذلك تتبع الطلبات والمطالبات واستدعاءات النماذج. من خلال البقاء على اطلاع بهذه المقاييس، يمكنك اكتشاف أوجه القصور وإجراء تعديلات لتحسين استخدام الموارد، والحفاظ على التوازن بين التكلفة والأداء.

للبقاء في صدارة انجراف النماذج، قم بإعداد أنظمة مراقبة آلية تراقب عن كثب مقاييس الأداء وجودة البيانات في الوقت الفعلي. يمكن لهذه الأدوات اكتشاف التحولات مثل انحراف المفهوم، أو التحول المتغير، أو انجراف التسمية من خلال فحص التغييرات في توزيع البيانات ودقة التنبؤ. عند اكتشاف الانحراف، يمكن لمشغلات إعادة التدريب المحددة مسبقًا أن تعمل على تحديث النماذج الخاصة بك بسرعة، مع الحفاظ على التحقق المتسق والتكامل السلس داخل عمليات MLOps الخاصة بك.