تعمل منصات سير عمل الذكاء الاصطناعي في عام 2026 على إعادة تشكيل كيفية عمل الشركات، والانتقال من أتمتة المهام البسيطة إلى أنظمة أكثر ذكاءً تعتمد على القرار ومدعومة بنماذج لغوية كبيرة (LLMs). تعمل هذه الأدوات على تبسيط العمليات، وخفض التكاليف، والتكامل بسلاسة مع الأنظمة البيئية التقنية الحالية، مما يحل التحديات مثل انتشار الأدوات وعدم التوافق. فيما يلي أهم المنصات التي تقود هذا التحول:

تلبي هذه المنصات الاحتياجات الحيوية مثل كفاءة التكلفة وقابلية التوسع والحوكمة، مما يجعلها أدوات أساسية للشركات التي تتنقل في المستقبل القائم على الذكاء الاصطناعي.

تجمع Prompts.ai أكثر من 35 نموذجًا لغويًا كبيرًا (LLMs) - مثل GPT-5 وClaude وLLaMA وGemini وGrok-4 وFlux Pro - في منصة واحدة وآمنة. وهذا يزيل متاعب التوفيق بين الاشتراكات المتعددة وتسجيلات الدخول وأنظمة الفوترة. وإليك كيف تعمل ميزاته على تبسيط سير عمل الذكاء الاصطناعي وتحسين الإنتاجية.

Prompts.ai’s design allows users to switch between models effortlessly without reconfiguring workflows or managing separate API keys. This means you can directly compare GPT-5’s strengths to those of Claude or Gemini, then direct production tasks to the model that fits your needs best. Each model has unique strengths - some excel in creative tasks, while others are better suited for data analysis or coding. This flexibility ensures you always have the right tool for the job.

بالإضافة إلى إمكانات التكامل، تساعد Prompts.ai على تقليل التكاليف من خلال نموذج الفوترة المباشر والمبني على الاستخدام. من خلال تنفيذ نظام تتبع موحد لاستخدام الرمز المميز، توفر المنصة أرصدة TOKN للدفع أولاً بأول، مما يلغي الحاجة إلى الرسوم المتكررة. قامت العديد من المؤسسات بتخفيض نفقات برامج الذكاء الاصطناعي الخاصة بها بنسبة تصل إلى 98% من خلال دمج أدوات متعددة في هذه المنصة الواحدة الشفافة.

Prompts.ai adapts to the needs of individuals, teams, and enterprises alike. Plans start at $29 per month for individual users, while enterprise plans range from $99 to $129 per member. There’s even a $99 Family Plan, recognizing that AI automation is increasingly valuable for both personal and professional use. This scalability ensures that users only pay for what they need, whether they’re automating workflows for a small team or an entire organization.

بالنسبة للعمليات المتنامية، تعد الإدارة الآمنة أولوية قصوى. تم تصميم Prompts.ai بميزات على مستوى المؤسسات، مما يوفر مسار تدقيق لكل تفاعل للذكاء الاصطناعي لدعم احتياجات الامتثال. تبقى البيانات الحساسة داخل المؤسسة، مع تجنب التعرض لها عبر خدمات خارجية متعددة. تمنح لوحات المعلومات في الوقت الفعلي للمسؤولين رؤية واضحة للإنفاق والتحكم في الوصول والقدرة على ربط تكاليف الذكاء الاصطناعي مباشرةً بنتائج الأعمال. تعتبر هذه الأدوات ضرورية للحفاظ على الشفافية والتحكم في العمليات التي تعتمد على الذكاء الاصطناعي.

يتبع Vellum AI نهجًا مختلفًا من خلال التركيز على تنسيق سير العمل الأصلي للذكاء الاصطناعي بدلاً من مجرد أتمتة المهام الفردية. فهو يسمح للمستخدمين بوصف العملية بلغة واضحة، ويقوم النظام تلقائيًا بإنشاء بنية سير العمل - مما يلغي الحاجة إلى إعداد العقدة يدويًا. تعمل ميزة "المطالبة بالإنشاء" هذه على توفير وقت كبير، خاصة للفرق التي تقوم بتجربة مفاهيم الوكلاء المتعددة.

بفضل تصميمه الذي لا يعتمد على النموذج، يتيح Vellum التبديل السلس بين دورات LLM لتحقيق التوازن بين التكلفة والسرعة والجودة دون الحاجة إلى إعادة بناء سير العمل بشكل كامل. تدعم المنصة ميزات متقدمة مثل توليد الاسترجاع المعزز (RAG)، والتوجيه الدلالي، وتنسيق الوكيل متعدد الخطوات. فهو يسمح للمستخدمين بتسلسل المطالبات، بحيث يصبح الناتج من نموذج واحد مدخلاً لنموذج آخر، مما يتيح مسارات التفكير المعقدة. تسهل أدوات الإصدار والتقييم المضمنة اختبار الاختلافات السريعة وتحسينها.

تم تصميم Vellum للجمع بين الفرق الفنية وغير الفنية معًا. يمكن لمديري المنتجات وموظفي العمليات استخدام المنشئ المرئي لإنشاء وكلاء، بينما يمكن للمهندسين تحسين سير العمل باستخدام المنطق المخصص مع TypeScript أو Python SDK. على سبيل المثال، استخدمت RelyHealth برنامج Vellum لنشر مئات من وكلاء الرعاية الصحية المخصصين، مما أدى إلى تقليل الجدول الزمني لنشرهم بمقدار 100 مرة. شارك ماكس بريان، نائب الرئيس للتكنولوجيا والتصميم:

__XLATE_8__

لقد قمنا بتسريع الجدول الزمني لمدة 9 أشهر بمقدار 2x وحققنا دقة مضادة للرصاص باستخدام مساعدنا الافتراضي. لقد كان Vellum فعالاً في جعل بياناتنا قابلة للتنفيذ وموثوقة.

The platform’s strong governance features ensure that rapid deployment doesn’t compromise security.

يوفر Vellum أمانًا على مستوى المؤسسات من خلال التحكم في الوصول المستند إلى الأدوار (RBAC)، وتكامل SSO/SAML، وسجلات التدقيق غير القابلة للتغيير التي تتعقب كل مطالبة ومخرجات. وهو يتوافق مع معايير SOC 2، وGDPR، وHIPAA، وISO 27001. تتضمن خيارات النشر السحابة العامة، وVPC الخاصة، والإعدادات المحلية، وحتى البيئات المعزولة للصناعات ذات اللوائح الصارمة. تسمح بوابات الموافقة البشرية في الحلقة بإيقاف الإجراءات الحساسة مؤقتًا للمراجعة، مما يضمن المساءلة. ومن الجدير بالذكر أن 78% من قادة العمليات يشيرون إلى أدوات التوضيح وتصحيح الأخطاء كعوامل حاسمة في قرارات الشراء الخاصة بهم.

يبدأ السعر من 25 دولارًا أمريكيًا شهريًا لخطة Pro، و79 دولارًا أمريكيًا شهريًا لخطط الأعمال، وتسعير Enterprise المخصص للحصول على أرصدة غير محدودة ودعم مخصص.

يربط Zapier مهام الذكاء الاصطناعي عبر أكثر من 8000 تطبيق، ويتعامل مع أكثر من 23 مليون مهمة ذكاء اصطناعي شهريًا لأكثر من مليون شركة. يمكن للمستخدمين الاختيار من بين موفري LLM مثل GPT وAnthropic وGemini وAzure OpenAI، أو اختيار الخيارات المجانية المضمنة مثل GPT-4o mini وGemini 2.0 Flash. ومن خلال استبدال مسارات العمل الثابتة بعملية صنع القرار الديناميكية المستندة إلى الذكاء الاصطناعي، يقدم Zapier تجربة أتمتة أكثر تكيفًا.

تعمل ميزة وكلاء Zapier في Zaps على تمكين الذكاء الاصطناعي من اتخاذ قرارات بشأن كيفية تحقيق الأهداف بشكل مستقل، والانتقال إلى ما هو أبعد من سير العمل الصارم. يمكن لهؤلاء الوكلاء أداء مهام مثل عمليات البحث على الويب، وصياغة الرسائل، وتحديث قواعد البيانات دون تدخل يدوي. يدعم النظام الأساسي أيضًا معالجة الصور والصوت والفيديو مباشرةً ضمن سير العمل. باستخدام موصل Model context Protocol (MCP)، يمكن للمطورين دمج أدوات الذكاء الاصطناعي الخارجية بسلاسة في نظام Zapier البيئي الذي يضم أكثر من 8000 تطبيق دون الحاجة إلى إعدادات واجهة برمجة التطبيقات المعقدة. لمزيد من التحكم، تسمح خطوات الموافقة البشرية - مثل المراجعات المستندة إلى Slack - للفرق بالتحقق من الإجراءات التي تم إنشاؤها بواسطة الذكاء الاصطناعي قبل الانتهاء منها، مما يعزز الدقة والثقة في الأتمتة.

يوضح Zapier قيمته في توسيع نطاق العمليات من خلال تطبيقات العالم الحقيقي. على سبيل المثال:

تسلط هذه الأمثلة الضوء على كيف يمكن لأتمتة الذكاء الاصطناعي أن تعزز الكفاءة والتأثير المالي عبر مختلف الصناعات.

__XLATE_16__

"يجعل زابير فريقنا المكون من ثلاثة أفراد يبدو وكأنه فريق مكون من عشرة أفراد." - ماركوس سايتو، رئيس قسم تكنولوجيا المعلومات وأتمتة الذكاء الاصطناعي عن بعد

تلتزم Zapier بمعايير SOC 2 Type II وGDPR وGDPR UK وCCPA، مع ضمانات لضمان عدم استخدام نماذج الذكاء الاصطناعي التابعة لجهات خارجية لبيانات العميل للتدريب. توفر المنصة أدوات حوكمة مركزية مثل Domain Capture لرؤية الاستخدام الكامل، وعناصر التحكم في التطبيق لتقييد عمليات تكامل الذكاء الاصطناعي المحددة، والأذونات التفصيلية على مستويات الفريق والتطبيق والبيانات. تشتمل إجراءات الأمان على Enterprise SSO (SAML 2.0) وSCIM والمصادقة الثنائية والقائمة المسموح بها لـ IP ونظير VPC للاتصال الداخلي الآمن. تتم حماية البيانات باستخدام بروتوكولات التشفير والنقل عالية المستوى، مما يضمن الشفافية في تغييرات سير العمل. يبدأ السعر من 19.99 دولارًا أمريكيًا شهريًا للخطط الاحترافية، و69 دولارًا أمريكيًا شهريًا لخطط الفريق، مع خيارات تسعير مخصصة متاحة لخطط المؤسسات التي تتضمن عدد غير محدود من المستخدمين.

يمكنك إجراء اتصالات بين أكثر من 3000 تطبيق باستخدام لوحة مرئية تعرض سير عمل الأتمتة لديك. على عكس الأدوات الخطية التقليدية، يستخدم Make الأتمتة القائمة على السيناريو، والتي تتضمن منطق التفرع، والمرشحات، وسير العمل المرن متعدد المسارات. إن منشئه المرئي ماهر بشكل خاص في التعامل مع تحويلات البيانات، وذلك بفضل ميزات مثل التكرارات والمجمعات. وهذا يجعله خيارًا قويًا لمعالجة كميات كبيرة من البيانات دون الحاجة إلى مهارات البرمجة.

يوفر Make وحدات أصلية للأدوات الشائعة مثل OpenAI (ChatGPT وDALL-E وWhisper) وGoogle Gemini، بينما يدعم أيضًا أي نموذج متوافق مع OpenAI من خلال وحدة HTTP الخاصة به. في عام 2026، قدمت المنصة Make AI Agents - وهي عمليات أتمتة موجهة نحو الأهداف تختار الأدوات بشكل مستقل لتحقيق أهداف محددة. يستفيد هؤلاء الوكلاء من سيناريوهات Make الحالية للتعامل مع المهام دون تدخل يدوي. بالإضافة إلى ذلك، يعمل Make كخادم بروتوكول سياق النموذج (MCP)، مما يسمح لنماذج الذكاء الاصطناعي الخارجية، مثل Claude، بتنفيذ سيناريوهات Make بشكل آمن كأدوات لمهام العالم الحقيقي.

وبالنظر إلى المستقبل، سيمكن مساعد Make Maia المستخدمين من إنشاء مسارات عمل معقدة ببساطة عن طريق وصفها باللغة الطبيعية. ستسمح هذه الميزة بإنشاء عمليات التشغيل الآلي عن طريق المحادثة، مما يقلل الحاجة إلى التكوين العملي وتبسيط العملية للمستخدمين.

يستخدم Make نموذج تسعير قائم على العمليات، حيث يتم فرض رسوم على كل تنفيذ للوحدة بدلاً من كل سير عمل مكتمل. تتضمن الخطة المجانية 1000 عملية شهريًا وسيناريوهين نشطين. تبدأ الخطط المدفوعة بسعر 9 دولارات شهريًا للخطة الأساسية (10000 عملية، وسيناريوهات غير محدودة)، و16 دولارًا شهريًا لـ Pro (الذي يضيف دعمًا ذا أولوية)، و29 دولارًا شهريًا لـ Teams (يتميز بقدرات المستخدمين المتعددين). يمكن شراء عمليات إضافية بحوالي 1 دولار لكل 1000 عملية. يمكن أن يكون هذا النموذج اقتصاديًا للغاية بالنسبة لعمليات سير العمل المعقدة ذات المنطق المتفرع، حيث أنك تدفع فقط مقابل الوحدات التي يتم تشغيلها. ومع ذلك، قد تستهلك خطوات الذكاء الاصطناعي أرصدة متعددة لكل عملية تنفيذ، اعتمادًا على مدى تعقيدها.

Make’s pricing model and operational framework support scalability, from simple automations to enterprise-level workflows. The platform ensures data integrity with ACID transactions and offers tools for bulk data processing. It boasts a 99.9% infrastructure availability rate and average response times under 200ms for standard integrations. Examples of its scalability in action include:

__XLATE_23__

قال رئيس العمليات في Teleclinic: "لقد ساعدنا برنامج Make حقًا على توسيع نطاق عملياتنا، والتخلص من الاحتكاك في عملياتنا، وخفض التكاليف، وإراحة فريق الدعم لدينا."

__XLATE_25__

لاحظ المدير التنفيذي للعمليات في Shop Accelerator Martech قائلاً: "اجعل محركات الأقراص تتسم بكفاءة غير مسبوقة في أعمالنا بطرق لم نتخيلها أبدًا. إنها الحصول على موظف إضافي (أو 10) مقابل جزء بسيط من التكلفة."

The upcoming Make Grid feature, set to launch in 2026, will act as a "Command Center", providing a visual overview of an organization’s entire automation ecosystem. This tool will help teams identify bottlenecks and monitor workflow performance in real time.

Make adheres to SOC 2 Type II, GDPR, and SCIM standards, offering Single Sign-On (SSO) and a secure connection manager that stores API keys securely instead of embedding them directly in workflows. The "Scenario Run Replay" feature allows users to replay failed executions with the original data, speeding up troubleshooting processes. Enterprise plans include advanced governance options and dedicated support, though some users have noted that the platform’s role-based access control (RBAC) is less detailed compared to other enterprise solutions. To minimize risks, critical modules should include manual error-handling configurations to prevent silent data loss during API disruptions. For organizations with strict compliance needs, redirecting execution data to an external logging service may be advisable, as Make’s native logs are retained only for a limited time based on the plan.

تبرز n8n كمنصة مصممة مع وضع المطورين في الاعتبار، حيث تقدم خيارات الاستضافة السحابية والاستضافة الذاتية. وهو يعمل على نموذج تسعير قائم على التنفيذ، حيث يساوي تشغيل سير عمل واحد تنفيذًا واحدًا، بغض النظر عن عدد الخطوات التي يتضمنها. وهذا يجعله خيارًا عمليًا لإدارة سير عمل الذكاء الاصطناعي المعقد ومتعدد الخطوات دون التكاليف المرتفعة المرتبطة غالبًا بالتسعير القائم على المهام.

يوفر n8n تكامل LangChain الأصلي، مما يمكّن المستخدمين من إنشاء أنظمة ذكاء اصطناعي متقدمة متعددة الوكلاء وخطوط أنابيب RAG (جيل الاسترجاع المعزز) مباشرة داخل محرره المرئي. باستخدام AI Agent Node، يمكن تحويل LLMs القياسي إلى وكلاء موجهين نحو الأهداف وقادرين على استخدام الأدوات واتخاذ القرارات والاحتفاظ بالذاكرة عبر مسارات العمل المعقدة. تدعم المنصة مجموعة من برامج LLM، بما في ذلك OpenAI وAnthropic (Claude) وGoogle Gemini وDeepSeek وGroq وHugging Face، جنبًا إلى جنب مع عمليات تكامل قواعد البيانات المتجهة مثل pgvector وPinecone وChroma وQdrant وWeaviate. يمكن لـ AI Workflow Builder الخاص به تحويل أوصاف اللغة الطبيعية إلى مهام سير عمل وظيفية تلقائيًا. ومن خلال تسلسل طلبات الذكاء الاصطناعي واستخدام نماذج أرخص للخطوات المتوسطة، يمكن للمستخدمين خفض تكاليف واجهة برمجة التطبيقات بنسبة 30-50%.

n8n’s execution-based pricing ensures affordability for even the most complex workflows. Technical users can access the self-hosted Community Edition for free, with unlimited workflows and executions. For cloud-hosted options, the Cloud Starter plan begins at $20/month for 2,500 executions, while Cloud Pro offers 10,000 executions for $50/month. For businesses, the self-hosted Business plan costs $800/month, offering advanced features, while Enterprise pricing is customized for organizations requiring features like advanced RBAC, SSO, and dedicated support. By charging per workflow execution instead of per step, n8n can save organizations over $500 per month on high-volume workflows compared to task-based pricing models.

n8n is built to handle up to 220 workflow executions per second per instance. Its Queue Mode leverages Redis to distribute execution across multiple worker processes, enabling horizontal scaling to meet increasing demands for fast and efficient AI workflows. For instance, in 2025, Dennis Zahrt, Director of Global IT Service Delivery at Delivery Hero, implemented a user management workflow that saved the company 200 hours each month. Similarly, Luka Pilic, Marketplace Tech Lead at StepStone, reported a dramatic improvement in efficiency, completing two weeks’ worth of API integration and data transformation work in just two hours.

__XLATE_29__

"يستغرق الأمر ساعتين كحد أقصى لتوصيل واجهات برمجة التطبيقات وتحويل البيانات التي نحتاجها. لا يمكنك القيام بذلك بهذه السرعة في التعليمات البرمجية." - لوكا بيليتش، قائد التكنولوجيا في Marketplace، StepStone

يعطي n8n الأولوية للأمان من خلال التكامل مع مديري السرية الخارجيين مثل AWS Secrets Manager وAzure Key Vault وGoogle Cloud Platform وHashiCorp Vault وInfisical، مما يضمن بقاء بيانات الاعتماد الحساسة خارج النظام الأساسي. بالنسبة للمستخدمين الذين يختارون الاستضافة الذاتية عبر Docker أو Kubernetes، تظل جميع بيانات سير العمل وبيانات الاعتماد والسجلات داخل جدار الحماية الخاص بهم، مما يدعم الامتثال للوائح مثل HIPAA وGDPR وSOC 2. ويستفيد مستخدمو المؤسسات من RBAC المتقدم من خلال "المشاريع"، التي تقيد الوصول إلى سير عمل وبيانات اعتماد محددة بناءً على الأدوار. بالإضافة إلى ذلك، يسمح التحكم بالمصدر المستند إلى Git بالحركة الآمنة لسير العمل بين بيئات التطوير والتجهيز والإنتاج.

Gumloop عبارة عن منصة مصممة خصيصًا لمساعدة الفرق على الاستفادة من نماذج اللغات الكبيرة (LLMs) بسهولة. في قلب هذا النظام يوجد Gummie، وهو مساعد الذكاء الاصطناعي الذي يحول تعليمات اللغة الطبيعية إلى سير عمل يعمل بكامل طاقته. وقد أثبتت هذه القدرة أنها لا تقدر بثمن بالنسبة للمنظمات. قال فيدجي سيمو، الرئيس التنفيذي لشركة Instacart، "لقد كان Gumloop حاسمًا في مساعدة جميع الفرق في Instacart - بما في ذلك أولئك الذين ليس لديهم مهارات تقنية - في اعتماد الذكاء الاصطناعي وأتمتة سير العمل، مما أدى إلى تحسين كفاءتنا التشغيلية بشكل كبير."

Gumloop supports model-agnostic workflows, allowing users to switch seamlessly between models like GPT-4o, Claude 3.7 Sonnet, Deepseek V3 R1, and Gemini 2.5 Pro within a single automation. Unlike many platforms that require users to manage API keys separately, Gumloop simplifies the process by including LLM costs in its subscription plans. The AI Router node intelligently assigns tasks to the right models, while the Model Context Protocol (MCP) server enables connections to custom APIs, extending the platform’s capabilities beyond its 125+ built-in nodes. This setup ensures predictable pricing and smooth integration.

Gumloop’s pricing structure is designed for flexibility and clarity:

من خلال تجميع تكاليف LLM API في خطط الاشتراك الخاصة بها بدلاً من فرض رسوم على كل مهمة، تعمل Gumloop على تبسيط الميزانية، مما يسهل على المؤسسات توسيع نطاق سير عمل الذكاء الاصطناعي الخاص بها دون نفقات غير متوقعة.

Gumloop’s structure is designed to grow alongside organizations of any size. It uses a hierarchical approach, with Organizations providing centralized control and Workspaces enabling collaboration across departments like Sales, Marketing, and Operations. The platform also supports agentic workflows, where AI agents can assess tasks dynamically and trigger workflows based on context instead of following rigid sequences. Bryant Chou of Webflow remarked, "Gumloop wins time back across an org. It puts the tools into the hands of people who understand a task and lets them completely automate it away." Additionally, the platform’s ability to auto-scale and execute workflows in parallel ensures it can handle the demands of enterprise operations.

يعطي Gumloop الأولوية للأمن والامتثال لتلبية الاحتياجات التنظيمية. وهو يلتزم بمعايير SOC 2 واللائحة العامة لحماية البيانات ويتضمن أدوات للتحكم على مستوى المؤسسة. يمكن للمسؤولين فرض قوائم السماح/الرفض لنموذج الذكاء الاصطناعي، مما يضمن الامتثال للوائح مثل HIPAA عن طريق تقييد نماذج أو موفري خدمات معينين. يعمل وضع التصفح المتخفي على تحسين الخصوصية من خلال مسح جميع المدخلات والمخرجات والوسائط في الوقت الفعلي. يتم دعم سياسات الأمان المركزية أيضًا من خلال بيانات الاعتماد على مستوى المؤسسة، والتي تتجاوز المفاتيح الشخصية أو مفاتيح مساحة العمل لمنع الوصول غير المصرح به. بالنسبة للمؤسسات التي تتطلب أقصى قدر من الأمان، تسمح عمليات نشر VPC لـ Gumloop بالعمل ضمن البنية التحتية السحابية الخاصة بها. يقوم تسجيل التدقيق الشامل بتتبع كل إجراء على النظام الأساسي، مما يوفر عرضًا شفافًا لتدفق البيانات والتغييرات الإدارية إما من خلال لوحة المعلومات أو واجهة برمجة التطبيقات.

تبرز Lindy.ai في مشهد الأتمتة من خلال إنشاء عملاء ذكاء اصطناعي يفكرون ويتكيفون بدلاً من اتباع نصوص برمجية جامدة محددة مسبقًا. ومن خلال نهج "التشفير الديناميكي" المبتكر، يمكن للمستخدمين وصف سلوك الوكيل باللغة الإنجليزية البسيطة، وتقوم المنصة بتحويل ذلك بسرعة إلى حل جاهز للإنتاج - أحيانًا في أقل من 5 دقائق. يتيح ذلك للشركات تقليل المهام المتكررة من خلال نشر وكلاء مجهزين بالذاكرة والقدرة على التكيف.

تستفيد المنصة من GPT وClaude لتزويد الوكلاء القادرين على تحليل النص وإنشاء المخرجات وفهم نية المستخدم. على عكس أدوات الأتمتة التقليدية التي تتعثر عند مواجهة سياقات متغيرة، يستخدم وكلاء Lindy.ai الذاكرة للتنقل في السيناريوهات المعقدة، بما في ذلك الحالات الطرفية التي غالبًا ما تتطلب مدخلات بشرية. من خلال دعم أكثر من 3000 عملية تكامل أصلية - وما يصل إلى 7000+ في تكوينات معينة - يتصل Lindy.ai بسلاسة مع أنظمة إدارة علاقات العملاء (CRM) ومنصات البريد الإلكتروني وأدوات التقويم. يسلط الرئيس التنفيذي فلو كريفيلو الضوء على هذه القدرة:

__XLATE_37__

يمكن لسير العمل المدعوم بالذكاء الاصطناعي التعامل مع تلك الحالات المتطورة والتكيف للحفاظ على استمرار التشغيل الآلي.

تعمل ميزة الطيار الآلي على تحسين الوظائف من خلال تزويد الوكلاء بأجهزة الكمبيوتر الخاصة بهم المستندة إلى السحابة، مما يمكنهم من تنفيذ المهام بما يتجاوز عمليات تكامل واجهة برمجة التطبيقات النموذجية. بالإضافة إلى ذلك، يتيح التنسيق بين الوكلاء المتعددين للوكلاء المتخصصين التعاون في العمليات التجارية المعقدة، مما يؤدي إلى سد الفجوة بين الأتمتة وصنع القرار في الوقت الفعلي.

تقدم Lindy.ai نموذج تسعير قائم على المهام، حيث تفرض رسومًا على تنفيذ المهمة بدلاً من كل مستخدم، مما يجعلها خيارًا اقتصاديًا للفرق ذات متطلبات الاستخدام العالية. تشمل مستويات التسعير ما يلي:

تشمل الرسوم الإضافية مكالمات هاتفية بتقنية الذكاء الاصطناعي بسعر 20 نقطة في الدقيقة وأرقام هواتف بتقنية الذكاء الاصطناعي بسعر 10 دولارات لكل رقم شهريًا، مما يوفر المرونة للمهام المتخصصة.

تم تصميم Lindy.ai للتوسع بسهولة، لاستيعاب المستخدمين الأفراد والشركات الكبيرة. تسمح حسابات الفريق بالمشاركة الآمنة ونشر وكلاء الذكاء الاصطناعي عبر الأقسام، بينما تتيح ميزة Agent Swarms لوكيل واحد استنساخ نفسه وتنفيذ مئات المهام في وقت واحد، مثل إدارة حملات التوعية الشخصية. بالنسبة لسير العمل الذي يتطلب الدقة، تتيح ميزة Human-in-the-Loop (HITL) للذكاء الاصطناعي التعامل مع معظم المهام ولكنها تتوقف مؤقتًا للمراجعة البشرية عند النقاط الحرجة، مما يجعلها مثالية للعمليات الحساسة في مجالات مثل التمويل أو الموارد البشرية أو دعم العملاء.

تعطي Lindy.ai الأولوية للأمان والامتثال، وتلبية المعايير الصارمة مثل SOC 2، وHIPAA، وGDPR، وPIPEDA. تتضمن المنصة مركز ثقة وأدوات إدارة سرية لتلبية متطلبات الأمان على مستوى المؤسسة. من خلال حسابات الفريق، يمكن للمؤسسات تكوين الأذونات وعناصر التحكم لضمان عمل الوكلاء بشكل آمن ويمكن التنبؤ به. بالنسبة لمقدمي الرعاية الصحية، تقدم Lindy.ai أداة تدوين ملاحظات متوافقة مع قانون HIPAA ومصممة خصيصًا للتوثيق الطبي، وتلبية الاحتياجات الفريدة للصناعات الخاضعة للتنظيم مثل الرعاية الصحية والتمويل.

يوفر StackAI نظامًا أساسيًا بدون تعليمات برمجية يعمل على ربط نماذج اللغات الكبيرة (LLMs) ببيانات المؤسسة من خلال لوحة مرئية بديهية ثنائية الأبعاد. يمكن لفرق العمل إنشاء مسارات عمل بسهولة باستخدام أدوات السحب والإفلات، في حين يتمتع المطورون بالمرونة اللازمة لتعزيز مسارات العمل هذه باستخدام عقد Python لإجراء تخصيص أعمق. في عام 2025، استخدم ستيفان جالوبي، مدير تكنولوجيا المعلومات في LifeMD، StackAI لتبسيط سير عمل الذكاء الاصطناعي المعقد، وإظهار فعالية النظام الأساسي.

يدعم هذا التصميم سهل الاستخدام التكامل السلس مع حاملي شهادات LLM الرائدة.

يدعم StackAI أصلاً أفضل حاملي شهادات LLM، بما في ذلك OpenAI وAnthropic (Claude) وMistral وGoogle وMeta وAzure OpenAI والنماذج المحلية عبر نقاط النهاية. يقدم التوجيه AI-Native الخاص به عقدًا منطقية لاتخاذ القرار إذا/آخر والمطالبة الديناميكية، مما يتيح توجيه المهام تلقائيًا بناءً على مخرجات LLM. تعمل عقدة قاعدة المعرفة المضمنة على تبسيط عملية إنشاء الاسترجاع المعزز (RAG) عن طريق التعامل مع التجزئة والتضمين والفهرسة والاسترجاع مع الاستشهادات، مما يغطي 90% من حالات استخدام RAG خارج الصندوق.

تتفوق المنصة أيضًا في معالجة البيانات غير المنظمة، وتقدم أدوات لتحليل ملفات PDF، وتقطيع الويب، والتعرف الضوئي على الحروف. يؤدي هذا إلى تحويل البيانات الأولية إلى رؤى منظمة يمكن نشرها كروبوتات محادثة، أو نماذج ويب، أو معالجات مجمعة للمهام المجمعة، أو واجهات برمجة تطبيقات REST للتكامل الخلفي. على سبيل المثال، في مركز مارتن ترست التابع لمعهد ماساتشوستس للتكنولوجيا، أنشأ دوج ويليامز، قائد الذكاء الاصطناعي العام، مساعدين للذكاء الاصطناعي للطلاب في أسابيع فقط، مما أحدث ثورة في تجربة التعلم الخاصة بهم دون الحاجة إلى مهارات البرمجة. وبالمثل، قام بريان هايت، مدير ذكاء الأعمال في Noblereach، بتقليل الوقت اللازم لإنشاء التقارير المستشهد بها بالكامل للمنح والأبحاث التنافسية من أسبوع إلى خمس دقائق فقط.

تقدم StackAI بنية تسعير واضحة ومرنة بثلاثة مستويات: خطة مجانية للنماذج الأولية في المرحلة المبكرة، ونموذج SaaS قائم على الاستخدام لتوسيع نطاق العمليات، وخطة Enterprise Custom مصممة لعمليات النشر على نطاق واسع، بما في ذلك الخيارات السحابية الخاصة أو المحلية.

ويضمن هذا التسعير المرن قدرة StackAI على دعم المستخدمين في كل مرحلة، بدءًا من النماذج الأولية صغيرة الحجم وحتى التطبيقات على مستوى المؤسسة.

تتكيف المنصة مع احتياجات الأفراد والمؤسسات، وتضم أكثر من 100 نموذج تم إعداده مسبقًا للنشر السريع. تتضمن الأدوات المخصصة للمؤسسات تسجيل الدخول الموحد (SSO) وحماية كلمة المرور والمجالات المخصصة والتحليلات المركزية لمراقبة استخدام الرمز المميز والأداء. يمكن للمطورين توسيع سير العمل باستخدام تعليمات برمجية مخصصة أو عقد واجهة برمجة التطبيقات (API)، بينما يستفيد المستخدمون غير التقنيين من أداة الإنشاء المرئية المباشرة. يسلط غييرمو راوخ، الرئيس التنفيذي لشركة Vercel، الضوء على إمكانية الوصول إليه:

__XLATE_51__

StackAI يجعل الوعد الذي قطعه عملاء الذكاء الاصطناعي حقيقيًا. للجميع، على نطاق واسع، بمجرد الإشارة والنقر.

هذا التوازن بين البساطة والوظائف المتقدمة يجعل StackAI أداة قوية للمؤسسات من جميع الأحجام.

يعطي StackAI الأولوية للأمان من خلال نموذج حوكمة مكون من 8 طبقات يتضمن RBAC، وعناصر التحكم على مستوى المجلد، وإصدارات المشروع، وتسجيل الدخول الموحد (SSO)، والاتصالات المشفرة، وتحليلات الإنتاج، وMFA. تتوافق المنصة مع معايير SOC 2 Type II وHIPAA وGDPR، مع حصولها على شهادة ISO 27001 قيد التقدم. تضمن ميزات مثل اكتشاف معلومات تحديد الهوية الشخصية وتنقيحها، وسياسات الاحتفاظ بالبيانات، والالتزام الصارم بعدم استخدام بيانات المستخدم للتدريب النموذجي بموجب عقود المؤسسة، خصوصية البيانات. بالنسبة للصناعات ذات المتطلبات الصارمة لمقر البيانات، مثل الدفاع والتمويل، يدعم StackAI عمليات النشر على السحابة المحلية والخاصة. بالإضافة إلى ذلك، تضمن مسارات عمل الموافقة اليدوية عدم تشغيل أي وكيل للذكاء الاصطناعي دون مراجعة مناسبة.

هذا النهج الشامل للحوكمة والأمن يجعل StackAI خيارًا موثوقًا به للمؤسسات ذات معايير الامتثال والخصوصية العالية.

Pipedream is a platform designed with developers in mind, blending serverless infrastructure with AI-driven workflow automation. It’s trusted by over 1,000,000 developers, from small startups to Fortune 500 companies, handling billions of events and supporting data pipelines that process over 10,000,000 events per second. After being acquired by Workday in December 2025, Pipedream has strengthened its focus on enterprise-level stability and governance, giving developers more control and flexibility in automation. This foundation supports its advanced AI integration capabilities.

The platform’s code-centric design is a key feature, allowing developers to write custom Node.js, Python, Go, or Bash code directly within workflows. It also supports the use of any npm or PyPI package in a serverless environment. This flexibility makes it easier for developers to prototype quickly without the limitations often found in no-code platforms.

يتضمن Pipedream أدوات الذكاء الاصطناعي مثل "الإنشاء باستخدام الذكاء الاصطناعي" و"التحرير باستخدام الذكاء الاصطناعي" و"التصحيح باستخدام الذكاء الاصطناعي" - المدعوم من String.com - لمساعدة المطورين في إنشاء مسارات العمل وتعديلها واستكشاف أخطائها وإصلاحها باستخدام مطالبات اللغة الطبيعية وإصلاحات الأخطاء التلقائية.

The platform supports the Model Context Protocol (MCP), which includes a Docs MCP Server. This feature enables AI assistants like Claude and development environments such as VSCode to search Pipedream documentation and generate precise integration code. Pre-built actions are available for popular LLMs like OpenAI and Claude, handling tasks such as text classification, summarization, and embeddings. Developers can also write their own code to interact with any LLM API using Pipedream’s serverless environment.

يستخدم Pipedream هيكل تسعير قائم على الائتمان حيث يساوي الرصيد الواحد 30 ثانية من وقت الحوسبة.

بالنسبة للمؤسسات، يتوفر التسعير المخصص مع ميزات إضافية مثل الامتثال لقانون HIPAA وسجلات التدقيق.

تم تصميم Pipedream لقابلية التوسع، حيث يقدم ميزات مثل الذاكرة القابلة للتعديل، والمهلات المخصصة، وحدود المعدل، وإدارة البدء البارد. وهو يدعم الأنماط المستندة إلى الأحداث والمشغلات في الوقت الفعلي، مما يجعله مثاليًا لمعالجة البيانات ذات الحجم الكبير والأتمتة الخلفية. بفضل أكثر من 3000 عملية تكامل للتطبيقات وإدارة المصادقة المضمنة، يمكن للفرق إنشاء مهام سير عمل معقدة دون القلق بشأن المعالجة اليدوية لبيانات الاعتماد.

بالنسبة لفرق المطورين، توفر المنصة أدوات مثل GitHub Sync وتكامل VS Code ونشر خادم MCP. تسمح ملاحظات الخطوة للمطورين بإضافة تفسيرات قائمة على تخفيض السعر مباشرةً إلى خطوات سير العمل، مما يؤدي إلى تحسين تواصل الفريق والتوثيق.

يعطي Pipedream الأولوية للحوكمة والأمن إلى جانب الأداء. المنصة حاصلة على شهادة SOC 2 Type II، ومتوافقة مع قانون HIPAA، وتفي بمعايير اللائحة العامة لحماية البيانات. ويتضمن اتفاقية معالجة البيانات (DPA) لإدارة البيانات الحساسة. تشمل ميزات الأمان الرئيسية ما يلي:

بالنسبة لمستخدمي المؤسسات، تتوفر خيارات إضافية مثل SAML SSO وSCIM لإدارة الهوية والمصادقة الثنائية (2FA). يتم تضمين تسجيل التدقيق في طبقة المؤسسة، مما يوفر رؤى حول عمليات تنفيذ سير العمل وتغييراته. بالإضافة إلى ذلك، تعمل المشغلات والإجراءات المتوفرة في المصدر على تعزيز شفافية مراجعات الأمان.

Workato is a platform designed to handle complex, cross-departmental processes for enterprises. It’s trusted by over 2,000 brands, including Broadcom, Zendesk, and Atlassian, to manage workflows that require high uptime and strict governance.

تتميز المنصة بوجود Workato Agentic & Genie Framework، الذي يستخدم الأتمتة المعتمدة على الذكاء الاصطناعي لتجاوز قدرات روبوتات الدردشة الأساسية. يمكن لوكلاء الذكاء الاصطناعي المتخصصين، الذين يطلق عليهم اسم "Genies"، استرداد البيانات، وتشغيل الإجراءات عبر أكثر من 8500 تطبيق، وإدارة العمليات الديناميكية. يعمل AI Connector، الذي تم تطويره بالتعاون مع Anthropic وOpenAI، على الاستفادة من نماذج مثل Anthropic's Sonnet 4 وOpenAI's GPT-4o mini للقيام بمهام مثل تحليل النص، وصياغة البريد الإلكتروني، والتلخيص، والترجمة.

At the heart of Workato’s AI capabilities is Workato Genie, which uses generative AI to interpret user intent, incorporate real-time enterprise data, and execute tasks autonomously. Bhaskar Roy, Chief of AI Products & Solutions at Workato, highlights its impact:

__XLATE_64__

"مع Workato Agentic، يمكن للشركات الآن إنشاء عملاء الذكاء الاصطناعي وإدارتهم بسرعة باستخدام تعليمات برمجية منخفضة/بدون تعليمات برمجية لزيادة الإنتاجية وزيادة الكفاءة التشغيلية في جميع أنحاء مؤسستهم."

يتضمن Workato أيضًا AIRO (AI Orchestrator)، وهو مساعد مدعوم بالذكاء الاصطناعي يساعد المستخدمين على إنشاء سير العمل وتحسينه باستخدام اللغة الطبيعية. توفر إجراءات الذكاء الاصطناعي التي تم تكوينها مسبقًا إمكانات LLM مدمجة، بينما يقوم Agent Studio بتوجيه القرارات الحساسة إلى البشر عبر Slack أو Microsoft Teams للحصول على الموافقة. بالنسبة لمساحات عمل العميل، تقتصر إجراءات موصل الذكاء الاصطناعي على 60 طلبًا في الدقيقة.

The platform offers pre-built applications known as Genie Apps, such as ITGenie for handling helpdesk tickets and SalesGenie to boost sales productivity. These Genies adapt based on user interactions, ensuring that learning remains specific to the customer’s environment to protect data privacy.

يقترن تكامل الذكاء الاصطناعي في Workato بالقدرة على التوسع بفعالية عبر المؤسسات الكبيرة.

Workato’s workflows are designed to scale across enterprises and mid-sized businesses, connecting with over 8,500 apps, databases, and ERP systems. With orchestration patterns capable of managing more than 850 billion actions, the platform also supports Data Pipelines for high-volume replication to data warehouses like Snowflake and Databricks. These pipelines use parallel execution and automatic schema updates to handle large datasets efficiently.

تعمل نماذج القرار على تبسيط منطق الأعمال المعقد، مثل التسعير الديناميكي أو تسجيل العملاء المتوقعين، من خلال تخزين القواعد في جداول مركزية خارج مسارات العمل الفردية. هذا الأسلوب يجعل التدقيق والتحديثات واضحة. وفي الوقت نفسه، تقوم جداول البيانات - وهي ترقية من جداول البحث - بتخزين مجموعات بيانات أكبر بكثير مع وظيفة البحث المتقدم.

Workato’s global infrastructure supports local data residency with data centers in the EU, Australia, and Singapore. The platform is available in eight languages, including Japanese, Korean, and Spanish, and maintains a 99.9% uptime SLA for critical operations. It has been recognized as a Leader in the Gartner® Magic Quadrant™ for iPaaS seven times, with two instances of being positioned furthest in "Vision" as of 2025.

لاستكمال قابليته للتوسع، يعطي Workato الأولوية للحوكمة والأمن.

Workato’s Enterprise MCP Gateway serves as a secure control layer between AI tools and business systems, enforcing policies and ensuring visibility during runtime. AI agents operate under user-specific OAuth credentials, limiting access to authorized data. Additional safeguards include PII masking and de-identification within workflows.

يمكن للمسؤولين تحديد "المهارات الموثوقة"، وهي عبارة عن وصفات أو موصلات معتمدة مسبقًا يمكن للوكلاء استخدامها، مما يمنع استدعاءات واجهة برمجة التطبيقات (API) غير المصرح بها. يضمن RBAC 2.0 أذونات دقيقة على مستوى المشروع، مع تجنب توسيع الأدوار غير الضرورية. تتضمن المنصة أيضًا إجراءات أمنية متقدمة مثل تشفير BYOK، وتدوير المفاتيح كل ساعة، وعزل الحاويات باستخدام mTLS. تشمل الشهادات SOC 2 Type II، وISO 27001، وPCI DSS، والامتثال للقانون العام لحماية البيانات (GDPR).

تضمن مسارات التدقيق في الوقت الفعلي والموافقات البشرية في الحلقة المساءلة عن جميع إجراءات الوكيل. تعمل ميزة المراجعات والموافقات على تبسيط نشر الوصفة عبر بيئات التطوير والاختبار والإنتاج. أبلغت إحدى المؤسسات عن معالجة طلبات نقل الموظفين بشكل أسرع بنسبة 98% باستخدام Workato.

يتبع Workato نموذج تسعير يركز على المؤسسة، دون أي أسعار متاحة للعامة. يتم تصميم التسعير بناءً على عوامل مثل عدد المهام واستخدام الموصل المتقدم وعدد المستخدمين. تنفق الشركات الصغيرة عادة ما بين 500 إلى 3000 دولار شهريًا، وشركات السوق المتوسطة من 3000 إلى 10000 دولار، وغالبًا ما تتجاوز المؤسسات الكبيرة 10000 دولار شهريًا للتكامل والدعم المخصص. تم تصميم النظام الأساسي للمؤسسات التي تتطلب حوكمة متقدمة وإدارة عمليات معقدة.

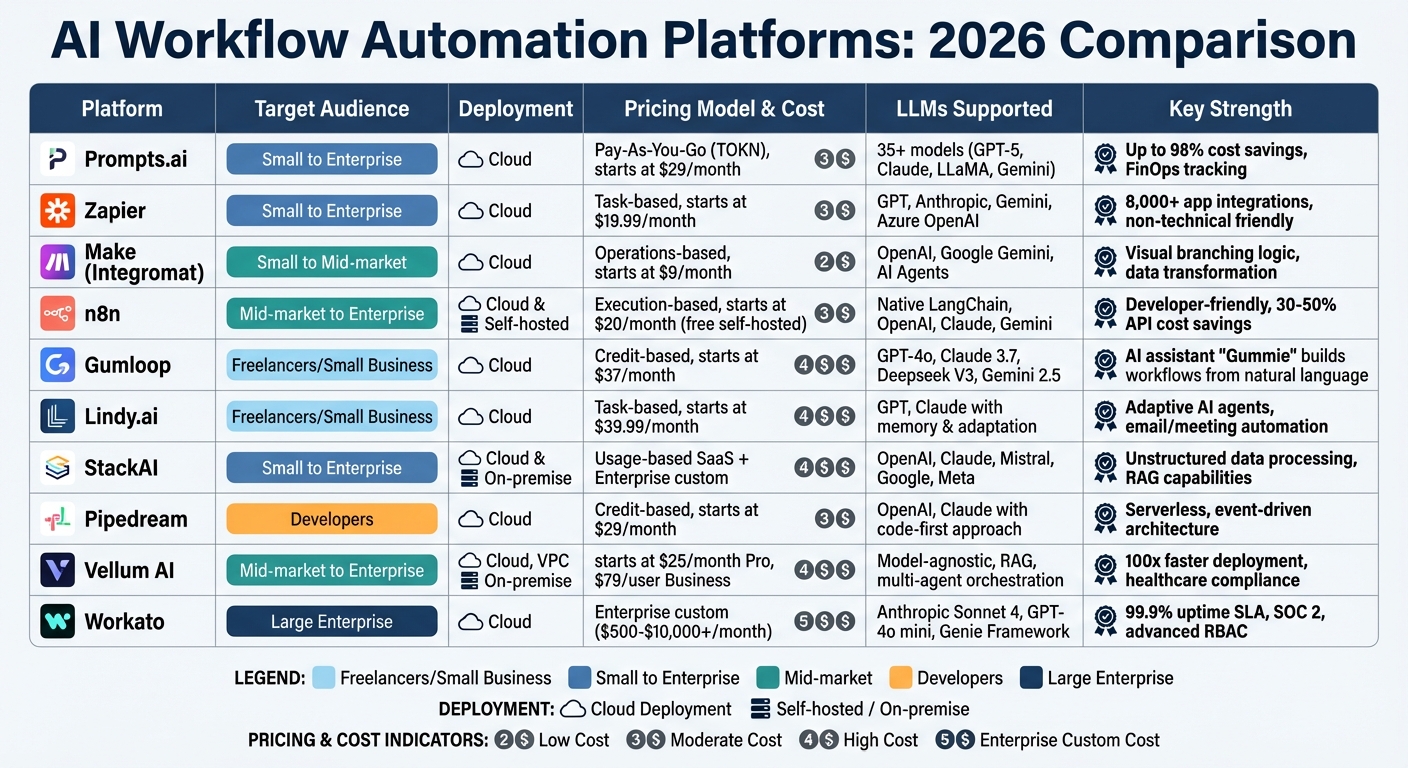

مقارنة منصة سير العمل بالذكاء الاصطناعي: الميزات والتسعير والمواصفات الجمهور المستهدف 2026

Choosing the right AI workflow platform depends on your team’s size, technical expertise, budget, and governance requirements. To simplify the decision-making process, the table below provides a side-by-side comparison of key features across various platforms.

تسلط هذه المقارنة الضوء على كيفية تلبية كل منصة لاحتياجات العمل المحددة، وموازنة نماذج التسعير ومرونة النشر. على سبيل المثال، يوفر n8n تكاليف ومرونة يمكن التنبؤ بها من خلال خيار الاستضافة الذاتية المجاني، مما يجعله جذابًا للفرق الفنية. في المقابل، تعطي منصات مثل Zapier الأولوية لسهولة الاستخدام للمستخدمين غير التقنيين ولكنها يمكن أن تصبح مكلفة مع حجم المهام الكبير.

عند النظر في خيارات النشر، تعد خصوصية البيانات عاملاً رئيسياً. على عكس معظم الأنظمة الأساسية السحابية فقط، يسمح n8n بالاستضافة الذاتية، مما يمنح الفرق التحكم الكامل في البنية التحتية الخاصة بهم. من ناحية أخرى، تركز حلول المؤسسات مثل Workato على الحوكمة المتقدمة والامتثال، مما يجعلها مثالية لإدارة سير العمل الحساسة ذات الحجم الكبير. تضمن هذه الفروق قدرة الشركات على مواءمة قدرات النظام الأساسي مع أولوياتها التشغيلية.

Choosing the right AI workflow platform in 2026 requires aligning your team's technical skills with your organization’s scale and compliance needs. For non-technical teams, tools like Zapier or Lindy.ai offer intuitive, prompt-based environments. On the other hand, developer-heavy organizations often prefer platforms like n8n or Pipedream, which provide greater customization through code extensions. A key differentiator among these platforms is how they manage workflow maintenance, a theme that has been explored throughout this guide.

يقدم التطور من الأتمتة الأساسية إلى سير عمل الذكاء الاصطناعي المستقل متطلبات جديدة - التعامل مع عملية صنع القرار الدلالي، والتوليد المعزز للاسترجاع، والتنسيق متعدد الوكلاء. وكما يقول نيكولاس ذيب:

__XLATE_77__

إن الطريق إلى الأمام في عام 2026 يحقق قفزة هائلة من كونه نظامًا مخصصًا لتطوير أتمتة الذكاء الاصطناعي فقط إلى رياضة جماعية.

يؤكد هذا التحول على أهمية المنصات التي تمزج المرونة التقنية مع ميزات الحوكمة، مما يسمح للمهندسين والخبراء المتخصصين بالتعاون بشكل فعال. تسلط هذه التحديات الضوء على أهمية مقاييس الأداء والشفافية التشغيلية.

تتميز الأنظمة الأساسية الجاهزة للإنتاج بميزات مثل التسجيل في الوقت الفعلي والتحكم في الإصدار وهياكل التسعير الواضحة. مع فشل 95% من طياري الذكاء الاصطناعي التوليدي في الانتقال إلى الإنتاج بسبب قيود البنية التحتية، تعد الأدوات التي تدعم إمكانية المراقبة والقدرة على التنبؤ بالتكلفة ضرورية. تحقق العديد من المؤسسات نتائج على مستوى الإنتاج في غضون 2 إلى 6 أسابيع من خلال البدء بالبرامج التجريبية المركزة، ودمج التوجيه الدلالي في وقت مبكر، وتقديم اختبار الانحدار بحلول الأسبوع الثالث.

وبعيدًا عن القدرات التقنية، يعد الامتثال التنظيمي والأمني أمرًا بالغ الأهمية لاعتماد المؤسسات. تضمن الميزات مثل التحكم في الوصول المستند إلى الدور (RBAC)، والامتثال لـ SOC 2، ومسارات التدقيق، وخيارات النشر المرنة إمكانية توسيع الأنظمة الأساسية مع تلبية المتطلبات التنظيمية. وكما تم توضيحه سابقًا، تقوم منصات مثل Prompts.ai وWorkato بدمج عناصر التحكم هذه بشكل فعال لتلبية احتياجات المؤسسات المتنوعة.

في حين أن وكلاء الذكاء الاصطناعي يمكن أن يساهموا بقيمة 450 مليار دولار بحلول عام 2028، إلا أن 2% فقط من المؤسسات قد احتضنتهم بالكامل. توفر الأنظمة الأساسية التي تمت مناقشتها في هذا الدليل الأساس لسد هذه الفجوة، وتحويل تجارب الذكاء الاصطناعي المعزولة إلى مسارات عمل قابلة للتطوير وقابلة للقياس تدفع الإنتاجية إلى الأمام.

توفر منصات سير عمل الذكاء الاصطناعي في عام 2026 مزايا تغير قواعد اللعبة للشركات والمهنيين على حدٍ سواء. إنها تعمل على تبسيط أتمتة المهام المعقدة، وتحسين كفاءة سير العمل، ومركزية إدارة نماذج الذكاء الاصطناعي المختلفة. وتؤدي هذه القدرات إلى تخفيضات كبيرة في التكاليف وزيادة في الإنتاجية تصل إلى عشرة أضعاف.

وبعيدًا عن الكفاءة، تعالج هذه المنصات القضايا الملحة مثل الامتثال والأمن والتحدي المتمثل في دمج أدوات متعددة. ومن خلال توحيد نماذج الذكاء الاصطناعي وأتمتة عمليات الحوكمة، فإنها تضمن سلاسة العمليات. كما أنها تتكامل بسهولة مع نماذج اللغات الكبيرة المتقدمة، مما يمكّن المؤسسات من توسيع نطاق عملياتها بفعالية مع الحفاظ على التحكم والإشراف على سير عمل الذكاء الاصطناعي الخاص بها. هذا المزيج من الكفاءة والرقابة يجعل هذه المنصات ضرورية لزيادة الإنتاجية والحفاظ على معايير تشغيلية عالية.

تُمكّن Prompts.ai الشركات من خفض النفقات مع الحفاظ على الشفافية من خلال تقديم تتبع التكلفة في الوقت الفعلي ونموذج تسعير مرن للدفع أولاً بأول. تسمح هذه الأدوات للشركات بمراقبة إنفاقها عن كثب والدفع فقط مقابل الموارد التي تستخدمها بنشاط، مما يضمن بقاء النفقات قابلة للتنبؤ بها وقابلة للتكيف.

علاوة على ذلك، تؤكد Prompts.ai على الأمان والامتثال، وتتميز بمعايير الامتثال SOC 2 Type II وHIPAA. وتساعد هذه التدابير على تقليل مخاطر الانتكاسات التنظيمية الباهظة الثمن. ومن خلال الجمع بين الإدارة الفعالة للتكاليف وضمانات الامتثال القوية، تساعد Prompts.ai المؤسسات على تبسيط سير عملها دون مواجهة عقبات مالية غير متوقعة.

تعطي منصات سير عمل الذكاء الاصطناعي الأولوية لبروتوكولات الأمان القوية لحماية المعلومات الحساسة وتلبية لوائح الصناعة. تشمل التدابير الرئيسية التشفير لحماية البيانات أثناء النقل وفي حالة عدم النشاط، وعناصر التحكم في الوصول المستندة إلى الأدوار لإدارة أذونات المستخدم، والامتثال لأطر العمل مثل SOC 2 وGDPR.

توفر العديد من الأنظمة الأساسية أيضًا ميزات متقدمة مثل اكتشاف التهديدات في الوقت الفعلي وإدارة المفاتيح الآمنة والشهادات التي تؤكد صحة تركيزها على الأمان. تساعد هذه الأدوات في تقليل المخاطر مثل الوصول غير المصرح به، وانتهاكات البيانات، وسرقة نماذج الذكاء الاصطناعي، مما يسمح للشركات بإدارة سير العمل المدعوم بالذكاء الاصطناعي بثقة.